Yayın özetini dinleyin:

Web sitem, her ziyaretçiyle birlikte gelişen özgün içeriğe sahip, iyi bakılmış bir bahçeyi andırıyor. Ancak, web sitelerinden veri çıkarma konusunda uzmanlaşmış yapay zeka araçlarının gelişmesiyle birlikte, bu istenmeyen veri çıkarma işlemlerini engellemek için sitemin savunmasını güçlendirme ihtiyacını fark ettim. Deneyimlerimden yola çıkarak şunları topladım: Web sitenizi yapay zeka tarafından yapılan veri kazıma işlemlerinden etkili bir şekilde koruma stratejileri. Sitenizi korumak için bazı adımları birlikte inceleyelim. Robots.txt yönergelerini uygulama, CAPTCHA doğrulama yöntemlerini kurma ve içeriğinizin yalnızca alan adınızda kalmasını sağlamak için ek yöntemler konusunda size rehberlik edeceğim. Her şey çevrimiçi dünyanızın kutsallığını korumak ve emeğinizin karşılığını yalnızca insan ziyaretçilerin almasını sağlamakla ilgili.

Dijital cennetinizi güvende tutma ruhuyla, "Sağlam bir kapı, yalnızca davetlilerin içerideki bahçenin tadını çıkarabilmesini sağlar" sözünü hatırlayın.“

Önemli Noktalar

Web sitemi yapay zekâ tabanlı veri hırsızlarından korumak, dikkat ve proaktif stratejiler gerektiren sürekli bir mücadele. Robots.txt dosyamı etkili bir şekilde yapılandırmanın, CAPTCHA kurmanın, bilinen yapay zekâ tabanlı veri hırsızlarını tespit edip engellemenin etkili olduğunu gördüm. aletler, İçeriğime kimlerin erişebileceğini kontrol etmek ve güvenlik protokollerini sık sık güncellemek çok önemli stratejilerdir. Yasal koruma eklemek ek bir savunma katmanı sağlar, ancak tetikte olmak ve teknik olarak yetenekli olmak, içeriğimi güvende tutmanın ve sitemin ziyaretçiler için değerini korumanın en iyi yoludur.

Veri toplama yöntemleri sürekli geliştiği için web sitenizin savunmasını güncel tutmayı unutmayın. Güvenlik ayarlarınızı düzenli olarak gözden geçirin ve içeriğinizin güvenliğini sağlamak için yeni zorluklara uyum sağlamaya hazır olun.

Yapay Zeka Destekli Web Kazıma İşlemlerini Anlamak

Veri Kazıma İşleminde Etik Kaygılar

Yapay Zekanın Etik Boyutlarını Anlamak İçerik Kazıma

Web sitenizden içerik çıkaran yapay zeka araçlarının etik yönleriyle neden ilgilenmelisiniz? Bu konuyu incelerken, veri gizliliğinin karmaşıklığına bakmak çok önemlidir. Düzenlenmemiş yapay zeka ile içerik çekme, içerik oluşturanların fikri mülkiyet haklarını ihlal edebilecek yetkisiz bilgi toplamaya yol açabilir. Ayrıca, verilerin nasıl toplandığı ve kullanıldığına dair yasalara uymak da önemlidir. Bu yasalar, bireyleri ve şirketleri gizlilik ihlallerinden ve bilgilerinin kötüye kullanılmasından korumayı amaçlamaktadır. Web sitenizin içeriğini güvende tutmak ve teknoloji ilerledikçe uygulamalarınızın etik açıdan sağlam olmasını sağlamak için bu düzenlemelerden haberdar olmak gereklidir.

Veri Kazıma İşlemlerine Karşı Önlemler

Web sitemden otomatik sistemlerin veri toplamasını önlemek için robots.txt dosyasında düzenli olarak ayarlamalar yapıyorum. Bu dikkatli uygulama, web sitemin hangi bölümlerinin GPTBot gibi botlar tarafından erişilebilir olduğunu belirlememi sağlıyor. Bu talimatları sürekli güncelleyerek, web sitesi içeriğimi otomatik araçlar tarafından yetkisiz olarak çıkarılmasından koruyorum.

Bunu yaparak sadece teknik bir rutini takip etmiyorum; büyük emeklerle oluşturduğum bilgilerin değerini ve gizliliğini korumak için bir duruş sergiliyorum. Web yöneticileri olarak, dijital varlıklarımızın kullanıcılarımızın güvenini kazanmış, erişilemez erişim yollarını güvence altına almak için tetikte ve proaktif olmalıyız.

Unutmayın, iyi bakımlı bir robots.txt dosyası, veri hırsızlarının amansız girişimlerine karşı basit ama etkili bir savunma katmanıdır.

Robots.txt dosyasını düzenli olarak güncelleyin.

Web sitenizin içeriğinin güvenliğini sağlamak, robots.txt dosyanızı düzenli olarak gözden geçirmek ve güncellemek anlamına gelir. İşte bunu etkili bir şekilde nasıl yapıyorum:

- Güncellemeler için düzenli bir program belirleyin.

- Sitenizin hangi bölümlerine kullanıcı aracıları (örneğin web tarayıcıları) erişebileceğini belirlemek için en iyi yöntemleri uygulayın.

- Olası güvenlik risklerinin önüne geçmek için yapay zeka destekli veri toplama araçlarındaki son gelişmeleri yakından takip edin.

- İçeriğinizin yetkisiz erişime karşı korunmasını sağlamak için, erişime kapalı yollarda gerekli ayarlamaları yapın.

Robots.txt dosyasını neden güncellemelisiniz?

Robots.txt dosyanızı güncellemek, web sitenizi korumanın basit ama güçlü bir yoludur. Arama motorlarına ve diğer web tarayıcılarına sitenizin hangi sayfalarına veya bölümlerine erişilmemesi gerektiğini söyler. endeksli. Bu, istenmeyen veri kazıma işlemlerini önlemeye yardımcı olabilir ve sitenizin içeriğini korumaya yönelik daha geniş bir stratejinin parçası olabilir.

Unutmayın, yeni web tarayıcı türleri ortaya çıktıkça, tetikte kalmak ve robots.txt dosyanızı uyarlamak akıllıca bir harekettir. İyi bakımlı bir robots.txt dosyası, web sitenizin genel güvenlik stratejisi için kritik öneme sahiptir.

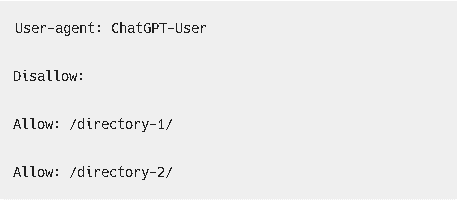

Robots.txt'i Etkin Bir Şekilde Kullanmak

Web sitenizi istenmeyen otomatik veri toplama işlemlerinden korumak için, robots.txt dosyasını nasıl dikkatlice güncelleyeceğimizi ele alalım. OpenAI'nin GPTBot'u gibi belirli web tarayıcılarına, özel kullanıcı aracısı kuralları oluşturarak sitenizin içeriğine erişmelerini veya onu atlamalarını söyleyebilirsiniz. Bu parametreleri ayrıntılara dikkat ederek ayarlayarak, sitenizin hangi bölümlerinin farklı yapay zeka sistemleri tarafından indekslenebileceği veya göz ardı edilebileceği konusunda kesin kontrol elde edersiniz.

Web sitenizi istenmeyen otomatik veri toplama işlemlerinden korumak için, robots.txt dosyasını nasıl dikkatlice güncelleyeceğimizi ele alalım. OpenAI'nin GPTBot'u gibi belirli web tarayıcılarına, özel kullanıcı aracısı kuralları oluşturarak sitenizin içeriğine erişmelerini veya onu atlamalarını söyleyebilirsiniz. Bu parametreleri ayrıntılara dikkat ederek ayarlayarak, sitenizin hangi bölümlerinin farklı yapay zeka sistemleri tarafından indekslenebileceği veya göz ardı edilebileceği konusunda kesin kontrol elde edersiniz.

Robots.Txt dosyasını doğru şekilde düzenleyin.

Web sitenizi istenmeyen yapay zeka destekli veri kazıma işlemlerinden korumak için robots.txt dosyanızı dikkatlice yönetmeniz hayati önem taşır. Bu adım, web sitenizin verilerinin gizliliğini korumak ve veri toplama yasalarına uymak için temeldir. İşte bunu etkili bir şekilde yapmanıza yardımcı olacak rehberim:

- Dosyayı BulÖncelikle, web sitemin sunucusuna giriş yaptım ve orada zaten mevcut olan robots.txt dosyasını aradım.

- Güncel Kuralları Gözden GeçirinArdından, mevcut kuralları ve bunların sitem için ne anlama geldiğini tam olarak anlamak için dosyayı yakından inceliyorum.

- Özenle GüncelleyinAyrıntılara dikkat ederek, yapay zeka sistemlerinin neler yapabileceğini ve neler yapamayacağını belirlemek için 'Disallow:' ile engelleme, 'Allow:' ile ise erişim izni verme yöntemini kullanarak yeni kurallar ekliyor veya mevcut kuralları ayarlıyorum.

- Düzenlemeleri DoğrulayınDeğişiklikleri yaptıktan sonra, kuralların doğru yazıldığından ve amaçlandığı gibi çalıştığından emin olmak için güncellenmiş robots.txt dosyasını test araçlarından geçiriyorum.

Bu adımları dikkatlice uygulayarak, sitemin güvenliğini sağlarken aynı zamanda ziyaretçileri ağırlamaya devam etmek için robots.txt dosyamı güncelliyorum. arama motorları Bu, insanların içeriğimi bulmasına yardımcı olur.

CAPTCHA Doğrulamasının Uygulanması

CAPTCHA doğrulama yöntemine dönecek olursak, bu yöntem yetkisiz otomatik veri toplama işlemlerine karşı sağlam bir bariyer görevi görür. Gerçek insan faaliyetini, yetkisiz işlemlerden ayırt ederek çalışır. otomatik yazılım, Bu sayede istenmeyen botlar etkili bir şekilde engellenirken gerçek kullanıcıların erişimine izin verilir. Bununla birlikte, CAPTCHA'yı entegre ederken, kullanıcı etkileşimi üzerindeki potansiyel etkilerini göz önünde bulundurmak çok önemlidir. Doğru dengeyi kurmak, web sitenizin kullanıcı dostu kalmasını sağlamanın anahtarıdır.

CAPTCHA Etkinliği

CAPTCHA kontrollerini entegre etmek, web sitemi yetkisiz erişimden korumak için sağlam bir stratejidir. içerik kazıma Otomatik araçlarla. İşte bunun neden etkili bir önlem olduğuna dair bakış açım:

- Karmaşık Zorluklar: Komplike CAPTCHA'lar, otomatik sistemler için çözülmesi zor, karmaşık bulmacalar oluşturur. Sistemler yine de insanlar için yönetilebilir durumda.

- Sürekli Güncellemeler: CAPTCHA algoritmalarını sık sık güncelleyerek, aksi takdirde değişmeyen sistemleri atlatabilecek yapay zekanın gelişimini geride bırakabilirler.

- Katmanlı GüvenlikCAPTCHA, diğer güvenlik önlemleriyle birlikte kullanıldığında, yetkisiz erişime karşı güçlendirilmiş bir bariyer oluşturur.

- Uyanıklık: CAPTCHA'nın performansını ve başarı oranını izlemek, ayarlamalar veya iyileştirmeler yapma zamanının geldiğini gösterebilir.

CAPTCHA eklemek güvenliği artırsa da, etik yönünü her zaman göz önünde bulunduruyorum ve kullanıcılar üzerindeki etkiyi mümkün olduğunca düşük tutmayı hedefliyorum. Sağlam güvenlik ile kullanıcı erişilebilirliği arasında doğru dengeyi bulmak dikkatli ve sürekli bir iştir.

Kullanıcı Deneyimi Etkisi

CAPTCHA kontrollerini uygularken, yapay zekâ kullanan botların içeriği kopyalamasını engellemede etkili olsalar bile, bazen kullanıcıları rahatsız edebileceklerinin farkındayım. Değerlendirmem, CAPTCHA'ların bu botları uzak tutmada etkili olduğunu, bu sayede web sitesi ziyaretçilerinin akışını yönetmeye ve içeriğin izinsiz kopyalanma olasılığını azaltmaya yardımcı olduğunu gösteriyor. Bununla birlikte, sitenizi ziyaret eden kişileri uzaklaştırmamak için bu aracı akıllıca kullanmak çok önemlidir. Her şey, içeriğinize kolayca ulaşmayı sağlamak ve istenmeyen yapay zekâ kopyalamasına karşı korumak arasında doğru dengeyi bulmakla ilgili. Çok fazla CAPTCHA testi, botlar kadar gerçek kullanıcıyı da uzaklaştırabilir. Sitenin geri kalanını kullanıcı dostu tutarken, kopyalamanın en olası olduğu alanlarda CAPTCHA kullanıyorum. Amacım, site ziyaretçilerine harika bir deneyim sunarken aynı zamanda sitenin içeriğini yapay zekâ tarafından yetkisiz kopyalamaya karşı güvende tutmaktır.

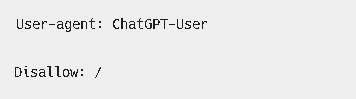

Belirli Yapay Zeka Tarayıcılarını Engelleme

Bir web sitesi işleten biri olarak, OpenAI'nin GPTBot'u gibi bazı yapay zeka tarayıcılarını engelleyerek sitemden içerik kopyalamalarını önleme olanağına sahibim. Bu adım sadece içeriğimin yetkisiz olarak toplanmasını engellemekle ilgili değil, aynı zamanda içerik kullanımına ilişkin etik standartlara ve yasal kurallara saygı göstermekle de ilgilidir. İşte benim yaklaşımım:

- Değiştir

robotlar.txtBu dosyayı, yapay zeka tarayıcılarının sitemin hangi bölümlerine erişiminin yasak olduğunu belirten özel talimatlarla düzenliyorum.

Kullanıcı aracısı: GPTBot

Yasakla: /

Kullanıcı aracısı: ChatGPT-User

Yasakla: /

Kullanıcı aracısı: CCBot

Yasakla: /

- Sunucu Günlüklerini Kontrol EdinSunucu günlüklerini inceleyerek olağan dışı görünen herhangi bir yapay zeka tarayıcı etkinliğini tespit etmeyi rutinimin bir parçası haline getirdim.

- CAPTCHA'ları KurunWeb sitemin kullanıcıların etkileşimde bulunduğu bölümlerinde CAPTCHA kullanıyorum. Bu testler, gerçek kişileri otomatik botlardan ayırt etmede çok başarılı.

- Belirli IP adreslerini engelleGerektiğinde, yapay zeka tarayıcılarıyla bağlantılı olduğunu bildiğim IP adreslerini engelleyerek siteme erişmelerini önlüyorum.

Bu sayede içeriğimi koruyor ve veri gizliliği ile fikri mülkiyetle ilgili kurallara uyduğumdan emin oluyorum.

İçerik Erişilebilirliğini Yönetme

Web Sitenizin İçeriğini Yetkisiz Veri Kazıma İşlemlerinden Koruma

İçerik kopyalama endişelerini gidermek için, web sitenizin içeriğine kimlerin erişebileceğini kontrol etmenin etkili yöntemlerini ele alalım. Bot girişini kısıtlamak hayati önem taşır ve bu otomatik sistemlerin sitenizin materyallerini kopyalamasını veya dizine eklemesini önlemek için belirli teknikleri özetleyeceğim. Bu, teknik değişiklikler ve erişim kontrol önlemlerinin dikkatli bir şekilde ayarlanmasını gerektirecektir.

Web Sitenizin İçeriğini Korumak

Bir web sitesini yönetenler için, içeriğinizin özel kalmasını ve otomatik veri kazıma sistemlerinden korunmasını sağlamak önemli bir konudur. Belirli teknik önlemler uygulamak, web sitenizin içeriğine kimlerin erişebileceğini ve dizine ekleyebileceğini kontrol etmenize yardımcı olabilir.

robots.txt dosyanızı düzenlemeyi düşünebilirsiniz. arama motoruna talimat vermek için dosya Sitenizin hangi bölümlerine botların erişmemesi gerektiğini belirleyebilirsiniz. CAPTCHA sistemleri kullanmak da insan kullanıcıları engellemeden botları caydırabilir. Daha gelişmiş bir yaklaşım için, meşru ziyaretçiler ile potansiyel veri kazıyıcıları ayırt etmek üzere sunucu tarafı kontrolleri uygulayabilirsiniz.

Unutmayın, içeriğinizin bütünlüğü ve özgünlüğü son derece önemlidir. Sitenizi güvence altına almak için proaktif adımlar atarak, içeriğiniz ve dağıtımı üzerindeki kontrolü elinizde tutarsınız. Sonuçta, oluşturduğunuz içerik markanızın bir yansımasıdır ve özenle korunmalıdır.

Bot Erişimini Sınırlama

Bot Erişimini Sınırlama

Sitemden otomatik sistemlerin içerik toplama riskini önemli ölçüde azaltmanın belirli adımlarla mümkün olduğunu keşfettim. İşte benim yaklaşımım:

- Robotları Ayarlama.txt: İnce ayar yapıyorum

robotlar.txtBot erişimini kontrol etmek için bir dosya oluşturulmalı, bu dosyada veri kazıma işlemlerinin yasal yönleri ve veri gizliliği endişeleri göz önünde bulundurulmalıdır. - Hız Sınırlarının UygulanmasıSunucuma hız sınırlamaları getirerek, bot trafiğinin potansiyel yıkıcı etkilerini azaltabilirim.

- API Kontrollerinin UygulanmasıAPI'ler aracılığıyla mümkün olduğunca az bilgi paylaşıyorum ve girişi kısıtlamak için uygun kimlik doğrulaması gerektiriyorum.

- İçerik Dağıtım Ağlarını KullanmakBot yönetimi özelliklerine sahip CDN'leri kullanmak, içeriğime kimlerin eriştiğini yönetmeme ve onu etkili bir şekilde korumama olanak tanıyor.

Bu adımları atmak, otomatik araçlar tarafından içeriğin yetkisiz olarak toplanmasına karşı güçlü bir savunma hattı oluşturur.

İçerik Kazıma Önleme

Güncelleme yaptıktan sonra robotlar.txt Şu anda, web sitemin erişilebilir ve güvenli kalmasını sağlamak için içerik kopyalamayı önlemeye yönelik önlemlere odaklanıyorum. Kopyalama işleminin teknik yönlerini, yasal sonuçlarını ve kullanıcı verilerini gelişmiş yapay zeka kopyalama yöntemlerinden korumanın önemini inceliyorum.

| Strateji | Tanım |

|---|---|

| Değişken İçerik Dağıtımı | Otomatik araçlara, insan ziyaretçilere sunulan içerikten farklı içerik sağlayın. |

| Kullanıcı Etkinliği İzleme | Veri kazıma işlemine işaret edebilecek davranışları kontrol edin. |

| Erişim Kısıtlamaları | Kullanıcıların içeriğe ne sıklıkla erişebileceğini kontrol edin ve şüpheli IP adreslerini engelleyin. |

Bu stratejileri dikkatlice uygulayarak, yalnızca web sitemin içeriğini korumakla kalmıyor, aynı zamanda kullanıcı bilgilerinin gizliliğini ve güvenliğini de sağlıyorum. Bu, web sitemin içeriğini yönetmek ve yetkisiz erişimi veya otomatik araçlar tarafından kötüye kullanımı engellemek için bilinçli bir plandır.

Bu stratejileri uygulamak, emeğinizi kötüye kullanmaya kalkışabilecek kişilerin önüne geçmenin akıllıca bir yoludur. Bu, sadece davetsiz misafirleri gözetlemekle kalmayıp aynı zamanda misafirlerinizin gizliliğine de saygı duyan gelişmiş bir alarm sistemi kurmaya benzer. Potansiyel tehditler karşısında tepkisel olmaktan ziyade proaktif olmakla ilgilidir.

Güvenlik Önlemlerinin Düzenli Olarak Güncellenmesi

Robots.txt dosyanızı düzenlemek veya CAPTCHA eklemek gibi ilk savunma önlemlerini almak harika bir başlangıçtır, ancak içeriği tarayan gelişmiş yapay zeka araçlarına karşı etkili bir şekilde korunmak için web sitenizin güvenlik stratejilerini sürekli olarak güncellemek hayati önem taşır. Teknoloji ortamı sürekli bir değişim halindedir; yapay zeka yetenekleri daha karmaşık hale gelmekte ve zaman zaman eski güvenlik yöntemlerinin önüne geçebilmektedir. Bu nedenle, web sitenizin güvenliğini sağlamak stratejik, teknolojiye hakim ve sistematik bir yaklaşım gerektirir.

İşte benim stratejim:

- Rutin Güvenlik İncelemeleriGüvenlik açıklarını tespit etmek ve önlemlerimle güncel ve etkili kalmak için düzenli aralıklarla güvenlik kontrolleri yapmaya özen gösteriyorum.

- Güncellemelerden Haberdar OlmakEn yeni güvenlik yamalarını takip ediyorum ve sitemin tüm yazılım unsurlarının güncel olduğundan emin oluyorum.

- Güvenlik Önlemlerinin UyarlanmasıGüvenlik ayarlarımı belirli tehditlerle başa çıkacak şekilde düzenliyorum; bu da içeriği korumak ve doğru nedenlerle erişilebilir olmasını sağlamak arasında sağlıklı bir denge kurmama yardımcı oluyor.

- Trafik Analizi ve RaporlamaSiteme gelen trafiğin akışını izleyerek ve erişim kayıtlarını inceleyerek, yapay zeka tarafından veri kazıma girişimi olabileceğini gösteren şüpheli davranışları hızlı bir şekilde tespit edip harekete geçebiliyorum.

Web sitemin güvenliğini sağlamak, bir kere kurup sonra unutabileceğim bir iş değil; kötü niyetli kişileri engellemek için sürekli bir mücadele. Güvenlik konusunda tetikte ve proaktif davranarak, sadece sitemin içeriğini değil, aynı zamanda ziyaret edenlerin gizliliğini de koruyorum.

Yasal Korumaları Keşfetmek

Hukuki karmaşıklıklarla boğuşurken, web sitemi yetkisiz yapay zeka kazıma işlemlerine karşı korumak için telif hakkı yasalarını ve düzenlemelerini inceliyorum. Ulusal ve uluslararası telif hakkı yasalarının sitemdeki materyali nasıl etkilediğini anlamak için sistematik bir yaklaşım benimsemek çok önemli. Ayrıca, yapay zeka kaynaklı ihlallere karşı içeriğimi nasıl koruyabileceğini görmek için Dijital Binyıl Telif Hakkı Yasası'nı (DMCA) da inceledim.

Yapay zeka araçlarının kullanım koşullarını değerlendirmek, bu araçların web sitelerinden veri toplama ve kullanma haklarını aşmamalarını sağlamak için sorumlu bir adımdır. Bu ayrıntılara gösterilen özen, sitemin kullanıcı deneyimini korumak ve içeriğimin kötüye kullanılmasını önlemek için çok önemlidir; aksi takdirde markamın etkisi azalabilir ve ziyaretçi etkileşimi düşebilir.

Ayrıca, veri kazıma girişimlerini tespit etmek ve önlemek için sıkı erişim kontrolleri ve sürekli trafik analizi gibi teknik stratejiler de düşünüyorum. Yasal önlemler ve teknik güvenlik tedbirlerinin bir kombinasyonu, web sitemin özgünlüğünü korumak ve arkasındaki yaratıcı emeği güvence altına almak için planımdır.

Sıkça Sorulan Sorular

Web sitemi kazıyan yapay zeka araçlarını engellersem, bu durum sitemin Google veya Bing gibi diğer arama motorlarındaki görünürlüğünü veya sıralamasını etkiler mi?

Yapay zekâ araçlarının web sitemi taramasını engellemenin, sitemin arama motoru optimizasyonundaki performansını değiştirip değiştirmeyeceğini düşünüyorum. Google gibi arama motorları veya Bing. Çevrimiçi görünürlükle ilgili her türlü karışıklığı gidermek önemlidir; bunlar Arama motorları sıralama için benzersiz algoritmalar kullanır.. Bunlar yalnızca yapay zeka araçlarının indekslemesine bağlı değil. Amacım içeriğimi korumak ve aynı zamanda arama motorlarında iyi bir konumda kalmak. arama sonuçları. Pratikte bu, kendimi korumak ile güvenliğimi sağlamak arasında dikkatli bir denge kurmak anlamına gelir. web sitesinin içeriği ve sağlam SEO elde etme sonuçlar.

Web sitemin trafiğini analiz ederken meşru arama motoru tarayıcıları ile yapay zeka veri kazıyıcılarını nasıl ayırt edebilirim?

Arama motoru tarayıcılarının meşru olanlarını yetkisiz yapay zeka veri toplayıcılarından ayırt etmek için, verilerime bakarken... web sitesinin trafiği, Kullanıcı davranışlarındaki otomatik etkileşimleri düşündüren kalıpları yakından inceliyorum. Potansiyel olarak zararlı trafiği engellemek için IP engelleme teknikleri uyguluyorum. Ayrıca, onaylanmamış botları tespit etmeme ve kontrol etmeme yardımcı olan bot algılama araçlarından da yararlanıyorum. Bu önlemler, sitemin saygın kişiler tarafından erişilebilir kalmasını sağlarken içeriğimi korumama yardımcı oluyor. arama motorları.

Gerçek ve yapay trafik arasındaki farkı anlamak, web sitemin analizlerinin doğru kalmasını ve içeriğimin yanlış ellere geçmemesini sağlar. Bir web sitesi sahibi olarak, tıpkı fiziksel bir mağazayı hırsızlardan korumak gibi, dijital mülkümü güvende tutmak benim sorumluluğumdur. Bu stratejilerle, web sitemin trafiğini güvenle yönetebilir ve bütünlüğünü koruyabilirim.

İznim olmadan bir yapay zeka aracı tarafından içeriğimin zaten kopyalandığını fark edersem hangi adımları atmalıyım?

İçeriğimin iznim olmadan bir yapay zeka aracı tarafından kullanıldığını keşfettiğimde, ilk adım bu ihlalin her örneğini titizlikle kaydetmektir. Ardından, sorumlu tarafla iletişime geçerek veya gerekirse DMCA kaldırma talepleri göndererek içeriğimi geri almaya çalışırım. Bu önlemler sorunu çözmezse, yasal yollara başvurmayı düşünebilirim. Ayrıca, çalışmalarımın izinsiz kullanımı hakkında kamuoyunu bilgilendirmek ve yapay zeka araçlarının etik kullanımını teşvik etmek faydalıdır. Çevrimiçi yaratıcı hakları korumada uyanıklık ve acil eylem çok önemlidir.

Unutmayın: Yaratıcı çalışmalarınızı korumak sadece bir hak değil; aynı zamanda bir sorumluluktur.

İçeriğimin yapay zeka modellerinin eğitiminde kullanılmaması gerektiğini belirtmek için filigran ekleme konusunda herhangi bir sektör standardı veya en iyi uygulama var mı?

Şu anda, yapay zeka modellerinin eğitiminde yetkisiz kullanımdan içeriklerimi koruma yöntemlerini inceliyorum. Bir yaklaşım, görünmez işaretler veya ayırt edici kodlar ekleyen dijital filigranlama ve içerik parmak izi kullanmaktır. Kullanımla ilgili açık politikalarla birleştirildiğinde, bu stratejiler materyallerimin yapay zeka modellerinin eğitimi için kullanılmaması gerektiğinin bir işareti olarak hizmet eder. Topluluk hala bu konuda ortak bir yönerge seti üzerinde çalışıyor, bu nedenle çalışmalarımın düzgün bir şekilde korunmasını sağlamak için en son stratejiler hakkında bilgi sahibi olmaya devam ediyorum.

“Verilerin sürekli olarak algoritmalara beslendiği bir çağda fikri mülkiyeti korumak, yaratıcılar için ortak bir endişe kaynağıdır. Proaktif ve bilgili olmak akıllıca bir davranıştır.”

Yapay zeka araçları CAPTCHA'yı atlatma yeteneği geliştirirse, web sitemi yetkisiz veri çıkarımından korumak için daha gelişmiş güvenlik stratejileri benimsemem gerekecek. Etkili yöntemlerden biri şudur: Davranışsal Biyometri, Bu sistem, kullanıcıların siteyle etkileşim biçimindeki düzensizlikleri izler. Bu, insan ziyaretçiler ile potansiyel otomatik veri kazıyıcılar arasında ayrım yapmaya yardımcı olabilir.

Bir diğer koruma katmanı şunları içerir: Parmak İzi Analizi. Bu teknik, işletim sistemi, ekran çözünürlüğü ve yüklü yazı tipleri gibi bir cihazın ve tarayıcısının benzersiz özelliklerini değerlendirerek, bot faaliyetlerine özgü tutarsızlıkları tespit eder.

Bir adım önde olmak için harekete geçerdim. Uyarlanabilir Zorluklar. Bunlar, değerlendirilen riske bağlı olarak karmaşıklığı değişebilen ve tespit edilen tehdit seviyesine göre ayarlanan dinamik bir savunma sağlayan güvenlik kontrolleridir. Bu gelişmiş yöntemleri kullanarak, web sitemin güvenliğini en yeni yapay zeka destekli veri kazıma araçlarına karşı önemli ölçüde güçlendirebilirim.

İnternet ortamında yapay zeka tarafından veri kazıma (scraping) koruması nedir?

Yapay zeka destekli veri kazıma koruması, otomatik botların izinsiz olarak web sitelerinden veri toplamasını veya kazımasını önlemek için kullanılan yöntem ve teknolojileri ifade eder. Bu teknolojiler, bu tür faaliyetleri tespit etmek, tanımlamak ve engellemek için yapay zeka yeteneklerinden yararlanır.

Yapay zekâ destekli veri kazıyıcılar internetteki fikri mülkiyet için neden bir tehdit oluşturuyor?

Yapay zekâ destekli veri toplama araçları, web üzerinde yayınlanan büyük miktarda özel bilgiyi hızlı ve verimli bir şekilde toplayabildikleri için tehdit oluşturmaktadır. Bu veriler, telif hakkıyla korunan içerik, ticari sırlar, veri tabanları veya yalnızca kaynak web sitesinde kullanılmak üzere tasarlanmış diğer dijital varlıkları içerebilir.

Yapay zekâ destekli veri çekme aracı nasıl çalışır?

Yapay zekâ destekli veri kazıyıcılar, insan tarama davranışını simüle ederek çalışır. Web sayfalarını ziyaret eder, önceden tanımlanmış kriterlere göre ilgili bilgileri belirler ve ardından bu verileri başka yerlerde kullanılmak üzere çıkarır. Bu araçların gelişmişlik düzeyi oldukça değişkendir; bazıları karmaşık site yapılarında gezinme ve temel veri kazıma önleme önlemlerinden kaçınma yeteneğine sahiptir.

Yapay zekâya yönelik veri kazıma işlemlerine karşı korumada yaygın olarak hangi teknikler kullanılır?

Yapay zekâ destekli veri kazıma saldırılarına karşı korumada sıklıkla kullanılan teknikler arasında, hız sınırlaması (bir IP adresinin belirli bir zaman dilimi içinde yapabileceği istek sayısını kısıtlama), CAPTCHA testleri (kullanıcıların insan olduklarını kanıtlamalarını gerektiren testler), kullanıcı aracısı analizi (şüpheli tarayıcı etkinliğini belirlemek için) ve bot davranışını gösteren olağandışı kalıpları tespit edebilen daha gelişmiş makine öğrenimi algoritmaları yer almaktadır.

Yapay zekâ, web kazıma faaliyetlerine karşı korunmada kullanılabilir mi?

Evet, makine öğrenmesi algoritmaları gibi çeşitli yapay zeka biçimleri, web kazıma işlemlerini tespit etmek ve önlemek için kullanılabilir. Bu sistemler, bot davranışlarının önceki örneklerinden öğrenerek, gelecekteki olası saldırıları daha iyi tahmin etmelerini ve engellemelerini sağlar. Ayrıca, şüpheli bot etkinliği meydana geldiğinde anında harekete geçmeyi sağlayan gerçek zamanlı tespit teknikleri de uygulayabilirler.

Web sitenizi yapay zeka araçları tarafından kopyalanmaya karşı korumaya ilişkin son düşüncelerim.

Web sitemi istenmeyen yapay zeka veri kazıma işlemlerinden korumak, özen gerektiren sürekli bir çabadır. Robots.txt dosyasını akıllıca kullanmanın, CAPTCHA uygulamanın, bilinen yapay zeka veri kazıyıcılarını engellemenin, içeriğe erişimi yönetmenin ve güvenlik önlemlerimi sürekli olarak güncellemenin hayati adımlar olduğunu gördüm. Yasal önlemler eklemek ek bir koruma katmanı sağlarken, dikkatli ve teknik olarak yetenekli olmak, içeriğimin kontrolüm altında kalmasını, dolayısıyla web sitemin bütünlüğünü ve ziyaretçilerine sunduğu değeri korumasını sağlamak için çok önemlidir.

Yetkili Referanslar

Web sitelerinizi yapay zeka tarayıcılarından koruma hakkında daha fazla bilgi edinmek istiyorsanız, aşağıdaki yazıyı incelemenizi öneririm:

- ITPro – Yapay Zeka Destekli Web Kazıma: İşletmenizi Nasıl Koruyabilirsiniz?

- Bu makale, yapay zekâ destekli web kazıma işlemlerinin karmaşıklığını ve ilgili riskleri ele almaktadır. Yapay zekânın verileri daha hızlı ve gelişmiş bir şekilde nasıl toplayabileceğine ve analiz ederek çıktılar üretebileceğine dair bilgiler sunmaktadır.

- ITPro Makalesi

- Yazarlar Birliği – Yazarların Eserlerini Yapay Zeka Kullanımından Korumaları İçin Pratik İpuçları

- Bu kaynak, yazarlara ve web sitesi sahiplerine, OpenAI'nin GPTBot'u gibi yapay zeka web tarayıcılarını engellemek için robots.txt dosyası kullanmak da dahil olmak üzere, eserlerini yapay zeka kullanımından nasıl koruyacakları konusunda pratik tavsiyeler sunmaktadır.

- Yazarlar Birliği İpuçları

- Resolution Digital – Web Sitenizi Koruyun Yapay Zeka İçeriği Kazıma

- Bu makale, web sitenizi ChatGPT gibi yapay zeka araçları tarafından yapılan veri kazıma ve yetkisiz kullanımdan korumak için basit adımlar sunmaktadır. Robots.txt dosyalarının kullanımı, CAPTCHA uygulaması ve IP aralığı engellemeleri ele alınmaktadır.

- Çözünürlük Dijital Kılavuzu

- Octoparse – Marka Koruması ve Siber Güvenlik için Web Kazıma Aracı

- Bu blog Bu yazı, web kazıma yönteminin marka koruma ve siber güvenlik için nasıl kullanılabileceğini inceliyor. Potansiyel ihlalleri ve telif hakkı ihlallerini bulmak için web kazıma araçlarının kullanımını ele alıyor.

- Octoparse Makalesi

- ScienceDirect – Yapay zekâ destekli web kazıma savaşları

- ScienceDirect'ten alınan bu makale, yapay zekânın web kazıma işlemine yönelik artan itirazları inceliyor ve yapay zekânın metin ve diğer dijital içeriklerden oluşan geniş veri kümeleri üzerinde eğitilmesindeki hızlı ilerlemeyi vurguluyor.

- ScienceDirect Makalesi