Luister naar de samenvatting van het bericht:

Mijn website lijkt op een goed onderhouden tuin, met originele content die met elke bezoeker tot bloei komt. Door de opkomst van AI-tools die data van websites kunnen extraheren, heb ik echter ingezien dat ik de beveiliging van mijn site moet versterken om deze ongewenste extracties te blokkeren. Door mijn ervaring heb ik het volgende verzameld: Strategieën om uw website effectief te beschermen tegen AI-scraping.. Laten we een aantal stappen doorlopen om uw site te beschermen. Ik zal u begeleiden bij het implementeren van robots.txt-richtlijnen, het instellen van CAPTCHA-uitdagingen en andere methoden om ervoor te zorgen dat uw content exclusief op uw domein blijft. Het draait allemaal om het beschermen van uw online domein en ervoor zorgen dat alleen menselijke bezoekers profiteren van uw harde werk.

Om uw digitale toevluchtsoord veilig te houden, onthoud dan: "Een stevige poort zorgt ervoor dat alleen degenen die welkom zijn, de tuin erachter kunnen bewonderen."“

Belangrijkste opmerkingen

Het beschermen van mijn website tegen AI-scrapers is een voortdurende strijd die aandacht en proactieve strategieën vereist. Ik heb gemerkt dat het effectief configureren van mijn robots.txt-bestand, het instellen van CAPTCHA en het identificeren en blokkeren van bekende AI-scrapers hierbij essentieel is. hulpmiddelen, Het controleren van wie toegang heeft tot mijn content en het regelmatig bijwerken van beveiligingsprotocollen zijn cruciale strategieën. Juridische bescherming biedt een extra verdedigingslaag, maar waakzaam blijven en technisch scherp blijven is de beste manier om mijn content te beveiligen en de waarde van mijn site voor bezoekers te behouden.

Vergeet niet om de beveiliging van uw website up-to-date te houden, aangezien methoden voor het scrapen van gegevens voortdurend verbeteren. Controleer regelmatig uw beveiligingsinstellingen en wees voorbereid op nieuwe uitdagingen om uw content veilig te houden.

Inzicht in AI-webscraping

Het wegnemen van ethische bezwaren

Inzicht in de ethische aspecten van AI Inhoud schrapen

Waarom zou u zich zorgen moeten maken over de ethische aspecten van AI-tools die content van uw website extraheren? Bij het onderzoeken van dit onderwerp is het essentieel om de complexiteit van gegevensprivacy te bekijken. Ongecontroleerde AI-scraping kan leiden tot het ongeoorloofd verzamelen van vertrouwelijke informatie, wat inbreuk kan maken op het intellectuele eigendom van de makers van de content. Het is ook belangrijk om te voldoen aan wetten die bepalen hoe gegevens worden verzameld en gebruikt. Deze wetten zijn bedoeld om individuen en bedrijven te beschermen tegen privacyschendingen en misbruik van hun gegevens. Op de hoogte blijven van deze regelgeving is noodzakelijk om de content van uw website te beschermen en ervoor te zorgen dat uw werkwijze ethisch verantwoord is naarmate de technologie zich verder ontwikkelt.

Tegenmaatregelen tegen scraping

Om te voorkomen dat geautomatiseerde systemen gegevens van mijn website verzamelen, pas ik regelmatig het robots.txt-bestand aan. Deze zorgvuldige procedure stelt me in staat te bepalen welke delen van mijn website toegankelijk zijn voor bots zoals GPTBot. Door deze instructies continu bij te werken, bescherm ik de inhoud van mijn website tegen ongeautoriseerde extractie door geautomatiseerde tools.

Daarbij volg ik niet zomaar een technische routine; ik neem een standpunt in om de waarde en privacy te beschermen van de informatie die ik met zoveel moeite heb gecreëerd. Als webmasters moeten we waakzaam en proactief zijn om onze digitale eigendommen te beveiligen en te voorkomen dat gebruikers essentiële informatie ontoegankelijk maken.

Onthoud dat een goed onderhouden robots.txt-bestand een eenvoudige maar effectieve verdedigingslinie vormt tegen de aanhoudende pogingen van data-scrapers.

Werk het Robots.txt-bestand regelmatig bij.

Om de veiligheid van de inhoud van uw website te waarborgen, is het belangrijk om uw robots.txt-bestand regelmatig te controleren en bij te werken. Zo doe ik dat effectief:

- Stel een vast schema in voor updates.

- Pas de beste methoden toe om te specificeren welke delen van uw site toegankelijk zijn voor gebruikersagenten (zoals webcrawlers).

- Houd de nieuwste ontwikkelingen op het gebied van AI-scrapingtools in de gaten om potentiële beveiligingsrisico's voor te blijven.

- Pas de ontoegankelijke paden indien nodig aan om ervoor te zorgen dat uw inhoud beschermd blijft tegen ongeautoriseerde toegang.

Waarom zou je je robots.txt bijwerken?

Het bijwerken van je robots.txt-bestand is een eenvoudige maar effectieve manier om je website te beschermen. Het vertelt zoekmachines en andere webcrawlers welke pagina's of gedeelten van je site niet bezocht mogen worden. geïndexeerd. Dit kan helpen om ongewenst scrapen te voorkomen en kan onderdeel zijn van een bredere strategie om de inhoud van uw site te beschermen.

Onthoud dat, naarmate er nieuwe soorten webcrawlers verschijnen, het verstandig is om alert te blijven en uw robots.txt-bestand aan te passen. Een goed onderhouden robots.txt-bestand is cruciaal voor de algehele beveiligingsstrategie van uw website.

Robots.txt effectief gebruiken

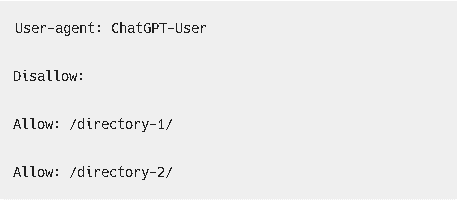

Om uw website te beschermen tegen ongewenste geautomatiseerde gegevensverzameling, bespreken we hoe u het robots.txt-bestand zorgvuldig kunt bijwerken. U kunt bepaalde webcrawlers, zoals GPTBot van OpenAI, instrueren om uw sitecontent wel of niet te benaderen door specifieke user-agent-regels aan te maken. Door deze parameters nauwkeurig in te stellen, krijgt u precieze controle over welke delen van uw site door verschillende AI-systemen wel of niet geïndexeerd mogen worden.

Om uw website te beschermen tegen ongewenste geautomatiseerde gegevensverzameling, bespreken we hoe u het robots.txt-bestand zorgvuldig kunt bijwerken. U kunt bepaalde webcrawlers, zoals GPTBot van OpenAI, instrueren om uw sitecontent wel of niet te benaderen door specifieke user-agent-regels aan te maken. Door deze parameters nauwkeurig in te stellen, krijgt u precieze controle over welke delen van uw site door verschillende AI-systemen wel of niet geïndexeerd mogen worden.

Bewerk het Robots.Txt-bestand op de juiste manier.

Om uw website te beschermen tegen ongewenste AI-gestuurde scraping, is het essentieel om uw robots.txt-bestand zorgvuldig te beheren. Deze stap is fundamenteel om de gegevens van uw website privé te houden en te voldoen aan de wetgeving inzake gegevensverzameling. Hier is mijn handleiding om dit effectief te doen:

- Zoek het bestandAllereerst logde ik in op de server van mijn website en zocht ik naar het robots.txt-bestand dat daar al aanwezig was.

- Bekijk de huidige regelsVervolgens bekijk ik het bestand nauwkeurig om de bestaande regels en hun betekenis voor mijn site volledig te begrijpen.

- Update met zorgMet oog voor detail pas ik regels aan of voeg ik nieuwe regels toe om te specificeren wat AI-systemen wel en niet mogen doen, waarbij ik 'Disallow:' gebruik om te blokkeren en 'Allow:' om toegang te verlenen.

- Controleer de bewerkingenNadat ik wijzigingen heb aangebracht, laat ik het bijgewerkte robots.txt-bestand door testers controleren of de regels correct zijn opgesteld en naar behoren functioneren.

Door deze stappen zorgvuldig uit te voeren, werk ik mijn robots.txt-bestand bij om mijn site veilig te houden en tegelijkertijd bezoekers te verwelkomen. zoekmachines die mensen helpen mijn content te vinden.

CAPTCHA-verificatie implementeren

Als we kijken naar CAPTCHA-verificatie, dan vormt deze methode een solide barrière tegen ongeautoriseerde geautomatiseerde gegevensverzameling. Het werkt door onderscheid te maken tussen echte menselijke activiteit en die van geautomatiseerde systemen. geautomatiseerde software, Dit blokkeert effectief ongewenste bots, terwijl echte gebruikers wel toegang krijgen. Bij het implementeren van CAPTCHA is het echter essentieel om rekening te houden met de mogelijke effecten ervan op de gebruikersinteractie. De juiste balans vinden is cruciaal om ervoor te zorgen dat uw website gebruiksvriendelijk blijft.

Effectiviteit van CAPTCHA

Het gebruik van CAPTCHA-controles is een degelijke strategie om mijn website te beschermen tegen ongeautoriseerde toegang. inhoud schrapen door geautomatiseerde tools. Dit is mijn visie op waarom het een effectieve maatregel is:

- Complexe uitdagingen: Verfijnd CAPTCHA's vormen ingewikkelde puzzels die moeilijk op te lossen zijn voor geautomatiseerde systemen. systemen, maar toch beheersbaar voor mensen.

- Constante updates: Door de CAPTCHA-algoritmes regelmatig te vernieuwen, kunnen ze de vooruitgang van AI voorblijven die anders onveranderlijke systemen zou kunnen omzeilen.

- Gelaagde beveiligingWanneer CAPTCHA samen met andere beveiligingsmaatregelen wordt gebruikt, vormt dit een versterkte barrière tegen ongeautoriseerde toegang.

- Waakzaamheid: Door de prestaties en het succespercentage van CAPTCHA te monitoren, kan worden vastgesteld wanneer het tijd is om aanpassingen of verbeteringen door te voeren.

Hoewel het toevoegen van CAPTCHA de beveiliging versterkt, houd ik altijd rekening met de ethische aspecten en streef ik ernaar de impact op gebruikers zo laag mogelijk te houden. Het vinden van de juiste balans tussen robuuste beveiliging en gebruiksvriendelijkheid is een zorgvuldige, voortdurende taak.

Impact op de gebruikerservaring

Hoewel ik CAPTCHA-controles implementeer, ben ik me ervan bewust dat ze gebruikers soms kunnen irriteren, ook al zijn ze effectief in het tegenhouden van bots die content scrapen met behulp van AI. Mijn analyse toont aan dat CAPTCHA's effectief zijn in het weren van deze bots, wat helpt bij het beheren van de bezoekersstroom op de website en de kans verkleint dat content zonder toestemming wordt gekopieerd. Desondanks is het cruciaal om deze tool verstandig te gebruiken om te voorkomen dat bezoekers van uw site afhaken. Het draait allemaal om het vinden van de juiste balans tussen het toegankelijk maken van uw content en het beschermen ervan tegen ongewenst scrapen door AI. Te veel CAPTCHA-controles kunnen net zoveel echte gebruikers als bots afschrikken. Ik gebruik CAPTCHA's op plekken waar scrapen het meest waarschijnlijk is, terwijl ik de rest van de site gebruiksvriendelijk houd. Mijn doel is om bezoekers een geweldige ervaring te bieden en tegelijkertijd de content van de site te beschermen tegen ongeautoriseerd scrapen door AI.

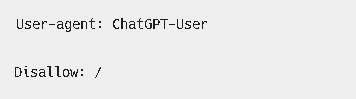

Het blokkeren van specifieke AI-crawlers

Als websitebeheerder heb ik de mogelijkheid om bepaalde AI-crawlers, zoals GPTBot van OpenAI, te blokkeren om te voorkomen dat ze content van mijn site kopiëren. Deze stap is niet alleen bedoeld om ongeoorloofde verzameling van mijn content te voorkomen, maar ook om ethische normen en wettelijke regels met betrekking tot contentgebruik te respecteren. Zo pak ik het aan:

- Bewerken

robots.txtIk pas dit bestand aan met specifieke instructies voor AI-crawlers, waarin wordt aangegeven tot welke delen van mijn site ze geen toegang hebben.

Gebruikersagent: GPTBot

Niet toestaan: /

Gebruikersagent: ChatGPT-User

Niet toestaan: /

Gebruikersagent: CCBot

Niet toestaan: /

- Controleer de serverlogboekenIk heb er een gewoonte van gemaakt om de logbestanden van mijn server te controleren op verdachte activiteiten van AI-crawlers.

- CAPTCHA's instellenOp de gedeeltes van mijn website waar gebruikers interactie hebben, gebruik ik CAPTCHA's. Deze tests zijn erg effectief om echte mensen te onderscheiden van geautomatiseerde bots.

- Bepaalde IP-adressen blokkeren: Indien nodig blokkeer ik de IP-adressen waarvan ik weet dat ze gekoppeld zijn aan AI-crawlers om ze buiten mijn site te houden.

Door dit te doen, bescherm ik mijn content en zorg ik ervoor dat ik de regels met betrekking tot gegevensbescherming en intellectueel eigendom naleef.

Toegankelijkheid van content beheren

Uw websitecontent beschermen tegen ongeautoriseerd scrapen

Om de zorgen over het scrapen van content aan te pakken, bespreken we effectieve methoden om te bepalen wie toegang heeft tot de content van uw website. Het is essentieel om de toegang van bots te beperken, en ik zal specifieke technieken beschrijven om te voorkomen dat deze geautomatiseerde systemen uw sitemateriaal kopiëren of indexeren. Dit vereist technische aanpassingen en een zorgvuldige instelling van toegangscontrolemaatregelen.

De inhoud van uw website beschermen

Voor websitebeheerders is het van groot belang dat de content exclusief blijft en beschermd is tegen geautomatiseerde scraping-systemen. Door specifieke technische maatregelen te implementeren, kunt u bepalen wie toegang heeft tot de content van uw website en deze kan indexeren.

Je zou kunnen overwegen om je robots.txt-bestand aan te passen. bestand om de zoekmachine te instrueren Bots kunnen zo bepaalde delen van uw site niet bezoeken. Het gebruik van CAPTCHA-systemen kan bots afschrikken zonder menselijke gebruikers te hinderen. Voor een meer geavanceerde aanpak kunt u server-side controles implementeren om onderscheid te maken tussen legitieme bezoekers en potentiële scrapers.

Onthoud dat de integriteit en exclusiviteit van uw content van het grootste belang zijn. Door proactieve stappen te nemen om uw site te beveiligen, behoudt u de controle over uw content en de verspreiding ervan. De content die u creëert, is immers een weerspiegeling van uw merk en moet met zorg worden beschermd.

Toegang van bots beperken

Toegang van bots beperken

Ik heb ontdekt dat ik door specifieke stappen te nemen het risico dat geautomatiseerde systemen content van mijn site verzamelen aanzienlijk kan verlagen. Zo pak ik het aan:

- Het aanpassen van Robots.txtIk stem mijn

robots.txtEen bestand aanmaken om de toegang van bots te beheren, rekening houdend met de juridische aspecten van scraping en zorgen over gegevensprivacy. - Het implementeren van snelheidslimietenDoor snelheidslimieten op mijn server in te stellen, kan ik de potentieel storende effecten van botverkeer beperken.

- API-besturingselementen toepassenIk deel zo min mogelijk informatie via API's en vereis een geldige authenticatie om de toegang te beperken.

- Gebruikmaken van contentleveringsnetwerkenDoor gebruik te maken van CDN's met botbeheerfuncties kan ik bepalen wie toegang heeft tot mijn content en deze effectief beveiligen.

Door deze stappen te nemen, vormt u een sterke verdedigingslinie tegen ongeoorloofde verzameling van content door geautomatiseerde tools.

Preventie van het scrapen van content

Na het bijwerken van mijn robots.txt Ik richt me nu op maatregelen om het scrapen van content te voorkomen, zodat mijn website toegankelijk maar ook veilig blijft. Ik onderzoek de technische aspecten van scraping, de juridische gevolgen ervan en het belang van het beschermen van gebruikersgegevens tegen geavanceerde AI-scrapingmethoden.

| Strategie | Beschrijving |

|---|---|

| Variabele inhoudslevering | Bied andere content aan geautomatiseerde tools dan aan menselijke bezoekers. |

| Gebruikersactiviteitsmonitoring | Zoek naar gedragingen die kunnen wijzen op webscraping. |

| Toegangsbeperkingen | Bepaal hoe vaak gebruikers toegang hebben tot content en blokkeer verdachte IP-adressen. |

Door deze strategieën zorgvuldig toe te passen, bescherm ik niet alleen de inhoud van mijn website, maar zorg ik er ook voor dat gebruikersinformatie privé en veilig blijft. Dit is een weloverwogen plan om de inhoud van mijn website te beheren en ongeautoriseerde toegang of misbruik door geautomatiseerde tools te voorkomen.

Het toepassen van deze strategieën is een slimme manier om potentiële misbruikers van uw harde werk een stap voor te blijven. Het is vergelijkbaar met het installeren van een geavanceerd alarmsysteem dat niet alleen indringers in de gaten houdt, maar ook de privacy van uw gasten respecteert. Het gaat erom proactief te handelen in plaats van reactief bij potentiële bedreigingen.

Beveiligingsmaatregelen regelmatig bijwerken

Het instellen van basisbeveiligingsmaatregelen, zoals het aanpassen van je robots.txt-bestand of het toevoegen van CAPTCHA, is een goede eerste stap. Maar om je effectief te beschermen tegen geavanceerde AI-tools die content scrapen, is het essentieel om de beveiligingsstrategieën van je website continu te vernieuwen. De technologische omgeving is constant in beweging, met steeds geavanceerdere AI-mogelijkheden die soms oudere beveiligingsmethoden omzeilen. Daarom vereist het onderhouden van de beveiliging van je website een strategische, technisch onderlegde en systematische aanpak.

Dit is mijn strategie:

- Regelmatige veiligheidscontrolesIk zorg ervoor dat ik regelmatig veiligheidscontroles uitvoer om eventuele zwakke punten op te sporen en ervoor te zorgen dat mijn beveiligingsmaatregelen actueel en effectief zijn.

- Blijf op de hoogte van de laatste updatesIk blijf op de hoogte van de nieuwste beveiligingspatches en zorg ervoor dat alle softwareonderdelen van mijn site up-to-date zijn.

- Beveiligingsmaatregelen aanpassenIk pas mijn beveiligingsinstellingen aan om specifieke bedreigingen aan te pakken, wat helpt om een gezond evenwicht te bewaren tussen het beschermen van content en ervoor zorgen dat deze om de juiste redenen toegankelijk is.

- Verkeersanalyse en -rapportageDoor de verkeersstromen naar mijn site in de gaten te houden en de toegangslogboeken te analyseren, kan ik snel verdacht gedrag identificeren en aanpakken dat zou kunnen wijzen op een poging tot AI-scraping.

Het beveiligen van mijn website is geen kwestie van instellen en vervolgens vergeten; het is een voortdurende uitdaging om kwaadwillenden af te weren. Door alert en proactief te blijven op het gebied van beveiliging, bescherm ik niet alleen de inhoud van mijn site, maar ook de privacy van de bezoekers.

Juridische bescherming onderzoeken

Ik ben bezig met het onderzoeken van de juridische complexiteit en de auteursrechtwetgeving met betrekking tot ongeoorloofde AI-scraping om mijn website te beschermen. Het is essentieel om een systematische aanpak te hanteren om te begrijpen hoe nationale en internationale auteursrechtwetten van invloed zijn op het materiaal op mijn site. Ik heb ook de Digital Millennium Copyright Act (DMCA) bestudeerd om te zien hoe deze mijn content kan beschermen tegen inbreuken door AI.

Het beoordelen van de gebruiksvoorwaarden van AI-tools is een verantwoorde stap om ervoor te zorgen dat ze hun rechten om gegevens van websites te verzamelen en te gebruiken niet overschrijden. Deze aandacht voor detail is essentieel om de gebruikerservaring van mijn site te behouden en misbruik van mijn content te voorkomen, wat de impact van mijn merk zou kunnen verminderen en de betrokkenheid van bezoekers zou kunnen verlagen.

Daarnaast overweeg ik technische strategieën zoals het implementeren van strikte toegangscontroles en continue verkeersanalyse om pogingen tot webscraping te identificeren en te beperken. Een combinatie van juridische maatregelen en technische beveiligingsmaatregelen is mijn plan om de unieke eigenschappen van mijn website te behouden en de creatieve inspanning erachter te beschermen.

Veelgestelde vragen

Als ik AI-tools blokkeer om mijn website te scrapen, heeft dat dan invloed op de zichtbaarheid of ranking van mijn site in andere zoekmachines zoals Google of Bing?

Ik overweeg of het voorkomen dat AI-tools mijn website scrapen, de prestaties van mijn site zou kunnen verbeteren. zoekmachines zoals Google of Bing. Het is belangrijk om eventuele verwarring over online zichtbaarheid op te helderen; deze Zoekmachines gebruiken unieke algoritmes voor de rangschikking.. Ze zijn niet uitsluitend afhankelijk van indexering door AI-tools. Mijn doel is om mijn content te beschermen en tegelijkertijd een goede positie te behouden in de zoekresultaten. zoekresultaten. In de praktijk betekent dit dat ik een zorgvuldige balans moet vinden tussen het beschermen van mijn websitecontent en het bereiken van solide SEO resultaten.

Hoe kan ik legitieme zoekmachinecrawlers onderscheiden van AI-scrapers bij het analyseren van het verkeer op mijn website?

Om legitieme zoekmachine-crawlers te onderscheiden van ongeautoriseerde AI-scrapers wanneer ik naar mijn gegevens kijk websiteverkeer, Ik analyseer nauwlettend patronen in gebruikersgedrag die kunnen wijzen op geautomatiseerde interacties. Om potentieel schadelijk verkeer buiten te houden, pas ik IP-blokkeringstechnieken toe. Ik maak ook gebruik van tools voor botdetectie, waarmee ik ongeautoriseerde bots kan opsporen en bestrijden. Deze maatregelen helpen me mijn content te beschermen en ervoor te zorgen dat mijn site toegankelijk blijft voor betrouwbare gebruikers. zoekmachines.

Het begrijpen van het verschil tussen echt en kunstmatig verkeer zorgt ervoor dat mijn website-analyses accuraat blijven en dat mijn content niet in verkeerde handen valt. Als website-eigenaar is het mijn verantwoordelijkheid om mijn digitale eigendom te beveiligen, net zoals je een fysieke winkel zou beschermen tegen winkeldieven. Met deze strategieën kan ik het verkeer op mijn website met vertrouwen beheren en de integriteit ervan waarborgen.

Welke stappen moet ik ondernemen als ik merk dat mijn content al zonder mijn toestemming door een AI-tool is verzameld?

Wanneer ik ontdek dat mijn content zonder mijn toestemming door een AI-tool is gebruikt, is de eerste stap het nauwkeurig vastleggen van elk geval van deze schending. Vervolgens probeer ik mijn content terug te krijgen door contact op te nemen met de verantwoordelijke partij, of indien nodig door een DMCA-verwijderingsverzoek in te dienen. Mochten deze maatregelen het probleem niet oplossen, dan is juridische actie een optie. Daarnaast is het nuttig om het publiek te informeren over het ongeoorloofde gebruik van mijn werk en zo het ethische gebruik van AI-tools te bevorderen. Waakzaamheid en onmiddellijk handelen zijn essentieel voor de bescherming van iemands creatieve rechten online.

Onthoud: het beschermen van je creatieve werk is niet alleen een recht, maar ook een plicht.

Zijn er industriestandaarden of best practices voor het watermerken van mijn content om aan te geven dat deze niet gebruikt mag worden voor het trainen van AI-modellen?

Ik ben momenteel bezig met het onderzoeken van methoden om mijn content te beschermen tegen ongeoorloofd gebruik bij het trainen van AI-modellen. Een mogelijke aanpak is het gebruik van digitale watermerken en content fingerprinting, waarbij onzichtbare markeringen of unieke codes in mijn werk worden ingevoegd. In combinatie met expliciete gebruiksrichtlijnen dienen deze strategieën als een signaal dat mijn materiaal niet mag worden gebruikt voor het trainen van AI-modellen. De community werkt nog steeds aan een gemeenschappelijke set richtlijnen hierover, dus ik blijf op de hoogte van de nieuwste strategieën om ervoor te zorgen dat mijn werk goed beschermd is.

“Het beschermen van intellectueel eigendom in een tijdperk waarin data constant in algoritmes wordt ingevoerd, is een gedeelde zorg voor makers. Het is verstandig om proactief en goed geïnformeerd te zijn.”

Mochten AI-tools in staat zijn om CAPTCHA te omzeilen, dan zou ik geavanceerdere beveiligingsstrategieën moeten toepassen om mijn website te beschermen tegen ongeautoriseerde gegevensextractie. Een effectieve methode is Gedragsbiometrie, Dit systeem monitort onregelmatigheden in de manier waarop gebruikers met de site interageren. Dit kan helpen onderscheid te maken tussen menselijke bezoekers en potentiële geautomatiseerde webscrapers.

Een andere beschermingslaag houdt in dat Vingerafdrukanalyse. Deze techniek analyseert de unieke kenmerken van een apparaat en de bijbehorende browser, zoals het besturingssysteem, de schermresolutie en de geïnstalleerde lettertypen, om inconsistenties te detecteren die kenmerkend zijn voor botactiviteit.

Om een stap voor te blijven, zou ik het volgende in de praktijk brengen: Adaptieve uitdagingen. Dit zijn beveiligingscontroles die in complexiteit kunnen variëren afhankelijk van het beoordeelde risico, waardoor een dynamische verdediging wordt gegarandeerd die zich aanpast aan het niveau van de gedetecteerde dreiging. Door deze geavanceerde methoden toe te passen, kan ik de beveiliging van mijn website aanzienlijk versterken tegen de nieuwste AI-gestuurde scrapingtools.

Wat is bescherming tegen AI-scraping in de context van het World Wide Web?

Bescherming tegen AI-scraping verwijst naar methoden en technologieën die worden gebruikt om te voorkomen dat geautomatiseerde bots zonder toestemming gegevens van websites verzamelen of scrapen. Deze technologieën maken gebruik van kunstmatige intelligentie om dergelijke activiteiten te detecteren, identificeren en blokkeren.

Waarom vormen AI-scrapers een bedreiging voor intellectueel eigendom op internet?

AI-scrapers vormen een bedreiging omdat ze snel en efficiënt grote hoeveelheden vertrouwelijke informatie van het web kunnen verzamelen. Deze gegevens kunnen auteursrechtelijk beschermde inhoud, bedrijfsgeheimen, databases of andere digitale activa bevatten die uitsluitend bedoeld zijn voor gebruik op de bronwebsite.

Hoe werkt een AI-scraper?

Een AI-scraper simuleert menselijk surfgedrag. Het bezoekt webpagina's, identificeert relevante informatie op basis van vooraf gedefinieerde criteria en extraheert deze gegevens vervolgens voor gebruik elders. De geavanceerdheid van deze tools varieert sterk; sommige zijn in staat om door complexe sitestructuren te navigeren en basismaatregelen tegen scraping te omzeilen.

Welke technieken worden doorgaans gebruikt ter bescherming tegen AI-scraping?

Technieken die vaak worden gebruikt ter bescherming tegen AI-scraping zijn onder andere rate limiting (het beperken van het aantal verzoeken dat een IP-adres binnen een bepaalde tijdsperiode kan doen), CAPTCHA-tests (waarbij gebruikers moeten bewijzen dat ze een mens zijn), analyse van de gebruikersagent (om verdachte browseractiviteit te identificeren) en meer geavanceerde machine learning-algoritmen die ongebruikelijke patronen kunnen detecteren die wijzen op botgedrag.

Kan kunstmatige intelligentie worden ingezet ter bescherming tegen webscraping?

Ja, diverse vormen van kunstmatige intelligentie, zoals machine learning-algoritmen, kunnen worden ingezet voor het detecteren en voorkomen van webscraping. Deze systemen leren van eerdere voorbeelden van botgedrag, waardoor ze potentiële toekomstige aanvallen beter kunnen voorspellen en afweren. Ze kunnen ook realtime detectietechnieken implementeren, waardoor direct actie kan worden ondernomen wanneer er vermoedelijke botactiviteit plaatsvindt.

Tot slot mijn gedachten over hoe je je website kunt beschermen tegen scraping door AI-tools.

Het beschermen van mijn website tegen ongewenste AI-scraping is een voortdurende inspanning die zorgvuldigheid vereist. Ik heb gemerkt dat slim gebruik van robots.txt, het implementeren van CAPTCHA, het blokkeren van herkende AI-scrapers, het beheren van de toegang tot content en het consequent bijwerken van mijn beveiligingsmaatregelen essentiële stappen zijn. Hoewel het toevoegen van juridische maatregelen een extra beschermingslaag biedt, is alert blijven en technisch onderlegd zijn cruciaal om ervoor te zorgen dat mijn content onder mijn controle blijft, waardoor de integriteit van mijn website en de waarde die deze biedt aan bezoekers behouden blijft.

Gezaghebbende referenties

Als je meer wilt lezen over het beschermen van je websites tegen AI-crawlers, raad ik je aan het volgende artikel te bekijken:

- ITPro – AI-webscraping: Hoe u uw bedrijf kunt beschermen tegen

- Dit artikel bespreekt de complexiteit van AI-webscraping en de bijbehorende risico's. Het geeft inzicht in hoe AI sneller en geavanceerder data kan verzamelen en analyseren om resultaten te genereren.

- ITPro-artikel

- Het Auteursgilde – Praktische tips voor auteurs om hun werk te beschermen tegen gebruik van AI

- Deze bron biedt praktisch advies aan auteurs en website-eigenaren over hoe ze hun werk kunnen beschermen tegen het gebruik van AI, bijvoorbeeld door een robots.txt-bestand te gebruiken om AI-webcrawlers zoals GPTBot van OpenAI te blokkeren.

- Tips van het Auteursgilde

- Resolution Digital – Bescherm uw website tegen AI-inhoud Schrapen

- Dit artikel biedt eenvoudige stappen om uw website te beschermen tegen scraping en ongeoorloofd gebruik door AI-tools zoals ChatGPT. Het bespreekt het gebruik van robots.txt-bestanden, de implementatie van CAPTCHA en het blokkeren van IP-adressen.

- Resolutie Digitale Gids

- Octoparse – Webscraping voor merkbescherming en cyberbeveiliging

- Deze blog Dit artikel onderzoekt hoe web scraping kan worden gebruikt voor merkbescherming en cyberbeveiliging. Het bespreekt het gebruik van web scraping-tools om potentiële inbreuken en auteursrechtenschendingen op te sporen.

- Octoparse-artikel

- ScienceDirect – De strijd tegen AI-webscraping

- Dit artikel van ScienceDirect onderzoekt de groeiende bezwaren tegen webscraping met behulp van AI, en belicht de snelle vooruitgang in AI en de training ervan op enorme datasets met tekst en andere digitale content.

- Artikel op ScienceDirect