ฟังสรุปโพสต์:

เว็บไซต์ของฉันเปรียบเสมือนสวนที่ได้รับการดูแลอย่างดี มีเนื้อหาต้นฉบับที่เพิ่มพูนขึ้นทุกครั้งที่มีผู้เข้าชม อย่างไรก็ตาม ด้วยความก้าวหน้าของเครื่องมือ AI ที่เชี่ยวชาญในการดึงข้อมูลจากเว็บไซต์ ฉันจึงตระหนักถึงความจำเป็นในการเสริมสร้างการป้องกันเว็บไซต์เพื่อบล็อกการดึงข้อมูลที่ไม่พึงประสงค์เหล่านี้ จากประสบการณ์ของฉัน ฉันได้รวบรวม... กลยุทธ์ในการปกป้องเว็บไซต์ของคุณจากการขูดข้อมูลด้วย AI อย่างมีประสิทธิภาพ. มาดูขั้นตอนการปกป้องเว็บไซต์ของคุณกันครับ ผมจะแนะนำวิธีการตั้งค่า robots.txt, การตรวจสอบ CAPTCHA และวิธีการเพิ่มเติมอื่นๆ เพื่อให้แน่ใจว่าเนื้อหาของคุณอยู่บนโดเมนของคุณเท่านั้น ทั้งหมดนี้ก็เพื่อรักษาความเป็นส่วนตัวของโลกออนไลน์ของคุณ และทำให้มั่นใจว่าผู้เข้าชมที่เป็นมนุษย์จะได้รับประโยชน์จากความพยายามของคุณ.

ในจิตวิญญาณของการรักษาที่หลบภัยดิจิทัลของคุณให้ปลอดภัย จงจำไว้ว่า “ประตูที่แข็งแรงทำให้แน่ใจว่าเฉพาะผู้ที่ได้รับการต้อนรับเท่านั้นที่จะชื่นชมสวนภายใน”

ประเด็นสำคัญ

การปกป้องเว็บไซต์ของฉันจากโปรแกรม AI ที่ดึงข้อมูลนั้นเป็นสงครามต่อเนื่องที่ต้องอาศัยความใส่ใจและกลยุทธ์เชิงรุก ฉันพบว่าการตั้งค่าไฟล์ robots.txt อย่างมีประสิทธิภาพ การตั้งค่า CAPTCHA การระบุและบล็อกโปรแกรม AI ที่รู้จักนั้นเป็นสิ่งสำคัญ เครื่องมือ, การควบคุมว่าใครสามารถเข้าถึงเนื้อหาของฉันได้บ้าง และการอัปเดตโปรโตคอลด้านความปลอดภัยอย่างสม่ำเสมอ เป็นกลยุทธ์ที่สำคัญมาก การเพิ่มการคุ้มครองทางกฎหมายเป็นการเพิ่มชั้นการป้องกันอีกชั้นหนึ่ง แต่การเฝ้าระวังและมีความเชี่ยวชาญด้านเทคนิคเป็นวิธีที่ดีที่สุดในการรักษาความปลอดภัยของเนื้อหาและรักษาคุณค่าของเว็บไซต์สำหรับผู้เข้าชม.

อย่าลืมอัปเดตระบบป้องกันเว็บไซต์ของคุณให้ทันสมัยอยู่เสมอ เพราะวิธีการดึงข้อมูลนั้นพัฒนาขึ้นอย่างต่อเนื่อง ตรวจสอบการตั้งค่าความปลอดภัยของคุณเป็นประจำและเตรียมพร้อมที่จะปรับตัวให้เข้ากับความท้าทายใหม่ๆ เพื่อรักษาความปลอดภัยของเนื้อหาของคุณ.

การทำความเข้าใจการดึงข้อมูลจากเว็บไซต์ด้วยปัญญาประดิษฐ์

ข้อกังวลทางจริยธรรมในการดึงข้อมูล

การเข้าใจมิติทางจริยธรรมของปัญญาประดิษฐ์ การขูดเนื้อหา

เหตุใดคุณจึงควรให้ความสำคัญกับแง่มุมทางจริยธรรมของการใช้เครื่องมือ AI ในการดึงเนื้อหาจากเว็บไซต์ของคุณ? เมื่อพิจารณาหัวข้อนี้ สิ่งสำคัญคือต้องพิจารณาถึงความซับซ้อนของความเป็นส่วนตัวของข้อมูล การดึงข้อมูลด้วย AI ที่ไม่มีการควบคุมอาจนำไปสู่การรวบรวมข้อมูลที่เป็นกรรมสิทธิ์โดยไม่ได้รับอนุญาต ซึ่งอาจละเมิดทรัพย์สินทางปัญญาของผู้ที่สร้างเนื้อหา นอกจากนี้ยังสำคัญที่จะต้องปฏิบัติตามกฎหมายที่ควบคุมวิธีการรวบรวมและใช้ข้อมูล กฎหมายเหล่านี้มีจุดมุ่งหมายเพื่อปกป้องบุคคลและบริษัทจากการละเมิดความเป็นส่วนตัวและการใช้ข้อมูลในทางที่ผิด การติดตามกฎระเบียบเหล่านี้อย่างสม่ำเสมอเป็นสิ่งจำเป็นเพื่อรักษาความปลอดภัยของเนื้อหาเว็บไซต์ของคุณและเพื่อให้มั่นใจว่าแนวทางปฏิบัติของคุณนั้นถูกต้องตามหลักจริยธรรมเมื่อเทคโนโลยีพัฒนาไป.

มาตรการตอบโต้การขูดข้อมูล

เพื่อป้องกันไม่ให้ระบบอัตโนมัติเก็บรวบรวมข้อมูลจากเว็บไซต์ของฉัน ฉันทำการปรับเปลี่ยนไฟล์ robots.txt เป็นประจำ การปฏิบัติอย่างรอบคอบนี้ช่วยให้ฉันสามารถกำหนดได้ว่าส่วนใดของเว็บไซต์ของฉันที่บอทเช่น GPTBot สามารถเข้าถึงได้ โดยการอัปเดตคำแนะนำเหล่านี้อย่างต่อเนื่อง ฉันปกป้องเนื้อหาของเว็บไซต์ของฉันจากการถูกดึงข้อมูลโดยไม่ได้รับอนุญาตจากเครื่องมืออัตโนมัติ.

ในการทำเช่นนั้น ผมไม่ได้แค่ทำตามขั้นตอนทางเทคนิคเท่านั้น แต่ผมกำลังยืนหยัดเพื่อปกป้องคุณค่าและความเป็นส่วนตัวของข้อมูลที่ผมได้ทุ่มเทสร้างมาอย่างหนัก ในฐานะผู้ดูแลเว็บไซต์ เราต้องระมัดระวังและริเริ่มเพื่อรักษาความปลอดภัยของเว็บไซต์ที่ผู้ใช้ไว้วางใจ ซึ่งเป็นสิ่งที่จำเป็นอย่างยิ่งที่จะต้องปิดกั้นไม่ให้เข้าถึง.

โปรดจำไว้ว่าไฟล์ robots.txt ที่ได้รับการดูแลอย่างดีเป็นชั้นป้องกันที่เรียบง่ายแต่มีประสิทธิภาพต่อความพยายามอย่างไม่หยุดยั้งของผู้ขูดข้อมูล.

อัปเดตไฟล์ Robots.txt เป็นประจำ

การรักษาความปลอดภัยของเนื้อหาเว็บไซต์ของคุณหมายถึงการตรวจสอบและอัปเดตไฟล์ robots.txt อย่างสม่ำเสมอ นี่คือวิธีการที่ผมใช้ได้อย่างมีประสิทธิภาพ:

- กำหนดตารางเวลาสำหรับการอัปเดตอย่างสม่ำเสมอ.

- ใช้วิธีการที่ดีที่สุดในการระบุส่วนใดของเว็บไซต์ของคุณที่ตัวแทนผู้ใช้ (เช่น เว็บครอลเลอร์) สามารถเข้าถึงได้.

- ติดตามการพัฒนาล่าสุดของเครื่องมือการขูดข้อมูล AI เพื่อรักษาความได้เปรียบเหนือความเสี่ยงด้านความปลอดภัยที่อาจเกิดขึ้น.

- ทำการปรับเปลี่ยนเส้นทางที่ห้ามเข้าให้เหมาะสมเพื่อให้แน่ใจว่าเนื้อหาของคุณยังคงได้รับการปกป้องจากการเข้าถึงโดยไม่ได้รับอนุญาต.

ทำไมต้องอัปเดตไฟล์ Robots.txt ของคุณ?

การอัปเดตไฟล์ robots.txt ของคุณเป็นวิธีที่ง่ายแต่ทรงพลังในการปกป้องเว็บไซต์ของคุณ มันบอกเครื่องมือค้นหาและโปรแกรมรวบรวมข้อมูลเว็บอื่นๆ ว่าหน้าหรือส่วนใดของเว็บไซต์ของคุณที่ไม่ควรเข้าถึงหรือ จัดทำดัชนี. วิธีนี้สามารถช่วยป้องกันการดึงข้อมูลที่ไม่พึงประสงค์ และเป็นส่วนหนึ่งของกลยุทธ์ที่ใหญ่กว่าในการปกป้องเนื้อหาเว็บไซต์ของคุณได้.

โปรดจำไว้ว่า เมื่อมีเว็บครอว์เลอร์ชนิดใหม่ๆ เกิดขึ้น การเฝ้าระวังและปรับแต่งไฟล์ robots.txt ของคุณจึงเป็นสิ่งสำคัญ ไฟล์ robots.txt ที่ได้รับการดูแลอย่างดีนั้นมีความสำคัญอย่างยิ่งต่อกลยุทธ์ด้านความปลอดภัยโดยรวมของเว็บไซต์ของคุณ.

การใช้ไฟล์ Robots.txt อย่างมีประสิทธิภาพ

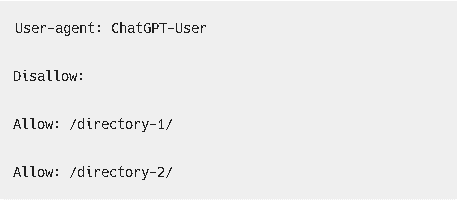

เพื่อปกป้องเว็บไซต์ของคุณจากการเก็บรวบรวมข้อมูลอัตโนมัติที่ไม่พึงประสงค์ เรามาพูดคุยกันถึงวิธีการอัปเดตไฟล์ robots.txt อย่างละเอียดกันดีกว่า คุณสามารถสั่งให้เว็บครอว์เลอร์บางตัว เช่น GPTBot ของ OpenAI เข้าถึงหรือข้ามเนื้อหาเว็บไซต์ของคุณได้โดยการสร้างกฎ user-agent เฉพาะ ด้วยการตั้งค่าพารามิเตอร์เหล่านี้อย่างละเอียด คุณจะสามารถควบคุมได้อย่างแม่นยำว่าส่วนใดของเว็บไซต์ของคุณสามารถถูกจัดทำดัชนีหรือถูกละเว้นโดยระบบ AI ต่างๆ ได้.

เพื่อปกป้องเว็บไซต์ของคุณจากการเก็บรวบรวมข้อมูลอัตโนมัติที่ไม่พึงประสงค์ เรามาพูดคุยกันถึงวิธีการอัปเดตไฟล์ robots.txt อย่างละเอียดกันดีกว่า คุณสามารถสั่งให้เว็บครอว์เลอร์บางตัว เช่น GPTBot ของ OpenAI เข้าถึงหรือข้ามเนื้อหาเว็บไซต์ของคุณได้โดยการสร้างกฎ user-agent เฉพาะ ด้วยการตั้งค่าพารามิเตอร์เหล่านี้อย่างละเอียด คุณจะสามารถควบคุมได้อย่างแม่นยำว่าส่วนใดของเว็บไซต์ของคุณสามารถถูกจัดทำดัชนีหรือถูกละเว้นโดยระบบ AI ต่างๆ ได้.

แก้ไขไฟล์ Robots.Txt อย่างถูกต้อง

เพื่อปกป้องเว็บไซต์ของคุณจากการถูกดึงข้อมูลโดย AI ที่ไม่พึงประสงค์ การจัดการไฟล์ robots.txt อย่างระมัดระวังจึงเป็นสิ่งสำคัญ ขั้นตอนนี้มีความสำคัญอย่างยิ่งในการรักษาความเป็นส่วนตัวของข้อมูลเว็บไซต์ของคุณและปฏิบัติตามกฎหมายเกี่ยวกับการเก็บรวบรวมข้อมูล นี่คือคำแนะนำของฉันในการดำเนินการอย่างมีประสิทธิภาพ:

- ค้นหาไฟล์ขั้นแรก ผมล็อกอินเข้าสู่เซิร์ฟเวอร์ของเว็บไซต์และค้นหาไฟล์ robots.txt ซึ่งมีอยู่แล้ว.

- ทบทวนกฎระเบียบปัจจุบัน: ต่อไป ฉันจะตรวจสอบไฟล์อย่างละเอียดเพื่อทำความเข้าใจกฎที่มีอยู่ทั้งหมดและผลกระทบต่อเว็บไซต์ของฉัน.

- อัปเดตด้วยความใส่ใจ: ด้วยความใส่ใจในรายละเอียด ฉันปรับแต่งหรือเพิ่มกฎใหม่เพื่อระบุว่าระบบ AI สามารถทำอะไรได้บ้างและทำอะไรไม่ได้บ้าง โดยใช้ 'ห้าม:' เพื่อบล็อก และ 'อนุญาต:' เพื่อให้สิทธิ์ในการเข้าถึง.

- ตรวจสอบการแก้ไขหลังจากที่ผมทำการเปลี่ยนแปลงเสร็จแล้ว ผมจะนำไฟล์ robots.txt ที่อัปเดตแล้วไปให้ผู้ทดสอบตรวจสอบ เพื่อให้แน่ใจว่ากฎต่างๆ เขียนถูกต้องและทำงานได้ตามที่ตั้งใจไว้.

โดยการดำเนินการตามขั้นตอนเหล่านี้อย่างรอบคอบ ฉันอัปเดตไฟล์ robots.txt ของฉันเพื่อให้เว็บไซต์ของฉันปลอดภัยในขณะที่ยังคงต้อนรับ เครื่องมือค้นหา ที่ช่วยให้ผู้คนค้นหาเนื้อหาของฉันได้.

การนำการตรวจสอบ CAPTCHA มาใช้

เมื่อหันมาพิจารณาการตรวจสอบ CAPTCHA วิธีนี้ทำหน้าที่เป็นอุปสรรคที่แข็งแกร่งต่อการเก็บรวบรวมข้อมูลโดยอัตโนมัติโดยไม่ได้รับอนุญาต มันทำงานโดยการแยกแยะระหว่างกิจกรรมของมนุษย์จริงกับ ซอฟต์แวร์อัตโนมัติ, ซึ่งช่วยป้องกันบอทที่ไม่พึงประสงค์ได้อย่างมีประสิทธิภาพ ในขณะที่อนุญาตให้ผู้ใช้จริงเข้าถึงได้ อย่างไรก็ตาม เมื่อนำ CAPTCHA มาใช้ จำเป็นอย่างยิ่งที่จะต้องพิจารณาผลกระทบที่อาจเกิดขึ้นต่อการโต้ตอบของผู้ใช้ การสร้างสมดุลที่เหมาะสมเป็นกุญแจสำคัญในการทำให้เว็บไซต์ของคุณยังคงใช้งานง่าย.

ประสิทธิผลของ CAPTCHA

การรวมการตรวจสอบ CAPTCHA เป็นกลยุทธ์ที่มั่นคงในการปกป้องเว็บไซต์ของฉันจากการเข้าถึงโดยไม่ได้รับอนุญาต การขูดข้อมูล โดยใช้เครื่องมืออัตโนมัติ นี่คือมุมมองของผมว่าทำไมมันถึงเป็นมาตรการที่มีประสิทธิภาพ:

- ความท้าทายที่ซับซ้อน: ซับซ้อน CAPTCHA เป็นปริศนาที่ซับซ้อนซึ่งยากสำหรับระบบอัตโนมัติที่จะแก้ไข ระบบ แต่ยังสามารถจัดการได้สำหรับผู้คน.

- การอัปเดตอย่างต่อเนื่อง: โดยการปรับปรุงอัลกอริทึม CAPTCHA อย่างสม่ำเสมอ พวกเขาสามารถก้าวล้ำหน้าการพัฒนาของ AI ที่อาจหลีกเลี่ยงระบบที่ไม่เปลี่ยนแปลงได้.

- ระบบความปลอดภัยแบบหลายชั้น: เมื่อใช้ CAPTCHA ร่วมกับมาตรการรักษาความปลอดภัยอื่น ๆ จะสร้างกำแพงที่แข็งแกร่งเพื่อป้องกันการเข้าถึงโดยไม่ได้รับอนุญาต.

- ความระมัดระวัง: การตรวจสอบประสิทธิภาพและอัตราความสำเร็จของ CAPTCHA สามารถบ่งชี้ได้ว่าถึงเวลาแล้วที่จะต้องปรับปรุงหรือแก้ไข.

แม้ว่าการเพิ่ม CAPTCHA จะช่วยเสริมความปลอดภัย แต่ฉันก็มักจะพิจารณาด้านจริยธรรมอยู่เสมอ และพยายามลดผลกระทบต่อผู้ใช้ให้น้อยที่สุด การหาจุดสมดุลที่เหมาะสมระหว่างความปลอดภัยที่แข็งแกร่งและการเข้าถึงของผู้ใช้เป็นงานที่ต้องทำอย่างรอบคอบและต่อเนื่อง.

ผลกระทบต่อประสบการณ์ผู้ใช้

ขณะที่กำลังติดตั้งระบบตรวจสอบ CAPTCHA ผมตระหนักดีว่าบางครั้งมันอาจสร้างความรำคาญให้กับผู้ใช้ แม้ว่ามันจะมีประสิทธิภาพในการป้องกันบอทที่ใช้ AI ในการคัดลอกเนื้อหา จากการประเมินของผมพบว่า CAPTCHA มีประสิทธิภาพในการป้องกันบอทเหล่านี้ ซึ่งช่วยจัดการการไหลเวียนของผู้เข้าชมเว็บไซต์และลดโอกาสที่เนื้อหาจะถูกคัดลอกโดยไม่ได้รับอนุญาต อย่างไรก็ตาม จำเป็นอย่างยิ่งที่จะต้องใช้เครื่องมือนี้อย่างชาญฉลาดเพื่อป้องกันไม่ให้ผู้เข้าชมเว็บไซต์ของคุณหนีไป สิ่งสำคัญคือการหาจุดสมดุลที่เหมาะสมระหว่างการทำให้เนื้อหาเข้าถึงได้ง่ายและการปกป้องเนื้อหาจากการคัดลอกโดย AI ที่ไม่พึงประสงค์ การทดสอบ CAPTCHA มากเกินไปอาจทำให้ผู้ใช้จริงหนีไปได้มากพอๆ กับบอท ผมใช้ CAPTCHA ในพื้นที่ที่มีโอกาสเกิดการคัดลอกมากที่สุด ในขณะที่ส่วนอื่นๆ ของเว็บไซต์ยังคงใช้งานง่าย เป้าหมายของผมคือการมอบประสบการณ์ที่ดีเยี่ยมแก่ผู้เข้าชมเว็บไซต์ ในขณะเดียวกันก็รักษาความปลอดภัยของเนื้อหาเว็บไซต์จากการคัดลอกโดย AI โดยไม่ได้รับอนุญาต.

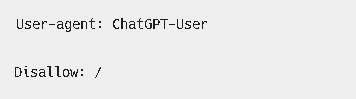

การบล็อกครอลเลอร์ AI เฉพาะเจาะจง

ในฐานะผู้ดูแลเว็บไซต์ ผมมีอำนาจในการบล็อกโปรแกรมรวบรวมข้อมูล AI บางตัว เช่น GPTBot ของ OpenAI เพื่อป้องกันไม่ให้มันคัดลอกเนื้อหาจากเว็บไซต์ของผม ขั้นตอนนี้ไม่ได้มีจุดประสงค์เพียงแค่หยุดการรวบรวมเนื้อหาโดยไม่ได้รับอนุญาตเท่านั้น แต่ยังเป็นการเคารพมาตรฐานทางจริยธรรมและกฎหมายเกี่ยวกับการใช้เนื้อหาด้วย นี่คือวิธีการที่ผมใช้:

- แก้ไข

ไฟล์โรบ็อตส์ทีทีเอ็กซ์: ฉันได้แก้ไขไฟล์นี้โดยเพิ่มคำแนะนำเฉพาะสำหรับโปรแกรมรวบรวมข้อมูล AI เพื่อระบุว่าส่วนใดของเว็บไซต์ที่โปรแกรมเหล่านั้นไม่สามารถเข้าถึงได้.

ผู้ใช้เอเจนต์: GPTBot

ไม่อนุญาต: /

ผู้ใช้: ChatGPT-User

ไม่อนุญาต: /

ผู้ใช้เอเจนต์: CCBot

ไม่อนุญาต: /

- ตรวจสอบบันทึกเซิร์ฟเวอร์ผมกำหนดให้การตรวจสอบบันทึกของเซิร์ฟเวอร์เป็นส่วนหนึ่งของกิจวัตรประจำวันของผม เพื่อตรวจจับกิจกรรมของโปรแกรมรวบรวมข้อมูล AI ที่ดูผิดปกติ.

- ตั้งค่า CAPTCHA: ในส่วนของเว็บไซต์ของฉันที่ผู้ใช้มีปฏิสัมพันธ์ ฉันใช้ CAPTCHA การทดสอบเหล่านี้มีประสิทธิภาพมากในการแยกแยะระหว่างคนจริงกับบอทอัตโนมัติ.

- บล็อกที่อยู่ IP บางรายการ: เมื่อฉันต้องการ ฉันจะบล็อกที่อยู่ IP ที่ฉันรู้ว่าเชื่อมโยงกับโปรแกรมรวบรวมข้อมูล AI เพื่อป้องกันไม่ให้พวกมันเข้ามาในเว็บไซต์ของฉัน.

ด้วยการกระทำเหล่านี้ ฉันจึงปกป้องเนื้อหาของฉันและทำให้แน่ใจว่าฉันปฏิบัติตามกฎหมายที่เกี่ยวข้องกับความเป็นส่วนตัวของข้อมูลและทรัพย์สินทางปัญญา.

การจัดการการเข้าถึงเนื้อหา

ปกป้องเนื้อหาเว็บไซต์ของคุณจากการขูดข้อมูลโดยไม่ได้รับอนุญาต

เพื่อแก้ไขข้อกังวลเกี่ยวกับการคัดลอกเนื้อหา เรามาพูดคุยถึงวิธีการที่มีประสิทธิภาพในการควบคุมว่าใครบ้างที่สามารถเข้าถึงเนื้อหาเว็บไซต์ของคุณได้ การจำกัดการเข้าถึงของบอทเป็นสิ่งสำคัญ และผมจะอธิบายเทคนิคเฉพาะเพื่อป้องกันระบบอัตโนมัติเหล่านี้จากการคัดลอกหรือจัดทำดัชนีเนื้อหาเว็บไซต์ของคุณ ซึ่งจะเกี่ยวข้องกับการเปลี่ยนแปลงทางเทคนิคและการตั้งค่ามาตรการควบคุมการเข้าถึงอย่างรอบคอบ.

ปกป้องเนื้อหาเว็บไซต์ของคุณ

สำหรับผู้ที่ดูแลเว็บไซต์ การทำให้มั่นใจว่าเนื้อหาของคุณเป็นเอกสิทธิ์เฉพาะและได้รับการปกป้องจากระบบการดึงข้อมูลอัตโนมัติเป็นเรื่องสำคัญ การใช้มาตรการทางเทคนิคเฉพาะเจาะจงจะช่วยให้คุณควบคุมได้ว่าใครบ้างที่สามารถเข้าถึงและจัดทำดัชนีเนื้อหาเว็บไซต์ของคุณได้.

คุณอาจพิจารณาปรับแต่งไฟล์ robots.txt ของคุณ ไฟล์เพื่อสั่งการเครื่องมือค้นหา ส่วนใดของเว็บไซต์ของคุณที่ไม่ควรให้บอทเข้าถึง การใช้ระบบ CAPTCHA ยังสามารถช่วยป้องกันบอทได้โดยไม่รบกวนผู้ใช้ที่เป็นมนุษย์ สำหรับวิธีการที่ซับซ้อนมากขึ้น คุณอาจใช้การตรวจสอบฝั่งเซิร์ฟเวอร์เพื่อแยกแยะระหว่างผู้เข้าชมที่ถูกต้องกับผู้ที่อาจเข้ามาขูดข้อมูล.

โปรดจำไว้ว่าความซื่อสัตย์และความเป็นเอกสิทธิ์ของเนื้อหาของคุณเป็นสิ่งสำคัญที่สุด การดำเนินการเชิงรุกเพื่อรักษาความปลอดภัยของเว็บไซต์ของคุณจะช่วยให้คุณควบคุมเนื้อหาและการเผยแพร่ได้อย่างเต็มที่ ท้ายที่สุดแล้ว เนื้อหาที่คุณสร้างขึ้นเป็นภาพสะท้อนของแบรนด์ของคุณและควรได้รับการปกป้องอย่างระมัดระวัง.

การจำกัดการเข้าถึงของบอท

การจำกัดการเข้าถึงของบอท

ฉันค้นพบว่าการทำตามขั้นตอนเฉพาะบางอย่างสามารถลดความเสี่ยงที่ระบบอัตโนมัติจะขโมยเนื้อหาจากเว็บไซต์ของฉันได้อย่างมาก นี่คือวิธีการที่ฉันใช้:

- การปรับแต่งไฟล์ Robots.txt: ฉันปรับแต่ง

ไฟล์โรบ็อตส์ทีทีเอ็กซ์ไฟล์เพื่อควบคุมการเข้าถึงของบอท โดยคำนึงถึงข้อกฎหมายที่เกี่ยวข้องกับการดึงข้อมูลและการคุ้มครองความเป็นส่วนตัวของข้อมูล. - การกำหนดขีดจำกัดอัตรา: โดยการกำหนดขีดจำกัดความเร็วบนเซิร์ฟเวอร์ของฉัน ฉันสามารถลดผลกระทบที่อาจเกิดขึ้นจากการจราจรของบอทได้.

- การนำไปใช้ของระบบควบคุม API: ฉันแบ่งปันข้อมูลน้อยที่สุดเท่าที่จำเป็นผ่าน API และต้องการการยืนยันตัวตนที่เหมาะสมเพื่อจำกัดการเข้าถึง.

- การใช้เครือข่ายการส่งมอบเนื้อหา: การใช้ CDN ที่มีคุณสมบัติการจัดการบอทช่วยให้ฉันสามารถจัดการผู้ที่เข้าถึงเนื้อหาของฉันและปกป้องมันได้อย่างมีประสิทธิภาพ.

การดำเนินการตามขั้นตอนเหล่านี้จะสร้างแนวป้องกันที่แข็งแกร่งต่อการเก็บรวบรวมเนื้อหาโดยไม่ได้รับอนุญาตโดยเครื่องมืออัตโนมัติ.

การป้องกันการขโมยเนื้อหา

หลังจากอัปเดตของฉัน ไฟล์โรบ็อตส์ทีทีเอ็กซ์ ขณะนี้ฉันกำลังมุ่งเน้นไปที่มาตรการป้องกันการคัดลอกเนื้อหา เพื่อให้มั่นใจว่าเว็บไซต์ของฉันยังคงเข้าถึงได้และปลอดภัย ฉันกำลังตรวจสอบแง่มุมทางเทคนิคของการคัดลอกเนื้อหา ผลกระทบทางกฎหมาย และความสำคัญของการปกป้องข้อมูลผู้ใช้จากวิธีการคัดลอกเนื้อหาด้วย AI ที่ซับซ้อน.

| กลยุทธ์ | คำอธิบาย |

|---|---|

| การส่งมอบเนื้อหาแบบปรับเปลี่ยนได้ | ให้เนื้อหาที่แตกต่างกันแก่เครื่องมืออัตโนมัติกับผู้เยี่ยมชมที่เป็นมนุษย์. |

| การตรวจสอบกิจกรรมของผู้ใช้ | ตรวจสอบพฤติกรรมที่อาจบ่งชี้ถึงการขูดข้อมูล. |

| ข้อจำกัดการเข้าถึง | ควบคุมความถี่ที่ผู้ใช้สามารถเข้าถึงเนื้อหาและบล็อกที่อยู่ IP ที่น่าสงสัย. |

ด้วยการวางแผนกลยุทธ์เหล่านี้อย่างรอบคอบ ผมไม่เพียงแต่ปกป้องเนื้อหาของเว็บไซต์เท่านั้น แต่ยังรักษาข้อมูลของผู้ใช้ให้เป็นส่วนตัวและปลอดภัยอีกด้วย นี่คือแผนการที่วางไว้อย่างรอบคอบเพื่อจัดการเนื้อหาของเว็บไซต์และป้องกันการเข้าถึงโดยไม่ได้รับอนุญาตหรือการใช้งานในทางที่ผิดโดยเครื่องมืออัตโนมัติ.

การนำกลยุทธ์เหล่านี้มาใช้เป็นวิธีที่ชาญฉลาดในการป้องกันตัวเองจากผู้ที่อาจพยายามนำผลงานของคุณไปใช้ในทางที่ผิด มันเหมือนกับการติดตั้งระบบเตือนภัยที่ซับซ้อน ซึ่งไม่เพียงแต่คอยจับตาดูผู้บุกรุกเท่านั้น แต่ยังเคารพความเป็นส่วนตัวของแขกของคุณด้วย มันคือการป้องกันล่วงหน้ามากกว่าการแก้ไขปัญหาภายหลังเมื่อเผชิญกับภัยคุกคามที่อาจเกิดขึ้น.

การปรับปรุงมาตรการรักษาความปลอดภัยอย่างสม่ำเสมอ

การตั้งค่าระบบป้องกันเบื้องต้น เช่น การปรับแต่งไฟล์ robots.txt หรือการเพิ่ม CAPTCHA เป็นจุดเริ่มต้นที่ดี แต่เพื่อป้องกันเครื่องมือ AI ขั้นสูงที่ดึงข้อมูลเนื้อหาอย่างมีประสิทธิภาพ จำเป็นอย่างยิ่งที่จะต้องปรับปรุงกลยุทธ์ด้านความปลอดภัยของเว็บไซต์อย่างต่อเนื่อง สภาพแวดล้อมทางเทคโนโลยีมีการเปลี่ยนแปลงอยู่ตลอดเวลา ความสามารถของ AI มีความซับซ้อนมากขึ้นและบางครั้งก็สามารถหลบเลี่ยงวิธีการรักษาความปลอดภัยแบบเก่าได้ ดังนั้น การรักษาความปลอดภัยของเว็บไซต์จึงต้องใช้แนวทางเชิงกลยุทธ์ มีความรู้ด้านเทคโนโลยี และเป็นระบบ.

นี่คือกลยุทธ์ของฉัน:

- การทบทวนความปลอดภัยตามปกติ: ฉันให้ความสำคัญกับการตรวจสอบความปลอดภัยอย่างสม่ำเสมอ เพื่อค้นหาจุดอ่อนที่อาจเกิดขึ้นใหม่ และเพื่อให้มั่นใจว่ามาตรการป้องกันของฉันทันสมัยและมีประสิทธิภาพอยู่เสมอ.

- ติดตามการอัปเดตอยู่เสมอ: ฉันติดตามข่าวสารเกี่ยวกับแพตช์ความปลอดภัยล่าสุดอยู่เสมอ และตรวจสอบให้แน่ใจว่าองค์ประกอบซอฟต์แวร์ทั้งหมดของเว็บไซต์ของฉันเป็นเวอร์ชันล่าสุด.

- การปรับมาตรการรักษาความปลอดภัยฉันปรับการตั้งค่าความปลอดภัยเพื่อรับมือกับภัยคุกคามเฉพาะเจาะจง ซึ่งช่วยรักษาสมดุลที่ดีระหว่างการปกป้องเนื้อหาและการทำให้มั่นใจว่าสามารถเข้าถึงได้เพื่อวัตถุประสงค์ที่ถูกต้อง.

- การวิเคราะห์และรายงานการจราจรด้วยการติดตามการไหลเวียนของปริมาณการเข้าชมเว็บไซต์และตรวจสอบบันทึกการเข้าถึงอย่างละเอียด ฉันจึงสามารถระบุและดำเนินการกับพฤติกรรมที่น่าสงสัยซึ่งอาจบ่งชี้ถึงความพยายามในการดึงข้อมูลโดยใช้ AI ได้อย่างรวดเร็ว.

การรักษาความปลอดภัยเว็บไซต์ของฉันไม่ใช่เรื่องที่ทำแล้วปล่อยทิ้งไว้ได้ มันเป็นความท้าทายอย่างต่อเนื่องในการป้องกันผู้ที่มีเจตนาร้าย ด้วยการตื่นตัวและดำเนินการเชิงรุกด้านความปลอดภัย ฉันจึงปกป้องไม่เพียงแต่เนื้อหาในเว็บไซต์ของฉันเท่านั้น แต่ยังรวมถึงความเป็นส่วนตัวของผู้เข้าชมด้วย.

การสำรวจการคุ้มครองทางกฎหมาย

ในการศึกษาความซับซ้อนทางกฎหมาย ฉันกำลังตรวจสอบกฎหมายลิขสิทธิ์และข้อบังคับเกี่ยวกับการคัดลอกข้อมูลโดยไม่ได้รับอนุญาตจาก AI เพื่อปกป้องเว็บไซต์ของฉัน จำเป็นอย่างยิ่งที่จะต้องใช้แนวทางที่เป็นระบบเพื่อทำความเข้าใจว่ากฎหมายลิขสิทธิ์ระดับชาติและระดับนานาชาติมีผลต่อเนื้อหาในเว็บไซต์ของฉันอย่างไร นอกจากนี้ ฉันยังได้ตรวจสอบพระราชบัญญัติลิขสิทธิ์ดิจิทัลแห่งสหัสวรรษ (DMCA) เพื่อดูว่าสามารถปกป้องเนื้อหาของฉันจากการละเมิดที่ขับเคลื่อนด้วย AI ได้อย่างไร.

การประเมินข้อกำหนดการใช้งานของเครื่องมือ AI เป็นขั้นตอนที่สำคัญเพื่อให้แน่ใจว่าเครื่องมือเหล่านั้นจะไม่ละเมิดสิทธิ์ในการใช้และรวบรวมข้อมูลจากเว็บไซต์ การใส่ใจในรายละเอียดเช่นนี้เป็นกุญแจสำคัญในการรักษาประสบการณ์การใช้งานเว็บไซต์ของผู้ใช้และป้องกันการใช้เนื้อหาในทางที่ผิด ซึ่งอาจลดทอนอิทธิพลของแบรนด์และลดการมีส่วนร่วมของผู้เข้าชมได้.

นอกจากนี้ ผมกำลังพิจารณากลยุทธ์ทางเทคนิค เช่น การใช้มาตรการควบคุมการเข้าถึงที่เข้มงวด และการวิเคราะห์ปริมาณการเข้าชมอย่างต่อเนื่อง เพื่อระบุและลดความพยายามในการคัดลอกข้อมูล ผมวางแผนที่จะรักษาเอกลักษณ์ของเว็บไซต์และปกป้องผลงานสร้างสรรค์ที่อยู่เบื้องหลังเว็บไซต์ โดยใช้มาตรการทางกฎหมายและมาตรการป้องกันทางเทคนิคควบคู่กันไป.

คำถามที่พบบ่อย

ถ้าฉันบล็อกไม่ให้เครื่องมือ AI ดึงข้อมูลจากเว็บไซต์ของฉัน จะส่งผลกระทบต่อการมองเห็นหรืออันดับของเว็บไซต์ฉันบนเครื่องมือค้นหาอื่นๆ เช่น Google หรือ Bing หรือไม่?

ฉันกำลังพิจารณาว่าการป้องกันไม่ให้เครื่องมือ AI ดึงข้อมูลจากเว็บไซต์ของฉัน อาจส่งผลต่อประสิทธิภาพของเว็บไซต์บนเครื่องมือค้นหาหรือไม่ เครื่องมือค้นหา เช่น Google หรือ Bing สิ่งสำคัญคือต้องชี้แจงความสับสนเกี่ยวกับความสามารถในการมองเห็นทางออนไลน์ให้ชัดเจน; เหล่านี้ เครื่องมือค้นหาใช้ขั้นตอนวิธีที่ไม่ซ้ำกันในการจัดอันดับ. พวกเขาไม่ได้พึ่งพาการจัดทำดัชนีโดยเครื่องมือ AI เพียงอย่างเดียว เป้าหมายของฉันคือการปกป้องเนื้อหาของฉันและยังคงรักษาตำแหน่งที่ดีไว้ได้ ผลการค้นหา. ในทางปฏิบัติ นี่หมายถึงการหาสมดุลอย่างรอบคอบระหว่างการปกป้อง เนื้อหาเว็บไซต์และการบรรลุ SEO ที่แข็งแกร่ง ผลลัพธ์.

ฉันจะแยกแยะระหว่างโปรแกรมรวบรวมข้อมูลของเครื่องมือค้นหาที่ถูกต้องตามกฎหมายกับโปรแกรมดึงข้อมูลด้วย AI ได้อย่างไรเมื่อวิเคราะห์ปริมาณการเข้าชมเว็บไซต์ของฉัน?

เพื่อแยกแยะระหว่างโปรแกรมรวบรวมข้อมูลของเครื่องมือค้นหาที่ถูกต้องตามกฎหมายกับโปรแกรมรวบรวมข้อมูล AI ที่ไม่ได้รับอนุญาตเมื่อดูที่ ปริมาณการเข้าชมเว็บไซต์, ฉันตรวจสอบรูปแบบพฤติกรรมของผู้ใช้อย่างใกล้ชิดที่อาจบ่งชี้ถึงการโต้ตอบอัตโนมัติ เพื่อป้องกันทราฟฟิกที่อาจเป็นอันตราย ฉันใช้เทคนิคการบล็อก IP นอกจากนี้ ฉันยังใช้ประโยชน์จากเครื่องมือตรวจจับบอท ซึ่งช่วยฉันระบุและควบคุมบอทที่ไม่ได้รับอนุญาต มาตรการเหล่านี้ช่วยปกป้องเนื้อหาของฉันในขณะที่ทำให้แน่ใจว่าเว็บไซต์ของฉันยังคงเข้าถึงได้สำหรับผู้ใช้ที่น่าเชื่อถือ เครื่องมือค้นหา.

การเข้าใจความแตกต่างระหว่างการเข้าชมเว็บไซต์ที่แท้จริงและการเข้าชมปลอม ช่วยให้การวิเคราะห์เว็บไซต์ของฉันแม่นยำ และป้องกันไม่ให้เนื้อหาตกไปอยู่ในมือผู้ไม่หวังดี ในฐานะเจ้าของเว็บไซต์ ฉันมีหน้าที่รับผิดชอบในการรักษาความปลอดภัยของทรัพย์สินดิจิทัลของฉัน เช่นเดียวกับการปกป้องร้านค้าจากโจรขโมย ด้วยกลยุทธ์เหล่านี้ ฉันจึงสามารถจัดการการเข้าชมเว็บไซต์และรักษาความสมบูรณ์ของเว็บไซต์ได้อย่างมั่นใจ.

หากฉันสังเกตเห็นว่าเนื้อหาของฉันถูกคัดลอกโดยเครื่องมือ AI โดยไม่ได้รับอนุญาตจากฉัน ฉันควรทำอย่างไร?

เมื่อพบว่าเนื้อหาของฉันถูกนำไปใช้โดยเครื่องมือ AI โดยไม่ได้รับอนุญาต ขั้นตอนแรกคือการบันทึกทุกกรณีของการละเมิดอย่างละเอียดถี่ถ้วน จากนั้น ฉันจะพยายามขอคืนเนื้อหาโดยการติดต่อฝ่ายที่รับผิดชอบ หรือหากจำเป็น ก็จะยื่นคำร้องขอให้ลบเนื้อหาตามกฎหมาย DMCA หากมาตรการเหล่านี้ไม่สามารถแก้ไขปัญหาได้ การพิจารณาใช้มาตรการทางกฎหมายก็เป็นอีกทางเลือกหนึ่ง นอกจากนี้ การแจ้งให้สาธารณชนทราบเกี่ยวกับการใช้ผลงานของฉันโดยไม่ได้รับอนุญาตก็เป็นประโยชน์เช่นกัน เพื่อส่งเสริมการใช้เครื่องมือ AI อย่างมีจริยธรรม ความระมัดระวังและการดำเนินการอย่างทันท่วงทีเป็นกุญแจสำคัญในการปกป้องสิทธิ์ในการสร้างสรรค์ของตนเองบนโลกออนไลน์.

โปรดจำไว้ว่า การปกป้องผลงานสร้างสรรค์ของคุณไม่ใช่แค่สิทธิ์ แต่เป็นความรับผิดชอบ.

มีมาตรฐานอุตสาหกรรมหรือแนวปฏิบัติที่ดีที่สุดสำหรับการใส่ลายน้ำในเนื้อหาของฉันเพื่อระบุว่าไม่ควรนำไปใช้ในการฝึกอบรมโมเดล AI หรือไม่?

ขณะนี้ฉันกำลังพิจารณาวิธีการปกป้องเนื้อหาของฉันจากการนำไปใช้โดยไม่ได้รับอนุญาตในการฝึกโมเดล AI วิธีหนึ่งคือการใช้ลายน้ำดิจิทัลและการสร้างลายนิ้วมือเนื้อหา ซึ่งเป็นการแทรกเครื่องหมายที่มองไม่เห็นหรือรหัสเฉพาะลงในงานของฉัน เมื่อรวมกับนโยบายการใช้งานที่ชัดเจน กลยุทธ์เหล่านี้จะทำหน้าที่เป็นสัญญาณว่าไม่ควรนำเนื้อหาของฉันไปใช้ในการฝึกโมเดล AI ชุมชนยังคงทำงานร่วมกันเพื่อกำหนดแนวทางปฏิบัติร่วมกันในเรื่องนี้ ดังนั้นฉันจึงติดตามข้อมูลเกี่ยวกับกลยุทธ์ล่าสุดเพื่อให้แน่ใจว่างานของฉันได้รับการปกป้องอย่างเหมาะสม.

“การปกป้องทรัพย์สินทางปัญญาในยุคที่ข้อมูลถูกป้อนเข้าสู่อัลกอริทึมอย่างต่อเนื่องเป็นเรื่องที่ผู้สร้างสรรค์ผลงานทุกคนให้ความสำคัญ การเตรียมตัวล่วงหน้าและติดตามข้อมูลอย่างรอบด้านจึงเป็นสิ่งสำคัญ”

หากเครื่องมือ AI สามารถพัฒนาความสามารถในการผ่าน CAPTCHA ได้ ฉันจำเป็นต้องนำกลยุทธ์การรักษาความปลอดภัยที่ซับซ้อนมากขึ้นมาใช้เพื่อปกป้องเว็บไซต์ของฉันจากการดึงข้อมูลโดยไม่ได้รับอนุญาต หนึ่งในวิธีที่มีประสิทธิภาพคือ ชีวมาตรพฤติกรรม, ซึ่งตรวจสอบความผิดปกติในการที่ผู้ใช้โต้ตอบกับเว็บไซต์ ซึ่งสามารถช่วยแยกแยะระหว่างผู้เยี่ยมชมที่เป็นมนุษย์กับผู้รวบรวมข้อมูลอัตโนมัติที่อาจเกิดขึ้นได้.

อีกชั้นหนึ่งของการป้องกันเกี่ยวข้องกับ การวิเคราะห์ลายนิ้วมือ. เทคนิคนี้ประเมินคุณลักษณะเฉพาะของอุปกรณ์และเบราว์เซอร์ เช่น ระบบปฏิบัติการ ความละเอียดหน้าจอ และฟอนต์ที่ติดตั้ง เพื่อตรวจจับความไม่สอดคล้องกันที่มักพบในกิจกรรมของบอท.

เพื่อให้ก้าวนำหน้าหนึ่งก้าว ฉันจะลงมือทำ ความท้าทายที่ปรับตัวได้. นี่คือการตรวจสอบความปลอดภัยที่มีความซับซ้อนแตกต่างกันไปตามระดับความเสี่ยงที่ประเมินได้ ทำให้มั่นใจได้ว่าระบบป้องกันจะปรับเปลี่ยนไปตามระดับภัยคุกคามที่ตรวจพบ การใช้วิธีการขั้นสูงเหล่านี้ช่วยเสริมความปลอดภัยของเว็บไซต์ได้อย่างมีประสิทธิภาพมากขึ้น เพื่อต่อต้านเครื่องมือดึงข้อมูลที่ใช้ AI รุ่นล่าสุด.

การป้องกันการขูดข้อมูลด้วย AI คืออะไรในบริบทของเวิลด์ไวด์เว็บ?

การป้องกันการขูดข้อมูลด้วย AI หมายถึงวิธีการและเทคโนโลยีที่ใช้เพื่อป้องกันไม่ให้บอทอัตโนมัติทำการเก็บรวบรวมหรือขูดข้อมูลจากเว็บไซต์โดยไม่ได้รับอนุญาต เทคโนโลยีเหล่านี้ใช้ความสามารถของปัญญาประดิษฐ์เพื่อตรวจจับ ระบุ และบล็อกกิจกรรมดังกล่าว.

ทำไมโปรแกรมรวบรวมข้อมูลด้วยปัญญาประดิษฐ์จึงเป็นภัยคุกคามต่อทรัพย์สินทางปัญญาบนอินเทอร์เน็ต?

โปรแกรมขูดข้อมูลด้วย AI เป็นภัยคุกคามเนื่องจากสามารถรวบรวมข้อมูลที่เป็นกรรมสิทธิ์จำนวนมากที่เผยแพร่บนเว็บได้อย่างรวดเร็วและมีประสิทธิภาพ ข้อมูลนี้อาจรวมถึงเนื้อหาที่มีลิขสิทธิ์ ความลับทางการค้า ฐานข้อมูล หรือทรัพย์สินดิจิทัลอื่นๆ ที่มีไว้เพื่อการใช้งานบนเว็บไซต์ต้นทางเท่านั้น.

เครื่องมือดึงข้อมูลด้วย AI ทำงานอย่างไร?

เครื่องมือสกัดข้อมูลด้วย AI ทำงานโดยการจำลองพฤติกรรมการท่องเว็บของมนุษย์ มันเข้าชมหน้าเว็บ ระบุข้อมูลที่เกี่ยวข้องตามเกณฑ์ที่กำหนดไว้ล่วงหน้า จากนั้นดึงข้อมูลนี้ไปใช้ในที่อื่น ความซับซ้อนของเครื่องมือเหล่านี้แตกต่างกันอย่างมาก บางเครื่องมือสามารถนำทางโครงสร้างเว็บไซต์ที่ซับซ้อนและหลบเลี่ยงมาตรการป้องกันการสกัดข้อมูลขั้นพื้นฐานได้.

เทคนิคใดบ้างที่มักใช้ในการป้องกันการขูดข้อมูลด้วย AI?

เทคนิคที่มักใช้ในป้องกันการขูดข้อมูลด้วย AI ได้แก่ การจำกัดอัตรา (การจำกัดจำนวนคำขอที่ที่อยู่ IP สามารถทำได้ภายในระยะเวลาที่กำหนด), การทดสอบ CAPTCHA (ซึ่งท้าทายผู้ใช้ให้พิสูจน์ว่าพวกเขาเป็นมนุษย์), การวิเคราะห์ตัวแทนผู้ใช้ (เพื่อระบุกิจกรรมของเบราว์เซอร์ที่น่าสงสัย), และอัลกอริธึมการเรียนรู้ของเครื่องขั้นสูงที่สามารถตรวจจับรูปแบบผิดปกติที่บ่งชี้ถึงพฤติกรรมของบอท.

ปัญญาประดิษฐ์สามารถนำมาใช้เพื่อป้องกันการกระทำของการขูดข้อมูลทางเว็บได้หรือไม่?

ใช่, รูปแบบต่าง ๆ ของปัญญาประดิษฐ์ เช่น อัลกอริทึมการเรียนรู้ของเครื่อง สามารถนำมาใช้เพื่อตรวจจับและป้องกันการขูดข้อมูลจากเว็บไซต์ได้ ระบบเหล่านี้เรียนรู้จากกรณีพฤติกรรมของบอทในอดีต ทำให้สามารถคาดการณ์และป้องกันการโจมตีที่อาจเกิดขึ้นในอนาคตได้ดีขึ้น พวกมันอาจใช้เทคนิคการตรวจจับแบบเรียลไทม์ซึ่งช่วยให้สามารถดำเนินการได้ทันทีเมื่อมีการสงสัยว่ามีการกระทำของบอทเกิดขึ้น.

ข้อคิดสุดท้ายของฉันเกี่ยวกับการปกป้องเว็บไซต์ของคุณจากการถูกเครื่องมือ AI ขูดข้อมูล

การรักษาความปลอดภัยของเว็บไซต์ของฉันจากการถูก AI ดึงข้อมูลโดยไม่ได้รับอนุญาตนั้นเป็นความพยายามอย่างต่อเนื่องที่ต้องใช้ความเอาใจใส่ ฉันพบว่าการใช้ robots.txt อย่างชาญฉลาด การใช้ CAPTCHA การบล็อก AI ที่รู้จัก การจัดการการเข้าถึงเนื้อหา และการอัปเดตมาตรการรักษาความปลอดภัยอย่างสม่ำเสมอเป็นขั้นตอนที่สำคัญ แม้ว่าการเพิ่มมาตรการทางกฎหมายจะช่วยเพิ่มระดับการป้องกัน แต่การตื่นตัวและมีความเชี่ยวชาญทางเทคนิคเป็นกุญแจสำคัญในการทำให้แน่ใจว่าเนื้อหาของฉันยังคงอยู่ภายใต้การควบคุมของฉัน ซึ่งจะช่วยรักษาความสมบูรณ์ของเว็บไซต์และคุณค่าที่เว็บไซต์มอบให้แก่ผู้เข้าชม.

เอกสารอ้างอิงที่น่าเชื่อถือ

หากคุณต้องการอ่านเพิ่มเติมเกี่ยวกับการปกป้องเว็บไซต์ของคุณจาก AI Crawlers ฉันขอแนะนำให้คุณดูโพสต์ต่อไปนี้:

- ITPro – การดึงข้อมูลจากเว็บไซต์ด้วย AI: วิธีปกป้องธุรกิจของคุณจาก

- บทความนี้กล่าวถึงความซับซ้อนของการดึงข้อมูลจากเว็บไซต์ด้วยปัญญาประดิษฐ์ (AI web scraping) และความเสี่ยงที่เกี่ยวข้อง โดยให้ข้อมูลเชิงลึกเกี่ยวกับวิธีที่ AI สามารถรวบรวมข้อมูลได้ด้วยความรวดเร็วและความซับซ้อนที่มากขึ้น รวมถึงการวิเคราะห์ข้อมูลเพื่อสร้างผลลัพธ์ที่ต้องการ.

- บทความ ITPro

- สมาคมนักเขียน – เคล็ดลับปฏิบัติสำหรับนักเขียนในการปกป้องผลงานจากการใช้งาน AI

- แหล่งข้อมูลนี้เสนอคำแนะนำที่เป็นประโยชน์สำหรับนักเขียนและเจ้าของเว็บไซต์เกี่ยวกับวิธีการปกป้องผลงานของตนจากการใช้งาน AI ซึ่งรวมถึงการใช้ไฟล์ robots.txt เพื่อบล็อกโปรแกรมรวบรวมข้อมูลเว็บ AI เช่น GPTBot ของ OpenAI.

- คำแนะนำจากสมาคมนักเขียน

- Resolution Digital – ปกป้องเว็บไซต์จาก เนื้อหา AI การดึงข้อมูล

- บทความนี้นำเสนอขั้นตอนง่ายๆ เพื่อปกป้องเว็บไซต์ของคุณจากการขูดข้อมูลและการใช้งานโดยไม่ได้รับอนุญาตจากเครื่องมือ AI เช่น ChatGPT โดยจะกล่าวถึงการใช้ไฟล์ robots.txt การติดตั้ง CAPTCHA และการบล็อกช่วง IP.

- คู่มือดิจิทัลสำหรับ Resolution

- Octoparse – การดึงข้อมูลจากเว็บไซต์เพื่อการปกป้องแบรนด์และความปลอดภัยทางไซเบอร์

- สิ่งนี้ บล็อก โพสต์นี้สำรวจวิธีการใช้เว็บสเครปปิ้งเพื่อการปกป้องแบรนด์และความปลอดภัยทางไซเบอร์ โดยกล่าวถึงการใช้เครื่องมือเว็บสเครปปิ้งเพื่อค้นหาการละเมิดที่อาจเกิดขึ้นและการละเมิดลิขสิทธิ์.

- Octoparse บทความ

- ScienceDirect – สงครามต่อต้านการขูดข้อมูลเว็บด้วย AI

- บทความนี้จาก ScienceDirect สำรวจการคัดค้านที่เพิ่มขึ้นต่อการดึงข้อมูลจากเว็บไซต์ด้วย AI โดยเน้นถึงความก้าวหน้าอย่างรวดเร็วของ AI และการฝึกฝนบนชุดข้อมูลขนาดใหญ่ของข้อความและเนื้อหาดิจิทัลอื่นๆ.

- บทความจาก ScienceDirect