Послушай краткое содержание поста:

Мой веб-сайт похож на ухоженный сад с оригинальным контентом, который расцветает с каждым посетителем. Однако с развитием инструментов искусственного интеллекта, умеющих извлекать данные с веб-сайтов, я осознал необходимость усиления защиты моего сайта, чтобы блокировать эти нежелательные извлечения. На основе своего опыта я собрал... Как защитить свой сайт от скрапинга с помощью искусственного интеллекта. Давайте рассмотрим несколько шагов для защиты вашего сайта. Я помогу вам внедрить директивы robots.txt, настроить CAPTCHA-проверку и другие методы, гарантирующие, что ваш контент останется исключительно на вашем домене. Речь идёт о сохранении неприкосновенности вашего онлайн-пространства, чтобы именно посетители-люди получали выгоду от вашей работы.

В стремлении обеспечить безопасность вашего цифрового убежища помните: “Прочная калитка гарантирует, что только радушный прием сможет оценить сад внутри”.”

Основные выводы

Защита моего сайта от программ-парсеров на основе ИИ — это постоянная борьба, требующая внимания и упреждающих стратегий. Я обнаружил, что эффективная настройка файла robots.txt, установка CAPTCHA, выявление и блокировка известных программ-парсеров на основе ИИ помогают инструменты, Контроль доступа к контенту и регулярное обновление протоколов безопасности — важнейшие стратегии. Добавление юридической защиты обеспечивает дополнительный уровень защиты, но бдительность и техническая грамотность — лучший способ обеспечить безопасность контента и сохранить ценность сайта для посетителей.

Не забывайте обновлять средства защиты вашего сайта, поскольку методы сбора данных постоянно совершенствуются. Регулярно проверяйте настройки безопасности и будьте готовы к новым вызовам, чтобы обеспечить безопасность вашего контента.

Понимание веб-парсинга с помощью искусственного интеллекта

Приступая к обсуждению темы веб-скрейпинга с использованием ИИ, крайне важно учитывать этические последствия этой практики. Я оценю потенциальные риски и преимущества, обеспечив создание рамок этического поведения при сборе данных с помощью ИИ. После этого я рассмотрю технические меры противодействия, доступные владельцам веб-сайтов, стремящимся защитить свой контент от несанкционированного скрейпинга с использованием ИИ.

Приступая к обсуждению темы веб-скрейпинга с использованием ИИ, крайне важно учитывать этические последствия этой практики. Я оценю потенциальные риски и преимущества, обеспечив создание рамок этического поведения при сборе данных с помощью ИИ. После этого я рассмотрю технические меры противодействия, доступные владельцам веб-сайтов, стремящимся защитить свой контент от несанкционированного скрейпинга с использованием ИИ.

Скребковые этические проблемы

Понимание этических аспектов ИИ Скраппинг содержимого

Почему вас должны беспокоить этические аспекты извлечения контента с вашего веб-сайта с помощью инструментов искусственного интеллекта? При рассмотрении этой темы крайне важно учитывать сложность защиты данных. Нерегулируемый сбор данных с помощью ИИ может привести к несанкционированному сбору конфиденциальной информации, что может нарушать интеллектуальную собственность тех, кто создает контент. Также важно соблюдать законы, регулирующие сбор и использование данных. Эти законы направлены на защиту частных лиц и компаний от нарушений конфиденциальности и неправомерного использования их информации. Соблюдение этих правил необходимо для обеспечения безопасности контента вашего веб-сайта и для гарантии этичности ваших действий по мере развития технологий.

Как справиться со скрейпингом

Чтобы автоматические системы не собирали данные с моего сайта, я регулярно обновляю файл robots.txt. Это позволяет мне определять, какие части сайта доступны для ботов, типа GPTBot. Постоянно обновляя эти настройки, я защищаю контент своего сайта от несанкционированного извлечения с помощью автоматических инструментов.

Таким образом, я не просто следую технической процедуре; я отстаиваю право на защиту ценности и конфиденциальности информации, над созданием которой я так усердно работал. Как веб-мастера, мы должны быть бдительными и инициативными, чтобы защитить наши цифровые ресурсы, которые являются крайне важными и недоступными для пользователей.

Помни, что хорошо настроенный файл robots.txt — это простой, но эффективный способ защиты от назойливых попыток скраперов.

Регулярно обновляй файл Robots.txt

Для обеспечения безопасности контента вашего сайта необходимо регулярно проверять и обновлять файл robots.txt. Вот как я это делаю эффективно:

- Установите регулярный график обновлений.

- Используй самые крутые методы, чтобы определить, к каким частям твоего сайта могут заходить пользовательские агенты (типа веб-краулеров).

- Следи за последними новостями в области инструментов для сбора данных с помощью искусственного интеллекта, чтобы быть в курсе возможных рисков безопасности.

- Сделай нужные изменения в запретных путях, чтобы твой контент был защищен от посторонних.

Зачем обновлять файл robots.txt?

Обновление файла robots.txt — это простой, но эффективный способ защитить свой сайт. Он сообщает поисковым системам и другим веб-краулерам, к каким страницам или разделам вашего сайта не следует обращаться или индексируемый. Это может помочь предотвратить нежелательное копирование данных и стать частью более масштабной стратегии по защите контента вашего сайта.

Помните, что с появлением новых типов веб-сканеров, сохранять бдительность и адаптировать файл robots.txt — разумный шаг. Хорошо поддерживаемый файл robots.txt имеет решающее значение для общей стратегии безопасности вашего веб-сайта.

Как правильно использовать файл Robots.txt

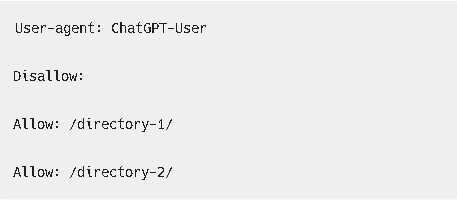

Чтобы защитить свой веб-сайт от нежелательного автоматизированного сбора данных, давайте обсудим, как правильно обновить файл robots.txt. Вы можете указать определенным веб-краулерам, таким как GPTBot от OpenAI, либо получать доступ к содержимому вашего сайта, либо обходить его, создав специальные правила для пользовательских агентов. Тщательно настроив эти параметры, вы получите точный контроль над тем, какие части вашего сайта могут быть проиндексированы или проигнорированы различными системами искусственного интеллекта.

Чтобы защитить свой веб-сайт от нежелательного автоматизированного сбора данных, давайте обсудим, как правильно обновить файл robots.txt. Вы можете указать определенным веб-краулерам, таким как GPTBot от OpenAI, либо получать доступ к содержимому вашего сайта, либо обходить его, создав специальные правила для пользовательских агентов. Тщательно настроив эти параметры, вы получите точный контроль над тем, какие части вашего сайта могут быть проиндексированы или проигнорированы различными системами искусственного интеллекта.

Правильно отредактируй файл Robots.Txt

Чтобы защитить свой веб-сайт от нежелательного сбора данных с помощью ИИ, крайне важно тщательно управлять файлом robots.txt. Этот шаг имеет основополагающее значение для обеспечения конфиденциальности данных вашего веб-сайта и соблюдения законов о сборе данных. Вот мое руководство по эффективному выполнению этой задачи:

- Найди файлСначала я зашёл на сервер своего сайта и поискал файл robots.txt, который уже там был.

- Просмотрите действующие правила: Затем я внимательно изучаю файл, чтобы полностью понять существующие правила и их значение для моего сайта.

- Обновляй с осторожностьюВнимательно относясь к деталям, я корректирую или добавляю новые правила, чтобы определить, что системы ИИ могут и чего не могут делать, используя ‘Disallow:’ для блокировки и ‘Allow:’ для предоставления доступа.

- Проверь измененияПосле внесения изменений я проверяю обновленный файл robots.txt с помощью тестировщиков, чтобы убедиться, что правила написаны правильно и работают должным образом.

Внимательно выполняя эти шаги, я обновляю файл robots.txt, чтобы мой сайт был в безопасности, но при этом оставался открытым для всех. поисковые системы которые помогают людям находить мой контент.

Внедрение проверки CAPTCHA

Если говорить о проверке CAPTCHA, то этот способ — отличный способ защиты от автоматического сбора данных без разрешения. Он работает, отличая настоящую человеческую деятельность от автоматизированное программное обеспечение, CAPTCHA эффективно блокирует нежелательных ботов, одновременно предоставляя доступ реальным пользователям. Тем не менее, при внедрении CAPTCHA крайне важно учитывать ее потенциальное влияние на взаимодействие с пользователями. Нахождение правильного баланса — ключ к обеспечению удобства использования вашего веб-сайта.

Эффективность CAPTCHA

Включение проверки CAPTCHA — это надежный способ защитить мой сайт от несанкционированного доступа. Сокращение контента с помощью автоматизированных инструментов. Вот моя точка зрения на то, почему это эффективная мера:

- Сложные задачи: Изысканный CAPTCHA — это сложные головоломки, которые трудно решить автоматически. системы, но все равно понятные для людей.

- Постоянные обновления: Часто обновляя алгоритмы CAPTCHA, они могут опередить развитие искусственного интеллекта, который в противном случае мог бы обойти неизменные системы.

- Многоуровневая безопасностьКогда CAPTCHA используется вместе с другими мерами безопасности, она создает надежный барьер против несанкционированного доступа.

- Бдительность: Мониторинг производительности и процента успешных проверок CAPTCHA может подсказать, когда пора внести корректировки или улучшения.

Хотя CAPTCHA делает сайт более безопасным, я всегда думаю об этике и стараюсь, чтобы это как можно меньше влияло на пользователей. Найти баланс между надежной безопасностью и удобством для пользователей — это сложная и постоянная задача.

Влияние на пользовательский опыт

Внедряя проверки CAPTCHA, я прекрасно понимаю, что они иногда могут раздражать пользователей, даже если хорошо справляются с предотвращением работы ботов, которые собирают контент с помощью ИИ. Моя оценка показывает, что CAPTCHA эффективно сдерживают таких ботов, что помогает регулировать поток посетителей сайта и снижает вероятность несанкционированного копирования контента. Тем не менее, крайне важно использовать этот инструмент с умом, чтобы не отпугивать посетителей вашего сайта. Главное — найти правильный баланс между лёгким доступом к контенту и защитой его от нежелательного сбора данных с помощью ИИ. Слишком много проверок CAPTCHA может отпугнуть столько же реальных пользователей, сколько и ботов. Я использую CAPTCHA в тех местах, где сбор данных наиболее вероятен, сохраняя при этом остальную часть сайта удобной для пользователей. Моя цель — обеспечить отличный пользовательский опыт, одновременно защищая контент сайта от несанкционированного сбора данных с помощью ИИ.

Блокировка определенных роботов-пауков искусственного интеллекта

Как владелец веб-сайта, я имею возможность блокировать определенные поисковые роботы, такие как GPTBot от OpenAI, чтобы предотвратить копирование контента с моего сайта. Этот шаг направлен не только на предотвращение несанкционированного сбора моего контента, но и на соблюдение этических норм и правовых правил использования контента. Вот как я это делаю:

- Изменить

файл robots.txtЯ вношу в этот файл конкретные инструкции для поисковых роботов, указывающие, к каким разделам моего сайта им запрещен доступ.

Пользовательский агент: GPTBot

Запретить: /

Пользовательский агент: ChatGPT-User

Запретить: /

Пользовательский агент: CCBot

Запретить: /

- Проверь журналы сервераЯ включил в свою рутину просмотр логов сервера для выявления любой подозрительной активности, которую может вызвать поисковый робот с искусственным интеллектом.

- Настройка CAPTCHAНа тех частях моего сайта, где люди общаются, я использую CAPTCHA. Эти тесты отлично помогают отличить настоящих людей от ботов.

- Блокировка определенных IP-адресовКогда нужно, я блокирую IP-адреса, которые, как я знаю, связаны с AI-краулерами, чтобы они не забирались на мой сайт.

Таким образом, я защищаю свой контент и гарантирую соблюдение правил, касающихся конфиденциальности данных и интеллектуальной собственности.

Как управлять доступностью контента

Защита контента твоего сайта от несанкционированного копирования

Чтобы решить проблему скрейпинга контента, давайте обсудим эффективные методы контроля доступа к содержимому вашего сайта. Крайне важно ограничить доступ ботов, и я расскажу о конкретных методах предотвращения копирования или индексации материалов вашего сайта этими автоматизированными системами. Это потребует технических изменений и тщательной настройки мер контроля доступа.

Защита контента твоего сайта

Для тех, кто управляет веб-сайтом, обеспечение эксклюзивности контента и его защиты от автоматических систем сбора данных является ключевой задачей. Внедрение специальных технических мер может помочь контролировать доступ и индексацию контента вашего сайта.

Ты можешь подумать о том, чтобы настроить файл robots.txt. файл для указания поисковой системе ботам, какие части твоего сайта недоступны. Использование CAPTCHA-систем тоже может отпугнуть ботов, не мешая при этом людям. Если хочешь более сложный подход, можно использовать серверные проверки, чтобы отличать настоящих посетителей от потенциальных скраперов.

Помни, что целостность и эксклюзивность твоего контента — это самое главное. Если ты будешь принимать меры для защиты своего сайта, ты сможешь контролировать свой контент и его распространение. В конце концов, контент, который ты создаешь, — это отражение твоего бренда, и его нужно бережно охранять.

Ограничение доступа ботов

Ограничение доступа ботов

Я обнаружил, что, предприняв определенные шаги, можно значительно снизить риск того, что автоматизированные системы будут собирать контент с моего сайта. Вот как я это делаю:

- Настройка файла Robots.txt: Я дорабатываю свой

файл robots.txtфайл для управления доступом ботов, не забывая про юридические моменты скрапинга и вопросы конфиденциальности данных. - Введение ограничений скорости: Введя ограничения скорости на моем сервере, я могу уменьшить возможные проблемы, связанные с ботовым трафиком.

- Как использовать API-контрольЯ делюсь как можно меньше инфой через API и требую правильную аутентификацию, чтобы ограничить доступ.

- Использование сетей доставки контентаИспользование CDN с функциями управления ботами позволяет мне контролировать, кто получает доступ к моему контенту, и эффективно его защищать.

Эти меры создают надежную защиту от несанкционированного сбора контента с помощью автоматических инструментов.

Предотвращение копирования контента

После обновления моего файл robots.txt Сейчас я сосредоточен на мерах по предотвращению сбора данных с веб-сайта, чтобы обеспечить его доступность и безопасность. Я изучаю технические аспекты сбора данных, его юридические последствия и важность защиты пользовательских данных от сложных методов сбора данных с использованием искусственного интеллекта.

| Стратегия | Описание |

|---|---|

| Доставка переменного контента | Показывайте автоматизированным инструментам другой контент, чем людям. |

| Мониторинг того, что делают пользователи | Проверь, нет ли каких-то действий, которые могут быть связаны со скрапингом. |

| Ограничения доступа | Управляйте, как часто пользователи могут заходить на сайт, и блокируйте подозрительные IP-адреса. |

Тщательно внедряя эти стратегии, я не только защищаю контент своего сайта, но и обеспечиваю конфиденциальность и безопасность информации пользователей. Это продуманный план по управлению контентом сайта и предотвращению несанкционированного доступа или неправомерного использования со стороны автоматизированных инструментов.

Внедрение этих стратегий — разумный способ опередить тех, кто может попытаться злоупотребить результатами вашей работы. Это как установка сложной системы сигнализации, которая не только следит за злоумышленниками, но и уважает частную жизнь ваших гостей. Речь идёт о проактивном, а не реактивном подходе к потенциальным угрозам.

Регулярно обновляй меры безопасности

Первоначальная настройка защиты, например, внесение изменений в robots.txt или добавление CAPTCHA, — это отличное начало, но для эффективной защиты от сложных инструментов искусственного интеллекта, которые собирают контент, крайне важно постоянно обновлять стратегии безопасности вашего веб-сайта. Технологическая среда находится в состоянии постоянных изменений, возможности ИИ становятся все более сложными и иногда обходят старые методы безопасности. Поэтому поддержание безопасности вашего веб-сайта требует стратегического, технически грамотного и системного подхода.

Вот моя стратегия:

- Регулярные проверки безопасностиЯ стараюсь регулярно проверять безопасность, чтобы заметить слабые места, и следить за тем, чтобы мои меры безопасности были актуальными и эффективными.

- Будьте в курсе обновленийЯ слежу за новыми обновлениями безопасности и проверяю, чтобы всё программное обеспечение на моём сайте было обновлённым.

- Как настроить меры безопасностиЯ настраиваю параметры безопасности для борьбы с конкретными угрозами, что помогает поддерживать здоровый баланс между защитой контента и обеспечением его доступа по правильным причинам.

- Анализ трафика и отчетностьБлагодаря постоянному отслеживанию трафика на моем сайте и тщательному анализу журналов доступа, я могу быстро выявлять и реагировать на подозрительное поведение, которое может указывать на попытку сбора данных с помощью искусственного интеллекта.

Обеспечение безопасности моего сайта — это не дело одного дня, а постоянная задача, направленная на противодействие злоумышленникам. Благодаря бдительности и активным мерам безопасности я защищаю не только контент своего сайта, но и конфиденциальность его посетителей.

Рассмотрение правовых мер защиты

Разбираясь в юридических тонкостях, я изучаю законы и правила об авторском праве, касающиеся несанкционированного сбора данных с помощью ИИ, чтобы защитить свой веб-сайт. Крайне важно применять системный подход, чтобы понять, как национальные и международные законы об авторском праве влияют на материалы на моем сайте. Я также изучил Закон об авторском праве в цифровую эпоху (DMCA), чтобы понять, как он может защитить мой контент от нарушений, совершаемых с помощью ИИ.

Оценка условий использования инструментов искусственного интеллекта — это ответственный шаг, позволяющий убедиться, что они не злоупотребляют своими правами на использование и сбор данных с веб-сайтов. Такое внимание к деталям имеет ключевое значение для сохранения удобства использования моего сайта и предотвращения неправомерного использования моего контента, что может снизить влияние моего бренда и уменьшить вовлеченность посетителей.

Кроме того, я рассматриваю технические стратегии, такие как внедрение строгого контроля доступа и постоянный анализ трафика для выявления и предотвращения попыток парсинга. Мой план состоит в сочетании правовых мер и технических средств защиты, чтобы сохранить уникальность моего веб-сайта и защитить творческий труд, вложенный в его создание.

Часто задаваемые вопросы

Если я заблокирую инструменты искусственного интеллекта для сбора данных с моего сайта, повлияет ли это на видимость или рейтинг моего сайта в других поисковых системах, таких как Google или Bing?

Я размышляю над тем, повлияет ли предотвращение сбора данных с моего сайта с помощью инструментов искусственного интеллекта на его производительность в поисковых системах. поисковые системы, такие как Google или Bing. Важно прояснить любые недоразумения относительно видимости в интернете; эти Поисковые системы используют свои алгоритмы для ранжирования сайтов.. Они не зависят исключительно от индексации с помощью инструментов искусственного интеллекта. Моя цель — защитить свой контент и при этом сохранить хорошие позиции в поисковой выдаче. результаты поиска. На деле это значит найти правильный баланс между защитой моих Контент сайта и достижение качественной SEO-оптимизации результаты.

Как отличить легитимные поисковые роботы от фреймворков с искусственным интеллектом при анализе трафика моего сайта?

Чтобы отличить нормальные поисковые роботы от тех, кто без разрешения копирует контент, когда смотрю на мой сайт, трафик сайта, Я внимательно смотрю на поведение пользователей, которое может быть связано с автоматизированными действиями. Чтобы не пускать потенциально опасный трафик, я использую методы блокировки IP-адресов. Еще я пользуюсь инструментами для обнаружения ботов, которые помогают мне находить и контролировать нежелательных ботов. Эти меры помогают мне защищать свой контент и при этом делать сайт доступным для нормальных пользователей. поисковые системы.

Понимание разницы между реальным и искусственным трафиком гарантирует точность аналитики моего сайта и предотвращает попадание контента в чужие руки. Как владелец сайта, я несу ответственность за безопасность своей цифровой собственности, подобно защите физического магазина от краж. Благодаря этим стратегиям я могу уверенно управлять трафиком своего сайта и поддерживать его целостность.

Что делать, если заметил, что твой контент уже скопили с помощью ИИ-инструмента без твоего разрешения?

Обнаружив, что мой контент был использован инструментом искусственного интеллекта без моего согласия, первым шагом будет тщательная фиксация каждого случая такого нарушения. Затем я попытаюсь вернуть свой контент, связавшись с ответственной стороной или, при необходимости, отправив запрос на удаление в соответствии с DMCA. Если эти меры не помогут решить проблему, можно рассмотреть возможность обращения в суд. Кроме того, полезно информировать общественность о несанкционированном использовании моей работы, пропагандируя этичное использование инструментов искусственного интеллекта. Бдительность и незамедлительные действия являются ключевыми факторами защиты творческих прав в интернете.

Помните: защита вашего творческого труда — это не просто право, это обязанность.

Существуют ли какие-либо отраслевые стандарты или лучшие практики для нанесения водяных знаков на мой контент, указывающих на то, что его не следует использовать для обучения моделей искусственного интеллекта?

В настоящее время я изучаю методы защиты своего контента от несанкционированного использования при обучении моделей ИИ. Один из подходов — использование цифровых водяных знаков и идентификации контента, которые внедряют невидимые маркеры или уникальные коды в мою работу. В сочетании с четкими правилами использования эти стратегии служат сигналом того, что мои материалы не должны использоваться для обучения моделей ИИ. Сообщество все еще работает над общим набором рекомендаций по этому вопросу, поэтому я слежу за последними стратегиями, чтобы обеспечить надлежащую защиту своей работы.

“Защита интеллектуальной собственности в эпоху, когда данные постоянно поступают в алгоритмы, является общей проблемой для всех создателей контента. Разумно проявлять инициативу и быть информированным”.”

Если инструменты искусственного интеллекта научатся обходить CAPTCHA, мне придется применять более сложные стратегии безопасности, чтобы защитить свой сайт от несанкционированного извлечения данных. Один из эффективных способов — это Поведенческая биометрия, который следит за странными вещами в том, как люди взаимодействуют с сайтом. Это может помочь отличить настоящих людей от потенциальных автоматических скрейперов.

Еще один уровень защиты включает в себя Анализ отпечатков пальцев. Эта технология анализирует уникальные характеристики устройства и браузера, такие как операционная система, разрешение экрана и установленные шрифты, чтобы выявить несоответствия, которые обычно характерны для ботов.

Чтобы быть на шаг впереди, я бы сделал следующее: Адаптивные вызовы. Это проверки безопасности, сложность которых может варьироваться в зависимости от оцениваемого риска, обеспечивая динамическую защиту, которая адаптируется к уровню обнаруженной угрозы. Используя эти передовые методы, я могу значительно усилить защиту своего веб-сайта от новейших инструментов сбора данных на основе искусственного интеллекта.

Что такое защита от скрапинга с помощью искусственного интеллекта в контексте Всемирной паутины?

Защита от скрапинга с помощью ИИ — это методы и технологии, которые используются, чтобы боты не могли без разрешения собирать или скрапировать данные с сайтов. Эти технологии используют возможности искусственного интеллекта, чтобы обнаруживать, идентифицировать и блокировать такие действия.

Почему скрейперы с искусственным интеллектом — это проблема для интеллектуальной собственности в интернете?

AI-скребки — это проблема, потому что они могут быстро и эффективно собирать кучу конфиденциальной информации, которая есть в сети. Эти данные могут включать в себя защищенный авторским правом контент, коммерческие тайны, базы данных или другие цифровые активы, которые предназначены только для использования на исходном веб-сайте.

Как работает скребок искусственного интеллекта?

AI-скребок имитирует, как люди просматривают сайты. Он заходит на страницы, находит нужную инфу по заданным параметрам, а потом копирует эти данные, чтобы использовать их где-то еще. Эти инструменты могут быть разные: некоторые умеют лазать по сложным сайтам и обходить базовые меры защиты от скрейпинга.

Какие методы обычно используются для защиты от скрапинга с помощью искусственного интеллекта?

Техники, которые часто используют для защиты от скрапинга с помощью ИИ, включают ограничение скорости (ограничение количества запросов, которые IP-адрес может сделать за определенный период времени), тесты CAPTCHA (которые требуют от пользователей доказать, что они люди), анализ пользовательских агентов (для выявления подозрительной активности браузера) и более продвинутые алгоритмы машинного обучения, которые могут обнаруживать необычные паттерны, указывающие на поведение ботов.

Можно ли использовать искусственный интеллект для защиты от веб-скрейпинга?

Да, можно использовать разные виды искусственного интеллекта, типа алгоритмов машинного обучения, чтобы обнаруживать и предотвращать веб-скрейпинг. Эти системы учатся на предыдущих примерах поведения ботов, что позволяет им лучше предвидеть и предотвратить возможные будущие атаки. Они также могут использовать методы обнаружения в реальном времени, которые позволяют сразу же реагировать, когда подозрительная активность ботов происходит.

Мои последние мысли о том, как защитить твой сайт от скрапинга с помощью инструментов искусственного интеллекта

Защита моего веб-сайта от нежелательного сбора данных с помощью ИИ — это постоянная работа, требующая усердия. Я обнаружил, что грамотное использование robots.txt, внедрение CAPTCHA, блокировка распознаваемых ИИ-сборщиков, управление доступом к контенту и постоянное обновление мер безопасности являются жизненно важными шагами. Хотя добавление юридических мер обеспечивает дополнительный уровень защиты, бдительность и техническая компетентность являются ключом к тому, чтобы мой контент оставался в рамках моих полномочий, тем самым поддерживая целостность моего веб-сайта и ценность, которую он предлагает посетителям.

Авторитетные ссылки

Если хочешь узнать больше о том, как защитить свои сайты от AI-краулеров, то я рекомендую тебе заглянуть в следующий пост:

- ITPro – Веб-скрейпинг с использованием ИИ: как защитить свой бизнес от

- В этой статье рассказывается о сложностях веб-парсинга с помощью ИИ и связанных с ним рисках. Здесь объясняется, как ИИ может быстрее и лучше собирать данные, а потом их анализировать, чтобы получить нужные результаты.

- Статья ITPro

- Гильдия авторов – Практические советы для авторов по защите своих произведений от использования ИИ.

- Этот ресурс предлагает практические советы авторам и владельцам веб-сайтов о том, как защитить свои работы от использования ИИ, в том числе с помощью файла robots.txt для блокировки веб-краулеров ИИ, таких как GPTBot от OpenAI.

- Советы от Гильдии авторов

- Resolution Digital – Защита веб-сайта от Содержание ИИ Скребковые работы

- В этой статье рассказывается, как защитить свой сайт от скрапинга и несанкционированного использования такими AI-инструментами, как ChatGPT. Здесь обсуждается использование файлов robots.txt, внедрение CAPTCHA и блокировка диапазонов IP-адресов.

- Цифровое руководство по разрешению

- Octoparse – веб-скрейпинг для защиты бренда и кибербезопасности

- Это блог В этой статье рассказывается, как можно использовать веб-парсинг для защиты бренда и кибербезопасности. Здесь обсуждается, как с помощью инструментов веб-парсинга можно найти потенциальные нарушения авторских прав.

- Статья Octoparse

- ScienceDirect – Война против веб-скрейпинга с использованием ИИ.

- В этой статье из ScienceDirect рассказывается о растущем недовольстве веб-парсингом с помощью ИИ, а также о том, как быстро развивается ИИ и как его обучают на огромных наборах данных с текстом и другим цифровым контентом.

- Статья ScienceDirect