Nghe tóm tắt bài viết:

Trang web của tôi giống như một khu vườn được chăm sóc kỹ lưỡng, với nội dung độc đáo ngày càng phát triển mỗi khi có khách truy cập. Tuy nhiên, với sự tiến bộ của các công cụ AI có khả năng trích xuất dữ liệu từ các trang web, tôi nhận thấy cần phải tăng cường khả năng phòng thủ của trang web để ngăn chặn những hành vi trích xuất không mong muốn này. Qua kinh nghiệm của mình, tôi đã thu thập được nhiều thông tin. Các chiến lược bảo vệ website của bạn khỏi việc bị AI thu thập dữ liệu một cách hiệu quả. Hãy cùng điểm qua một vài bước để bảo vệ trang web của bạn. Tôi sẽ hướng dẫn bạn cách triển khai chỉ thị robots.txt, thiết lập thử thách CAPTCHA và các phương pháp bổ sung để đảm bảo nội dung của bạn chỉ được lưu trữ trên tên miền của bạn. Tất cả là để duy trì tính toàn vẹn của thế giới trực tuyến của bạn, đảm bảo rằng chính những người truy cập là con người mới được hưởng lợi từ công sức của bạn.

Để giữ cho không gian kỹ thuật số của bạn được an toàn, hãy nhớ rằng, “Một cánh cổng vững chắc đảm bảo rằng chỉ những người được chào đón mới có thể tận hưởng khu vườn bên trong.”

Những điểm chính

Bảo vệ trang web của tôi khỏi các phần mềm thu thập dữ liệu tự động là một cuộc chiến liên tục đòi hỏi sự chú ý và các chiến lược chủ động. Tôi nhận thấy rằng việc cấu hình hiệu quả tệp robots.txt, thiết lập CAPTCHA, xác định và chặn các phần mềm thu thập dữ liệu tự động đã biết là rất hữu ích. công cụ, Việc kiểm soát ai có thể truy cập nội dung của tôi và thường xuyên cập nhật các giao thức bảo mật là những chiến lược quan trọng. Thêm các biện pháp bảo vệ pháp lý cung cấp thêm một lớp phòng thủ nữa, nhưng việc luôn cảnh giác và am hiểu về kỹ thuật là cách tốt nhất để giữ an toàn cho nội dung của tôi và duy trì giá trị của trang web đối với khách truy cập.

Hãy nhớ luôn cập nhật hệ thống bảo mật của trang web, vì các phương pháp thu thập dữ liệu đang không ngừng được cải tiến. Thường xuyên xem xét lại các cài đặt bảo mật và sẵn sàng thích ứng với những thách thức mới để giữ an toàn cho nội dung của bạn.

Tìm hiểu về thu thập dữ liệu web bằng AI

Khi bàn về chủ đề thu thập dữ liệu web bằng AI, điều quan trọng là phải nhận thức được những tác động đạo đức của hoạt động này. Tôi sẽ đánh giá những rủi ro và lợi ích tiềm tàng, đảm bảo thiết lập một khuôn khổ cho hành vi đạo đức trong việc thu thập dữ liệu bằng AI. Sau đó, tôi sẽ xem xét các biện pháp kỹ thuật mà chủ sở hữu trang web có thể sử dụng để bảo vệ nội dung của họ khỏi việc thu thập dữ liệu trái phép bằng AI.

Khi bàn về chủ đề thu thập dữ liệu web bằng AI, điều quan trọng là phải nhận thức được những tác động đạo đức của hoạt động này. Tôi sẽ đánh giá những rủi ro và lợi ích tiềm tàng, đảm bảo thiết lập một khuôn khổ cho hành vi đạo đức trong việc thu thập dữ liệu bằng AI. Sau đó, tôi sẽ xem xét các biện pháp kỹ thuật mà chủ sở hữu trang web có thể sử dụng để bảo vệ nội dung của họ khỏi việc thu thập dữ liệu trái phép bằng AI.

Những lo ngại về đạo đức khi thu thập dữ liệu

Hiểu về khía cạnh đạo đức của trí tuệ nhân tạo Trích xuất nội dung

Tại sao bạn cần quan tâm đến khía cạnh đạo đức của việc sử dụng công cụ AI để trích xuất nội dung từ trang web của mình? Khi xem xét vấn đề này, điều quan trọng là phải nhìn vào sự phức tạp của vấn đề bảo mật dữ liệu. Việc thu thập dữ liệu bằng AI không được kiểm soát có thể dẫn đến việc thu thập trái phép thông tin độc quyền, điều này có thể xâm phạm quyền sở hữu trí tuệ của những người tạo ra nội dung. Điều quan trọng nữa là phải tuân thủ các luật kiểm soát cách thức thu thập và sử dụng dữ liệu. Những luật này nhằm mục đích bảo vệ cá nhân và công ty khỏi các hành vi vi phạm quyền riêng tư và lạm dụng thông tin của họ. Việc cập nhật các quy định này là cần thiết để giữ an toàn cho nội dung trang web của bạn và đảm bảo các hoạt động của bạn luôn đúng đắn về mặt đạo đức khi công nghệ phát triển.

Các biện pháp đối phó với việc thu thập dữ liệu trái phép

Để ngăn chặn các hệ thống tự động thu thập dữ liệu từ trang web của mình, tôi thường xuyên điều chỉnh tệp robots.txt. Việc làm cẩn thận này cho phép tôi xác định những phần nào của trang web mà các bot như GPTBot có thể truy cập. Bằng cách liên tục cập nhật các hướng dẫn này, tôi bảo vệ nội dung trang web của mình khỏi việc bị các công cụ tự động trích xuất trái phép.

Khi làm như vậy, tôi không chỉ tuân theo một quy trình kỹ thuật; tôi đang thể hiện lập trường của mình để bảo vệ giá trị và quyền riêng tư của thông tin mà tôi đã dày công tạo ra. Là những người quản trị trang web, chúng ta phải cảnh giác và chủ động để bảo vệ tài sản kỹ thuật số mà người dùng tin tưởng – một con đường thiết yếu không thể bị xâm phạm.

Hãy nhớ rằng, một tệp robots.txt được bảo trì tốt là một lớp phòng thủ đơn giản nhưng hiệu quả chống lại những nỗ lực không ngừng nghỉ của các phần mềm thu thập dữ liệu.

Cập nhật Robots.txt thường xuyên

Việc đảm bảo an ninh cho nội dung trang web của bạn đòi hỏi phải thường xuyên xem xét và cập nhật tệp robots.txt. Đây là cách tôi thực hiện hiệu quả:

- Hãy thiết lập lịch cập nhật thường xuyên.

- Hãy áp dụng các phương pháp tốt nhất để xác định những phần nào của trang web mà các tác nhân người dùng (như trình thu thập dữ liệu web) có thể truy cập.

- Hãy theo dõi sát sao những phát triển mới nhất trong các công cụ thu thập dữ liệu bằng AI để luôn đi trước các rủi ro bảo mật tiềm ẩn.

- Hãy điều chỉnh các đường dẫn bị cấm truy cập để đảm bảo nội dung của bạn luôn được bảo vệ khỏi sự truy cập trái phép.

Tại sao cần cập nhật file Robots.txt?

Cập nhật tệp robots.txt là một cách đơn giản nhưng hiệu quả để bảo vệ trang web của bạn. Nó cho các công cụ tìm kiếm và các trình thu thập thông tin web khác biết trang hoặc phần nào của trang web của bạn không nên được truy cập hoặc không được phép truy cập. được lập chỉ mục. Điều này có thể giúp ngăn chặn việc thu thập dữ liệu trái phép và là một phần của chiến lược lớn hơn để bảo vệ nội dung trang web của bạn.

Hãy nhớ rằng, khi các loại trình thu thập dữ liệu web mới xuất hiện, việc luôn cảnh giác và điều chỉnh tệp robots.txt là một bước đi thông minh. Một tệp robots.txt được bảo trì tốt đóng vai trò quan trọng trong chiến lược bảo mật tổng thể của trang web của bạn.

Sử dụng Robots.txt hiệu quả

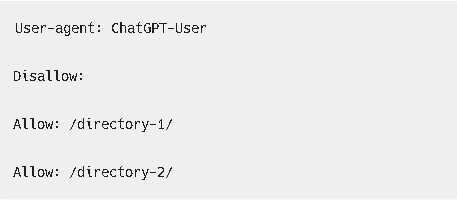

Để bảo vệ trang web của bạn khỏi việc thu thập dữ liệu tự động không mong muốn, hãy cùng thảo luận về cách cập nhật tệp robots.txt một cách cẩn thận. Bạn có thể hướng dẫn các trình thu thập dữ liệu web nhất định, chẳng hạn như GPTBot của OpenAI, truy cập hoặc bỏ qua nội dung trang web của bạn bằng cách tạo các quy tắc user-agent cụ thể. Bằng cách thiết lập các tham số này một cách chi tiết, bạn sẽ có được quyền kiểm soát chính xác những phần nào của trang web có thể được lập chỉ mục hoặc bị bỏ qua bởi các hệ thống AI khác nhau.

Để bảo vệ trang web của bạn khỏi việc thu thập dữ liệu tự động không mong muốn, hãy cùng thảo luận về cách cập nhật tệp robots.txt một cách cẩn thận. Bạn có thể hướng dẫn các trình thu thập dữ liệu web nhất định, chẳng hạn như GPTBot của OpenAI, truy cập hoặc bỏ qua nội dung trang web của bạn bằng cách tạo các quy tắc user-agent cụ thể. Bằng cách thiết lập các tham số này một cách chi tiết, bạn sẽ có được quyền kiểm soát chính xác những phần nào của trang web có thể được lập chỉ mục hoặc bị bỏ qua bởi các hệ thống AI khác nhau.

Chỉnh sửa tệp Robots.TXT cho đúng

Để bảo vệ trang web của bạn khỏi việc bị các phần mềm AI thu thập dữ liệu trái phép, việc quản lý tệp robots.txt một cách cẩn thận là vô cùng quan trọng. Bước này rất cần thiết để giữ cho dữ liệu trang web của bạn được bảo mật và tuân thủ luật thu thập dữ liệu. Dưới đây là hướng dẫn của tôi để thực hiện điều đó một cách hiệu quả:

- Tìm tập tinĐầu tiên, tôi đăng nhập vào máy chủ trang web của mình và tìm kiếm tệp robots.txt đã có sẵn ở đó.

- Xem xét lại các quy tắc hiện hànhTiếp theo, tôi xem xét kỹ tệp tin để hiểu đầy đủ các quy tắc hiện có và ý nghĩa của chúng đối với trang web của tôi.

- Cập nhật với sự quan tâmVới sự chú trọng đến từng chi tiết, tôi điều chỉnh hoặc thêm các quy tắc mới để xác định những gì hệ thống AI có thể và không thể làm, sử dụng 'Disallow:' để chặn và 'Allow:' để cấp quyền truy cập.

- Xác minh các chỉnh sửaSau khi thực hiện các thay đổi, tôi sẽ chạy tệp robots.txt đã cập nhật qua các trình kiểm thử để đảm bảo các quy tắc được viết chính xác và hoạt động như mong muốn.

Bằng cách thực hiện cẩn thận các bước này, tôi cập nhật tệp robots.txt để giữ cho trang web của mình an toàn mà vẫn thân thiện. công cụ tìm kiếm Những công cụ giúp mọi người tìm thấy nội dung của tôi.

Triển khai xác minh CAPTCHA

Chuyển sang phần xác thực CAPTCHA, phương pháp này đóng vai trò như một rào cản vững chắc chống lại việc thu thập dữ liệu tự động trái phép. Nó hoạt động bằng cách phân biệt hoạt động của con người thực sự với hoạt động của máy móc. phần mềm tự động, CAPTCHA giúp chặn hiệu quả các bot không mong muốn trong khi vẫn cho phép người dùng thật truy cập. Tuy nhiên, khi tích hợp CAPTCHA, điều quan trọng là phải xem xét các tác động tiềm tàng của nó đối với tương tác người dùng. Tìm được sự cân bằng phù hợp là chìa khóa để đảm bảo trang web của bạn vẫn thân thiện với người dùng.

Hiệu quả của CAPTCHA

Việc tích hợp kiểm tra CAPTCHA là một chiến lược hiệu quả để bảo vệ trang web của tôi khỏi các truy cập trái phép. Trích xuất nội dung bằng các công cụ tự động. Đây là quan điểm của tôi về lý do tại sao đây là một biện pháp hiệu quả:

- Những thách thức phức tạp: Cầu kì CAPTCHA đặt ra những câu đố phức tạp, khó giải quyết bằng hệ thống tự động. nhưng vẫn dễ quản lý đối với mọi người.

- Cập nhật liên tục: Bằng cách thường xuyên cập nhật thuật toán CAPTCHA, họ có thể vượt qua sự phát triển của trí tuệ nhân tạo, vốn có thể dễ dàng né tránh các hệ thống không thay đổi.

- Bảo mật nhiều lớpKhi CAPTCHA được sử dụng cùng với các biện pháp bảo mật khác, nó tạo ra một rào cản vững chắc chống lại sự truy cập trái phép.

- Cảnh giác: Việc theo dõi hiệu suất và tỷ lệ thành công của CAPTCHA có thể giúp xác định thời điểm cần điều chỉnh hoặc cải tiến.

Mặc dù việc thêm CAPTCHA giúp tăng cường bảo mật, tôi luôn cân nhắc khía cạnh đạo đức và hướng đến việc giảm thiểu tối đa tác động đến người dùng. Tìm ra sự cân bằng phù hợp giữa bảo mật mạnh mẽ và khả năng truy cập của người dùng là một nhiệm vụ cần sự cẩn trọng và liên tục.

Tác động đến trải nghiệm người dùng

Khi triển khai kiểm tra CAPTCHA, tôi nhận thức rõ rằng đôi khi chúng có thể gây khó chịu cho người dùng, ngay cả khi chúng rất hiệu quả trong việc ngăn chặn các bot sử dụng trí tuệ nhân tạo để thu thập nội dung. Đánh giá của tôi cho thấy CAPTCHA hiệu quả trong việc ngăn chặn các bot này, giúp quản lý lưu lượng truy cập trang web và giảm nguy cơ sao chép nội dung trái phép. Tuy nhiên, điều quan trọng là phải sử dụng công cụ này một cách khôn ngoan để tránh làm mất lòng người dùng truy cập trang web của bạn. Vấn đề là tìm ra sự cân bằng phù hợp giữa việc giúp người dùng dễ dàng truy cập nội dung và bảo vệ nội dung đó khỏi việc bị thu thập trái phép bởi AI. Quá nhiều bài kiểm tra CAPTCHA có thể khiến cả người dùng thực và bot rời bỏ trang web. Tôi sử dụng CAPTCHA ở những khu vực có khả năng bị thu thập nội dung cao nhất, đồng thời vẫn giữ cho phần còn lại của trang web thân thiện với người dùng. Mục tiêu của tôi là mang đến trải nghiệm tuyệt vời cho khách truy cập trang web, đồng thời bảo mật nội dung trang web khỏi mọi hành vi thu thập trái phép bằng AI.

Chặn các trình thu thập dữ liệu AI cụ thể

Với tư cách là người điều hành một trang web, tôi có khả năng chặn một số trình thu thập dữ liệu AI nhất định, chẳng hạn như GPTBot của OpenAI, để ngăn chúng sao chép nội dung từ trang web của tôi. Bước này không chỉ nhằm ngăn chặn việc thu thập nội dung trái phép mà còn thể hiện sự tôn trọng các tiêu chuẩn đạo đức và quy định pháp luật liên quan đến việc sử dụng nội dung. Sau đây là cách tôi thực hiện:

- Biến đổi

robots.txtTôi chỉnh sửa tệp này với các hướng dẫn cụ thể dành cho trình thu thập dữ liệu AI, nêu rõ những phần nào trên trang web của tôi mà chúng bị cấm truy cập.

User-agent: GPTBot

Cấm: /

User-agent: ChatGPT-User

Cấm: /

User-agent: CCBot

Cấm: /

- Kiểm tra nhật ký máy chủTôi thường xuyên kiểm tra nhật ký máy chủ để phát hiện bất kỳ hoạt động nào bất thường của trình thu thập dữ liệu AI.

- Thiết lập CAPTCHATrên những phần trang web mà người dùng tương tác, tôi sử dụng CAPTCHA. Các bài kiểm tra này rất hiệu quả trong việc phân biệt người thật với các bot tự động.

- Chặn một số địa chỉ IP nhất địnhKhi cần thiết, tôi sẽ chặn các địa chỉ IP mà tôi biết là có liên quan đến trình thu thập dữ liệu AI để ngăn chúng truy cập vào trang web của tôi.

Bằng cách làm những điều này, tôi bảo vệ nội dung của mình và đảm bảo tuân thủ các quy định liên quan đến quyền riêng tư dữ liệu và sở hữu trí tuệ.

Quản lý khả năng truy cập nội dung

Bảo vệ nội dung trang web của bạn khỏi bị sao chép trái phép

Để giải quyết vấn đề sao chép nội dung trái phép, chúng ta hãy cùng thảo luận về các phương pháp hiệu quả để kiểm soát ai có thể truy cập nội dung trang web của bạn. Việc hạn chế truy cập của bot là rất quan trọng, và tôi sẽ trình bày các kỹ thuật cụ thể để ngăn chặn các hệ thống tự động này sao chép hoặc lập chỉ mục tài liệu trên trang web của bạn. Điều này sẽ bao gồm các thay đổi kỹ thuật và thiết lập cẩn thận các biện pháp kiểm soát truy cập.

Bảo vệ nội dung trang web của bạn

Đối với những người quản lý trang web, việc đảm bảo nội dung của bạn luôn độc quyền và được bảo vệ khỏi các hệ thống sao chép tự động là mối quan tâm hàng đầu. Áp dụng các biện pháp kỹ thuật cụ thể có thể giúp bạn kiểm soát ai có khả năng truy cập và lập chỉ mục nội dung trang web của mình.

Bạn có thể cân nhắc chỉnh sửa tệp robots.txt của mình. tập tin hướng dẫn công cụ tìm kiếm Các bot có thể xác định những phần nào trên trang web của bạn không nên được truy cập. Sử dụng hệ thống CAPTCHA cũng có thể ngăn chặn bot mà không gây cản trở cho người dùng. Để có cách tiếp cận tinh vi hơn, bạn có thể triển khai kiểm tra phía máy chủ để phân biệt giữa khách truy cập hợp pháp và những kẻ thu thập dữ liệu tiềm năng.

Hãy nhớ rằng, tính toàn vẹn và độc quyền của nội dung là tối quan trọng. Bằng cách chủ động bảo vệ trang web của mình, bạn duy trì quyền kiểm soát nội dung và việc phân phối nội dung đó. Xét cho cùng, nội dung bạn tạo ra phản ánh thương hiệu của bạn và cần được bảo vệ cẩn thận.

Hạn chế quyền truy cập của bot

Hạn chế quyền truy cập của bot

Tôi nhận thấy rằng việc thực hiện các bước cụ thể có thể giảm đáng kể nguy cơ các hệ thống tự động thu thập nội dung từ trang web của tôi. Đây là cách tôi làm:

- Điều chỉnh Robot.txtTôi tinh chỉnh

robots.txtTệp này dùng để kiểm soát quyền truy cập của bot, cần lưu ý đến các khía cạnh pháp lý của việc thu thập dữ liệu tự động và các vấn đề về bảo mật dữ liệu. - Áp dụng giới hạn tỷ lệBằng cách thiết lập giới hạn tốc độ truy cập trên máy chủ, tôi có thể hạn chế những tác động gây rối tiềm tàng do lưu lượng truy cập của bot gây ra.

- Áp dụng các biện pháp kiểm soát APITôi chỉ chia sẻ lượng thông tin tối thiểu cần thiết thông qua API và yêu cầu xác thực hợp lệ để hạn chế quyền truy cập.

- Sử dụng mạng phân phối nội dungViệc sử dụng các CDN có khả năng quản lý bot cho phép tôi quản lý ai có thể truy cập nội dung của mình và bảo vệ nội dung đó một cách hiệu quả.

Thực hiện các bước này sẽ tạo ra một tuyến phòng thủ vững chắc chống lại việc thu thập nội dung trái phép bằng các công cụ tự động.

Ngăn chặn sao chép nội dung

Sau khi cập nhật robots.txt Hiện tại, tôi đang tập trung vào các biện pháp ngăn chặn việc sao chép nội dung trái phép, đảm bảo trang web của tôi vẫn truy cập được mà vẫn an toàn. Tôi đang nghiên cứu các khía cạnh kỹ thuật của việc sao chép nội dung, hậu quả pháp lý của nó và tầm quan trọng của việc bảo vệ dữ liệu người dùng khỏi các phương pháp sao chép nội dung bằng trí tuệ nhân tạo tinh vi.

| Chiến lược | Mô tả |

|---|---|

| Phân phối nội dung biến đổi | Cung cấp nội dung khác nhau cho các công cụ tự động và cho người dùng. |

| Giám sát hoạt động người dùng | Kiểm tra các dấu hiệu có thể cho thấy hành vi thu thập dữ liệu trái phép. |

| Hạn chế truy cập | Kiểm soát tần suất người dùng truy cập nội dung và chặn các địa chỉ IP đáng ngờ. |

Bằng cách cẩn thận triển khai các chiến lược này, tôi không chỉ bảo vệ nội dung trang web của mình mà còn giữ cho thông tin người dùng được bảo mật và riêng tư. Đây là một kế hoạch có chủ đích để quản lý nội dung trang web và ngăn chặn việc truy cập trái phép hoặc lạm dụng bởi các công cụ tự động.

Áp dụng những chiến lược này là một cách thông minh để luôn đi trước những kẻ có thể tìm cách lợi dụng công sức của bạn. Nó giống như việc thiết lập một hệ thống báo động tinh vi, không chỉ giám sát những kẻ xâm nhập mà còn tôn trọng sự riêng tư của khách mời. Đó là việc chủ động thay vì phản ứng thụ động trước các mối đe dọa tiềm tàng.

Cập nhật thường xuyên các biện pháp an ninh

Việc thiết lập các biện pháp phòng vệ ban đầu như chỉnh sửa tệp robots.txt hoặc thêm CAPTCHA là một khởi đầu tuyệt vời, nhưng để bảo vệ hiệu quả trước các công cụ AI tiên tiến có khả năng thu thập nội dung, điều quan trọng là phải liên tục cập nhật các chiến lược bảo mật của trang web. Môi trường công nghệ luôn thay đổi không ngừng, với khả năng của AI ngày càng tinh vi và đôi khi vượt qua được các phương pháp bảo mật cũ. Do đó, việc duy trì bảo mật cho trang web của bạn đòi hỏi một cách tiếp cận chiến lược, am hiểu công nghệ và có hệ thống.

Đây là chiến lược của tôi:

- Đánh giá an ninh định kỳTôi luôn chú trọng việc tiến hành kiểm tra an ninh định kỳ để phát hiện bất kỳ điểm yếu nào mới xuất hiện, đảm bảo các biện pháp bảo vệ của tôi luôn được cập nhật và hiệu quả.

- Luôn cập nhật thông tin mới nhấtTôi luôn cập nhật các bản vá bảo mật mới nhất và đảm bảo tất cả các thành phần phần mềm trên trang web của mình đều được cập nhật.

- Điều chỉnh các biện pháp an ninhTôi điều chỉnh cài đặt bảo mật của mình để đối phó với các mối đe dọa cụ thể, điều này giúp duy trì sự cân bằng lành mạnh giữa việc bảo vệ nội dung và đảm bảo nội dung đó có thể truy cập được vì những lý do chính đáng.

- Phân tích và báo cáo lưu lượng giao thôngBằng cách theo dõi lưu lượng truy cập vào trang web của mình và kiểm tra kỹ lưỡng nhật ký truy cập, tôi có thể nhanh chóng xác định và xử lý các hành vi đáng ngờ có thể cho thấy nỗ lực thu thập dữ liệu bằng trí tuệ nhân tạo.

Bảo mật trang web của tôi không phải là chuyện một lần rồi quên đi; đó là một thách thức liên tục để chống lại những kẻ có ý đồ xấu. Bằng cách luôn cảnh giác và chủ động về vấn đề bảo mật, tôi không chỉ bảo vệ nội dung trang web của mình mà còn cả quyền riêng tư của những người truy cập.

Tìm hiểu về các biện pháp bảo vệ pháp lý

Để giải quyết những vấn đề pháp lý phức tạp, tôi đang nghiên cứu luật bản quyền và các quy định liên quan đến việc thu thập dữ liệu trái phép bằng AI nhằm bảo vệ trang web của mình. Việc tiếp cận một cách có hệ thống là rất cần thiết để hiểu luật bản quyền quốc gia và quốc tế ảnh hưởng đến nội dung trên trang web của tôi như thế nào. Tôi cũng đã xem xét Đạo luật Bản quyền Kỹ thuật số Thiên niên kỷ (DMCA) để xem nó có thể bảo vệ nội dung của tôi khỏi các hành vi vi phạm do AI gây ra như thế nào.

Việc đánh giá các điều khoản sử dụng của các công cụ AI là một bước cần thiết để đảm bảo chúng không lạm dụng quyền sử dụng và thu thập dữ liệu từ các trang web. Sự chú trọng đến từng chi tiết này rất quan trọng để bảo vệ trải nghiệm người dùng trên trang web của tôi và ngăn chặn việc lạm dụng nội dung, điều có thể làm giảm tầm ảnh hưởng của thương hiệu và giảm sự tương tác của khách truy cập.

Ngoài ra, tôi cũng đang xem xét các chiến lược kỹ thuật như triển khai kiểm soát truy cập nghiêm ngặt và phân tích lưu lượng truy cập liên tục để xác định và giảm thiểu các nỗ lực sao chép trái phép. Sự kết hợp giữa các biện pháp pháp lý và bảo vệ kỹ thuật là kế hoạch của tôi để duy trì tính độc đáo của trang web và bảo vệ công sức sáng tạo đằng sau nó.

Câu hỏi thường gặp

Nếu tôi chặn các công cụ AI thu thập dữ liệu từ trang web của mình, liệu điều đó có ảnh hưởng đến khả năng hiển thị hoặc thứ hạng của trang web trên các công cụ tìm kiếm khác như Google hay Bing không?

Tôi đang cân nhắc xem việc ngăn chặn các công cụ AI thu thập dữ liệu từ trang web của mình có thể ảnh hưởng đến hiệu suất hoạt động của trang web hay không. các công cụ tìm kiếm như Google hoặc Bing. Điều quan trọng là phải làm rõ mọi sự nhầm lẫn về khả năng hiển thị trực tuyến; những điều này Các công cụ tìm kiếm sử dụng các thuật toán độc đáo để xếp hạng. Họ không hoàn toàn phụ thuộc vào việc lập chỉ mục bằng các công cụ AI. Mục tiêu của tôi là bảo vệ nội dung của mình và vẫn giữ được vị trí tốt trên công cụ tìm kiếm. kết quả tìm kiếm. Trên thực tế, điều này có nghĩa là phải tìm ra sự cân bằng cẩn thận giữa việc bảo vệ bản thân tôi. nội dung trang web và đạt được SEO vững chắc kết quả.

Làm thế nào để phân biệt giữa trình thu thập dữ liệu của công cụ tìm kiếm hợp pháp và trình quét dữ liệu bằng AI khi phân tích lưu lượng truy cập trang web của tôi?

Để phân biệt các trình thu thập dữ liệu của công cụ tìm kiếm hợp pháp với các trình thu thập dữ liệu AI trái phép khi xem kết quả tìm kiếm của tôi. lưu lượng truy cập trang web, Tôi xem xét kỹ lưỡng các mẫu hành vi người dùng có thể cho thấy sự tương tác tự động. Để ngăn chặn lưu lượng truy cập có khả năng gây hại, tôi áp dụng các kỹ thuật chặn IP. Tôi cũng tận dụng các công cụ phát hiện bot, giúp tôi xác định và kiểm soát các bot trái phép. Những biện pháp này giúp tôi bảo vệ nội dung của mình đồng thời đảm bảo trang web của tôi vẫn có thể truy cập được bởi những người dùng có uy tín. công cụ tìm kiếm.

Hiểu rõ sự khác biệt giữa lưu lượng truy cập thực và lưu lượng truy cập giả mạo giúp đảm bảo số liệu phân tích trang web của tôi luôn chính xác và nội dung của tôi không rơi vào tay kẻ xấu. Là chủ sở hữu trang web, tôi có trách nhiệm bảo vệ tài sản kỹ thuật số của mình, giống như việc bảo vệ một cửa hàng vật lý khỏi những kẻ trộm cắp. Với những chiến lược này, tôi có thể tự tin quản lý lưu lượng truy cập trang web và duy trì tính toàn vẹn của nó.

Tôi nên làm gì nếu phát hiện nội dung của mình đã bị công cụ AI sao chép mà không được sự cho phép của tôi?

Khi phát hiện nội dung của mình bị công cụ AI sử dụng mà không được sự cho phép, bước đầu tiên là ghi lại cẩn thận mọi trường hợp vi phạm. Tiếp theo, tôi sẽ cố gắng lấy lại nội dung của mình bằng cách liên hệ với bên chịu trách nhiệm, hoặc nếu cần, bằng cách gửi yêu cầu gỡ bỏ theo DMCA. Nếu các biện pháp này không giải quyết được vấn đề, việc xem xét các biện pháp pháp lý là một lựa chọn. Ngoài ra, việc thông báo cho công chúng về việc sử dụng trái phép tác phẩm của tôi cũng rất có lợi, nhằm thúc đẩy việc sử dụng các công cụ AI một cách có đạo đức. Sự cảnh giác và hành động kịp thời là chìa khóa để bảo vệ quyền sáng tạo trực tuyến của mỗi người.

Hãy nhớ: Bảo vệ tác phẩm sáng tạo của bạn không chỉ là quyền mà còn là trách nhiệm.

Có tiêu chuẩn ngành hoặc thực tiễn tốt nhất nào về việc đóng dấu bản quyền nội dung của tôi để chỉ ra rằng nội dung đó không nên được sử dụng để huấn luyện các mô hình AI không?

Hiện tại, tôi đang xem xét các phương pháp bảo vệ nội dung của mình khỏi việc sử dụng trái phép để huấn luyện các mô hình AI. Một cách tiếp cận là sử dụng kỹ thuật thủy vân kỹ thuật số và nhận dạng dấu vân tay nội dung, chèn các dấu hiệu vô hình hoặc mã đặc trưng vào tác phẩm của tôi. Khi kết hợp với các chính sách rõ ràng về việc sử dụng, những chiến lược này đóng vai trò như một dấu hiệu cho thấy tài liệu của tôi không nên được sử dụng để huấn luyện các mô hình AI. Cộng đồng vẫn đang nỗ lực hướng tới một bộ hướng dẫn chung về vấn đề này, vì vậy tôi đang cập nhật thông tin về các chiến lược mới nhất để đảm bảo tác phẩm của mình được bảo vệ đúng cách.

“Bảo vệ quyền sở hữu trí tuệ trong thời đại mà dữ liệu liên tục được đưa vào thuật toán là mối quan tâm chung của các nhà sáng tạo. Chủ động và nắm bắt thông tin là điều khôn ngoan.”

Nếu các công cụ AI phát triển khả năng vượt qua CAPTCHA, tôi sẽ cần áp dụng các chiến lược bảo mật tinh vi hơn để bảo vệ trang web của mình khỏi việc trích xuất dữ liệu trái phép. Một phương pháp hiệu quả là... Sinh trắc học hành vi, Nó giám sát những bất thường trong cách người dùng tương tác với trang web. Điều này có thể giúp phân biệt giữa người dùng thật và các phần mềm thu thập dữ liệu tự động tiềm năng.

Một lớp bảo vệ khác bao gồm Phân tích dấu vân tay. Kỹ thuật này đánh giá các thuộc tính độc đáo của thiết bị và trình duyệt của nó, chẳng hạn như hệ điều hành, độ phân giải màn hình và phông chữ đã cài đặt, để phát hiện những điểm không nhất quán điển hình của hoạt động bot.

Để luôn đi trước một bước, tôi sẽ hành động. Thử thách thích ứng. Đây là các bước kiểm tra bảo mật có thể khác nhau về độ phức tạp tùy thuộc vào mức độ rủi ro được đánh giá, đảm bảo khả năng phòng thủ linh hoạt, thích ứng với mức độ đe dọa được phát hiện. Bằng cách sử dụng các phương pháp tiên tiến này, tôi có thể tăng cường đáng kể bảo mật cho trang web của mình trước các công cụ thu thập dữ liệu tự động dựa trên trí tuệ nhân tạo mới nhất.

Bảo vệ chống lại việc thu thập dữ liệu tự động bằng AI trong bối cảnh mạng Internet toàn cầu là gì?

Bảo vệ chống thu thập dữ liệu tự động bằng AI đề cập đến các phương pháp và công nghệ được sử dụng để ngăn chặn các bot tự động thu thập hoặc trích xuất dữ liệu từ các trang web mà không được phép. Các công nghệ này tận dụng khả năng của trí tuệ nhân tạo để phát hiện, nhận dạng và chặn các hoạt động đó.

Tại sao các phần mềm thu thập dữ liệu tự động bằng AI lại là mối đe dọa đối với quyền sở hữu trí tuệ trên internet?

Các công cụ thu thập dữ liệu tự động bằng AI tiềm ẩn mối đe dọa vì chúng có thể nhanh chóng và hiệu quả thu thập một lượng lớn thông tin độc quyền được công bố trên web. Dữ liệu này có thể bao gồm nội dung có bản quyền, bí mật thương mại, cơ sở dữ liệu hoặc các tài sản kỹ thuật số khác chỉ được sử dụng trên trang web nguồn.

Công cụ thu thập dữ liệu bằng AI hoạt động như thế nào?

Công cụ thu thập dữ liệu bằng trí tuệ nhân tạo hoạt động bằng cách mô phỏng hành vi duyệt web của con người. Nó truy cập các trang web, xác định thông tin liên quan dựa trên các tiêu chí được xác định trước, sau đó trích xuất dữ liệu này để sử dụng ở nơi khác. Độ tinh vi của các công cụ này rất khác nhau; một số có khả năng điều hướng cấu trúc trang web phức tạp và né tránh các biện pháp chống thu thập dữ liệu cơ bản.

Những kỹ thuật nào thường được sử dụng để bảo vệ khỏi việc thu thập dữ liệu tự động bằng AI?

Các kỹ thuật thường được sử dụng để bảo vệ khỏi việc AI thu thập dữ liệu bao gồm giới hạn tốc độ (hạn chế số lượng yêu cầu mà một địa chỉ IP có thể thực hiện trong một khoảng thời gian nhất định), kiểm tra CAPTCHA (thách thức người dùng chứng minh họ là con người), phân tích tác nhân người dùng (để xác định hoạt động trình duyệt đáng ngờ) và các thuật toán học máy tiên tiến hơn có thể phát hiện các mẫu bất thường cho thấy hành vi của bot.

Liệu trí tuệ nhân tạo có thể được sử dụng để bảo vệ chống lại các hoạt động thu thập dữ liệu web trái phép?

Đúng vậy, nhiều dạng trí tuệ nhân tạo như thuật toán học máy có thể được sử dụng để phát hiện và ngăn chặn việc thu thập dữ liệu tự động từ web. Các hệ thống này học hỏi từ các trường hợp hoạt động của bot trước đó, cho phép chúng dự đoán và ngăn chặn tốt hơn các cuộc tấn công tiềm tàng trong tương lai. Chúng cũng có thể triển khai các kỹ thuật phát hiện theo thời gian thực, cho phép hành động ngay lập tức khi phát hiện hoạt động của bot.

Lời kết của tôi về việc bảo vệ trang web của bạn khỏi bị các công cụ AI thu thập dữ liệu.

Việc bảo vệ trang web của tôi khỏi các hành vi thu thập dữ liệu trái phép bằng AI là một nỗ lực liên tục đòi hỏi sự siêng năng. Tôi nhận thấy rằng việc sử dụng thông minh tệp robots.txt, triển khai CAPTCHA, chặn các phần mềm thu thập dữ liệu bằng AI đã được nhận diện, quản lý quyền truy cập nội dung và liên tục cập nhật các biện pháp bảo mật là những bước quan trọng. Mặc dù việc bổ sung các biện pháp pháp lý cung cấp thêm một lớp bảo vệ, nhưng việc luôn cảnh giác và am hiểu kỹ thuật là chìa khóa để đảm bảo nội dung của tôi nằm trong phạm vi quyền hạn của mình, từ đó duy trì tính toàn vẹn của trang web và giá trị mà nó mang lại cho những người truy cập.

Tài liệu tham khảo có thẩm quyền

Nếu bạn muốn tìm hiểu thêm về cách bảo vệ trang web của mình khỏi các trình thu thập dữ liệu AI, tôi khuyên bạn nên xem bài viết sau:

- ITPro – Thu thập dữ liệu web bằng AI: Làm thế nào để bảo vệ doanh nghiệp của bạn khỏi

- Bài viết này thảo luận về sự phức tạp của việc thu thập dữ liệu web bằng trí tuệ nhân tạo (AI) và những rủi ro liên quan. Bài viết cung cấp những hiểu biết sâu sắc về cách AI có thể thu thập dữ liệu với tốc độ và độ tinh vi cao hơn, phân tích dữ liệu để tạo ra kết quả đầu ra.

- Bài viết của ITPro

- Hiệp hội Tác giả – Mẹo thực tế dành cho tác giả để bảo vệ tác phẩm của họ khỏi việc sử dụng trí tuệ nhân tạo

- Tài liệu này cung cấp những lời khuyên thiết thực cho các tác giả và chủ sở hữu trang web về cách bảo vệ tác phẩm của họ khỏi việc sử dụng trí tuệ nhân tạo, bao gồm cả việc sử dụng tệp robots.txt để chặn các trình thu thập dữ liệu web bằng trí tuệ nhân tạo như GPTBot của OpenAI.

- Mẹo từ Hội Nhà văn

- Resolution Digital – Bảo vệ trang web khỏi Nội dung AI Cạo

- Bài viết này cung cấp các bước đơn giản để bảo vệ trang web của bạn khỏi bị sao chép và sử dụng trái phép bởi các công cụ AI như ChatGPT. Bài viết thảo luận về việc sử dụng tệp robots.txt, triển khai CAPTCHA và chặn dải địa chỉ IP.

- Hướng dẫn kỹ thuật số Resolution

- Octoparse – Công cụ thu thập dữ liệu web phục vụ bảo vệ thương hiệu và an ninh mạng.

- Cái này blog Bài viết này khám phá cách thức sử dụng công nghệ thu thập dữ liệu web (web scraping) để bảo vệ thương hiệu và đảm bảo an ninh mạng. Bài viết thảo luận về việc sử dụng các công cụ thu thập dữ liệu web để tìm kiếm các hành vi xâm phạm và vi phạm bản quyền tiềm ẩn.

- Bài viết Octoparse

- ScienceDirect – Cuộc chiến chống lại việc thu thập dữ liệu web bằng AI

- Bài viết này từ ScienceDirect khám phá những phản đối ngày càng tăng đối với việc thu thập dữ liệu web bằng AI, nhấn mạnh sự tiến bộ nhanh chóng của AI và quá trình huấn luyện nó trên các tập dữ liệu khổng lồ gồm văn bản và các nội dung kỹ thuật số khác.

- Bài viết trên ScienceDirect