پوسٹ کا خلاصہ سنیں:

میری ویب سائٹ ایک اچھی طرح سے رکھے ہوئے باغ سے مشابہ ہے، اصل مواد کے ساتھ جو ہر آنے والے کے ساتھ پھلتا پھولتا ہے۔ تاہم، ویب سائٹس سے ڈیٹا نکالنے میں ماہر AI ٹولز کی ترقی کے ساتھ، میں نے ان ناپسندیدہ نکالنے کو روکنے کے لیے اپنی سائٹ کے دفاع کو مضبوط کرنے کی ضرورت کو تسلیم کیا ہے۔ اپنے تجربے کے ذریعے، میں نے جمع کیا ہے۔ آپ کی ویب سائٹ کو مؤثر طریقے سے AI سکریپنگ سے بچانے کے لیے حکمت عملی. آئیے آپ کی سائٹ کی حفاظت کے لیے کچھ اقدامات کرتے ہیں۔ میں آپ کی robots.txt ہدایات کو نافذ کرنے، کیپچا چیلنجز ترتیب دینے، اور اضافی طریقوں کے بارے میں آپ کی رہنمائی کروں گا تاکہ یہ یقینی بنایا جا سکے کہ آپ کا مواد صرف آپ کے ڈومین پر ہی رہے۔ یہ سب کچھ آپ کے آن لائن دائرے کے تقدس کو برقرار رکھنے کے بارے میں ہے، اس بات کو یقینی بنانا کہ یہ انسانی وزیٹر ہیں جو آپ کی محنت کے فوائد حاصل کرتے ہیں۔.

اپنی ڈیجیٹل پناہ گاہ کو محفوظ رکھنے کے جذبے میں، یاد رکھیں، "ایک مضبوط گیٹ اس بات کو یقینی بناتا ہے کہ صرف استقبال کرنے والا ہی باغ کی تعریف کر سکتا ہے۔"“

کلیدی ٹیک ویز

میری ویب سائٹ کو AI سکریپر سے بچانا ایک مسلسل جنگ ہے جو توجہ اور فعال حکمت عملیوں کا تقاضا کرتی ہے۔ میں نے اپنی robots.txt فائل کو مؤثر طریقے سے ترتیب دینے، کیپچا کو ترتیب دینے، معروف AI سکریپر کی شناخت اور بلاک کرنے سے پایا ہے۔ اوزار, یہ کنٹرول کرنا کہ کون میرے مواد تک رسائی حاصل کر سکتا ہے، اور سیکورٹی پروٹوکول کو کثرت سے اپ ڈیٹ کرنا اہم حکمت عملی ہیں۔ قانونی تحفظات شامل کرنا ایک اور دفاعی تہہ فراہم کرتا ہے، لیکن چوکس رہنا اور تکنیکی طور پر تیز رہنا میرے مواد کو محفوظ رکھنے اور دیکھنے والوں کے لیے میری سائٹ کی قدر کو برقرار رکھنے کا بہترین طریقہ ہے۔.

اپنی ویب سائٹ کے دفاع کو اپ ٹو ڈیٹ رکھنا یاد رکھیں، کیونکہ ڈیٹا سکریپنگ کے طریقے مسلسل آگے بڑھ رہے ہیں۔ اپنی حفاظتی ترتیبات کا باقاعدگی سے جائزہ لیں اور اپنے مواد کو محفوظ رکھنے کے لیے نئے چیلنجوں سے نمٹنے کے لیے تیار رہیں۔.

AI ویب سکریپنگ کو سمجھنا

جیسا کہ ہم AI ویب سکریپنگ کے موضوع تک پہنچتے ہیں، اس مشق کے اخلاقی مضمرات کو پہچاننا بہت ضروری ہے۔ میں ممکنہ خطرات اور فوائد کا جائزہ لوں گا، اس بات کو یقینی بناتے ہوئے کہ ہم AI ڈیٹا اکٹھا کرنے میں اخلاقی طرز عمل کے لیے ایک فریم ورک قائم کریں۔ اس کے بعد، میں ویب سائٹ کے مالکان کے لیے دستیاب تکنیکی جوابی اقدامات کو تلاش کروں گا جو اپنے مواد کو غیر مجاز AI سکریپنگ سے بچانے کی کوشش کر رہے ہیں۔.

جیسا کہ ہم AI ویب سکریپنگ کے موضوع تک پہنچتے ہیں، اس مشق کے اخلاقی مضمرات کو پہچاننا بہت ضروری ہے۔ میں ممکنہ خطرات اور فوائد کا جائزہ لوں گا، اس بات کو یقینی بناتے ہوئے کہ ہم AI ڈیٹا اکٹھا کرنے میں اخلاقی طرز عمل کے لیے ایک فریم ورک قائم کریں۔ اس کے بعد، میں ویب سائٹ کے مالکان کے لیے دستیاب تکنیکی جوابی اقدامات کو تلاش کروں گا جو اپنے مواد کو غیر مجاز AI سکریپنگ سے بچانے کی کوشش کر رہے ہیں۔.

اخلاقی خدشات کو ختم کرنا

AI کے اخلاقی جہتوں کو سمجھنا مواد سکریپنگ

آپ کو اپنی ویب سائٹ سے مواد نکالنے والے AI ٹولز کے اخلاقی پہلوؤں کے بارے میں کیوں فکر مند ہونا چاہیے؟ اس موضوع کی جانچ کرتے وقت، ڈیٹا کی رازداری کی پیچیدگی کو دیکھنا بہت ضروری ہے۔ غیر منظم AI سکریپنگ ملکیتی معلومات کے غیر مجاز مجموعہ کا باعث بن سکتی ہے، جو مواد تخلیق کرنے والوں کی دانشورانہ املاک کی خلاف ورزی کر سکتی ہے۔ ان قوانین کی تعمیل کرنا بھی ضروری ہے جو ڈیٹا کو جمع کرنے اور استعمال کرنے کے طریقہ کو کنٹرول کرتے ہیں۔ ان قوانین کا مقصد افراد اور کمپنیوں کو رازداری کی خلاف ورزیوں اور ان کی معلومات کے غلط استعمال سے بچانا ہے۔ آپ کی ویب سائٹ کے مواد کو محفوظ رکھنے اور ٹیکنالوجی کی ترقی کے ساتھ ساتھ آپ کے طرز عمل اخلاقی طور پر درست ہونے کو یقینی بنانے کے لیے ان ضوابط کے ساتھ اپ ٹو ڈیٹ ہونا ضروری ہے۔.

سکریپنگ کے لئے انسدادی اقدامات

خودکار نظاموں کو اپنی ویب سائٹ سے ڈیٹا حاصل کرنے سے روکنے کے لیے، میں robots.txt فائل میں معمول کی ایڈجسٹمنٹ کرتا ہوں۔ یہ محتاط مشق مجھے یہ وضاحت کرنے دیتی ہے کہ میری ویب سائٹ کے کون سے حصے GPTBot جیسے بوٹس کے لیے قابل رسائی ہیں۔ ان ہدایات کو مسلسل اپ ڈیٹ کرتے ہوئے، میں اپنی ویب سائٹ کے مواد کو خودکار ٹولز کے ذریعے غیر مجاز نکالنے سے بچاتا ہوں۔.

ایسا کرنے میں، میں صرف ایک تکنیکی معمول کی پیروی نہیں کر رہا ہوں؛ میں ان معلومات کی قدر اور رازداری کے تحفظ کے لیے موقف اختیار کر رہا ہوں جسے میں نے تخلیق کرنے کے لیے سخت محنت کی ہے۔ ویب ماسٹرز کے طور پر، ہمیں اپنے ڈیجیٹل پراپرٹیز کے صارفین کو اعتماد کے لیے ضروری آف حد کے راستے کو محفوظ بنانے کے لیے چوکس اور متحرک رہنا چاہیے۔.

یاد رکھیں، ایک اچھی طرح سے برقرار رکھنے والی robots.txt فائل ڈیٹا سکریپر کی انتھک کوششوں کے خلاف دفاع کی ایک سادہ لیکن موثر پرت ہے۔.

Robots.txt کو باقاعدگی سے اپ ڈیٹ کریں۔

اپنی ویب سائٹ کے مواد کی حفاظت کو برقرار رکھنے کا مطلب ہے اپنی robots.txt فائل کا باقاعدگی سے جائزہ لینا اور اسے اپ ڈیٹ کرنا۔ اس طرح میں اسے مؤثر طریقے سے کرتا ہوں:

- اپ ڈیٹس کے لیے باقاعدہ شیڈول مرتب کریں۔.

- یہ بتانے کے لیے بہترین طریقے استعمال کریں کہ آپ کی سائٹ کے صارف ایجنٹ (جیسے ویب کرالر) کے کن حصوں تک رسائی حاصل کر سکتے ہیں۔.

- ممکنہ حفاظتی خطرات سے آگے رہنے کے لیے AI سکریپنگ ٹولز میں تازہ ترین پیش رفت پر نظر رکھیں۔.

- اس بات کو یقینی بنانے کے لیے کہ آپ کا مواد غیر مجاز رسائی سے محفوظ رہے ان راستوں میں ضروری ایڈجسٹمنٹ کریں۔.

اپنے Robots.txt کو کیوں اپ ڈیٹ کریں؟

اپنی robots.txt فائل کو اپ ڈیٹ کرنا آپ کی ویب سائٹ کی حفاظت کا ایک آسان لیکن طاقتور طریقہ ہے۔ یہ سرچ انجنوں اور دوسرے ویب کرالر کو بتاتا ہے کہ آپ کی سائٹ کے کن صفحات یا حصوں تک رسائی نہیں ہونی چاہیے یا انڈیکسڈ. اس سے ناپسندیدہ سکریپنگ کو روکنے میں مدد مل سکتی ہے اور یہ آپ کی سائٹ کے مواد کی حفاظت کے لیے ایک بڑی حکمت عملی کا حصہ ہو سکتا ہے۔.

یاد رکھیں، جیسے جیسے ویب کرالرز کی نئی قسمیں سامنے آتی ہیں، چوکنا رہنا اور اپنی robots.txt فائل کو ڈھالنا ایک زبردست اقدام ہے۔ ایک اچھی طرح سے برقرار رکھنے والی robots.txt فائل آپ کی ویب سائٹ کی مجموعی سیکیورٹی حکمت عملی کے لیے اہم ہے۔.

Robots.txt کو مؤثر طریقے سے استعمال کرنا

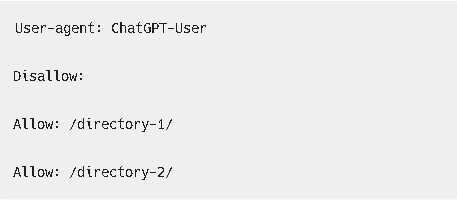

اپنی ویب سائٹ کو غیر مطلوبہ خودکار ڈیٹا اکٹھا کرنے سے بچانے کے لیے، آئیے اس بات پر بات کرتے ہیں کہ robots.txt فائل کو احتیاط سے کیسے اپ ڈیٹ کیا جائے۔ آپ مخصوص ویب کرالر، جیسے OpenAI's GPTBot، کو صارف ایجنٹ کے مخصوص قوانین بنا کر اپنی سائٹ کے مواد تک رسائی یا بائی پاس کرنے کی ہدایت کر سکتے ہیں۔ تفصیل پر توجہ کے ساتھ ان پیرامیٹرز کو ترتیب دینے سے، آپ اس بات پر قطعی کنٹرول حاصل کر لیتے ہیں کہ آپ کی سائٹ کے کن حصوں کو مختلف AI سسٹمز کے ذریعے انڈیکس یا نظر انداز کیا جا سکتا ہے۔.

اپنی ویب سائٹ کو غیر مطلوبہ خودکار ڈیٹا اکٹھا کرنے سے بچانے کے لیے، آئیے اس بات پر بات کرتے ہیں کہ robots.txt فائل کو احتیاط سے کیسے اپ ڈیٹ کیا جائے۔ آپ مخصوص ویب کرالر، جیسے OpenAI's GPTBot، کو صارف ایجنٹ کے مخصوص قوانین بنا کر اپنی سائٹ کے مواد تک رسائی یا بائی پاس کرنے کی ہدایت کر سکتے ہیں۔ تفصیل پر توجہ کے ساتھ ان پیرامیٹرز کو ترتیب دینے سے، آپ اس بات پر قطعی کنٹرول حاصل کر لیتے ہیں کہ آپ کی سائٹ کے کن حصوں کو مختلف AI سسٹمز کے ذریعے انڈیکس یا نظر انداز کیا جا سکتا ہے۔.

Robots.Txt میں درست طریقے سے ترمیم کریں۔

اپنی ویب سائٹ کو غیر مطلوبہ AI سے چلنے والے سکریپنگ سے بچانے کے لیے، اپنی robots.txt فائل کو احتیاط کے ساتھ منظم کرنا بہت ضروری ہے۔ یہ قدم آپ کی ویب سائٹ کے ڈیٹا کو نجی رکھنے اور ڈیٹا اکٹھا کرنے کے قوانین کی تعمیل کرنے کے لیے بنیادی ہے۔ اسے مؤثر طریقے سے کرنے کے لیے میرا گائیڈ یہ ہے:

- فائل تلاش کریں۔: سب سے پہلے، میں نے اپنی ویب سائٹ کے سرور میں لاگ ان کیا اور پہلے سے موجود robots.txt فائل کو تلاش کیا۔.

- موجودہ قواعد کا جائزہ لیں۔: اس کے بعد، میں موجودہ قواعد کو مکمل طور پر سمجھنے کے لیے فائل کو قریب سے دیکھتا ہوں اور میری سائٹ کے لیے ان کا کیا مطلب ہے۔.

- نگہداشت کے ساتھ اپ ڈیٹ کریں۔: تفصیل پر توجہ دینے کے ساتھ، میں یہ بتانے کے لیے نئے قواعد کو ایڈجسٹ یا داخل کرتا ہوں کہ AI سسٹم کیا کر سکتے ہیں اور کیا نہیں، بلاک کرنے کے لیے 'Disallow:' اور رسائی دینے کے لیے 'Allow:' کا استعمال کرتے ہوئے.

- ترامیم کی تصدیق کریں۔: تبدیلیاں کرنے کے بعد، میں ٹیسٹرز کے ذریعے اپ ڈیٹ شدہ robots.txt چلاتا ہوں تاکہ یہ یقینی بنایا جا سکے کہ قواعد صحیح طریقے سے لکھے گئے ہیں اور حسب منشا کام کر رہے ہیں۔.

ان اقدامات کو احتیاط سے انجام دے کر، میں اپنی robots.txt فائل کو اپ ڈیٹ کرتا ہوں تاکہ اپنی سائٹ کو ابھی تک خوش آمدید کہتے ہوئے محفوظ رکھا جا سکے۔ سرچ انجن جو لوگوں کو میرا مواد تلاش کرنے میں مدد کرتا ہے۔.

کیپچا کی توثیق کو نافذ کرنا

کیپچا کی تصدیق کی طرف ہماری توجہ مبذول کرتے ہوئے، یہ طریقہ غیر مجاز خودکار ڈیٹا کی کٹائی کے خلاف ایک ٹھوس رکاوٹ کا کام کرتا ہے۔ یہ حقیقی انسانی سرگرمی کو اس سے ممتاز کرکے کام کرتا ہے۔ خودکار سافٹ ویئر, حقیقی صارفین تک رسائی کی اجازت دیتے ہوئے مؤثر طریقے سے ناپسندیدہ بوٹس کو مسدود کرنا۔ بہر حال، کیپچا کو شامل کرتے وقت، صارف کے تعامل پر اس کے ممکنہ اثرات پر غور کرنا بہت ضروری ہے۔ صحیح توازن برقرار رکھنا اس بات کو یقینی بنانے کی کلید ہے کہ آپ کی ویب سائٹ صارف کے موافق رہے۔.

کیپچا کی تاثیر

کیپچا چیک کو شامل کرنا میری ویب سائٹ کو غیر مجاز سے بچانے کے لیے ایک ٹھوس حکمت عملی ہے۔ مواد سکریپنگ خودکار ٹولز کے ذریعے۔ یہاں میرا نقطہ نظر ہے کہ یہ ایک مؤثر اقدام کیوں ہے:

- پیچیدہ چیلنجز: نفیس کیپچا پیچیدہ پہیلیاں بناتے ہیں جو خودکار کے لیے مشکل ہیں۔ سسٹم لیکن پھر بھی لوگوں کے لیے قابل انتظام۔.

- مسلسل اپ ڈیٹس: کیپچا الگورتھم کو کثرت سے تروتازہ کرنے سے، وہ AI کی ترقی کو آگے بڑھا سکتے ہیں جو بصورت دیگر غیر تبدیل شدہ نظاموں کو پیچھے چھوڑ سکتا ہے۔.

- پرتوں والی سیکیورٹی: جب کیپچا کو دیگر حفاظتی اقدامات کے ساتھ استعمال کیا جاتا ہے، تو یہ غیر مجاز رسائی کے خلاف ایک مضبوط رکاوٹ پیدا کرتا ہے۔.

- چوکسی: کیپچا کی کارکردگی اور کامیابی کی شرح کی نگرانی اس وقت اشارہ دے سکتی ہے جب ایڈجسٹمنٹ یا بہتری کا وقت ہو۔.

جبکہ CAPTCHA کو شامل کرنے سے سیکیورٹی میں اضافہ ہوتا ہے، میں ہمیشہ اخلاقی پہلو پر غور کرتا ہوں اور صارفین پر اثرات کو کم سے کم رکھنے کا مقصد رکھتا ہوں۔ مضبوط سیکورٹی اور صارف کی رسائی کے درمیان صحیح توازن تلاش کرنا ایک محتاط، مسلسل کام ہے۔.

صارف کے تجربے کا اثر

کیپچا چیک کو جگہ پر رکھتے ہوئے، میں اچھی طرح جانتا ہوں کہ وہ بعض اوقات صارفین کو پریشان کر سکتے ہیں، چاہے وہ ایسے بوٹس کو روکنے میں اچھے ہوں جو AI کا استعمال کرتے ہوئے مواد کو کھرچتے ہیں۔ میرے جائزے سے پتہ چلتا ہے کہ کیپچا ان بوٹس کو بے قابو رکھنے میں مؤثر ہیں، جو ویب سائٹ کے وزٹرز کے بہاؤ کو منظم کرنے میں مدد کرتا ہے اور بغیر اجازت کے مواد کی نقل کیے جانے کے امکانات کو کم کرتا ہے۔ اس کے باوجود، آپ کی سائٹ پر آنے والے لوگوں کو باہر جانے سے روکنے کے لیے اس ٹول کو سمجھداری سے استعمال کرنا بہت ضروری ہے۔ یہ سب کچھ آپ کے مواد تک رسائی کو آسان بنانے اور اسے ناپسندیدہ AI سکریپنگ سے بچانے کے درمیان صحیح توازن تلاش کرنے کے بارے میں ہے۔ بہت زیادہ کیپچا ٹیسٹ بوٹس جتنے حقیقی صارفین کو دور کر سکتے ہیں۔ میں ان علاقوں میں کیپچا استعمال کرتا ہوں جہاں سائٹ کے باقی حصوں کو صارف دوست رکھتے ہوئے سکریپنگ ہونے کا زیادہ امکان ہوتا ہے۔ میرا مقصد سائٹ کے زائرین کے لیے ایک بہترین تجربہ پیش کرنا ہے جبکہ سائٹ کے مواد کو AI کے ذریعے کسی بھی غیر مجاز سکریپنگ سے بھی محفوظ رکھنا ہے۔.

مخصوص AI کرالر کو مسدود کرنا

کسی ایسے شخص کے طور پر جو ویب سائٹ چلاتا ہے، میں کچھ مخصوص AI کرالر کو بلاک کرنے کی صلاحیت رکھتا ہوں، جیسے OpenAI کے GPTBot، انہیں اپنی سائٹ سے مواد کاپی کرنے سے روک سکتا ہوں۔ یہ قدم صرف میرے مواد کے غیر مجاز مجموعہ کو روکنے کے بارے میں نہیں ہے، بلکہ یہ اخلاقی معیارات اور مواد کے استعمال سے متعلق قانونی قواعد کا احترام کرنے کے بارے میں بھی ہے۔ یہاں میں اس سے کیسے رجوع کرتا ہوں:

- ترمیم کریں۔

robots.txt: میں اس فائل کو AI کرالر کے لیے مخصوص ہدایات کے ساتھ ایڈجسٹ کرتا ہوں جس میں یہ بتایا جاتا ہے کہ میری سائٹ کے کن حصوں سے انہیں منع کیا گیا ہے۔.

صارف ایجنٹ: GPTBot

اجازت نہ دیں: /

صارف کا ایجنٹ: چیٹ جی پی ٹی صارف

اجازت نہ دیں: /

صارف کا ایجنٹ: CCBot

اجازت نہ دیں: /

- سرور لاگز کو چیک کریں۔: میں اپنے سرور کے لاگز سے گزرنا اپنے معمول کا حصہ بناتا ہوں تاکہ کسی بھی AI کرالر کی سرگرمی کو دیکھا جا سکے جو جگہ سے باہر نظر آتی ہے۔.

- کیپچا سیٹ اپ کریں۔: میری ویب سائٹ کے ان حصوں پر جہاں صارفین بات چیت کرتے ہیں، میں کیپچا استعمال کرتا ہوں۔ یہ ٹیسٹ خودکار بوٹس کے علاوہ حقیقی لوگوں کو بتانے میں بہت اچھے ہیں۔.

- کچھ IP پتوں کو مسدود کریں۔: جب مجھے ضرورت ہو، میں ان IP پتوں کو بلاک کر دیتا ہوں جن کے بارے میں میں جانتا ہوں کہ انہیں میری سائٹ سے دور رکھنے کے لیے AI کرالر سے منسلک ہیں۔.

یہ چیزیں کرنے سے، میں اپنے مواد کی حفاظت کرتا ہوں اور اس بات کو یقینی بناتا ہوں کہ میں ڈیٹا پرائیویسی اور دانشورانہ املاک سے متعلق قوانین کی پیروی کر رہا ہوں۔.

مواد کی رسائی کا انتظام کرنا

آپ کی ویب سائٹ کے مواد کو غیر مجاز سکریپنگ سے بچانا

مواد کو کھرچنے کے خدشات کو دور کرنے کے لیے، آئیے آپ کی ویب سائٹ کے مواد تک کون رسائی حاصل کر سکتا ہے اس کو کنٹرول کرنے کے مؤثر طریقوں پر بات کرتے ہیں۔ بوٹ کے اندراج کو محدود کرنا بہت ضروری ہے، اور میں ان خودکار نظاموں کو آپ کی سائٹ کے مواد کو کاپی کرنے یا انڈیکس کرنے سے روکنے کے لیے مخصوص تکنیکوں کا خاکہ پیش کروں گا۔ اس میں تکنیکی تبدیلیاں اور رسائی کنٹرول کے اقدامات کی محتاط ترتیب شامل ہوگی۔.

آپ کی ویب سائٹ کے مواد کی حفاظت

ان لوگوں کے لیے جو ویب سائٹ کا نظم کرتے ہیں، اس بات کو یقینی بنانا کہ آپ کا مواد خصوصی رہے اور خودکار سکریپنگ سسٹم سے محفوظ رہے۔ مخصوص تکنیکی اقدامات کو نافذ کرنے سے آپ کو یہ کنٹرول کرنے میں مدد مل سکتی ہے کہ آپ کی ویب سائٹ کے مواد تک رسائی اور انڈیکس کرنے کی اہلیت کس کے پاس ہے۔.

آپ اپنی robots.txt کو ایڈجسٹ کرنے پر غور کر سکتے ہیں۔ سرچ انجن کو ہدایت دینے کے لیے فائل بوٹس آپ کی سائٹ کے کن حصوں تک رسائی حاصل نہیں کی جانی چاہئے۔ کیپچا سسٹمز کو استعمال کرنے سے بوٹس کو انسانی صارفین میں رکاوٹ ڈالے بغیر بھی روکا جا سکتا ہے۔ زیادہ نفیس نقطہ نظر کے لیے، آپ جائز وزیٹرز اور ممکنہ کھرچنے والوں کے درمیان فرق جاننے کے لیے سرور سائیڈ چیکس کو نافذ کر سکتے ہیں۔.

یاد رکھیں، آپ کے مواد کی سالمیت اور خصوصیت سب سے اہم ہے۔ اپنی سائٹ کو محفوظ بنانے کے لیے فعال اقدامات کر کے، آپ اپنے مواد اور اس کی تقسیم پر کنٹرول برقرار رکھتے ہیں۔ بہر حال، آپ جو مواد بناتے ہیں وہ آپ کے برانڈ کی عکاسی کرتا ہے اور اسے احتیاط کے ساتھ محفوظ کیا جانا چاہیے۔.

بوٹ تک رسائی کو محدود کرنا

بوٹ تک رسائی کو محدود کرنا

میں نے دریافت کیا ہے کہ مخصوص اقدامات کرنے سے میری سائٹ سے مواد کی کٹائی کے خودکار نظاموں کے خطرے کو بہت حد تک کم کیا جا سکتا ہے۔ یہاں میں اس سے کیسے رجوع کرتا ہوں:

- Robots.txt کو ایڈجسٹ کرنا: میں ٹھیک ٹھیک ہوں میری

robots.txtسکریپنگ کے قانونی پہلوؤں اور ڈیٹا پرائیویسی کے خدشات کو مدنظر رکھتے ہوئے بوٹ تک رسائی کو کنٹرول کرنے کے لیے فائل۔. - شرح کی حدود کو نافذ کرنا: اپنے سرور پر شرح کی حدیں متعارف کروا کر، میں بوٹ ٹریفک کے ممکنہ خلل ڈالنے والے اثرات کو روک سکتا ہوں۔.

- API کنٹرولز کا اطلاق کرنا: میں APIs کے ذریعے ضرورت کے مطابق کم معلومات کا اشتراک کرتا ہوں اور اندراج کو محدود کرنے کے لیے مناسب تصدیق کی ضرورت ہوتی ہے۔.

- مواد کی ترسیل کے نیٹ ورکس کا استعمال: بوٹ مینجمنٹ کی صلاحیتوں کے ساتھ آنے والے CDNs کو ملازمت دینے سے مجھے یہ انتظام کرنے کی اجازت ملتی ہے کہ کون میرے مواد تک رسائی حاصل کرتا ہے اور مؤثر طریقے سے اس کی حفاظت کرتا ہے۔.

یہ اقدامات خودکار ٹولز کے ذریعے مواد کی غیر مجاز کٹائی کے خلاف دفاع کی ایک مضبوط لائن تشکیل دیتے ہیں۔.

مواد سکریپنگ کی روک تھام

اپ ڈیٹ کرنے کے بعد میری robots.txt فائل، میں اب مواد کو سکریپ کرنے سے روکنے کے اقدامات پر توجہ مرکوز کر رہا ہوں، اس بات کو یقینی بناتے ہوئے کہ میری ویب سائٹ قابل رسائی اور محفوظ رہے۔ میں سکریپنگ کے تکنیکی پہلوؤں، اس کے قانونی نتائج، اور صارف کے ڈیٹا کو جدید ترین AI سکریپنگ طریقوں سے بچانے کی اہمیت کا جائزہ لے رہا ہوں۔.

| حکمت عملی | تفصیل |

|---|---|

| متغیر مواد کی ترسیل | انسانی وزٹرز کے مقابلے خودکار ٹولز کو مختلف مواد فراہم کریں۔. |

| صارف کی سرگرمی کی نگرانی | ان طرز عمل کی جانچ کریں جو کھرچنے کی نشاندہی کر سکتے ہیں۔. |

| رسائی کی پابندیاں | کنٹرول کریں کہ صارف کتنی بار مواد تک رسائی حاصل کر سکتے ہیں اور مشکوک IP پتوں کو مسدود کر سکتے ہیں۔. |

ان حکمت عملیوں کو احتیاط سے رکھ کر، میں نہ صرف اپنی ویب سائٹ کے مواد کی حفاظت کر رہا ہوں، بلکہ میں صارف کی معلومات کو نجی اور محفوظ بھی رکھتا ہوں۔ یہ میری ویب سائٹ کے مواد کو منظم کرنے اور خودکار ٹولز کے ذریعے غیر مجاز رسائی یا غلط استعمال کو روکنے کے لیے ایک دانستہ منصوبہ ہے۔.

ان حکمت عملیوں کو شامل کرنا ان لوگوں سے آگے رہنے کا ایک زبردست طریقہ ہے جو آپ کی محنت کا غلط استعمال کرنے کی کوشش کر سکتے ہیں۔ یہ ایک جدید ترین الارم سسٹم قائم کرنے جیسا ہے جو نہ صرف گھسنے والوں پر نظر رکھتا ہے بلکہ آپ کے مہمانوں کی رازداری کا بھی احترام کرتا ہے۔ یہ ممکنہ خطرات کے پیش نظر رد عمل کے بجائے فعال ہونے کے بارے میں ہے۔.

حفاظتی اقدامات کو باقاعدگی سے اپ ڈیٹ کرنا

ابتدائی دفاع کو ترتیب دینا جیسے اپنے robots.txt کو ٹویٹ کرنا یا کیپچا شامل کرنا ایک بہترین شروعات ہے، لیکن مواد کو کھرچنے والے جدید AI ٹولز سے مؤثر طریقے سے حفاظت کے لیے، اپنی ویب سائٹ کی حفاظتی حکمت عملیوں کو مسلسل تازہ کرنا بہت ضروری ہے۔ ٹیک ماحول مسلسل بہاؤ کی حالت میں ہے، AI کی صلاحیتیں زیادہ نفیس ہوتی جا رہی ہیں اور کبھی کبھار پرانے حفاظتی طریقوں کو پیچھے چھوڑتی ہیں۔ لہذا، آپ کی ویب سائٹ کی حفاظت کو برقرار رکھنے کے لیے ایک اسٹریٹجک، ٹیک سیوی، اور منظم انداز کی ضرورت ہوتی ہے۔.

یہاں میری حکمت عملی ہے:

- معمول کے حفاظتی جائزے: میں اس بات کو یقینی بناتا ہوں کہ کسی بھی ابھرتے ہوئے کمزور مقامات کو تلاش کرنے کے لیے باقاعدگی سے حفاظتی چیکس کروائیں، اس بات کو یقینی بناتے ہوئے کہ میرے تحفظات تازہ ترین اور موثر ہیں۔.

- اپ ڈیٹس میں سرفہرست رہنا: میں تازہ ترین حفاظتی پیچ سے باخبر رہتا ہوں اور اس بات کو یقینی بناتا ہوں کہ میری سائٹ کے تمام سافٹ ویئر عناصر موجودہ ہیں۔.

- حفاظتی اقدامات کو اپنانا: میں مخصوص خطرات سے نمٹنے کے لیے اپنی حفاظتی ترتیبات کو ایڈجسٹ کرتا ہوں، جس سے مواد کی حفاظت اور صحیح وجوہات کی بنا پر اس تک رسائی کو یقینی بنانے کے درمیان صحت مند توازن برقرار رکھنے میں مدد ملتی ہے۔.

- ٹریفک تجزیہ اور رپورٹنگ: میری سائٹ پر ٹریفک کے بہاؤ کے طریقہ پر نظر رکھنے اور رسائی کے نوشتہ جات کی چھان بین کرنے سے، میں مشکوک رویے کی فوری شناخت کرنے اور اس پر کارروائی کرنے کے قابل ہوں جو AI سکریپنگ کی کوشش کی نشاندہی کر سکتا ہے۔.

میری ویب سائٹ کو محفوظ بنانا کوئی طے شدہ اور بھول جانے والا معاملہ نہیں ہے۔ خراب ارادوں والے لوگوں کو روکنا ایک مسلسل چیلنج ہے۔ سیکیورٹی کے بارے میں الرٹ اور فعال رہ کر، میں نہ صرف اپنی سائٹ کے مواد کی بلکہ دیکھنے والوں کی رازداری کی بھی حفاظت کر رہا ہوں۔.

قانونی تحفظات کی تلاش

قانونی پیچیدگیوں کو نیویگیٹ کرتے ہوئے، میں اپنی ویب سائٹ کی حفاظت کے لیے غیر مجاز AI سکریپنگ کے خلاف کاپی رائٹ کے قوانین اور ضوابط کی جانچ کر رہا ہوں۔ قومی اور بین الاقوامی کاپی رائٹ قوانین میری سائٹ پر موجود مواد کو کس طرح متاثر کرتے ہیں اس کو سمجھنے کے لیے ایک منظم انداز اختیار کرنا ضروری ہے۔ میں نے یہ دیکھنے کے لیے ڈیجیٹل ملینیم کاپی رائٹ ایکٹ (DMCA) کا بھی جائزہ لیا ہے کہ یہ میرے مواد کو AI سے چلنے والی خلاف ورزیوں سے کیسے بچا سکتا ہے۔.

AI ٹولز کے استعمال کی شرائط کا اندازہ لگانا ایک ذمہ دار قدم ہے اس بات کو یقینی بنانے کے لیے کہ وہ ویب سائٹس سے ڈیٹا استعمال کرنے اور جمع کرنے کے اپنے حقوق سے تجاوز نہیں کرتے ہیں۔ تفصیل پر یہ توجہ میری سائٹ کے صارف کے تجربے کو محفوظ رکھنے اور میرے مواد کے غلط استعمال کو روکنے کی کلید ہے، جس سے میرے برانڈ کا اثر کم ہو سکتا ہے اور وزیٹر کی مصروفیت کم ہو سکتی ہے۔.

مزید برآں، میں تکنیکی حکمت عملیوں پر غور کر رہا ہوں جیسے سخت رسائی کے کنٹرول کو نافذ کرنا اور سکریپنگ کی کوششوں کی شناخت اور ان کو کم کرنے کے لیے ٹریفک کے مسلسل تجزیہ۔ قانونی اقدامات اور تکنیکی تحفظات کا امتزاج میری ویب سائٹ کی انفرادیت کو برقرار رکھنے اور اس کے پیچھے تخلیقی کوششوں کی حفاظت کرنے کا میرا منصوبہ ہے۔.

اکثر پوچھے گئے سوالات

اگر میں AI ٹولز کو اپنی ویب سائٹ کو سکریپ کرنے سے روکتا ہوں، تو کیا یہ میری سائٹ کی مرئیت یا گوگل یا بنگ جیسے دوسرے سرچ انجنوں پر درجہ بندی کو متاثر کرے گا؟

میں اس بات پر غور کر رہا ہوں کہ آیا AI ٹولز کو میری ویب سائٹ کو سکریپ کرنے سے روکنے سے یہ بدل سکتا ہے کہ میری سائٹ کتنی اچھی کارکردگی دکھاتی ہے۔ سرچ انجن جیسے گوگل یا بنگ۔ آن لائن مرئیت کے بارے میں کسی بھی الجھن کو دور کرنا ضروری ہے۔ یہ سرچ انجن درجہ بندی کے لیے منفرد الگورتھم استعمال کرتے ہیں۔. وہ AI ٹولز کے ذریعے انڈیکسنگ پر خصوصی طور پر انحصار نہیں کرتے ہیں۔ میرا مقصد اپنے مواد کو محفوظ رکھنا اور پھر بھی اچھی پوزیشن برقرار رکھنا ہے۔ تلاش کے نتائج. عملی طور پر، اس کا مطلب ہے میری حفاظت کے درمیان محتاط توازن تلاش کرنا ویب سائٹ کا مواد اور ٹھوس SEO کا حصول نتائج.

اپنی ویب سائٹ کے ٹریفک کا تجزیہ کرتے وقت میں جائز سرچ انجن کرالر اور اے آئی سکریپرز کے درمیان کیسے فرق کر سکتا ہوں؟

میرے کو دیکھتے وقت غیر مجاز AI سکریپرز سے جائز سرچ انجن کرالرز کو الگ کرنے کے لیے ویب سائٹ کی ٹریفک, میں صارف کے رویے میں ان نمونوں کا باریک بینی سے جائزہ لیتا ہوں جو خودکار تعاملات تجویز کر سکتے ہیں۔ ممکنہ طور پر نقصان دہ ٹریفک کو روکنے کے لیے، میں IP بلاک کرنے کی تکنیکوں کا اطلاق کرتا ہوں۔ میں بوٹ کا پتہ لگانے والے ٹولز سے بھی فائدہ اٹھاتا ہوں، جو غیر منظور شدہ بوٹس کی نشاندہی کرنے اور ان کو کنٹرول کرنے میں میری مدد کرتے ہیں۔ یہ اقدامات مجھے اپنے مواد کی حفاظت کرنے میں مدد کرتے ہیں اور اس بات کو یقینی بناتے ہیں کہ میری سائٹ قابلِ اعتبار لوگوں تک رسائی کے قابل رہے۔ سرچ انجن.

حقیقی اور مصنوعی ٹریفک کے درمیان فرق کو سمجھنا اس بات کو یقینی بناتا ہے کہ میری ویب سائٹ کے تجزیات درست رہیں اور میرا مواد غلط ہاتھوں میں نہ جائے۔ ایک ویب سائٹ کے مالک کے طور پر، یہ میری ذمہ داری ہے کہ میں اپنی ڈیجیٹل پراپرٹی کو محفوظ رکھوں، بالکل اسی طرح جیسے کوئی شخص دکان کو چوروں سے محفوظ رکھتا ہے۔ ان حکمت عملیوں کے ساتھ، میں اعتماد کے ساتھ اپنی ویب سائٹ کے ٹریفک کا نظم کر سکتا ہوں اور اس کی سالمیت کو برقرار رکھ سکتا ہوں۔.

اگر میں نے محسوس کیا کہ میرے مواد کو میری اجازت کے بغیر کسی AI ٹول کے ذریعے پہلے ہی ختم کر دیا گیا ہے تو مجھے کیا اقدامات کرنے چاہئیں؟

یہ دریافت کرنے پر کہ میرا مواد میری رضامندی کے بغیر AI ٹول کے ذریعے استعمال کیا گیا ہے، پہلا قدم یہ ہے کہ اس خلاف ورزی کی ہر مثال کو احتیاط سے ریکارڈ کیا جائے۔ اس کے بعد، میں ذمہ دار فریق سے رابطہ کر کے، یا اگر ضرورت ہو تو، DMCA کے اخراج کی درخواستیں جاری کر کے اپنے مواد کا دوبارہ دعوی کرنے کی کوشش کروں گا۔ اگر یہ اقدامات مسئلے کو حل کرنے میں ناکام رہتے ہیں تو، قانونی چارہ جوئی پر غور کرنا ایک آپشن ہے۔ مزید برآں، عوام کو میرے کام کے غیر مجاز استعمال کے بارے میں مطلع کرنا، AI ٹولز کے اخلاقی استعمال کو فروغ دینا فائدہ مند ہے۔ آن لائن کسی کے تخلیقی حقوق کے تحفظ میں چوکسی اور فوری کارروائی کلیدی حیثیت رکھتی ہے۔.

یاد رکھیں: اپنے تخلیقی کام کی حفاظت کرنا صرف ایک حق نہیں ہے۔ یہ ایک ذمہ داری ہے.

کیا میرے مواد کو واٹر مارک کرنے کے لیے کوئی صنعتی معیارات یا بہترین طریقہ کار ہیں جو اس بات کی نشاندہی کریں کہ اسے AI ماڈلز کی تربیت کے لیے استعمال نہیں کیا جانا چاہیے؟

میں فی الحال AI ماڈلز کی تربیت میں اپنے مواد کو غیر مجاز استعمال سے بچانے کے طریقوں کا جائزہ لے رہا ہوں۔ ایک نقطہ نظر ڈیجیٹل واٹر مارکنگ اور مواد کی فنگر پرنٹنگ کا استعمال کرنا ہے، جو میرے کام میں غیر مرئی مارکر یا مخصوص کوڈز داخل کرتے ہیں۔ استعمال کے حوالے سے واضح پالیسیوں کے ساتھ مل کر، یہ حکمت عملی اس بات کی علامت کے طور پر کام کرتی ہیں کہ میرے مواد کو AI ماڈلز کی تربیت کے لیے استعمال نہیں کیا جانا چاہیے۔ کمیونٹی اب بھی اس معاملے پر رہنما خطوط کے ایک مشترکہ سیٹ کے لیے کام کر رہی ہے، اس لیے میں تازہ ترین حکمت عملیوں کے بارے میں باخبر رہتا ہوں تاکہ یہ یقینی بنایا جا سکے کہ میرے کام کی صحیح حفاظت کی جائے۔.

“"ایک ایسے دور میں جہاں ڈیٹا کو مسلسل الگورتھم میں فیڈ کیا جاتا ہے، دانشورانہ املاک کا تحفظ تخلیق کاروں کے لیے ایک مشترکہ تشویش ہے۔ فعال اور باخبر رہنا دانشمندی ہے۔"”

اگر AI ٹولز کیپچا کو نظرانداز کرنے کی صلاحیت پیدا کرتے ہیں، تو مجھے اپنی ویب سائٹ کو غیر مجاز ڈیٹا نکالنے سے بچانے کے لیے مزید جدید ترین حفاظتی حکمت عملی اپنانے کی ضرورت ہوگی۔ ایک مؤثر طریقہ ہے۔ طرز عمل بایومیٹرکس, ، جو اس بات میں بے ضابطگیوں کی نگرانی کرتا ہے کہ صارفین کس طرح سائٹ کے ساتھ تعامل کرتے ہیں۔ اس سے انسانی زائرین اور ممکنہ خودکار سکریپرز کے درمیان فرق کرنے میں مدد مل سکتی ہے۔.

تحفظ کی ایک اور پرت شامل ہے۔ فنگر پرنٹ تجزیہ. یہ تکنیک کسی ڈیوائس اور اس کے براؤزر کی منفرد خصوصیات کا جائزہ لیتی ہے، جیسا کہ آپریٹنگ سسٹم، اسکرین ریزولوشن، اور انسٹال کردہ فونٹس، بوٹ کی سرگرمی کی مخصوص تضادات کو تلاش کرنے کے لیے۔.

ایک قدم آگے رہنے کے لیے، میں عمل میں لاؤں گا۔ انکولی چیلنجز. یہ حفاظتی چیک ہیں جو تشخیص شدہ خطرے کی بنیاد پر پیچیدگی میں مختلف ہو سکتے ہیں، ایک متحرک دفاع کو یقینی بناتے ہیں جو خطرے کی سطح کے مطابق ہوتا ہے۔ ان جدید طریقوں کو بروئے کار لا کر، میں AI سے چلنے والے جدید ترین سکریپنگ ٹولز کے خلاف اپنی ویب سائٹ کی سیکیورٹی کو نمایاں طور پر مضبوط بنا سکتا ہوں۔.

ورلڈ وائڈ ویب کے تناظر میں AI سکریپنگ پروٹیکشن کیا ہے؟

AI سکریپنگ پروٹیکشن سے مراد وہ طریقے اور ٹیکنالوجیز ہیں جو خودکار بوٹس کو بغیر اجازت ویب سائٹس سے ڈیٹا کی کٹائی یا سکریپنگ سے روکنے کے لیے استعمال ہوتے ہیں۔ یہ ٹیکنالوجیز مصنوعی ذہانت کی صلاحیتوں سے فائدہ اٹھاتی ہیں تاکہ اس طرح کی سرگرمیوں کا پتہ لگانے، شناخت کرنے اور ان کو روکنے کے لیے۔.

AI سکریپر انٹرنیٹ پر دانشورانہ املاک کے لیے کیوں خطرہ ہے؟

AI سکریپرز کو خطرہ لاحق ہے کیونکہ وہ ویب پر شائع ہونے والی ملکیتی معلومات کی بڑی مقدار کو جلدی اور مؤثر طریقے سے جمع کر سکتے ہیں۔ اس ڈیٹا میں کاپی رائٹ شدہ مواد، تجارتی راز، ڈیٹا بیس یا دیگر ڈیجیٹل اثاثے شامل ہو سکتے ہیں جن کا مقصد صرف ماخذ کی ویب سائٹ پر استعمال کرنا ہے۔.

AI سکریپر کیسے کام کرتا ہے؟

ایک AI سکریپر انسانی براؤزنگ کے رویے کی تقلید کرکے کام کرتا ہے۔ یہ ویب صفحات کا دورہ کرتا ہے، پہلے سے طے شدہ معیار کی بنیاد پر متعلقہ معلومات کی شناخت کرتا ہے، پھر اس ڈیٹا کو کہیں اور استعمال کرنے کے لیے نکالتا ہے۔ ان آلات کی نفاست وسیع پیمانے پر مختلف ہوتی ہے۔ کچھ پیچیدہ سائٹ کے ڈھانچے کو نیویگیٹ کرنے اور اینٹی سکریپنگ کے بنیادی اقدامات سے بچنے کی صلاحیت رکھتے ہیں۔.

AI سکریپنگ پروٹیکشن میں عام طور پر کون سی تکنیک استعمال کی جاتی ہے؟

AI سکریپنگ پروٹیکشن میں اکثر استعمال کی جانے والی تکنیکوں میں شرح کو محدود کرنا (یہ محدود کرنا کہ IP ایڈریس ایک مخصوص مدت کے اندر کتنی درخواستیں کر سکتا ہے)، کیپچا ٹیسٹ (جو صارفین کو چیلنج کرتے ہیں کہ وہ انسان ہیں)، صارف ایجنٹ کا تجزیہ (مشکوک براؤزر کی سرگرمی کی نشاندہی کرنے کے لیے)، اور مزید جدید مشین لرننگ الگورتھم جو بوٹ کے رویے کی نشاندہی کرنے والے غیر معمولی نمونوں کا پتہ لگاسکتے ہیں۔.

کیا مصنوعی ذہانت کو ویب سکریپنگ سرگرمیوں سے بچانے کے لیے استعمال کیا جا سکتا ہے؟

جی ہاں، مصنوعی ذہانت کی مختلف شکلیں جیسے مشین لرننگ الگورتھم کو ویب سکریپنگ کا پتہ لگانے اور روکنے کے لیے استعمال کیا جا سکتا ہے۔ یہ سسٹم بوٹ رویے کی سابقہ مثالوں سے سیکھتے ہیں، جس سے وہ مستقبل کے ممکنہ حملوں کا بہتر انداز میں اندازہ لگا سکتے ہیں اور انہیں ناکام بنا سکتے ہیں۔ وہ ریئل ٹائم پتہ لگانے کی تکنیک کو بھی نافذ کر سکتے ہیں جو بوٹ کی مشتبہ سرگرمی ہونے پر فوری کارروائی کی اجازت دیتی ہیں۔.

آپ کی ویب سائٹ کو AI ٹولز کے ذریعے سکریپ ہونے سے بچانے کے بارے میں میرے آخری خیالات

میری ویب سائٹ کو ناپسندیدہ AI سکریپنگ سے محفوظ رکھنا ایک مسلسل کوشش ہے جس کے لیے مستعدی کی ضرورت ہے۔ میں نے محسوس کیا ہے کہ robots.txt کا سمارٹ استعمال، کیپچا کا نفاذ، تسلیم شدہ AI سکریپرز کو مسدود کرنا، مواد تک رسائی کا انتظام کرنا، اور اپنے حفاظتی اقدامات کو مسلسل اپ ڈیٹ کرنا اہم اقدامات ہیں۔ اگرچہ قانونی اقدامات کو شامل کرنا تحفظ کی ایک اضافی تہہ پیش کرتا ہے، باقی چوکنا رہنا اور تکنیکی طور پر ماہر ہونا اس بات کو یقینی بنانے کے لیے کلید ہے کہ میرا مواد میرے دائرہ کار میں رہے، اس طرح میری ویب سائٹ کی سالمیت اور اس کی قیمت کو برقرار رکھنے کے لیے جو اسے دیکھنے والوں کو پیش کرتا ہے۔.

مستند حوالہ جات

اگر آپ اپنی ویب سائٹس کو AI Crawlers سے بچانے کے بارے میں کچھ اور پڑھنا چاہتے ہیں، تو میں آپ کو مندرجہ ذیل پوسٹ پر ایک نظر ڈالنے کی سفارش کرتا ہوں:

- ITPro - AI ویب سکریپنگ: اپنے کاروبار کو کیسے بچائیں۔

- اس مضمون میں AI ویب سکریپنگ کی پیچیدگیوں اور اس سے وابستہ خطرات پر تبادلہ خیال کیا گیا ہے۔ یہ بصیرت فراہم کرتا ہے کہ AI کس طرح زیادہ رفتار اور نفاست کے ساتھ ڈیٹا اکٹھا کر سکتا ہے، اس کا تجزیہ کر کے آؤٹ پٹ تیار کر سکتا ہے۔.

- ITPro آرٹیکل

- مصنفین کا گلڈ - مصنفین کے لیے اپنے کام کو AI کے استعمال سے بچانے کے لیے عملی نکات

- یہ وسیلہ مصنفین اور ویب سائٹ کے مالکان کے لیے عملی مشورہ پیش کرتا ہے کہ ان کے کاموں کو AI کے استعمال سے کیسے بچایا جائے، بشمول OpenAI کے GPTBot جیسے AI ویب کرالر کو بلاک کرنے کے لیے robots.txt فائل کا استعمال۔.

- مصنفین گلڈ کے نکات

- ریزولوشن ڈیجیٹل - ویب سائٹ کو اس سے محفوظ کریں۔ AI مواد کھرچنا

- یہ مضمون ChatGPT جیسے AI ٹولز کے ذریعے آپ کی ویب سائٹ کو سکریپنگ اور غیر مجاز استعمال سے بچانے کے لیے آسان اقدامات فراہم کرتا ہے۔ یہ robots.txt فائلوں، کیپچا کے نفاذ، اور IP رینج بلاکس کے استعمال پر بحث کرتا ہے۔.

- ریزولوشن ڈیجیٹل گائیڈ

- Octoparse - برانڈ کے تحفظ اور سائبرسیکیوریٹی کے لیے ویب سکریپنگ

- یہ بلاگ پوسٹ دریافت کرتی ہے کہ ویب سکریپنگ کو برانڈ کے تحفظ اور سائبرسیکیوریٹی کے لیے کس طرح استعمال کیا جا سکتا ہے۔ یہ ممکنہ خلاف ورزیوں اور کاپی رائٹ کی خلاف ورزیوں کو تلاش کرنے کے لیے ویب سکریپنگ ٹولز کے استعمال پر بحث کرتا ہے۔.

- آکٹوپارس آرٹیکل

- سائنس ڈائریکٹ - AI ویب سکریپنگ کے خلاف جنگ

- ScienceDirect کا یہ مضمون AI ویب سکریپنگ پر بڑھتے ہوئے اعتراضات کی کھوج کرتا ہے، جس میں AI میں تیز رفتار پیش رفت اور متن اور دیگر ڈیجیٹل مواد کے وسیع ڈیٹا سیٹس پر اس کی تربیت کو اجاگر کیا گیا ہے۔.

- سائنس ڈائریکٹ آرٹیکل