Pakinggan ang buod ng post:

Ang aking website ay parang isang maayos na inaalagaang hardin, na may orihinal na nilalaman na umuunlad sa bawat bisita. Gayunpaman, sa pagsulong ng mga AI tool na bihasa sa pagkuha ng data mula sa mga website, kinilala ko ang pangangailangang palakasin ang mga depensa ng aking site upang harangan ang mga hindi gustong pagkuha na ito. Sa pamamagitan ng aking karanasan, nakalap ko ang mga mga estratehiya upang epektibong protektahan ang iyong website mula sa AI scraping. Talakayin natin ang ilang hakbang para protektahan ang iyong site. Gagabayan kita sa pagpapatupad ng mga direktiba ng robots.txt, pag-set up ng mga hamon sa CAPTCHA, at mga karagdagang pamamaraan para matiyak na ang iyong nilalaman ay mananatili lamang sa iyong domain. Ang lahat ay tungkol sa pagpapanatili ng kabanalan ng iyong online na realm, at siguraduhing ang mga taong bisita ang makikinabang sa iyong pagsusumikap.

Sa diwa ng pagpapanatiling ligtas ng iyong digital na kanlungan, tandaan, "Tinitiyak ng isang matibay na gate na tanging ang mga sumasalubong lamang ang makaka-appreciate sa hardin sa loob."“

Mga Pangunahing Puntos

Ang pagprotekta sa aking website mula sa mga AI scraper ay isang patuloy na laban na nangangailangan ng atensyon at mga proaktibong estratehiya. Natuklasan ko na ang epektibong pag-configure ng aking robots.txt file, pag-set up ng CAPTCHA, pagtukoy at pagharang sa kilalang AI scraper ay... mga kagamitan, ang pagkontrol kung sino ang maaaring maka-access sa aking nilalaman, at ang madalas na pag-update ng mga protocol ng seguridad ay mahahalagang estratehiya. Ang pagdaragdag ng mga legal na proteksyon ay nagbibigay ng isa pang layer ng depensa, ngunit ang pananatiling mapagmatyag at matalas sa teknikal na aspeto ang pinakamahusay na paraan upang mapanatiling ligtas ang aking nilalaman at mapangalagaan ang halaga ng aking site para sa mga bisita.

Tandaang panatilihing napapanahon ang mga depensa ng iyong website, dahil patuloy na umuunlad ang mga pamamaraan para sa data scraping. Regular na suriin ang iyong mga setting ng seguridad at maging handa na umangkop sa mga bagong hamon upang mapanatiling ligtas ang iyong nilalaman.

Pag-unawa sa AI Web Scraping

Habang tinatalakay natin ang paksa ng AI web scraping, mahalagang kilalanin ang mga etikal na implikasyon ng gawaing ito. Susuriin ko ang mga potensyal na panganib at benepisyo, at sisiguraduhin na magtatatag tayo ng balangkas para sa etikal na pag-uugali sa pangongolekta ng datos ng AI. Pagkatapos nito, susuriin ko ang mga teknikal na hakbang na magagamit ng mga may-ari ng website na naghahangad na protektahan ang kanilang nilalaman mula sa hindi awtorisadong AI scraping.

Habang tinatalakay natin ang paksa ng AI web scraping, mahalagang kilalanin ang mga etikal na implikasyon ng gawaing ito. Susuriin ko ang mga potensyal na panganib at benepisyo, at sisiguraduhin na magtatatag tayo ng balangkas para sa etikal na pag-uugali sa pangongolekta ng datos ng AI. Pagkatapos nito, susuriin ko ang mga teknikal na hakbang na magagamit ng mga may-ari ng website na naghahangad na protektahan ang kanilang nilalaman mula sa hindi awtorisadong AI scraping.

Pag-alis ng mga Alalahaning Etikal

Pag-unawa sa mga Etikal na Dimensyon ng AI Pag-scrape ng Nilalaman

Bakit ka dapat mag-alala tungkol sa mga etikal na aspeto ng mga AI tool na kumukuha ng nilalaman mula sa iyong website? Kapag sinusuri ang paksang ito, mahalagang tingnan ang kasalimuotan ng privacy ng data. Ang hindi reguladong AI scraping ay maaaring humantong sa hindi awtorisadong pagkolekta ng impormasyong pagmamay-ari, na maaaring lumabag sa intelektwal na ari-arian ng mga lumilikha ng nilalaman. Mahalaga ring sumunod sa mga batas na kumokontrol sa kung paano kinokolekta at ginagamit ang data. Nilalayon ng mga batas na ito na protektahan ang mga indibidwal at kumpanya mula sa mga paglabag sa privacy at maling paggamit ng kanilang impormasyon. Ang pagiging napapanahon sa mga regulasyong ito ay kinakailangan upang mapanatiling ligtas ang nilalaman ng iyong website at upang matiyak na ang iyong mga kasanayan ay etikal na maayos habang umuunlad ang teknolohiya.

Mga Panlaban sa Pag-scrape

Para maiwasan ang pagkuha ng datos mula sa aking website ng mga automated system, regular akong gumagawa ng mga pagsasaayos sa robots.txt file. Dahil sa maingat na pagsasanay na ito, natutukoy ko kung aling mga bahagi ng aking website ang maaaring ma-access ng mga bot tulad ng GPTBot. Sa pamamagitan ng patuloy na pag-update ng mga tagubiling ito, pinoprotektahan ko ang nilalaman ng aking website mula sa hindi awtorisadong pagkuha ng mga automated tool.

Sa paggawa nito, hindi lang ako basta sumusunod sa isang teknikal na gawain; naninindigan ako upang pangalagaan ang halaga at privacy ng impormasyong pinaghirapan kong likhain. Bilang mga webmaster, dapat tayong maging mapagmatyag at maagap upang ma-secure ang ating mga digital na ari-arian sa mga bawal na landas na pinagkakatiwalaan ng mga gumagamit.

Tandaan, ang isang mahusay na napanatiling robots.txt file ay isang simple ngunit epektibong patong ng depensa laban sa walang humpay na pagtatangka ng mga data scraper.

Regular na I-update ang Robots.txt

Ang pagpapanatili ng seguridad ng nilalaman ng iyong website ay nangangahulugan ng regular na pagsusuri at pag-update ng iyong robots.txt file. Ganito ko ito epektibong ginagawa:

- Magtakda ng regular na iskedyul para sa mga update.

- Gamitin ang pinakamahusay na mga pamamaraan para matukoy kung aling mga bahagi ng iyong site ang maaaring ma-access ng mga user-agent (tulad ng mga web crawler).

- Subaybayan ang mga pinakabagong pag-unlad sa mga AI scraping tool upang manatiling nangunguna sa mga potensyal na panganib sa seguridad.

- Gumawa ng mga kinakailangang pagsasaayos sa mga path na bawal sundan upang matiyak na ang iyong nilalaman ay nananatiling protektado mula sa hindi awtorisadong pag-access.

Bakit Kailangang I-update ang Iyong Robots.txt?

Ang pag-update ng iyong robots.txt file ay isang simple ngunit mabisang paraan upang pangalagaan ang iyong website. Sinasabi nito sa mga search engine at iba pang web crawler kung aling mga pahina o seksyon ng iyong site ang hindi dapat ma-access o naka-index. Makakatulong ito na maiwasan ang mga hindi gustong pagkayod at maaaring maging bahagi ng isang mas malaking estratehiya upang protektahan ang nilalaman ng iyong site.

Tandaan, habang lumilitaw ang mga bagong uri ng web crawler, ang pananatiling mapagmatyag at pag-aangkop sa iyong robots.txt file ay isang matalinong hakbang. Ang isang mahusay na napanatiling robots.txt file ay mahalaga sa pangkalahatang diskarte sa seguridad ng iyong website.

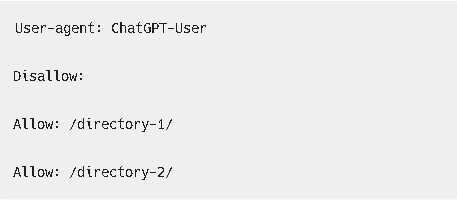

Epektibong Paggamit ng Robots.txt

Para protektahan ang iyong website mula sa mga hindi gustong awtomatikong pangongolekta ng datos, pag-usapan natin kung paano maingat na i-update ang robots.txt file. Maaari mong utusan ang ilang web crawler, tulad ng GPTBot ng OpenAI, na i-access o i-bypass ang nilalaman ng iyong site sa pamamagitan ng paglikha ng mga partikular na panuntunan ng user-agent. Sa pamamagitan ng pag-set up ng mga parameter na ito nang may atensyon sa detalye, makakakuha ka ng tumpak na kontrol sa kung aling mga bahagi ng iyong site ang maaaring i-index o balewalain ng iba't ibang AI system.

Para protektahan ang iyong website mula sa mga hindi gustong awtomatikong pangongolekta ng datos, pag-usapan natin kung paano maingat na i-update ang robots.txt file. Maaari mong utusan ang ilang web crawler, tulad ng GPTBot ng OpenAI, na i-access o i-bypass ang nilalaman ng iyong site sa pamamagitan ng paglikha ng mga partikular na panuntunan ng user-agent. Sa pamamagitan ng pag-set up ng mga parameter na ito nang may atensyon sa detalye, makakakuha ka ng tumpak na kontrol sa kung aling mga bahagi ng iyong site ang maaaring i-index o balewalain ng iba't ibang AI system.

I-edit nang Tama ang Robots.txt

Para maprotektahan ang iyong website mula sa mga hindi gustong AI-powered scraping, mahalagang pangasiwaan nang may pag-iingat ang iyong robots.txt file. Ang hakbang na ito ay mahalaga sa pagpapanatiling pribado ng data ng iyong website at pagsunod sa mga batas sa pangangalap ng data. Narito ang aking gabay para magawa ito nang epektibo:

- Hanapin ang FileUna, nag-log in ako sa server ng website ko at hinanap ang robots.txt file na naroon na.

- Suriin ang Kasalukuyang mga PanuntunanSusunod, susuriin kong mabuti ang file upang lubos na maunawaan ang mga umiiral na patakaran at kung ano ang kahulugan ng mga ito para sa aking site.

- Mag-update nang may Pag-iingat: Nang may pagbibigay-pansin sa detalye, inaayos o inilalagay ko ang mga bagong patakaran upang tukuyin kung ano ang magagawa at hindi magagawa ng mga sistema ng AI, gamit ang 'Disallow:' upang harangan at 'Allow:' upang magbigay ng access.

- I-verify ang mga Pag-editKapag nagawa ko na ang mga pagbabago, pinapatakbo ko ang na-update na robots.txt sa mga tester upang matiyak na ang mga patakaran ay wastong nakasulat at gumagana ayon sa nilalayon.

Sa pamamagitan ng maingat na pagsasagawa ng mga hakbang na ito, ina-update ko ang aking robots.txt file upang mapanatiling ligtas ang aking site habang tinatanggap pa rin ang mga... mga search engine na tumutulong sa mga tao na mahanap ang aking nilalaman.

Pagpapatupad ng Pag-verify ng CAPTCHA

Sa pamamagitan ng pagbibigay-pansin sa beripikasyon ng CAPTCHA, ang pamamaraang ito ay nagsisilbing matibay na hadlang laban sa hindi awtorisadong awtomatikong pagkolekta ng datos. Gumagana ito sa pamamagitan ng pagkilala sa tunay na aktibidad ng tao mula sa awtomatikong software, epektibong humaharang sa mga hindi gustong bot habang pinapayagan ang mga totoong user na maka-access. Gayunpaman, kapag isinasama ang CAPTCHA, mahalagang isaalang-alang ang mga potensyal na epekto nito sa pakikipag-ugnayan ng user. Ang pagkakaroon ng tamang balanse ay susi sa pagtiyak na nananatiling user-friendly ang iyong website.

Bisa ng CAPTCHA

Ang pagsasama ng mga pagsusuri sa CAPTCHA ay isang matibay na estratehiya upang protektahan ang aking website mula sa mga hindi awtorisadong pag-scrape ng nilalaman gamit ang mga automated na tool. Narito ang aking pananaw kung bakit ito isang epektibong hakbang:

- Mga Komplikadong Hamon: Sopistikado Ang mga CAPTCHA ay nagdudulot ng masalimuot na mga palaisipan na mahirap para sa mga awtomatiko mga sistema ngunit mapapamahalaan pa rin para sa mga tao.

- Mga Patuloy na Update: Sa pamamagitan ng madalas na pag-refresh ng mga algorithm ng CAPTCHA, mas mapapabilis nila ang pag-unlad ng AI na maaaring makaiwas sa mga hindi nagbabagong sistema.

- Seguridad na may LayerKapag ginamit ang CAPTCHA kasama ng iba pang mga hakbang sa seguridad, lumilikha ito ng isang pinatibay na harang laban sa hindi awtorisadong pag-access.

- Pagbabantay: Ang pagsubaybay sa performance at success rate ng CAPTCHA ay maaaring magpahiwatig kung kailan dapat gumawa ng mga pagsasaayos o pagpapabuti.

Bagama't pinapalakas ng pagdaragdag ng CAPTCHA ang seguridad, lagi kong isinasaalang-alang ang etikal na aspeto at nilalayon kong panatilihing mababa hangga't maaari ang epekto sa mga gumagamit. Ang paghahanap ng tamang balanse sa pagitan ng matibay na seguridad at accessibility ng gumagamit ay isang maingat at patuloy na gawain.

Epekto ng Karanasan ng Gumagamit

Habang naglalagay ng mga CAPTCHA check, alam kong minsan ay nakakairita ang mga ito sa mga user, kahit na mahusay sila sa pagpigil sa mga bot na nag-scrape ng content gamit ang AI. Ipinapakita ng aking pagtatasa na epektibo ang mga CAPTCHA sa pagpigil sa mga bot na ito, na nakakatulong sa pamamahala ng daloy ng mga bisita sa website at nagpapababa ng posibilidad na makopya ang content nang walang pahintulot. Gayunpaman, mahalagang gamitin nang matalino ang tool na ito upang maiwasan ang pagtataboy sa mga taong bumibisita sa iyong site. Ang mahalaga ay ang paghahanap ng tamang balanse sa pagitan ng paggawa ng iyong content na madaling mapuntahan at pagprotekta nito laban sa mga hindi gustong AI scraping. Ang napakaraming CAPTCHA test ay maaaring magtaboy ng maraming totoong user gaya ng mga bot. Gumagamit ako ng mga CAPTCHA sa mga lugar kung saan malamang na mangyari ang scraping habang pinapanatiling user-friendly ang iba pang bahagi ng site. Ang aking layunin ay mag-alok ng magandang karanasan para sa mga bisita sa site habang pinapanatili ring ligtas ang content ng site mula sa anumang hindi awtorisadong scraping ng AI.

Pagharang sa mga Partikular na AI Crawler

Bilang isang taong nagpapatakbo ng isang website, may kakayahan akong harangan ang ilang AI crawler, tulad ng GPTBot ng OpenAI, upang pigilan sila sa pagkopya ng nilalaman mula sa aking site. Ang hakbang na ito ay hindi lamang tungkol sa paghinto sa hindi awtorisadong pagkolekta ng aking nilalaman, kundi tungkol din ito sa paggalang sa mga pamantayang etikal at mga legal na tuntunin patungkol sa paggamit ng nilalaman. Narito kung paano ko ito nilalapitan:

- Baguhin

robots.txtInaayos ko ang file na ito gamit ang mga partikular na tagubilin para sa mga AI crawler na nagbabalangkas kung saang mga bahagi ng aking site ipinagbabawal ang mga ito.

Ahente ng gumagamit: GPTBot

Huwag Payagan: /

Ahente ng gumagamit: ChatGPT-User

Huwag Payagan: /

Ahente ng gumagamit: CCBot

Huwag Payagan: /

- Suriin ang mga Log ng ServerGinagawa kong bahagi ng aking routine ang pagtingin sa mga log ng aking server para makita ang anumang aktibidad ng AI crawler na tila wala sa lugar.

- Mag-set up ng mga CAPTCHASa mga bahagi ng aking website kung saan nakikipag-ugnayan ang mga user, gumagamit ako ng mga CAPTCHA. Mahusay ang mga pagsubok na ito sa pagtukoy ng pagkakaiba ng mga totoong tao sa mga automated bot.

- Harangan ang Ilang IP AddressKapag kailangan ko, hinaharangan ko ang mga IP address na alam kong nakatali sa mga AI crawler para ilayo ang mga ito sa aking site.

Sa pamamagitan ng paggawa ng mga bagay na ito, pinoprotektahan ko ang aking nilalaman at tinitiyak na sinusunod ko ang mga patakaran na may kaugnayan sa privacy ng data at intelektwal na ari-arian.

Pamamahala ng Pagiging Accessible ng Nilalaman

Pagprotekta sa Nilalaman ng Iyong Website mula sa Hindi Awtorisadong Pag-scrape

Upang matugunan ang mga alalahanin tungkol sa content scraping, ating talakayin ang mga epektibong pamamaraan para makontrol kung sino ang maaaring maka-access sa nilalaman ng iyong website. Mahalagang paghigpitan ang pagpasok ng bot, at ibabalangkas ko ang mga partikular na pamamaraan upang maiwasan ang mga automated system na ito sa pagkopya o pag-index ng mga materyales ng iyong site. Kakailanganin nito ang mga teknikal na pagbabago at maingat na pagtatakda ng mga hakbang sa pagkontrol ng access.

Pagprotekta sa Nilalaman ng Iyong Website

Para sa mga namamahala ng isang website, ang pagtiyak na ang iyong nilalaman ay nananatiling eksklusibo at protektado mula sa mga awtomatikong sistema ng pag-scrape ay isang pangunahing alalahanin. Ang pagpapatupad ng mga partikular na teknikal na hakbang ay makakatulong sa iyong kontrolin kung sino ang may kakayahang mag-access at mag-index ng nilalaman ng iyong website.

Maaari mong isaalang-alang ang pagsasaayos ng iyong robots.txt file para magbigay ng tagubilin sa search engine mga bot kung aling mga bahagi ng iyong site ang hindi dapat ma-access. Ang paggamit ng mga sistema ng CAPTCHA ay maaari ring makahadlang sa mga bot nang hindi nakahahadlang sa mga gumagamit na tao. Para sa isang mas sopistikadong pamamaraan, maaari kang magpatupad ng mga pagsusuri sa panig ng server upang matukoy ang pagitan ng mga lehitimong bisita at mga potensyal na scraper.

Tandaan, ang integridad at eksklusibong katangian ng iyong nilalaman ay pinakamahalaga. Sa pamamagitan ng pagsasagawa ng mga proaktibong hakbang upang ma-secure ang iyong site, napapanatili mo ang kontrol sa iyong nilalaman at sa pamamahagi nito. Tutal, ang nilalamang iyong nilikha ay repleksyon ng iyong brand at dapat na pangalagaan nang may pag-iingat.

Paglilimita sa Pag-access sa Bot

Paglilimita sa Pag-access sa Bot

Natuklasan ko na ang pagsasagawa ng mga partikular na hakbang ay maaaring lubos na makabawas sa panganib ng pagkuha ng nilalaman mula sa aking site ng mga automated system. Narito kung paano ko ito nilalapitan:

- Pagsasaayos ng Robots.txt: Pinupuno ko ang aking

robots.txtfile upang kontrolin ang pag-access ng bot, isinasaalang-alang ang mga legal na aspeto ng scraping at mga alalahanin sa privacy ng data. - Pagpapatupad ng mga Limitasyon sa RateSa pamamagitan ng pagpapakilala ng mga limitasyon sa rate sa aking server, mapipigilan ko ang mga potensyal na nakakagambalang epekto ng trapiko ng bot.

- Paglalapat ng mga Kontrol ng APINagbabahagi ako ng kaunting impormasyon kung kinakailangan sa pamamagitan ng mga API at nangangailangan ng wastong pagpapatotoo upang paghigpitan ang pagpasok.

- Paggamit ng mga Network ng Paghahatid ng NilalamanAng paggamit ng mga CDN na may kasamang kakayahan sa pamamahala ng bot ay nagbibigay-daan sa akin na pamahalaan kung sino ang nag-a-access sa aking nilalaman at pangalagaan ito nang epektibo.

Ang pagsasagawa ng mga hakbang na ito ay bumubuo ng isang matibay na linya ng depensa laban sa hindi awtorisadong pagkuha ng nilalaman gamit ang mga awtomatikong tool.

Pag-iwas sa Pag-scrape ng Nilalaman

Pagkatapos kong i-update ang aking robots.txt file, nakatuon na ako ngayon sa mga hakbang upang maiwasan ang content scraping, tinitiyak na ang aking website ay nananatiling naa-access ngunit ligtas. Sinusuri ko ang mga teknikal na aspeto ng scraping, ang mga legal na kahihinatnan nito, at ang kahalagahan ng pagprotekta sa data ng user mula sa mga sopistikadong pamamaraan ng AI scraping.

| Istratehiya | Paglalarawan |

|---|---|

| Paghahatid ng Variable na Nilalaman | Magbigay ng ibang nilalaman sa mga awtomatikong tool kumpara sa mga taong bisita. |

| Pagsubaybay sa Aktibidad ng Gumagamit | Suriin ang mga kilos na maaaring magpahiwatig ng pagkayod. |

| Mga Restriksyon sa Pag-access | Kontrolin kung gaano kadalas maaaring ma-access ng mga user ang nilalaman at harangan ang mga kahina-hinalang IP address. |

Sa pamamagitan ng maingat na paglalapat ng mga estratehiyang ito, hindi ko lamang pinoprotektahan ang nilalaman ng aking website, kundi pinapanatili ko ring pribado at ligtas ang impormasyon ng gumagamit. Ito ay isang sinasadyang plano upang pamahalaan ang nilalaman ng aking website at upang pigilan ang hindi awtorisadong pag-access o maling paggamit ng mga awtomatikong tool.

Ang pagsasama ng mga estratehiyang ito ay isang matalinong paraan upang makaiwas sa mga maaaring magtangkang abusuhin ang iyong pinaghirapan. Para itong pag-set up ng isang sopistikadong sistema ng alarma na hindi lamang nagbabantay sa mga nanghihimasok kundi nirerespeto rin ang privacy ng iyong mga bisita. Ito ay tungkol sa pagiging proactive sa halip na reactive sa harap ng mga potensyal na banta.

Regular na Pag-update ng mga Hakbang sa Seguridad

Ang pag-set up ng mga panimulang depensa tulad ng pagsasaayos ng iyong robots.txt o pagdaragdag ng CAPTCHA ay isang magandang panimula, ngunit upang epektibong maprotektahan laban sa mga advanced na AI tool na kumukuha ng nilalaman, mahalagang patuloy na i-refresh ang mga estratehiya sa seguridad ng iyong website. Ang kapaligirang teknolohikal ay nasa isang estado ng patuloy na pagbabago, kung saan ang mga kakayahan ng AI ay nagiging mas sopistikado at paminsan-minsan ay nalulugi sa mga lumang pamamaraan ng seguridad. Samakatuwid, ang pagpapanatili ng seguridad ng iyong website ay nangangailangan ng isang estratehiko, tech-savvy, at sistematikong diskarte.

Narito ang aking estratehiya:

- Mga Regular na Pagsusuri sa SeguridadSinisikap kong magsagawa ng mga pagsusuri sa seguridad nang regular upang matukoy ang anumang mga lumilitaw na kahinaan, at tinitiyak na ang aking mga pag-iingat ay napapanahon at epektibo.

- Manatiling Nakasubaybay sa mga UpdateSinusubaybayan ko ang mga pinakabagong security patch at tinitiyak na napapanahon ang lahat ng elemento ng software ng aking site.

- Pag-aangkop sa mga Hakbang sa SeguridadInaayos ko ang aking mga setting ng seguridad upang matugunan ang mga partikular na banta, na nakakatulong na mapanatili ang isang malusog na balanse sa pagitan ng pagprotekta sa nilalaman at pagtiyak na naa-access ito para sa mga tamang dahilan.

- Pagsusuri at Pag-uulat ng TrapikoSa pamamagitan ng pagsubaybay sa daloy ng trapiko papunta sa aking site at pagsusuri sa mga access log, mabilis kong natutukoy at naaaksyunan ang kahina-hinalang pag-uugali na maaaring magpahiwatig ng isang pagtatangka sa AI scraping.

Ang pag-secure ng aking website ay hindi isang basta-basta na lang kinakalimutan; ito ay isang patuloy na hamon upang ipagtanggol ang mga may masamang intensyon. Sa pamamagitan ng pananatiling alerto at proaktibo tungkol sa seguridad, pinangangalagaan ko hindi lamang ang nilalaman ng aking site kundi pati na rin ang privacy ng mga bumibisita.

Paggalugad sa mga Legal na Proteksyon

Sa pag-navigate sa mga legal na komplikasyon, sinusuri ko ang mga batas at regulasyon sa copyright laban sa hindi awtorisadong AI scraping upang protektahan ang aking website. Mahalagang magsagawa ng sistematikong pamamaraan upang maunawaan kung paano nakakaapekto ang mga pambansa at internasyonal na batas sa copyright sa materyal sa aking site. Sinuri ko rin ang Digital Millennium Copyright Act (DMCA) upang makita kung paano nito maipagtatanggol ang aking nilalaman mula sa mga paglabag na dulot ng AI.

Ang pagtatasa ng mga tuntunin ng paggamit para sa mga AI tool ay isang responsableng hakbang upang matiyak na hindi nila lalabagin ang kanilang mga karapatan sa paggamit at pangangalap ng datos mula sa mga website. Ang pagbibigay-pansin sa detalyeng ito ay susi sa pagpapanatili ng karanasan ng gumagamit ng aking site at pagpigil sa maling paggamit ng aking nilalaman, na maaaring makabawas sa epekto ng aking brand at makabawas sa pakikipag-ugnayan ng mga bisita.

Bukod pa rito, isinasaalang-alang ko ang mga teknikal na estratehiya tulad ng pagpapatupad ng mahigpit na mga kontrol sa pag-access at patuloy na pagsusuri ng trapiko upang matukoy at mabawasan ang mga pagtatangka ng pag-scrape. Ang kombinasyon ng mga legal na hakbang at mga teknikal na pananggalang ang aking plano upang mapanatili ang natatanging katangian ng aking website at protektahan ang malikhaing pagsisikap sa likod nito.

Mga Madalas Itanong

Kung Harangan Ko ang mga AI Tool sa Pag-scrape ng Aking Website, Makakaapekto ba Ito sa Visibility o Ranking ng Aking Site sa Iba Pang Search Engine Tulad ng Google o Bing?

Pinag-iisipan ko kung ang pagpigil sa mga AI tool sa pag-scrape ng aking website ay maaaring magbago kung gaano kahusay ang performance ng aking site sa mga search engine tulad ng Google o Bing. Mahalagang linawin ang anumang kalituhan tungkol sa online visibility; ang mga ito Gumagamit ang mga search engine ng mga natatanging algorithm para sa pagraranggo. Hindi sila umaasa lamang sa pag-index ng mga AI tool. Ang layunin ko ay panatilihing protektado ang aking nilalaman at mapanatili pa rin ang isang magandang posisyon sa mga resulta ng paghahanap. Sa pagsasagawa, nangangahulugan ito ng paghahanap ng maingat na balanse sa pagitan ng pangangalaga sa aking nilalaman ng website at pagkamit ng matibay na SEO mga resulta.

Paano Ko Makikilala ang Pagitan ng mga Lehitimong Search Engine Crawler at AI Scraper Kapag Sinusuri ang Trapiko ng Aking Website?

Para mapag-iba ang mga lehitimong search engine crawler mula sa mga hindi awtorisadong AI scraper kapag tinitingnan ang aking trapiko ng website, Masusing sinusuri ko ang mga pattern sa pag-uugali ng gumagamit na maaaring magmungkahi ng mga awtomatikong pakikipag-ugnayan. Upang maiwasan ang mga potensyal na mapaminsalang trapiko, gumagamit ako ng mga pamamaraan sa pagharang ng IP. Ginagamit ko rin ang mga tool sa pag-detect ng bot, na tumutulong sa akin sa pagtukoy at pagkontrol sa mga hindi naaprubahang bot. Ang mga hakbang na ito ay nakakatulong sa akin na pangalagaan ang aking nilalaman habang tinitiyak na ang aking site ay nananatiling naa-access ng mga kagalang-galang. mga search engine.

Ang pag-unawa sa pagkakaiba ng tunay at artipisyal na trapiko ay nagsisiguro na ang aking website analytics ay mananatiling tumpak at ang aking nilalaman ay hindi mahuhulog sa maling mga kamay. Bilang isang may-ari ng website, responsibilidad kong panatilihing ligtas ang aking digital na ari-arian, tulad ng pagprotekta sa isang pisikal na tindahan mula sa mga magnanakaw sa tindahan. Gamit ang mga estratehiyang ito, mapapamahalaan ko nang may kumpiyansa ang trapiko ng aking website at mapapanatili ang integridad nito.

Anong mga Hakbang ang Dapat Kong Gawin Kung Mapapansin Kong Na-scrape Na ang Aking Nilalaman ng isang AI Tool Nang Walang Pahintulot Ko?

Kapag natuklasan kong ginamit ang aking nilalaman ng isang AI tool nang walang pahintulot ko, ang unang hakbang ay maingat na itala ang bawat pagkakataon ng paglabag na ito. Susunod, susubukan kong bawiin ang aking nilalaman sa pamamagitan ng pakikipag-ugnayan sa partidong responsable, o kung kinakailangan, sa pamamagitan ng pag-isyu ng mga kahilingan sa pagtanggal gamit ang DMCA. Kung ang mga hakbang na ito ay hindi malutas ang isyu, ang pagsasaalang-alang sa legal na paraan ay isang opsyon. Bukod pa rito, kapaki-pakinabang na ipaalam sa publiko ang tungkol sa hindi awtorisadong paggamit ng aking trabaho, na nagtataguyod ng etikal na paggamit ng mga AI tool. Ang pagbabantay at agarang aksyon ay susi sa pagbabantay sa mga karapatan sa paglikha ng isang tao online.

Tandaan: Ang pagprotekta sa iyong malikhaing gawain ay hindi lamang isang karapatan; ito ay isang responsibilidad.

Mayroon bang Anumang Pamantayan ng Industriya o Pinakamahuhusay na Kasanayan para sa Paglalagay ng Watermark sa Aking Nilalaman na Nagpapakita na Hindi Ito Dapat Gamitin para sa Pagsasanay ng mga Modelo ng AI?

Kasalukuyan kong sinusuri ang mga pamamaraan para protektahan ang aking nilalaman mula sa hindi awtorisadong paggamit sa pagsasanay ng mga modelo ng AI. Ang isang paraan ay ang paggamit ng digital watermarking at content fingerprinting, na naglalagay ng mga hindi nakikitang marker o natatanging mga code sa aking trabaho. Kapag isinama sa mga tahasang patakaran tungkol sa paggamit, ang mga estratehiyang ito ay nagsisilbing senyales na ang aking mga materyales ay hindi dapat gamitin para sa pagsasanay ng mga modelo ng AI. Ang komunidad ay patuloy pa ring nagsusumikap patungo sa isang karaniwang hanay ng mga alituntunin sa bagay na ito, kaya nananatili akong may alam tungkol sa mga pinakabagong estratehiya upang matiyak na ang aking trabaho ay maayos na nababantayan.

“"Ang pagprotekta sa intelektwal na ari-arian sa panahon kung saan ang data ay patuloy na ipinapasok sa mga algorithm ay isang pinagkakaabalahan ng mga tagalikha. Makabubuting maging maagap at may kaalaman."”

Kung sakaling magkaroon ng kakayahan ang mga AI tool na malampasan ang CAPTCHA, kakailanganin kong gumamit ng mas sopistikadong mga estratehiya sa seguridad upang pangalagaan ang aking website mula sa hindi awtorisadong pagkuha ng datos. Ang isang epektibong paraan ay Mga Biometric sa Pag-uugali, na nagmomonitor ng mga iregularidad sa kung paano nakikipag-ugnayan ang mga user sa site. Makakatulong ito na makilala ang pagkakaiba sa pagitan ng mga taong bisita at mga potensyal na awtomatikong scraper.

Ang isa pang patong ng proteksyon ay kinabibilangan ng Pagsusuri ng Fingerprint. Sinusuri ng pamamaraang ito ang mga natatanging katangian ng isang device at ng browser nito, tulad ng operating system, resolution ng screen, at mga naka-install na font, upang matukoy ang mga hindi pagkakapare-pareho na tipikal ng aktibidad ng bot.

Para manatiling isang hakbang sa unahan, gagawin ko ang aking makakaya Mga Hamon sa Pag-aangkop. Ito ay mga pagsusuri sa seguridad na maaaring mag-iba ang pagiging kumplikado batay sa tinasang panganib, na tinitiyak ang isang dynamic na depensa na umaangkop sa antas ng banta na natukoy. Sa pamamagitan ng paggamit ng mga advanced na pamamaraang ito, mapapatibay ko nang malaki ang seguridad ng aking website laban sa mga pinakabagong tool sa pag-scrape na pinapagana ng AI.

Ano ang proteksyon laban sa AI scraping sa konteksto ng World Wide Web?

Ang proteksyon sa pag-scrape ng AI ay tumutukoy sa mga pamamaraan at teknolohiyang ginagamit upang maiwasan ang mga awtomatikong bot sa pagkuha o pag-scrape ng data mula sa mga website nang walang pahintulot. Ginagamit ng mga teknolohiyang ito ang mga kakayahan ng artificial intelligence upang matukoy, matukoy, at harangan ang mga naturang aktibidad.

Bakit banta sa intelektwal na ari-arian sa internet ang mga AI scraper?

Nagdudulot ng banta ang mga AI scraper dahil mabilis at mahusay nilang nakakakolekta ng malalaking halaga ng impormasyong pagmamay-ari na inilalathala sa web. Maaaring kabilang sa datos na ito ang nilalamang may copyright, mga lihim sa kalakalan, mga database o iba pang mga digital asset na nilayong gamitin lamang sa website ng pinagmulan.

Paano gumagana ang isang AI scraper?

Gumagana ang isang AI scraper sa pamamagitan ng paggaya sa gawi ng tao sa pag-browse. Binibisita nito ang mga web page, tinutukoy ang mga kaugnay na impormasyon batay sa mga paunang natukoy na pamantayan, pagkatapos ay kinukuha ang datos na ito para magamit sa ibang lugar. Ang pagiging sopistikado ng mga tool na ito ay lubhang nag-iiba-iba; ang ilan ay may kakayahang mag-navigate sa mga kumplikadong istruktura ng site at umiwas sa mga pangunahing hakbang laban sa pag-scrape.

Anong mga pamamaraan ang karaniwang ginagamit sa proteksyon laban sa AI scraping?

Ang mga pamamaraang kadalasang ginagamit sa proteksyon ng AI scraping ay kinabibilangan ng paglilimita sa rate (paghihigpit kung gaano karaming mga kahilingan ang maaaring gawin ng isang IP address sa loob ng isang partikular na tagal ng panahon), mga pagsubok sa CAPTCHA (na humahamon sa mga user na patunayan na sila ay tao), pagsusuri ng user agent (upang matukoy ang kahina-hinalang aktibidad ng browser), at mas advanced na mga algorithm ng machine learning na maaaring makakita ng mga hindi pangkaraniwang pattern na nagpapahiwatig ng pag-uugali ng bot.

Maaari bang gamitin ang Artificial Intelligence sa pagprotekta laban sa mga aktibidad ng web scraping?

Oo, maaaring gamitin ang iba't ibang anyo ng artificial intelligence tulad ng mga algorithm ng machine learning para sa pagtuklas at pagpigil sa web scraping. Natututo ang mga sistemang ito mula sa mga nakaraang pagkakataon ng pag-uugali ng bot, na nagbibigay-daan sa kanila na mas mahusay na mahulaan at mapigilan ang mga potensyal na pag-atake sa hinaharap. Maaari rin silang magpatupad ng mga real-time na pamamaraan ng pagtuklas na nagbibigay-daan sa agarang aksyon kapag may pinaghihinalaang aktibidad ng bot.

Ang aking mga huling saloobin sa pagprotekta sa iyong website mula sa pagkalat ng mga AI tool

Ang pagpapanatiling ligtas ng aking website mula sa mga hindi gustong AI scraping ay isang patuloy na pagsisikap na nangangailangan ng pagsisikap. Natuklasan ko na ang matalinong paggamit ng robots.txt, pagpapatupad ng CAPTCHA, pagharang sa mga kinikilalang AI scraper, pamamahala ng access sa nilalaman, at patuloy na pag-update ng aking mga hakbang sa seguridad ay mahahalagang hakbang. Bagama't ang pagdaragdag ng mga legal na hakbang ay nag-aalok ng karagdagang proteksyon, ang pananatiling alerto at mahusay sa teknikal na aspeto ay susi upang matiyak na ang aking nilalaman ay mananatili sa loob ng aking saklaw, sa gayon ay napapanatili ang integridad ng aking website at ang halagang iniaalok nito sa mga bumibisita dito.

Mga Awtoridad na Sanggunian

Kung gusto mong magbasa pa tungkol sa pagprotekta sa iyong mga website mula sa mga AI Crawler, irerekomenda kong basahin mo ang sumusunod na post:

- ITPro – AI web scraping: Paano protektahan ang iyong negosyo mula sa

- Tinatalakay ng artikulong ito ang mga komplikasyon ng AI web scraping at ang mga kaugnay na panganib. Nagbibigay ito ng mga pananaw kung paano makakalap ng datos ang AI nang mas mabilis at sopistikado, at sinusuri ito upang makabuo ng mga output.

- Artikulo ng ITPro

- Ang Authors Guild – Mga Praktikal na Tip para sa mga Awtor upang Protektahan ang Kanilang mga Akda mula sa Paggamit ng AI

- Ang mapagkukunang ito ay nag-aalok ng praktikal na payo para sa mga may-akda at may-ari ng website kung paano protektahan ang kanilang mga gawa mula sa paggamit ng AI, kabilang ang paggamit ng robots.txt file upang harangan ang mga AI web crawler tulad ng GPTBot ng OpenAI.

- Mga Tip sa Authors Guild

- Resolution Digital – Protektahan ang Website mula sa Nilalaman ng AI Pag-scrape

- Ang artikulong ito ay nagbibigay ng mga simpleng hakbang upang protektahan ang iyong website mula sa pag-scrape at hindi awtorisadong paggamit ng mga AI tool tulad ng ChatGPT. Tinatalakay nito ang paggamit ng mga robots.txt file, pagpapatupad ng CAPTCHA, at mga IP range block.

- Gabay sa Digital na Resolusyon

- Octoparse – Pag-scrape ng Web para sa Proteksyon ng Brand at Cybersecurity

- Ito blog Tinatalakay ng post kung paano magagamit ang web scraping para sa proteksyon ng brand at cybersecurity. Tinatalakay din nito ang paggamit ng mga web scraping tool upang mahanap ang mga potensyal na paglabag at paglabag sa copyright.

- Artikulo ng Octoparse

- ScienceDirect – Ang digmaan laban sa AI web scraping

- Tinatalakay ng artikulong ito mula sa ScienceDirect ang lumalaking pagtutol sa AI web scraping, na itinatampok ang mabilis na pag-unlad sa AI at ang pagsasanay nito sa malawak na hanay ng datos ng teksto at iba pang digital na nilalaman.

- Artikulo sa ScienceDirect