Dengar ringkasan catatan:

My website resembles a well-tended garden, with original content that flourishes with each visitor. However, with the advancement of AI tools skilled in extracting data from websites, I’ve recognized the need to bolster my site’s defenses to block these unwanted extractions. Through my experience, I’ve gathered strategi untuk melindungi laman web anda daripada pengikisan AI dengan berkesan. Let’s go through some steps to protect your site. I’ll guide you on implementing robots.txt directives, setting up CAPTCHA challenges, and additional methods to ensure your content remains exclusively on your domain. It’s all about maintaining the sanctity of your online realm, making sure it’s the human visitors who reap the benefits of your hard work.

Dalam semangat untuk memastikan keselamatan tempat perlindungan digital anda, ingatlah, “Pintu pagar yang kukuh memastikan hanya tetamu yang dialu-alukan dapat menghargai taman di dalamnya.”

Kesimpulan Utama

Protecting my website from AI scrapers is a continuous battle that demands attention and proactive strategies. I’ve found that effectively configuring my robots.txt file, setting up CAPTCHA, identifying and blocking known AI scraper alat, controlling who can access my content, and frequently updating security protocols are crucial strategies. Adding legal protections provides another defense layer, but staying vigilant and technically sharp is the best way to keep my content secure and uphold my site’s value for visitors.

Remember to keep your website’s defenses up to date, as methods for data scraping are constantly advancing. Regularly review your security settings and be ready to adapt to new challenges to keep your content safe.

Memahami Pengikisan Web AI

As we approach the topic of AI web scraping, it’s crucial to recognize the ethical implications of this practice. I’ll evaluate the potential risks and benefits, ensuring that we establish a framework for ethical conduct in AI data collection. After that, I’ll explore the technical countermeasures available to website owners seeking to protect their content from unauthorized AI scraping.

As we approach the topic of AI web scraping, it’s crucial to recognize the ethical implications of this practice. I’ll evaluate the potential risks and benefits, ensuring that we establish a framework for ethical conduct in AI data collection. After that, I’ll explore the technical countermeasures available to website owners seeking to protect their content from unauthorized AI scraping.

Mengikis Kebimbangan Etika

Memahami Dimensi Etika AI Pengikisan Kandungan

Why should you be concerned about the ethical aspects of AI tools extracting content from your website? When examining this topic, it’s vital to look at the complexity of data privacy. Unregulated AI scraping can lead to the unauthorized collection of proprietary information, which might infringe on the intellectual property of those who create content. It’s also important to comply with laws that control how data is gathered and used. These laws aim to shield individuals and companies from privacy breaches and the misuse of their information. Being up to date with these regulations is necessary to keep your website content safe and to ensure your practices are ethically sound as technology advances.

Langkah-langkah Penanggulangan untuk Mengikis

Untuk mengelakkan sistem automatik daripada mengumpul data daripada laman web saya, saya membuat pelarasan rutin pada fail robots.txt. Amalan teliti ini membolehkan saya menentukan bahagian laman web saya yang boleh diakses oleh bot seperti GPTBot. Dengan mengemas kini arahan ini secara berterusan, saya melindungi kandungan laman web saya daripada pengekstrakan tanpa kebenaran oleh alatan automatik.

In doing so, I’m not just following a technical routine; I’m taking a stand to safeguard the value and privacy of the information I’ve worked hard to create. As webmasters, we must be vigilant and proactive to secure our digital properties users trust-essential off-limits path.

Ingat, fail robots.txt yang diselenggara dengan baik ialah lapisan pertahanan yang mudah tetapi berkesan terhadap percubaan pengikis data yang tidak henti-henti.

Kemas kini Robots.txt Secara Berkala

Maintaining the security of your website’s content means regularly reviewing and updating your robots.txt file. This is how I do it effectively:

- Tetapkan jadual tetap untuk kemas kini.

- Gunakan kaedah terbaik untuk menentukan bahagian ejen pengguna tapak anda (seperti perayap web) yang boleh diakses.

- Pantau perkembangan terkini dalam alat pengikis AI untuk mendahului potensi risiko keselamatan.

- Buat pelarasan yang perlu pada laluan yang dilarang bagi memastikan kandungan anda kekal dilindungi daripada akses tanpa kebenaran.

Mengapa Perlu Mengemas Kini Robots.txt Anda?

Mengemas kini fail robots.txt anda adalah cara yang mudah tetapi berkesan untuk melindungi laman web anda. Ia memberitahu enjin carian dan perayap web lain halaman atau bahagian mana di laman web anda yang tidak boleh diakses atau diindeks. This can help prevent unwanted scraping and can be part of a larger strategy to protect your site’s content.

Remember, as new types of web crawlers emerge, staying vigilant and adapting your robots.txt file is a smart move. A well-maintained robots.txt file is critical to your website’s overall security strategy.

Menggunakan Robots.txt Dengan Berkesan

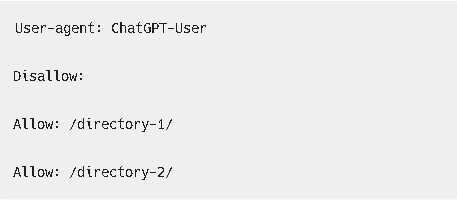

To protect your website from unwanted automated data collection, let’s discuss how to update the robots.txt file carefully. You can instruct certain web crawlers, such as OpenAI’s GPTBot, to either access or bypass your site content by creating specific user-agent rules. By setting up these parameters with attention to detail, you gain precise control over which parts of your site can be indexed or ignored by different AI systems.

To protect your website from unwanted automated data collection, let’s discuss how to update the robots.txt file carefully. You can instruct certain web crawlers, such as OpenAI’s GPTBot, to either access or bypass your site content by creating specific user-agent rules. By setting up these parameters with attention to detail, you gain precise control over which parts of your site can be indexed or ignored by different AI systems.

Edit Robots.Txt dengan Betul

To safeguard your website from unwanted AI-powered scraping, it’s vital to manage your robots.txt file with care. This step is fundamental in keeping your website’s data private and complying with data gathering laws. Here’s my guide to do it effectively:

- Cari Fail: First, I logged into my website’s server and searched for the robots.txt file that was already there.

- Semak Peraturan SemasaSeterusnya, saya melihat fail tersebut dengan teliti untuk memahami sepenuhnya peraturan sedia ada dan maksudnya untuk laman web saya.

- Kemas kini dengan Berhati-hati: With attention to detail, I adjust or insert new rules to specify what AI systems can and can’t do, using ‘Disallow:’ to block and ‘Allow:’ to give access.

- Sahkan Pengeditan: Once I’ve made changes, I run the updated robots.txt through testers to ensure the rules are correctly written and functioning as intended.

Dengan melaksanakan langkah-langkah ini dengan teliti, saya mengemas kini fail robots.txt saya untuk memastikan laman web saya selamat di samping masih mengalu-alukan enjin carian yang membantu orang ramai mencari kandungan saya.

Melaksanakan Pengesahan CAPTCHA

Mengalih perhatian kita kepada pengesahan CAPTCHA, kaedah ini berfungsi sebagai penghalang kukuh terhadap penuaian data automatik yang tidak dibenarkan. Ia beroperasi dengan membezakan aktiviti manusia yang sebenar daripada aktiviti manusia biasa. perisian automatik, effectively blocking unwanted bots while permitting real users access. Nonetheless, when incorporating CAPTCHA, it’s vital to consider its potential effects on user interaction. Striking the right balance is key to ensuring that your website remains user-friendly.

Keberkesanan CAPTCHA

Menggabungkan semakan CAPTCHA merupakan strategi yang kukuh untuk melindungi laman web saya daripada pengikisan kandungan by automated tools. Here’s my perspective on why it’s an effective measure:

- Cabaran Kompleks: Canggih CAPTCHA menimbulkan teka-teki rumit yang sukar untuk diautomatikkan sistem tetapi masih boleh diurus oleh orang ramai.

- Kemas Kini Berterusan: Dengan kerap menyegarkan algoritma CAPTCHA, ia boleh mengatasi perkembangan AI yang sebaliknya boleh mengelak sistem yang tidak berubah.

- Keselamatan BerlapisApabila CAPTCHA digunakan bersama langkah keselamatan yang lain, ia mewujudkan penghalang yang diperkukuh terhadap akses tanpa kebenaran.

- Kewaspadaan: Monitoring CAPTCHA’s performance and success rate can signal when it’s time to make adjustments or improvements.

Walaupun penambahan CAPTCHA memang meningkatkan keselamatan, saya sentiasa mempertimbangkan aspek etika dan bertujuan untuk memastikan impak terhadap pengguna serendah mungkin. Mencari keseimbangan yang tepat antara keselamatan yang mantap dan kebolehcapaian pengguna adalah tugas yang teliti dan berterusan.

Impak Pengalaman Pengguna

While putting CAPTCHA checks in place, I’m well aware that they can sometimes irritate users, even if they’re good at stopping bots that scrape content using AI. My assessment shows that CAPTCHAs are effective at keeping these bots at bay, which helps manage the flow of website visitors and lowers the chances of content being copied without permission. Nevertheless, it’s vital to use this tool wisely to prevent driving away the people who visit your site. It’s all about finding the right balance between making your content easy to get to and protecting it against unwanted AI scraping. Too many CAPTCHA tests can push away just as many real users as bots. I use CAPTCHAs in areas where scraping is most likely to happen while keeping the rest of the site user-friendly. My goal is to offer a great experience for site visitors while also keeping the site’s content secure from any unauthorized scraping by AI.

Menyekat Perayap AI Tertentu

As someone who runs a website, I have the ability to block certain AI crawlers, like OpenAI’s GPTBot, to stop them from copying content from my site. This step is not just about stopping unauthorized collection of my content, but it’s also about respecting ethical standards and legal rules regarding content use. Here’s how I approach it:

- Ubah suai

robots.txt: I adjust this file with specific instructions for AI crawlers outlining what parts of my site they’re barred from.

Ejen pengguna: GPTBot

Tidak Benarkan: /

Ejen-pengguna: Pengguna-ChatGPT

Tidak Benarkan: /

Ejen pengguna: CCBot

Tidak Benarkan: /

- Semak Log Pelayan: I make it part of my routine to go through my server’s logs to spot any AI crawler activity that seems out of place.

- Sediakan CAPTCHADi bahagian laman web saya yang pengguna berinteraksi, saya menggunakan CAPTCHA. Ujian ini sangat bagus untuk membezakan orang sebenar daripada bot automatik.

- Sekat Alamat IP TertentuApabila perlu, saya menyekat alamat IP yang saya tahu terikat pada perayap AI untuk menjauhkannya daripada tapak saya.

By doing these things, I protect my content and make sure I’m following the rules related to data privacy and intellectual property.

Mengurus Kebolehcapaian Kandungan

Melindungi Kandungan Laman Web Anda daripada Pengikisan Tanpa Kebenaran

To address the concerns of content scraping, let’s discuss effective methods for controlling who can access your website’s content. It’s vital to restrict bot entry, and I’ll outline specific techniques to prevent these automated systems from copying or indexing your site materials. This will involve technical changes and careful setting of access control measures.

Melindungi Kandungan Laman Web Anda

For those who manage a website, ensuring that your content remains exclusive and protected from automatic scraping systems is a key concern. Implementing specific technical measures can help you control who has the ability to access and index your website’s content.

Anda mungkin boleh mempertimbangkan untuk melaraskan robots.txt anda fail untuk mengarahkan enjin carian bot bahagian mana di laman web anda yang tidak boleh diakses. Menggunakan sistem CAPTCHA juga boleh menghalang bot tanpa menghalang pengguna manusia. Untuk pendekatan yang lebih canggih, anda mungkin melaksanakan semakan bahagian pelayan untuk membezakan antara pelawat yang sah dan pengikis yang berpotensi.

Ingat, integriti dan eksklusiviti kandungan anda adalah yang paling penting. Dengan mengambil langkah proaktif untuk mengamankan laman web anda, anda mengekalkan kawalan ke atas kandungan dan pengedarannya. Lagipun, kandungan yang anda cipta adalah cerminan jenama anda dan harus dijaga dengan teliti.

Mengehadkan Akses Bot

Mengehadkan Akses Bot

I’ve discovered that taking specific steps can greatly lower the risk of automated systems harvesting content from my site. Here’s how I approach it:

- Melaraskan Robots.txt: Saya memperhalusi

robots.txtfail untuk mengawal akses bot, dengan mengambil kira aspek undang-undang pengikisan dan kebimbangan privasi data. - Melaksanakan Had KadarDengan memperkenalkan had kadar pada pelayan saya, saya dapat membendung potensi kesan gangguan trafik bot.

- Menggunakan Kawalan APISaya berkongsi maklumat sesedikit yang diperlukan melalui API dan memerlukan pengesahan yang betul untuk menyekat kemasukan.

- Menggunakan Rangkaian Penghantaran KandunganMenggunakan CDN yang didatangkan dengan keupayaan pengurusan bot membolehkan saya mengurus siapa yang mengakses kandungan saya dan melindunginya dengan berkesan.

Mengambil langkah-langkah ini membentuk barisan pertahanan yang kukuh terhadap penuaian kandungan tanpa kebenaran oleh alatan automatik.

Pencegahan Pengikisan Kandungan

Selepas mengemas kini saya robots.txt file, I’m now focusing on measures to prevent content scraping, ensuring my website remains accessible yet secure. I’m examining the technical aspects of scraping, its legal consequences, and the importance of protecting user data from sophisticated AI scraping methods.

| Strategi | Penerangan |

|---|---|

| Penghantaran Kandungan Berubah-ubah | Sediakan kandungan yang berbeza kepada alatan automatik berbanding pelawat manusia. |

| Pemantauan Aktiviti Pengguna | Periksa tingkah laku yang mungkin menunjukkan pengikisan. |

| Sekatan Akses | Kawal kekerapan pengguna boleh mengakses kandungan dan sekat alamat IP yang mencurigakan. |

By carefully putting these strategies into place, I’m not just protecting my website’s content, but I’m also keeping user information private and secure. This is a deliberate plan to manage my website’s content and to deter unauthorized access or misuse by automated tools.

Incorporating these strategies is a smart way to keep ahead of those who might attempt to misuse your hard work. It’s like setting up a sophisticated alarm system that not only keeps an eye out for intruders but also respects the privacy of your guests. It’s about being proactive rather than reactive in the face of potential threats.

Mengemas kini Langkah Keselamatan Secara Berkala

Setting up initial defenses like tweaking your robots.txt or adding CAPTCHA is a great start, but to effectively guard against advanced AI tools that scrape content, it’s vital to continuously refresh your website’s security strategies. The tech environment is in a state of constant flux, with AI capabilities becoming more sophisticated and occasionally slipping past older security methods. Therefore, maintaining your website’s security requires a strategic, tech-savvy, and systematic approach.

Here’s my strategy:

- Semakan Keselamatan RutinSaya sentiasa menjalankan pemeriksaan keselamatan secara berkala bagi mengenal pasti sebarang kelemahan yang muncul, bagi memastikan langkah perlindungan saya adalah terkini dan berkesan.

- Kekal Mengikuti Kemas KiniSaya sentiasa mengikuti perkembangan tampalan keselamatan terkini dan memastikan semua elemen perisian laman web saya adalah terkini.

- Menyesuaikan Langkah-langkah Keselamatan: I adjust my security settings to tackle specific threats, which helps keep a healthy balance between protecting content and ensuring it’s accessible for the right reasons.

- Analisis dan Pelaporan Trafik: By keeping an eye on how traffic flows to my site and scrutinizing the access logs, I’m able to quickly identify and act upon suspicious behavior that might indicate an attempt at AI scraping.

Securing my website is not a set-it-and-forget-it affair; it’s a continuous challenge to fend off those with ill intentions. By remaining alert and proactive about security, I’m safeguarding not just my site’s content but also the privacy of those who visit.

Meneroka Perlindungan Undang-undang

Navigating legal complexities, I’m examining copyright laws and regulations against unauthorized AI scraping to protect my website. It’s essential to take a systematic approach to understand how national and international copyright laws affect the material on my site. I have also reviewed the Digital Millennium Copyright Act (DMCA) to see how it can defend my content from AI-driven infringements.

Assessing the terms of use for AI tools is a responsible step to ensure they don’t overreach in their rights to use and gather data from websites. This attention to detail is key to preserving my site’s user experience and preventing the misuse of my content, which could diminish my brand’s impact and reduce visitor engagement.

Additionally, I’m considering technical strategies like implementing strict access controls and constant traffic analysis to identify and mitigate scraping attempts. A combination of legal measures and technical safeguards is my plan to maintain my website’s distinctiveness and protect the creative effort behind it.

Soalan Lazim

If I Block AI Tools From Scraping My Website, Will It Affect My Site’s Visibility or Ranking on Other Search Engines Like Google or Bing?

I’m considering whether preventing AI tools from scraping my website might change how well my site performs on enjin carian seperti Google or Bing. It’s important to clear up any confusion about online visibility; these enjin carian menggunakan algoritma unik untuk kedudukan. They don’t depend exclusively on the indexing by AI tools. My aim is to keep my content protected and still retain a good position in hasil carian. Dalam praktiknya, ini bermakna mencari keseimbangan yang teliti antara melindungi diri saya website’s content and achieving solid SEO keputusan.

How Can I Differentiate Between Legitimate Search Engine Crawlers and AI Scrapers When Analyzing My Website’s Traffic?

Untuk membezakan perayap enjin carian yang sah daripada pengikis AI yang tidak dibenarkan apabila melihat saya website’s traffic, saya meneliti corak tingkah laku pengguna dengan teliti yang mungkin mencadangkan interaksi automatik. Untuk mengelakkan trafik yang berpotensi berbahaya, saya menggunakan teknik penyekatan IP. Saya juga memanfaatkan alat pengesanan bot, yang membantu saya mengenal pasti dan mengawal bot yang tidak diluluskan. Langkah-langkah ini membantu saya melindungi kandungan saya sambil memastikan laman web saya kekal boleh diakses oleh orang yang bereputasi. enjin carian.

Understanding the difference between genuine and artificial traffic ensures that my website analytics remain accurate and that my content doesn’t fall into the wrong hands. As a website owner, it’s my responsibility to keep my digital property secure, just as one would protect a physical store from shoplifters. With these strategies in place, I can confidently manage my website’s traffic and maintain its integrity.

Apakah Langkah-langkah yang Perlu Saya Ambil Jika Saya Perhatikan Bahawa Kandungan Saya Telah Dikikis oleh Alat AI Tanpa Kebenaran Saya?

Upon discovering that my content has been used by an AI tool without my consent, the first step is to meticulously record every instance of this violation. Next, I would attempt to reclaim my content by contacting the party responsible, or if needed, by issuing DMCA takedown requests. Should these measures fail to resolve the issue, considering legal recourse is an option. Additionally, it’s beneficial to inform the public about the unauthorized use of my work, promoting the ethical usage of AI tools. Vigilance and immediate action are key in safeguarding one’s creative rights online.

Remember: Protecting your creative work is not just a right; it’s a responsibility.

Are There Any Industry Standards or Best Practices for Watermarking My Content to Indicate That It Shouldn’t Be Used for TrAIning AI Models?

I’m currently reviewing methods for protecting my content from unauthorized use in training AI models. One approach is to use digital watermarking and content fingerprinting, which insert invisible markers or distinctive codes into my work. When combined with explicit policies regarding use, these strategies serve as a sign that my materials should not be used for training AI models. The community is still working towards a common set of guidelines on the matter, so I’m staying informed about the latest strategies to ensure my work is properly safeguarded.

“Protecting intellectual property in an age where data is constantly fed into algorithms is a shared concern for creators. It’s wise to be proactive and informed.”

Sekiranya alatan AI membangunkan keupayaan untuk memintas CAPTCHA, saya perlu menggunakan strategi keselamatan yang lebih canggih untuk melindungi laman web saya daripada pengekstrakan data yang tidak dibenarkan. Satu kaedah yang berkesan ialah Biometrik Tingkah Laku, yang memantau penyelewengan dalam cara pengguna berinteraksi dengan laman web ini. Ini dapat membantu membezakan antara pelawat manusia dan pengikis automatik yang berpotensi.

Satu lagi lapisan perlindungan melibatkan Analisis Cap Jari. Teknik ini menilai atribut unik peranti dan pelayarnya, seperti sistem pengendalian, resolusi skrin dan fon yang dipasang, untuk mengenal pasti ketidakkonsistenan yang lazim dalam aktiviti bot.

Untuk kekal selangkah ke hadapan, saya akan bertindak Cabaran Adaptif. These are security checks that can vary in complexity based on the assessed risk, ensuring a dynamic defense that adjusts to the level of threat detected. By employing these advanced methods, I can significantly reinforce my website’s security against the latest AI-powered scraping tools.

Apakah perlindungan pengikisan AI dalam konteks Jaringan Sejagat?

Perlindungan pengikisan AI merujuk kepada kaedah dan teknologi yang digunakan untuk menghalang bot automatik daripada menuai atau mengikis data daripada laman web tanpa kebenaran. Teknologi ini memanfaatkan keupayaan kecerdasan buatan untuk mengesan, mengenal pasti dan menyekat aktiviti tersebut.

Mengapakah pengikis AI merupakan ancaman kepada harta intelek di internet?

Pengikis AI menimbulkan ancaman kerana ia boleh mengumpul sejumlah besar maklumat proprietari yang diterbitkan di web dengan cepat dan cekap. Data ini boleh merangkumi kandungan berhak cipta, rahsia perdagangan, pangkalan data atau aset digital lain yang bertujuan untuk digunakan semata-mata di laman web sumber.

Bagaimanakah pengikis AI berfungsi?

Pengikis AI berfungsi dengan mensimulasikan tingkah laku pelayaran manusia. Ia melawat halaman web, mengenal pasti maklumat yang berkaitan berdasarkan kriteria yang telah ditetapkan, kemudian mengekstrak data ini untuk digunakan di tempat lain. Kecanggihan alat ini sangat berbeza; ada yang mampu menavigasi struktur tapak yang kompleks dan mengelakkan langkah anti-pengikisan asas.

Apakah teknik yang biasa digunakan dalam perlindungan pengikisan AI?

Teknik yang sering digunakan dalam perlindungan pengikisan AI termasuk pengehadan kadar (mengehadkan bilangan permintaan yang boleh dibuat oleh alamat IP dalam tempoh masa tertentu), ujian CAPTCHA (yang mencabar pengguna untuk membuktikan bahawa mereka manusia), analisis ejen pengguna (untuk mengenal pasti aktiviti pelayar yang mencurigakan) dan algoritma pembelajaran mesin yang lebih maju yang dapat mengesan corak luar biasa yang menunjukkan tingkah laku bot.

Bolehkah Kecerdasan Buatan digunakan dalam melindungi daripada aktiviti pengikisan web?

Ya, pelbagai bentuk kecerdasan buatan seperti algoritma pembelajaran mesin boleh digunakan untuk mengesan dan mencegah pengikisan web. Sistem ini belajar daripada contoh tingkah laku bot sebelumnya, membolehkannya menjangka dan menggagalkan serangan masa hadapan yang berpotensi dengan lebih baik. Ia juga boleh melaksanakan teknik pengesanan masa nyata yang membolehkan tindakan segera apabila aktiviti bot disyaki berlaku.

Pemikiran terakhir saya tentang melindungi laman web anda daripada dikikis oleh alat AI

Keeping my website safe from unwanted AI scraping is an ongoing effort that requires diligence. I have found that smart use of robots.txt, implementing CAPTCHA, blocking recognized AI scrapers, managing access to content, and consistently updating my security measures are vital steps. While adding legal measures offers an extra layer of protection, remaining alert and technically adept is key to ensuring my content stays within my purview, thus maintaining my website’s integrity and the value it offers to those who visit it.

Rujukan Berautoriti

Jika anda ingin membaca lebih lanjut tentang melindungi laman web anda daripada AI Crawler, maka saya cadangkan anda melihat siaran berikut:

- ITPro – Pengikisan web AI: Cara melindungi perniagaan anda daripada

- Artikel ini membincangkan kerumitan pengikisan web AI dan risiko yang berkaitan. Ia memberikan pandangan tentang bagaimana AI boleh mengumpul data dengan kelajuan dan kecanggihan yang lebih tinggi, menganalisisnya untuk menghasilkan output.

- Artikel ITPro

- Persatuan Pengarang – Petua Praktikal untuk Pengarang Melindungi Karya Mereka daripada Penggunaan AI

- This resource offers practical advice for authors and website owners on how to protect their works from AI use, including using a robots.txt file to block AI web crawlers like OpenAI’s GPTBot.

- Petua Persatuan Penulis

- Resolusi Digital – Lindungi Laman Web daripada Kandungan AI Mengikis

- Artikel ini menyediakan langkah mudah untuk melindungi laman web anda daripada pengikisan dan penggunaan tanpa kebenaran oleh alatan AI seperti ChatGPT. Ia membincangkan penggunaan fail robots.txt, pelaksanaan CAPTCHA dan blok julat IP.

- Panduan Digital Resolusi

- Octoparse – Pengikisan Web untuk Perlindungan Jenama dan Keselamatan Siber

- Ini blog Catatan ini meneroka bagaimana pengikisan web boleh digunakan untuk perlindungan jenama dan keselamatan siber. Ia membincangkan penggunaan alat pengikisan web untuk mencari potensi pelanggaran dan pelanggaran hak cipta.

- Artikel Octoparse

- ScienceDirect – Perang menentang pengikisan web AI

- Artikel daripada ScienceDirect ini meneroka bantahan yang semakin meningkat terhadap pengikisan web AI, menonjolkan kemajuan pesat dalam AI dan latihannya pada set data teks dan kandungan digital lain yang luas.

- Artikel ScienceDirect