投稿の要約を聞いてください:

私のウェブサイトは、訪問者ごとにオリジナルのコンテンツが豊かになる、手入れの行き届いた庭園のようなものです。しかし、ウェブサイトからデータを抽出するAIツールの進歩に伴い、こうした望ましくないデータ抽出を阻止するために、サイトの防御を強化する必要性を認識しました。これまでの経験から、私は以下のことを学んできました。 AIスクレイピングからウェブサイトを効果的に保護するための戦略. サイトを保護するための手順をいくつか見ていきましょう。robots.txtディレクティブの実装、CAPTCHA認証の設定、そしてコンテンツがあなたのドメイン内に確実に保持されるためのその他の方法についてご案内します。これはすべて、あなたのオンライン領域の尊厳を守り、あなたの努力の成果を人間である訪問者だけが享受できるようにするためです。.

デジタルの安息の地を安全に保つには、「頑丈な門があれば、歓迎された人だけが中の庭園を楽しめる」ということを忘れないでください。“

主な要点

ウェブサイトをAIスクレイパーから守ることは、継続的な努力と積極的な戦略を必要とする戦いです。robots.txtファイルを効果的に設定し、CAPTCHAを設定し、既知のAIスクレイパーを特定してブロックすることが効果的だと分かりました。 ツール, コンテンツへのアクセス権限を管理し、セキュリティプロトコルを頻繁に更新することは、非常に重要な戦略です。法的保護措置を追加することで防御層をさらに強化できますが、常に警戒を怠らず、技術的な知識を最新の状態に保つことが、コンテンツの安全性を維持し、訪問者にとってサイトの価値を高める最善の方法です。.

データスクレイピングの手法は常に進化しているため、ウェブサイトのセキュリティ対策を常に最新の状態に保つことを忘れないでください。セキュリティ設定を定期的に見直し、新たな脅威に対応できるよう準備して、コンテンツを安全に保ちましょう。.

AIウェブスクレイピングを理解する

AIによるウェブスクレイピングというテーマに取り組むにあたり、この手法の倫理的な意味合いを認識することが不可欠です。潜在的なリスクとメリットを評価し、AIデータ収集における倫理的な行動規範を確立します。その後、ウェブサイト所有者がコンテンツを不正なAIスクレイピングから保護するために利用できる技術的な対策について検討します。.

AIによるウェブスクレイピングというテーマに取り組むにあたり、この手法の倫理的な意味合いを認識することが不可欠です。潜在的なリスクとメリットを評価し、AIデータ収集における倫理的な行動規範を確立します。その後、ウェブサイト所有者がコンテンツを不正なAIスクレイピングから保護するために利用できる技術的な対策について検討します。.

倫理的な懸念を払拭する

AIの倫理的側面を理解する コンテンツ・スクレイピング

ウェブサイトからコンテンツを抽出するAIツールの倫理的側面について、なぜ懸念する必要があるのでしょうか?この問題を検討する際には、データプライバシーの複雑さを理解することが不可欠です。規制されていないAIによるスクレイピングは、コンテンツ作成者の知的財産権を侵害する可能性のある、無断での専有情報の収集につながる可能性があります。また、データの収集方法と使用方法を規制する法律を遵守することも重要です。これらの法律は、個人や企業をプライバシー侵害や情報の悪用から守ることを目的としています。ウェブサイトのコンテンツを安全に保ち、技術の進歩に伴って倫理的に健全な運用を確保するためには、これらの規制を常に最新の状態に保つことが不可欠です。.

スクレイピング対策

自動システムによるウェブサイトからのデータ収集を防ぐため、robots.txtファイルを定期的に変更しています。この綿密な作業により、GPTBotのようなボットがウェブサイトのどの部分にアクセスできるかを定義できます。これらの指示を継続的に更新することで、自動ツールによる不正な抽出からウェブサイトのコンテンツを保護しています。.

そうすることで、私は単に技術的な手順を踏んでいるのではなく、苦労して作り上げた情報の価値とプライバシーを守るために立ち上がっているのです。ウェブマスターとして、私たちはユーザーが信頼するデジタル資産を保護するために、警戒心を持ち、積極的に行動しなければなりません。これは、アクセスを遮断する上で不可欠な要素です。.

覚えておいてください。適切に管理された robots.txt ファイルは、データ スクレーパーの執拗な攻撃に対するシンプルでありながら効果的な防御層です。.

Robots.txtを定期的に更新する

ウェブサイトのコンテンツのセキュリティを維持するには、robots.txtファイルを定期的に確認し、更新する必要があります。私が効果的に行っている方法をご紹介します。

- 定期的な更新スケジュールを設定します。.

- サイトのどの部分に対してユーザーエージェント (Web クローラーなど) がアクセスできるかを指定するための最適な方法を適用します。.

- 潜在的なセキュリティ リスクに先手を打つために、AI スクレイピング ツールの最新の開発動向に注目してください。.

- コンテンツが不正アクセスから保護された状態を維持するために、立ち入り禁止のパスに必要な調整を加えます。.

Robots.txt を更新する理由は何ですか?

robots.txtファイルを更新することは、ウェブサイトを保護するためのシンプルかつ強力な方法です。検索エンジンやその他のウェブクローラーに、サイトのどのページやセクションにアクセスすべきでないかを伝えます。 インデックス付き. これは、不正なスクレイピングを防ぐのに役立ち、サイトのコンテンツを保護するためのより包括的な戦略の一部となり得ます。.

新しいタイプのウェブクローラーが出現するにつれ、警戒を怠らず、robots.txtファイルを適宜更新していくことが賢明な策となります。適切に管理されたrobots.txtファイルは、ウェブサイト全体のセキュリティ戦略において非常に重要です。.

Robots.txtを効果的に活用する

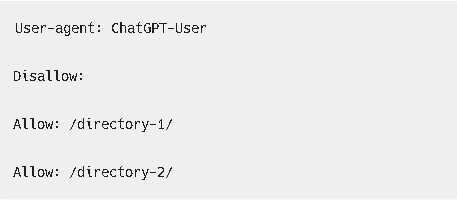

ウェブサイトを不要な自動データ収集から保護するために、robots.txt ファイルの適切な更新方法について説明しましょう。OpenAI の GPTBot などの特定のウェブクローラーに対して、ユーザーエージェントルールを作成することで、サイトコンテンツへのアクセスを許可したり、スキップしたりすることができます。これらのパラメータを細部まで注意深く設定することで、さまざまな AI システムによってサイトのどの部分がインデックス化され、どの部分が無視されるかを正確に制御できます。.

ウェブサイトを不要な自動データ収集から保護するために、robots.txt ファイルの適切な更新方法について説明しましょう。OpenAI の GPTBot などの特定のウェブクローラーに対して、ユーザーエージェントルールを作成することで、サイトコンテンツへのアクセスを許可したり、スキップしたりすることができます。これらのパラメータを細部まで注意深く設定することで、さまざまな AI システムによってサイトのどの部分がインデックス化され、どの部分が無視されるかを正確に制御できます。.

Robots.Txtを正しく編集する

不要なAIによるスクレイピングからウェブサイトを保護するには、robots.txtファイルを慎重に管理することが不可欠です。この手順は、ウェブサイトのデータをプライベートに保ち、データ収集に関する法律を遵守する上で非常に重要です。効果的な設定方法については、以下のガイドをご覧ください。

- ファイルを見つけるまず、自分のウェブサイトのサーバーにログインし、既に存在していたrobots.txtファイルを探しました。.

- 現在のルールを確認する次に、ファイルを詳しく調べて、既存のルールとそれが自分のサイトにとって何を意味するのかを完全に把握します。.

- 注意深く更新する: 細部に注意を払いながら、AI システムができることとできないことを指定するルールを調整したり、新しいルールを追加したりします。「Disallow:」を使用してブロックし、「Allow:」を使用してアクセスを許可します。.

- 編集内容を確認する変更を加えた後は、更新されたrobots.txtをテスターに実行して、ルールが正しく記述され、意図どおりに機能していることを確認します。.

これらの手順を慎重に実行することで、robots.txtファイルを更新し、サイトを安全に保ちながら、ユーザーを歓迎します。 検索エンジン 人々が私のコンテンツを見つけるのに役立ちます。.

CAPTCHA認証の実装

CAPTCHA認証に目を向けると、この方法は不正な自動データ収集に対する強固な障壁として機能する。これは、人間の真正な行動と、意図しない行動を区別することで機能する。 自動化ソフトウェア, CAPTCHAは、不要なボットを効果的にブロックしつつ、実際のユーザーのアクセスを許可します。しかしながら、CAPTCHAを導入する際には、ユーザーインタラクションへの潜在的な影響を考慮することが不可欠です。ウェブサイトの使いやすさを維持するには、適切なバランスを取ることが重要です。.

CAPTCHAの有効性

CAPTCHAチェックを組み込むことは、不正アクセスからウェブサイトを保護するための確実な戦略です。 コンテンツスクレイピング 自動化ツールによって。これが効果的な対策である理由について、私の見解を述べます。

- 複雑な課題: 洗練された CAPTCHAは複雑なパズルを解読するため、自動化には困難である。 システムですが、人間が管理できるレベルです。.

- 継続的なアップデート: CAPTCHA アルゴリズムを頻繁に更新することで、変化しないシステムを回避できる AI の進歩を先取りすることができます。.

- 階層化セキュリティCAPTCHA を他のセキュリティ対策と併用すると、不正アクセスに対する強化された障壁が形成されます。.

- 警戒: CAPTCHAのパフォーマンスと成功率を監視することで、調整や改善を行うべき時期を把握できます。.

CAPTCHAの追加は確かにセキュリティを強化しますが、私は常に倫理的な側面を考慮し、ユーザーへの影響を可能な限り最小限に抑えることを目指しています。堅牢なセキュリティとユーザーのアクセシビリティの適切なバランスを見つけることは、慎重かつ継続的な作業です。.

ユーザーエクスペリエンスへの影響

CAPTCHA認証を導入する際、AIを使ってコンテンツをスクレイピングするボットを阻止するのに効果的であっても、ユーザーを苛立たせることがあるのは承知しています。私の評価では、CAPTCHAはこれらのボットを寄せ付けない効果があり、ウェブサイト訪問者の流れを管理し、許可なくコンテンツがコピーされる可能性を低減するのに役立ちます。しかし、サイト訪問者を遠ざけないためにも、このツールを賢く使うことが重要です。コンテンツへのアクセスを容易にすることと、不要なAIスクレイピングからコンテンツを保護することの適切なバランスを見つけることが大切です。CAPTCHAテストが多すぎると、ボットだけでなく、実際のユーザーも遠ざけてしまう可能性があります。私は、スクレイピングが発生する可能性が最も高い箇所にCAPTCHAを使用し、サイトの他の部分はユーザーフレンドリーなままにしています。私の目標は、サイト訪問者に優れた体験を提供すると同時に、AIによる不正なスクレイピングからサイトのコンテンツを安全に保つことです。.

特定のAIクローラーをブロックする

ウェブサイト運営者として、OpenAIのGPTBotのような特定のAIクローラーをブロックして、サイトからコンテンツをコピーされないようにすることができます。この対策は、コンテンツの不正収集を防ぐだけでなく、コンテンツ利用に関する倫理基準や法的規則を尊重することにもつながります。私の具体的なアプローチは以下のとおりです。

- 修正する

robots.txt: AIクローラーに対して、サイトのどの部分へのアクセスを禁止するかを具体的に指示する設定をこのファイルに記述します。.

ユーザーエージェント: GPTBot

許可しない: /

ユーザーエージェント: ChatGPT-User

許可しない: /

ユーザーエージェント: CCBot

許可しない: /

- サーバーログを確認する私は、サーバーのログを定期的に確認し、不審なAIクローラーの活動がないかチェックすることを日課にしています。.

- CAPTCHAを設定するウェブサイトのユーザーインタラクション部分では、CAPTCHAを使用しています。このテストは、実際の人間と自動ボットを区別するのに非常に役立ちます。.

- 特定のIPアドレスをブロックする: 必要に応じて、AI クローラーに関連付けられていることがわかっている IP アドレスをブロックして、サイトへのアクセスを遮断します。.

これらのことを行うことで、私は自分のコンテンツを保護し、データプライバシーと知的財産に関する規則を確実に遵守することができます。.

コンテンツのアクセシビリティの管理

ウェブサイトのコンテンツを不正なスクレイピングから保護する

コンテンツスクレイピングに関する懸念に対処するため、ウェブサイトのコンテンツへのアクセス権限を効果的に制御する方法について説明しましょう。ボットの侵入を制限することは非常に重要であり、これらの自動システムがサイトのコンテンツをコピーしたりインデックス化したりするのを防ぐための具体的な手法を概説します。これには、技術的な変更とアクセス制御対策の慎重な設定が必要となります。.

ウェブサイトのコンテンツの保護

ウェブサイトを運営する者にとって、コンテンツの独自性を確保し、自動スクレイピングシステムから保護することは重要な課題です。具体的な技術的対策を講じることで、ウェブサイトのコンテンツにアクセスし、インデックスを作成できるユーザーを制御することができます。.

robots.txtの調整を検討してみてはいかがでしょうか 検索エンジンに指示するファイル ボットがサイトのどの部分にアクセスすべきでないかを指定します。CAPTCHAシステムを導入することで、人間のユーザーを邪魔することなくボットを阻止することもできます。より洗練されたアプローチとしては、正当な訪問者と潜在的なスクレイパーを区別するためのサーバー側チェックを実装することもできます。.

コンテンツの完全性と独自性は何よりも重要です。サイトのセキュリティを確保するための積極的な対策を講じることで、コンテンツとその配信をコントロールできます。結局のところ、作成するコンテンツはブランドを反映するものであり、慎重に保護する必要があります。.

ボットアクセスの制限

ボットアクセスの制限

特定の対策を講じることで、自動システムが私のサイトからコンテンツを収集するリスクを大幅に低減できることを発見しました。私の対策は以下のとおりです。

- Robots.txtの調整: 私は微調整します

robots.txtスクレイピングの法的側面とデータ プライバシーの懸念を念頭に置き、ボットのアクセスを制御するファイルです。. - レート制限の実装: サーバーにレート制限を導入することで、ボット トラフィックによる潜在的な混乱の影響を抑えることができます。.

- APIコントロールの適用: API を通じて共有する情報は必要最小限に抑え、アクセスを制限するために適切な認証を要求します。.

- コンテンツ配信ネットワークの使用: ボット管理機能を備えた CDN を使用すると、コンテンツにアクセスするユーザーを管理し、効果的に保護することができます。.

これらの手順を実行することで、自動化ツールによるコンテンツの不正収集に対する強力な防御線が形成されます。.

コンテンツスクレイピング防止

アップデート後 robots.txt ファイルに関しては、現在、コンテンツのスクレイピングを防止するための対策に注力しており、ウェブサイトのアクセス性とセキュリティの維持に努めています。スクレイピングの技術的な側面、法的影響、そして高度なAIによるスクレイピング手法からユーザーデータを保護することの重要性について調査しています。.

| 戦略 | 説明 |

|---|---|

| 可変コンテンツ配信 | 自動化ツールには、人間の訪問者とは異なるコンテンツを提供します。. |

| ユーザーアクティビティの監視 | スクレイピングを示唆する可能性のある動作を確認します。. |

| アクセス制限 | ユーザーがコンテンツにアクセスできる頻度を制御し、疑わしい IP アドレスをブロックします。. |

これらの戦略を慎重に実行することで、ウェブサイトのコンテンツを保護するだけでなく、ユーザー情報のプライバシーとセキュリティも確保しています。これは、ウェブサイトのコンテンツを管理し、自動化ツールによる不正アクセスや悪用を防止するための、綿密な計画です。.

これらの戦略を取り入れることは、あなたの努力の成果を悪用しようとする者たちの一歩先を行くための賢明な方法です。それは、侵入者を監視するだけでなく、ゲストのプライバシーも尊重する高度な警報システムを設置するようなものです。潜在的な脅威に対して、受動的に対応するのではなく、能動的に対応することが重要なのです。.

セキュリティ対策の定期的な更新

robots.txtの調整やCAPTCHAの追加といった初期対策は良いスタートですが、コンテンツをスクレイピングする高度なAIツールから効果的にウェブサイトを守るには、セキュリティ戦略を継続的に見直すことが不可欠です。技術環境は常に変化しており、AIの機能はますます高度化し、従来のセキュリティ対策をすり抜けてしまうこともあります。そのため、ウェブサイトのセキュリティを維持するには、戦略的で、技術に精通した、体系的なアプローチが必要です。.

私の戦略はこうです。

- 定期的なセキュリティレビュー: 定期的にセキュリティ チェックを実施して、新たな弱点を見つけ、安全対策が最新かつ効果的であることを確認するようにしています。.

- 最新情報を常に把握する: 最新のセキュリティ パッチを常に把握し、サイトのソフトウェア要素がすべて最新であることを確認します。.

- セキュリティ対策の適応私は特定の脅威に対処するためにセキュリティ設定を調整しており、それによってコンテンツの保護と、適切な理由でコンテンツにアクセスできるようにすることとの間で健全なバランスを保つことができています。.

- トラフィック分析とレポートサイトへのトラフィックの流れを監視し、アクセスログを精査することで、AIによるスクレイピングの試みを示唆する可能性のある不審な行動を迅速に特定し、対処することができます。.

ウェブサイトのセキュリティ対策は、一度設定すればそれで終わりというものではありません。悪意のある攻撃者から身を守るための継続的な取り組みが必要です。常に警戒を怠らず、セキュリティ対策に積極的に取り組むことで、サイトのコンテンツだけでなく、訪問者のプライバシーも保護しています。.

法的保護の探求

複雑な法的問題に対処しながら、ウェブサイトを保護するために、無許可のAIスクレイピングに対する著作権法と規制を調査しています。国内および国際的な著作権法がサイト上のコンテンツにどのように影響するかを理解するには、体系的なアプローチが不可欠です。また、デジタルミレニアム著作権法(DMCA)についても確認し、AIによる侵害からコンテンツをどのように保護できるかを検討しました。.

AIツールの利用規約を評価することは、ウェブサイトからデータを収集・利用する際に、AIツールが権利を逸脱しないようにするための責任あるステップです。このような細部への配慮は、サイトのユーザーエクスペリエンスを維持し、コンテンツの悪用を防ぐために不可欠です。コンテンツの悪用は、ブランドの影響力を低下させ、訪問者のエンゲージメントを減少させる可能性があります。.

さらに、スクレイピング行為を特定し、被害を軽減するために、厳格なアクセス制御の導入や継続的なトラフィック分析といった技術的な対策も検討しています。法的措置と技術的な安全対策を組み合わせることで、ウェブサイトの独自性を維持し、その背後にある創造的な努力を守るつもりです。.

よくある質問

AIツールによるウェブサイトのスクレイピングをブロックした場合、GoogleやBingなどの他の検索エンジンにおけるサイトの可視性やランキングに影響はありますか?

AIツールによるウェブサイトのスクレイピングを防ぐことで、サイトのパフォーマンスがどのように変化するかを検討しています。 Googleなどの検索エンジン または Bing。オンラインでの可視性に関する混乱を解消することが重要です。 検索エンジンはランキング付けに独自のアルゴリズムを使用する. AIツールによるインデックス作成だけに頼っているわけではありません。私の目標は、コンテンツを保護しつつ、検索順位を維持することです。 検索結果. 実際には、これは私の安全を守ることと、 ウェブサイトのコンテンツと確実なSEOの実現 結果。.

ウェブサイトのトラフィックを分析する際に、正規の検索エンジンクローラーとAIスクレイパーをどのように区別すればよいですか?

私のサイトを閲覧する際に、正当な検索エンジンクローラーと不正なAIスクレイパーを区別するために ウェブサイトのトラフィック, 自動化されたインタラクションを示唆する可能性のあるユーザー行動パターンを綿密に調査しています。潜在的に有害なトラフィックをブロックするために、IPブロッキング技術を適用しています。また、ボット検出ツールも活用し、承認されていないボットを特定して制御しています。これらの対策により、コンテンツを保護しつつ、信頼できるユーザーがサイトにアクセスできるようにしています。 検索エンジン.

本物のトラフィックと人工的なトラフィックの違いを理解することで、ウェブサイトの分析データの精度を維持し、コンテンツが不正に利用されるのを防ぐことができます。ウェブサイトの所有者として、実店舗を万引き犯から守るのと同じように、デジタル資産のセキュリティを確保するのは私の責任です。これらの対策を講じることで、ウェブサイトのトラフィックを自信を持って管理し、その健全性を維持することができます。.

自分のコンテンツが AI ツールによって許可なくすでにスクレイピングされていることに気付いた場合、どのような手順を踏む必要がありますか?

自分のコンテンツが同意なしにAIツールによって使用されていることが判明した場合、まず最初に行うべきことは、その違反行為を一つ一つ綿密に記録することです。次に、責任者に連絡を取るか、必要に応じてDMCA削除要請を発行することで、コンテンツの返還を試みるべきです。これらの措置で問題が解決しない場合は、法的手段を検討することも選択肢の一つです。さらに、自分の作品が無断で使用されていることを一般に周知し、AIツールの倫理的な利用を促進することも有益です。オンライン上で自身の創作権を守るためには、警戒心と迅速な対応が鍵となります。.

覚えておいてください。自分の創作物を守ることは、単なる権利ではなく、責任でもあるのです。.

AIモデルのトレーニングに使用してはならないことを示すために、コンテンツに透かしを入れるための業界標準やベストプラクティスはありますか?

現在、AIモデルのトレーニングにおけるコンテンツの不正使用を防ぐための方法を検討しています。一つのアプローチとして、デジタル透かしやコンテンツフィンガープリンティングを用いることが挙げられます。これらは、作品に目に見えないマーカーや固有のコードを挿入するものです。これらの手法を、使用に関する明確なポリシーと組み合わせることで、私の素材をAIモデルのトレーニングに使用すべきではないという意思表示となります。コミュニティはこの件に関して共通のガイドライン策定に取り組んでいる最中であるため、作品が適切に保護されるよう、最新の手法に関する情報を常に把握するように努めています。.

“「データが絶えずアルゴリズムに投入される時代において、知的財産を保護することは、クリエイターにとって共通の懸念事項です。積極的に情報収集を行い、対策を講じることが賢明です。」”

AIツールがCAPTCHAを回避する能力を開発した場合、不正なデータ抽出からウェブサイトを守るために、より高度なセキュリティ戦略を採用する必要があるでしょう。効果的な方法の一つは、 行動バイオメトリクス, は、ユーザーによるサイトへのアクセス方法における異常を監視します。これにより、人間の訪問者と潜在的な自動スクレイパーを区別することができます。.

もう一つの保護層は 指紋分析. この技術は、オペレーティング システム、画面解像度、インストールされているフォントなど、デバイスとそのブラウザの固有の属性を評価し、ボットのアクティビティに典型的な不一致を検出します。.

一歩先を行くために、私は行動を起こします 適応課題. これらは、評価されたリスクに基づいて複雑さが変化するセキュリティチェックであり、検出された脅威のレベルに合わせて調整される動的な防御を保証します。これらの高度な手法を採用することで、最新のAI搭載スクレイピングツールに対するウェブサイトのセキュリティを大幅に強化できます。.

World Wide Web における AI スクレイピング保護とは何ですか?

AIスクレイピング防止とは、自動ボットがウェブサイトから許可なくデータを収集またはスクレイピングするのを防ぐための方法と技術を指します。これらの技術は、人工知能(AI)の機能を活用して、そのような活動を検知、識別、ブロックします。.

AI スクレーパーはなぜインターネット上の知的財産にとって脅威となるのでしょうか?

AIスクレイパーは、ウェブ上に公開されている大量の機密情報を迅速かつ効率的に収集できるため、脅威となります。収集されるデータには、著作権で保護されたコンテンツ、企業秘密、データベース、あるいはソースウェブサイト内でのみ使用されることを意図したその他のデジタル資産が含まれる可能性があります。.

AI スクレーパーはどのように機能しますか?

AIスクレイパーは、人間のブラウジング行動をシミュレートすることで機能します。ウェブページにアクセスし、事前に定義された基準に基づいて関連情報を識別し、そのデータを抽出して他の用途に使用します。これらのツールの高度さは大きく異なり、複雑なサイト構造をナビゲートし、基本的なスクレイピング対策を回避できるものもあります。.

AI スクレイピング防止ではどのような技術が一般的に採用されていますか?

AI スクレイピング保護でよく使用される手法には、レート制限 (IP アドレスが一定期間内に実行できるリクエストの数を制限する)、CAPTCHA テスト (ユーザーが人間であることを証明することを要求する)、ユーザー エージェント分析 (疑わしいブラウザー アクティビティを識別する)、ボットの動作を示す異常なパターンを検出できるより高度な機械学習アルゴリズムなどがあります。.

人工知能は Web スクレイピング活動からの保護に使用できますか?

はい、機械学習アルゴリズムなどの様々な形態の人工知能は、ウェブスクレイピングの検出と防止に活用できます。これらのシステムは、過去のボットの行動事例を学習することで、将来の潜在的な攻撃をより正確に予測し、阻止することができます。また、ボットの活動が疑われる場合に即座に対応できるリアルタイム検知技術を実装する場合もあります。.

AIツールによるウェブサイトのスクレイピングから守るための最終的な考え

ウェブサイトを不要なAIスクレイピングから守ることは、継続的な努力と注意を要する作業です。robots.txtの適切な活用、CAPTCHAの実装、既知のAIスクレイパーのブロック、コンテンツへのアクセス管理、そしてセキュリティ対策の継続的な更新が不可欠なステップであることが分かりました。法的措置を講じることで保護層をさらに強化できますが、常に警戒を怠らず、技術的な知識を習得しておくことが、コンテンツを自分の管理下に置き、ウェブサイトの健全性と訪問者への価値を維持する鍵となります。.

権威ある参考文献

AI クローラーから Web サイトを保護する方法についてさらに詳しく知りたい場合は、次の投稿をご覧になることをお勧めします。

- ITPro – AIウェブスクレイピング:ビジネスを守る方法

- この記事では、AIによるウェブスクレイピングの複雑さとそれに伴うリスクについて解説します。AIがより高速かつ高度にデータを収集し、分析して出力を生成する方法について、洞察を提供します。.

- ITProの記事

- 著者組合 – AIによる作品保護のための著者向け実践的ヒント

- このリソースは、著者やウェブサイトの所有者に対し、OpenAIのGPTBotのようなAIウェブクローラーをブロックするためにrobots.txtファイルを使用する方法など、AIによる作品の利用から作品を保護する方法に関する実践的なアドバイスを提供します。.

- 著者ギルドのヒント

- Resolution Digital – ウェブサイトを保護 AIコンテンツ 削り取り

- この記事では、ChatGPTなどのAIツールによるスクレイピングや不正利用からウェブサイトを保護するための簡単な手順を紹介します。robots.txtファイルの使用、CAPTCHAの実装、IPアドレス範囲のブロックについても解説します。.

- 解像度デジタルガイド

- Octoparse – ブランド保護とサイバーセキュリティのためのWebスクレイピング

- これ ブログ この投稿では、Webスクレイピングをブランド保護とサイバーセキュリティにどのように活用できるかを考察します。また、潜在的な著作権侵害や著作権侵害を発見するためのWebスクレイピングツールの活用についても解説します。.

- Octoparseの記事

- ScienceDirect – AIウェブスクレイピングとの戦い

- ScienceDirect のこの記事では、AI による Web スクレイピングに対する反対意見の高まりについて考察し、AI の急速な進歩と、テキストやその他のデジタル コンテンツの膨大なデータ セットによる AI のトレーニングに焦点を当てています。.

- サイエンスダイレクトの記事