Dengarkan ringkasan postingan tersebut:

Situs web saya menyerupai taman yang terawat baik, dengan konten orisinal yang berkembang seiring bertambahnya pengunjung. Namun, dengan kemajuan alat AI yang mahir mengekstrak data dari situs web, saya menyadari perlunya memperkuat pertahanan situs saya untuk memblokir ekstraksi yang tidak diinginkan ini. Melalui pengalaman saya, saya telah mengumpulkan Strategi untuk melindungi situs web Anda dari pengikis data AI secara efektif.. Mari kita bahas beberapa langkah untuk melindungi situs Anda. Saya akan memandu Anda dalam menerapkan arahan robots.txt, menyiapkan tantangan CAPTCHA, dan metode tambahan untuk memastikan konten Anda tetap eksklusif di domain Anda. Ini semua tentang menjaga kesucian ranah online Anda, memastikan bahwa pengunjung manusialah yang menuai manfaat dari kerja keras Anda.

Demi menjaga keamanan tempat perlindungan digital Anda, ingatlah, "Gerbang yang kokoh memastikan bahwa hanya orang yang diterima yang dapat menikmati taman di dalamnya."“

Hal-hal Penting yang Dapat Dipetik

Melindungi situs web saya dari pengikis AI adalah pertempuran berkelanjutan yang membutuhkan perhatian dan strategi proaktif. Saya menemukan bahwa mengkonfigurasi file robots.txt saya secara efektif, menyiapkan CAPTCHA, mengidentifikasi dan memblokir pengikis AI yang dikenal sangat membantu. peralatan, Mengontrol siapa yang dapat mengakses konten saya, dan sering memperbarui protokol keamanan adalah strategi penting. Menambahkan perlindungan hukum memberikan lapisan pertahanan lain, tetapi tetap waspada dan mahir secara teknis adalah cara terbaik untuk menjaga keamanan konten saya dan mempertahankan nilai situs saya bagi pengunjung.

Ingatlah untuk selalu memperbarui pertahanan situs web Anda, karena metode pengambilan data terus berkembang. Tinjau pengaturan keamanan Anda secara berkala dan bersiaplah untuk beradaptasi dengan tantangan baru agar konten Anda tetap aman.

Memahami Web Scraping AI

Saat kita membahas topik web scraping menggunakan AI, sangat penting untuk menyadari implikasi etis dari praktik ini. Saya akan mengevaluasi potensi risiko dan manfaatnya, memastikan bahwa kita menetapkan kerangka kerja untuk perilaku etis dalam pengumpulan data AI. Setelah itu, saya akan mengeksplorasi langkah-langkah penanggulangan teknis yang tersedia bagi pemilik situs web yang ingin melindungi konten mereka dari web scraping AI yang tidak sah.

Saat kita membahas topik web scraping menggunakan AI, sangat penting untuk menyadari implikasi etis dari praktik ini. Saya akan mengevaluasi potensi risiko dan manfaatnya, memastikan bahwa kita menetapkan kerangka kerja untuk perilaku etis dalam pengumpulan data AI. Setelah itu, saya akan mengeksplorasi langkah-langkah penanggulangan teknis yang tersedia bagi pemilik situs web yang ingin melindungi konten mereka dari web scraping AI yang tidak sah.

Menggali Masalah Etika

Memahami Dimensi Etika AI Pengikisan Konten

Mengapa Anda harus khawatir tentang aspek etika dari alat AI yang mengekstrak konten dari situs web Anda? Saat membahas topik ini, sangat penting untuk melihat kompleksitas privasi data. Pengambilan data AI yang tidak diatur dapat menyebabkan pengumpulan informasi rahasia tanpa izin, yang mungkin melanggar hak kekayaan intelektual dari mereka yang membuat konten. Penting juga untuk mematuhi hukum yang mengatur bagaimana data dikumpulkan dan digunakan. Hukum ini bertujuan untuk melindungi individu dan perusahaan dari pelanggaran privasi dan penyalahgunaan informasi mereka. Selalu mengikuti peraturan ini sangat penting untuk menjaga keamanan konten situs web Anda dan memastikan praktik Anda beretika seiring kemajuan teknologi.

Tindakan Pencegahan untuk Pengikisan

Untuk mencegah sistem otomatis mengambil data dari situs web saya, saya secara rutin melakukan penyesuaian pada file robots.txt. Praktik yang cermat ini memungkinkan saya untuk menentukan bagian mana dari situs web saya yang dapat diakses oleh bot seperti GPTBot. Dengan terus memperbarui instruksi ini, saya melindungi konten situs web saya dari pengambilan data tanpa izin oleh alat otomatis.

Dengan melakukan hal itu, saya tidak hanya mengikuti rutinitas teknis; saya mengambil sikap untuk melindungi nilai dan privasi informasi yang telah saya buat dengan susah payah. Sebagai webmaster, kita harus waspada dan proaktif untuk mengamankan properti digital kita yang dipercaya pengguna—jalur terlarang yang penting.

Ingat, file robots.txt yang terawat dengan baik adalah lapisan pertahanan yang sederhana namun efektif terhadap upaya tanpa henti dari para pengikis data.

Perbarui Robots.txt Secara Teratur

Menjaga keamanan konten situs web Anda berarti secara teratur meninjau dan memperbarui file robots.txt Anda. Begini cara saya melakukannya secara efektif:

- Tetapkan jadwal rutin untuk pembaruan.

- Terapkan metode terbaik untuk menentukan bagian mana dari situs Anda yang dapat diakses oleh agen pengguna (seperti perayap web).

- Pantau terus perkembangan terbaru dalam alat pengikis data berbasis AI untuk mengantisipasi potensi risiko keamanan.

- Lakukan penyesuaian yang diperlukan pada jalur yang dilarang diakses untuk memastikan konten Anda tetap terlindungi dari akses tanpa izin.

Mengapa Anda Harus Memperbarui Robots.txt?

Memperbarui file robots.txt Anda adalah cara sederhana namun ampuh untuk melindungi situs web Anda. File ini memberi tahu mesin pencari dan perayap web lainnya halaman atau bagian mana dari situs Anda yang tidak boleh diakses atau diubah. diindeks. Hal ini dapat membantu mencegah pengambilan data yang tidak diinginkan dan dapat menjadi bagian dari strategi yang lebih besar untuk melindungi konten situs Anda.

Ingat, seiring munculnya jenis-jenis web crawler baru, tetap waspada dan menyesuaikan file robots.txt Anda adalah langkah yang cerdas. File robots.txt yang terawat dengan baik sangat penting untuk strategi keamanan situs web Anda secara keseluruhan.

Memanfaatkan Robots.txt Secara Efektif

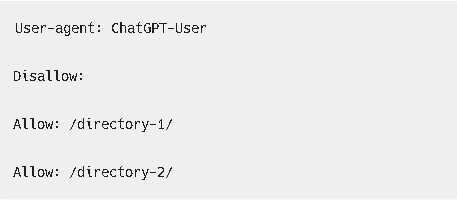

Untuk melindungi situs web Anda dari pengumpulan data otomatis yang tidak diinginkan, mari kita bahas cara memperbarui file robots.txt dengan hati-hati. Anda dapat menginstruksikan perayap web tertentu, seperti GPTBot dari OpenAI, untuk mengakses atau melewati konten situs Anda dengan membuat aturan agen pengguna tertentu. Dengan mengatur parameter ini dengan cermat, Anda mendapatkan kendali yang tepat atas bagian mana dari situs Anda yang dapat diindeks atau diabaikan oleh berbagai sistem AI.

Untuk melindungi situs web Anda dari pengumpulan data otomatis yang tidak diinginkan, mari kita bahas cara memperbarui file robots.txt dengan hati-hati. Anda dapat menginstruksikan perayap web tertentu, seperti GPTBot dari OpenAI, untuk mengakses atau melewati konten situs Anda dengan membuat aturan agen pengguna tertentu. Dengan mengatur parameter ini dengan cermat, Anda mendapatkan kendali yang tepat atas bagian mana dari situs Anda yang dapat diindeks atau diabaikan oleh berbagai sistem AI.

Edit Robots.TXT dengan Benar

Untuk melindungi situs web Anda dari pengambilan data yang tidak diinginkan oleh AI, sangat penting untuk mengelola file robots.txt Anda dengan hati-hati. Langkah ini sangat mendasar dalam menjaga privasi data situs web Anda dan mematuhi undang-undang pengumpulan data. Berikut panduan saya untuk melakukannya secara efektif:

- Temukan FilePertama, saya masuk ke server situs web saya dan mencari file robots.txt yang sudah ada di sana.

- Tinjau Aturan Saat IniSelanjutnya, saya akan meneliti file tersebut dengan saksama untuk memahami sepenuhnya aturan yang ada dan apa artinya bagi situs saya.

- Perbarui dengan Hati-hatiDengan memperhatikan detail, saya menyesuaikan atau menambahkan aturan baru untuk menentukan apa yang dapat dan tidak dapat dilakukan oleh sistem AI, menggunakan 'Disallow:' untuk memblokir dan 'Allow:' untuk memberikan akses.

- Verifikasi PerubahanSetelah saya melakukan perubahan, saya menjalankan file robots.txt yang telah diperbarui melalui penguji untuk memastikan aturan-aturan tersebut ditulis dengan benar dan berfungsi sebagaimana mestinya.

Dengan menjalankan langkah-langkah ini secara cermat, saya memperbarui file robots.txt saya untuk menjaga keamanan situs saya sekaligus tetap ramah bagi pengunjung. mesin pencari yang membantu orang menemukan konten saya.

Menerapkan Verifikasi CAPTCHA

Selanjutnya, mari kita bahas verifikasi CAPTCHA. Metode ini berfungsi sebagai penghalang yang kuat terhadap pengambilan data otomatis tanpa izin. Cara kerjanya adalah dengan membedakan aktivitas manusia yang asli dari aktivitas yang tidak sah. perangkat lunak otomatis, secara efektif memblokir bot yang tidak diinginkan sambil tetap mengizinkan akses pengguna sebenarnya. Meskipun demikian, saat menerapkan CAPTCHA, sangat penting untuk mempertimbangkan potensi dampaknya terhadap interaksi pengguna. Menemukan keseimbangan yang tepat adalah kunci untuk memastikan situs web Anda tetap ramah pengguna.

Efektivitas CAPTCHA

Mengintegrasikan pemeriksaan CAPTCHA adalah strategi yang tepat untuk melindungi situs web saya dari akses tidak sah. pengambilan konten dengan alat otomatis. Berikut perspektif saya mengapa ini merupakan langkah yang efektif:

- Tantangan Kompleks: Rumit CAPTCHA menghadirkan teka-teki rumit yang sulit dipecahkan oleh sistem otomatis. sistem tetapi tetap dapat dikelola oleh orang-orang.

- Pembaruan Berkelanjutan: Dengan sering memperbarui algoritma CAPTCHA, mereka dapat mengungguli perkembangan AI yang jika tidak demikian dapat menghindari sistem yang tidak berubah.

- Keamanan BerlapisKetika CAPTCHA digunakan bersamaan dengan langkah-langkah keamanan lainnya, ia menciptakan penghalang yang kuat terhadap akses tanpa izin.

- Kewaspadaan: Memantau kinerja dan tingkat keberhasilan CAPTCHA dapat memberikan sinyal kapan saatnya melakukan penyesuaian atau perbaikan.

Meskipun menambahkan CAPTCHA memang meningkatkan keamanan, saya selalu mempertimbangkan sisi etika dan bertujuan untuk meminimalkan dampaknya pada pengguna. Menemukan keseimbangan yang tepat antara keamanan yang kuat dan aksesibilitas pengguna adalah tugas yang cermat dan berkelanjutan.

Dampak pada Pengalaman Pengguna

Saat menerapkan pemeriksaan CAPTCHA, saya menyadari bahwa terkadang hal itu dapat mengganggu pengguna, meskipun efektif dalam menghentikan bot yang mengambil konten menggunakan AI. Penilaian saya menunjukkan bahwa CAPTCHA efektif dalam mencegah bot-bot ini, yang membantu mengelola arus pengunjung situs web dan mengurangi kemungkinan konten disalin tanpa izin. Namun demikian, sangat penting untuk menggunakan alat ini dengan bijak untuk mencegah pengunjung meninggalkan situs Anda. Kuncinya adalah menemukan keseimbangan yang tepat antara membuat konten Anda mudah diakses dan melindunginya dari pengambilan data oleh AI yang tidak diinginkan. Terlalu banyak tes CAPTCHA dapat mengusir pengguna asli maupun bot. Saya menggunakan CAPTCHA di area di mana pengambilan data paling mungkin terjadi sambil tetap menjaga agar bagian situs lainnya ramah pengguna. Tujuan saya adalah untuk menawarkan pengalaman yang hebat bagi pengunjung situs sekaligus menjaga keamanan konten situs dari pengambilan data tanpa izin oleh AI.

Memblokir Perayap AI Tertentu

Sebagai pengelola situs web, saya memiliki kemampuan untuk memblokir perayap AI tertentu, seperti GPTBot dari OpenAI, untuk menghentikan mereka menyalin konten dari situs saya. Langkah ini bukan hanya tentang menghentikan pengumpulan konten saya tanpa izin, tetapi juga tentang menghormati standar etika dan aturan hukum terkait penggunaan konten. Berikut cara saya melakukannya:

- Memodifikasi

robots.txtSaya menyesuaikan file ini dengan instruksi khusus untuk perayap AI yang menjelaskan bagian mana dari situs saya yang dilarang untuk mereka akses.

Agen pengguna: GPTBot

Dilarang: /

Agen pengguna: ChatGPT-User

Dilarang: /

Agen pengguna: CCBot

Dilarang: /

- Periksa Log ServerSaya menjadikan kebiasaan untuk memeriksa log server saya guna menemukan aktivitas perayap AI yang tampak mencurigakan.

- Cara Memasang CAPTCHADi beberapa bagian situs web saya tempat pengguna berinteraksi, saya menggunakan CAPTCHA. Tes ini sangat bagus untuk membedakan manusia asli dari bot otomatis.

- Memblokir Alamat IP TertentuJika diperlukan, saya memblokir alamat IP yang saya ketahui terkait dengan perayap AI untuk menjauhkan mereka dari situs saya.

Dengan melakukan hal-hal ini, saya melindungi konten saya dan memastikan saya mengikuti aturan terkait privasi data dan kekayaan intelektual.

Mengelola Aksesibilitas Konten

Melindungi Konten Situs Web Anda dari Pengambilan Data Tidak Sah

Untuk mengatasi kekhawatiran terkait pengambilan data dari situs web (content scraping), mari kita bahas metode efektif untuk mengontrol siapa yang dapat mengakses konten situs web Anda. Sangat penting untuk membatasi akses bot, dan saya akan menguraikan teknik spesifik untuk mencegah sistem otomatis ini menyalin atau mengindeks materi situs Anda. Ini akan melibatkan perubahan teknis dan pengaturan langkah-langkah kontrol akses yang cermat.

Melindungi Konten Situs Web Anda

Bagi pengelola situs web, memastikan konten tetap eksklusif dan terlindungi dari sistem pengikis otomatis merupakan hal yang sangat penting. Menerapkan langkah-langkah teknis tertentu dapat membantu Anda mengontrol siapa yang memiliki kemampuan untuk mengakses dan mengindeks konten situs web Anda.

Anda mungkin perlu mempertimbangkan untuk menyesuaikan file robots.txt Anda. berkas untuk menginstruksikan mesin pencari Bot dapat mengidentifikasi bagian mana dari situs Anda yang tidak boleh diakses. Penggunaan sistem CAPTCHA juga dapat mencegah bot tanpa menghambat pengguna manusia. Untuk pendekatan yang lebih canggih, Anda dapat menerapkan pemeriksaan sisi server untuk membedakan antara pengunjung yang sah dan potensi pengikis data (scraper).

Ingat, integritas dan eksklusivitas konten Anda sangat penting. Dengan mengambil langkah proaktif untuk mengamankan situs Anda, Anda mempertahankan kendali atas konten dan distribusinya. Bagaimanapun, konten yang Anda buat adalah cerminan merek Anda dan harus dijaga dengan hati-hati.

Membatasi Akses Bot

Membatasi Akses Bot

Saya telah menemukan bahwa mengambil langkah-langkah spesifik dapat sangat mengurangi risiko sistem otomatis mengambil konten dari situs saya. Berikut cara saya melakukannya:

- Menyesuaikan Robots.txt: Saya menyempurnakan

robots.txtberkas untuk mengontrol akses bot, dengan tetap memperhatikan aspek hukum dari pengambilan data (scraping) dan masalah privasi data. - Menerapkan Batasan LajuDengan menerapkan batasan laju (rate limit) pada server saya, saya dapat mengurangi potensi dampak negatif dari lalu lintas bot.

- Menerapkan Kontrol APISaya hanya membagikan sedikit informasi melalui API dan memerlukan otentikasi yang tepat untuk membatasi akses.

- Menggunakan Jaringan Pengiriman Konten (Content Delivery Networks)Dengan menggunakan CDN yang dilengkapi dengan kemampuan manajemen bot, saya dapat mengelola siapa yang mengakses konten saya dan melindunginya secara efektif.

Mengambil langkah-langkah ini membentuk garis pertahanan yang kuat terhadap pengambilan konten tanpa izin oleh alat otomatis.

Pencegahan Pengambilan Konten Secara Ilegal

Setelah memperbarui saya robots.txt Saat ini, saya sedang fokus pada langkah-langkah untuk mencegah pengambilan data konten secara ilegal (content scraping), memastikan situs web saya tetap dapat diakses namun aman. Saya sedang meneliti aspek teknis dari pengambilan data ilegal, konsekuensi hukumnya, dan pentingnya melindungi data pengguna dari metode pengambilan data ilegal berbasis AI yang canggih.

| Strategi | Keterangan |

|---|---|

| Penyampaian Konten Variabel | Berikan konten yang berbeda kepada alat otomatis dibandingkan dengan pengunjung manusia. |

| Pemantauan Aktivitas Pengguna | Periksa perilaku yang mungkin mengindikasikan pengambilan data secara ilegal (scraping). |

| Pembatasan Akses | Kontrol seberapa sering pengguna dapat mengakses konten dan blokir alamat IP yang mencurigakan. |

Dengan menerapkan strategi-strategi ini secara cermat, saya tidak hanya melindungi konten situs web saya, tetapi juga menjaga informasi pengguna tetap pribadi dan aman. Ini adalah rencana yang disengaja untuk mengelola konten situs web saya dan untuk mencegah akses tidak sah atau penyalahgunaan oleh alat otomatis.

Menerapkan strategi-strategi ini adalah cara cerdas untuk tetap selangkah lebih maju dari mereka yang mungkin mencoba menyalahgunakan kerja keras Anda. Ini seperti memasang sistem alarm canggih yang tidak hanya mengawasi penyusup tetapi juga menghormati privasi tamu Anda. Ini tentang bersikap proaktif daripada reaktif dalam menghadapi potensi ancaman.

Memperbarui Langkah-Langkah Keamanan Secara Berkala

Membangun pertahanan awal seperti mengubah file robots.txt atau menambahkan CAPTCHA adalah langkah awal yang baik, tetapi untuk secara efektif melindungi diri dari alat AI canggih yang mengambil konten, sangat penting untuk terus memperbarui strategi keamanan situs web Anda. Lingkungan teknologi berada dalam keadaan perubahan yang konstan, dengan kemampuan AI yang semakin canggih dan terkadang lolos dari metode keamanan lama. Oleh karena itu, menjaga keamanan situs web Anda membutuhkan pendekatan strategis, berwawasan teknologi, dan sistematis.

Inilah strategi saya:

- Tinjauan Keamanan RutinSaya selalu melakukan pemeriksaan keamanan secara berkala untuk mendeteksi titik lemah yang muncul, memastikan pengamanan saya selalu mutakhir dan efektif.

- Selalu Ikuti Perkembangan TerbaruSaya selalu mengikuti perkembangan terbaru terkait pembaruan keamanan dan memastikan semua elemen perangkat lunak situs saya selalu mutakhir.

- Menyesuaikan Langkah-Langkah KeamananSaya menyesuaikan pengaturan keamanan saya untuk mengatasi ancaman spesifik, yang membantu menjaga keseimbangan yang sehat antara melindungi konten dan memastikan konten tersebut dapat diakses untuk alasan yang tepat.

- Analisis dan Pelaporan Lalu LintasDengan memantau arus lalu lintas ke situs saya dan meneliti log akses, saya dapat dengan cepat mengidentifikasi dan menindaklanjuti perilaku mencurigakan yang mungkin mengindikasikan upaya pengambilan data oleh AI.

Mengamankan situs web saya bukanlah urusan sekali atur lalu lupakan; ini adalah tantangan berkelanjutan untuk menangkis mereka yang berniat jahat. Dengan tetap waspada dan proaktif terhadap keamanan, saya tidak hanya melindungi konten situs saya tetapi juga privasi para pengunjungnya.

Menjelajahi Perlindungan Hukum

Dalam menghadapi kompleksitas hukum, saya sedang meneliti undang-undang dan peraturan hak cipta terhadap pengambilan data AI tanpa izin untuk melindungi situs web saya. Sangat penting untuk mengambil pendekatan sistematis untuk memahami bagaimana undang-undang hak cipta nasional dan internasional memengaruhi materi di situs saya. Saya juga telah meninjau Digital Millennium Copyright Act (DMCA) untuk melihat bagaimana undang-undang tersebut dapat melindungi konten saya dari pelanggaran yang didorong oleh AI.

Menilai ketentuan penggunaan alat AI merupakan langkah bertanggung jawab untuk memastikan alat tersebut tidak melampaui haknya dalam menggunakan dan mengumpulkan data dari situs web. Perhatian terhadap detail ini sangat penting untuk menjaga pengalaman pengguna situs saya dan mencegah penyalahgunaan konten saya, yang dapat mengurangi dampak merek saya dan menurunkan keterlibatan pengunjung.

Selain itu, saya mempertimbangkan strategi teknis seperti menerapkan kontrol akses yang ketat dan analisis lalu lintas secara terus-menerus untuk mengidentifikasi dan mengurangi upaya pengambilan data (scraping). Kombinasi langkah-langkah hukum dan pengamanan teknis adalah rencana saya untuk mempertahankan keunikan situs web saya dan melindungi upaya kreatif di baliknya.

Pertanyaan yang Sering Diajukan

Jika saya memblokir alat AI agar tidak mengambil data dari situs web saya, apakah itu akan memengaruhi visibilitas atau peringkat situs saya di mesin pencari lain seperti Google atau Bing?

Saya sedang mempertimbangkan apakah mencegah alat AI untuk mengambil data dari situs web saya dapat mengubah seberapa baik kinerja situs saya. mesin pencari seperti Google atau Bing. Penting untuk meluruskan kebingungan tentang visibilitas online; ini Mesin pencari menggunakan algoritma unik untuk menentukan peringkat.. Mereka tidak bergantung sepenuhnya pada pengindeksan oleh alat AI. Tujuan saya adalah untuk menjaga konten saya tetap terlindungi dan tetap mempertahankan posisi yang baik di hasil pencarian. Dalam praktiknya, ini berarti menemukan keseimbangan yang cermat antara melindungi diri saya. konten situs web dan pencapaian SEO yang solid hasil.

Bagaimana Saya Dapat Membedakan Antara Crawler Mesin Pencari yang Sah dan Scraper AI Saat Menganalisis Lalu Lintas Situs Web Saya?

Untuk membedakan perayap mesin pencari yang sah dari pengikis AI yang tidak sah saat melihat data saya lalu lintas situs web, Saya mengamati dengan cermat pola perilaku pengguna yang mungkin mengindikasikan interaksi otomatis. Untuk mencegah lalu lintas yang berpotensi berbahaya, saya menerapkan teknik pemblokiran IP. Saya juga memanfaatkan alat pendeteksi bot, yang membantu saya mengidentifikasi dan mengendalikan bot yang tidak disetujui. Langkah-langkah ini membantu saya melindungi konten saya sekaligus memastikan situs saya tetap dapat diakses oleh pengguna yang bereputasi baik. mesin pencari.

Memahami perbedaan antara lalu lintas asli dan buatan memastikan bahwa analitik situs web saya tetap akurat dan konten saya tidak jatuh ke tangan yang salah. Sebagai pemilik situs web, adalah tanggung jawab saya untuk menjaga keamanan aset digital saya, sama seperti melindungi toko fisik dari pencuri. Dengan strategi-strategi ini, saya dapat dengan percaya diri mengelola lalu lintas situs web saya dan menjaga integritasnya.

Apa langkah yang harus saya ambil jika saya menyadari bahwa konten saya telah diambil (scrape) oleh alat AI tanpa izin saya?

Setelah mengetahui bahwa konten saya telah digunakan oleh alat AI tanpa izin saya, langkah pertama adalah mencatat secara teliti setiap pelanggaran tersebut. Selanjutnya, saya akan mencoba untuk mendapatkan kembali konten saya dengan menghubungi pihak yang bertanggung jawab, atau jika perlu, dengan mengajukan permintaan penghapusan DMCA. Jika langkah-langkah ini gagal menyelesaikan masalah, mempertimbangkan jalur hukum adalah pilihan. Selain itu, bermanfaat untuk memberi tahu publik tentang penggunaan karya saya yang tidak sah, dan mempromosikan penggunaan alat AI yang etis. Kewaspadaan dan tindakan segera adalah kunci untuk melindungi hak cipta seseorang secara daring.

Ingat: Melindungi karya kreatif Anda bukan hanya hak; itu adalah tanggung jawab.

Apakah Ada Standar Industri atau Praktik Terbaik untuk Memberi Tanda Air pada Konten Saya untuk Menunjukkan Bahwa Konten Tersebut Tidak Boleh Digunakan untuk Melatih Model AI?

Saat ini saya sedang meninjau metode untuk melindungi konten saya dari penggunaan tanpa izin dalam pelatihan model AI. Salah satu pendekatannya adalah menggunakan watermark digital dan sidik jari konten, yang menyisipkan penanda tak terlihat atau kode khas ke dalam karya saya. Jika dikombinasikan dengan kebijakan eksplisit mengenai penggunaan, strategi ini berfungsi sebagai tanda bahwa materi saya tidak boleh digunakan untuk melatih model AI. Komunitas masih berupaya mencapai pedoman bersama mengenai hal ini, jadi saya terus mengikuti perkembangan strategi terbaru untuk memastikan karya saya terlindungi dengan baik.

“Melindungi kekayaan intelektual di era di mana data terus-menerus dimasukkan ke dalam algoritma adalah kekhawatiran bersama bagi para kreator. Bijaksana untuk bersikap proaktif dan mendapatkan informasi yang cukup.”

Jika alat AI mengembangkan kemampuan untuk melewati CAPTCHA, saya perlu mengadopsi strategi keamanan yang lebih canggih untuk melindungi situs web saya dari pengambilan data tanpa izin. Salah satu metode yang efektif adalah Biometrik Perilaku, yang memantau kejanggalan dalam cara pengguna berinteraksi dengan situs. Ini dapat membantu membedakan antara pengunjung manusia dan potensi pengikis data otomatis.

Lapisan perlindungan lainnya meliputi Analisis Sidik Jari. Teknik ini mengevaluasi atribut unik dari sebuah perangkat dan perambannya, seperti sistem operasi, resolusi layar, dan font yang terpasang, untuk mendeteksi ketidaksesuaian yang lazim terjadi pada aktivitas bot.

Untuk selalu selangkah lebih maju, saya akan mengambil tindakan. Tantangan Adaptif. Ini adalah pemeriksaan keamanan yang kompleksitasnya dapat bervariasi berdasarkan risiko yang dinilai, memastikan pertahanan dinamis yang menyesuaikan dengan tingkat ancaman yang terdeteksi. Dengan menerapkan metode canggih ini, saya dapat secara signifikan memperkuat keamanan situs web saya terhadap alat pengikis data berbasis AI terbaru.

Apa yang dimaksud dengan perlindungan terhadap pengikisan data oleh AI dalam konteks World Wide Web?

Perlindungan terhadap pengambilan data menggunakan AI mengacu pada metode dan teknologi yang digunakan untuk mencegah bot otomatis mengambil atau mengikis data dari situs web tanpa izin. Teknologi ini memanfaatkan kemampuan kecerdasan buatan untuk mendeteksi, mengidentifikasi, dan memblokir aktivitas tersebut.

Mengapa program pengikis data berbasis AI menjadi ancaman bagi kekayaan intelektual di internet?

Perangkat lunak pengikis data berbasis AI menimbulkan ancaman karena dapat dengan cepat dan efisien mengumpulkan sejumlah besar informasi rahasia yang dipublikasikan di web. Data ini dapat mencakup konten berhak cipta, rahasia dagang, basis data, atau aset digital lainnya yang dimaksudkan untuk digunakan hanya di situs web sumbernya.

Bagaimana cara kerja pengikis data berbasis AI?

Sebuah program pengikis data berbasis AI bekerja dengan mensimulasikan perilaku penelusuran manusia. Program ini mengunjungi halaman web, mengidentifikasi informasi yang relevan berdasarkan kriteria yang telah ditentukan, kemudian mengekstrak data ini untuk digunakan di tempat lain. Tingkat kecanggihan alat-alat ini sangat bervariasi; beberapa mampu menavigasi struktur situs yang kompleks dan menghindari langkah-langkah anti-pengikisan data dasar.

Teknik apa saja yang umum digunakan dalam perlindungan terhadap pengikisan data AI?

Teknik yang sering digunakan dalam perlindungan terhadap pengikisan data oleh AI meliputi pembatasan laju (membatasi jumlah permintaan yang dapat dilakukan oleh alamat IP dalam periode waktu tertentu), tes CAPTCHA (yang menantang pengguna untuk membuktikan bahwa mereka adalah manusia), analisis agen pengguna (untuk mengidentifikasi aktivitas peramban yang mencurigakan), dan algoritma pembelajaran mesin yang lebih canggih yang dapat mendeteksi pola tidak biasa yang menunjukkan perilaku bot.

Bisakah kecerdasan buatan digunakan untuk melindungi dari aktivitas web scraping?

Ya, berbagai bentuk kecerdasan buatan seperti algoritma pembelajaran mesin dapat dimanfaatkan untuk mendeteksi dan mencegah web scraping. Sistem ini belajar dari contoh perilaku bot sebelumnya, memungkinkan mereka untuk lebih baik mengantisipasi dan menggagalkan potensi serangan di masa mendatang. Mereka juga dapat menerapkan teknik deteksi waktu nyata yang memungkinkan tindakan segera ketika aktivitas bot yang dicurigai terjadi.

Kesimpulan saya tentang cara melindungi situs web Anda agar tidak di-scrape oleh alat AI.

Menjaga keamanan situs web saya dari pengambilan data oleh AI yang tidak diinginkan adalah upaya berkelanjutan yang membutuhkan ketelitian. Saya menemukan bahwa penggunaan robots.txt yang cerdas, penerapan CAPTCHA, pemblokiran pengambil data AI yang dikenal, pengelolaan akses ke konten, dan pembaruan langkah-langkah keamanan secara konsisten adalah langkah-langkah penting. Meskipun menambahkan langkah-langkah hukum menawarkan lapisan perlindungan ekstra, tetap waspada dan mahir secara teknis adalah kunci untuk memastikan konten saya tetap berada dalam kendali saya, sehingga menjaga integritas situs web saya dan nilai yang ditawarkannya kepada pengunjung.

Referensi Otoritatif

Jika Anda ingin membaca lebih lanjut tentang melindungi situs web Anda dari perayap AI, saya sarankan Anda untuk melihat postingan berikut:

- ITPro – Pengambilan data web berbasis AI: Cara melindungi bisnis Anda dari

- Artikel ini membahas kompleksitas web scraping berbasis AI dan risiko yang terkait. Artikel ini memberikan wawasan tentang bagaimana AI dapat mengumpulkan data dengan kecepatan dan kecanggihan yang lebih tinggi, menganalisisnya untuk menghasilkan output.

- Artikel ITPro

- Authors Guild – Tips Praktis bagi Penulis untuk Melindungi Karya Mereka dari Penggunaan AI

- Sumber daya ini menawarkan saran praktis bagi penulis dan pemilik situs web tentang cara melindungi karya mereka dari penggunaan AI, termasuk menggunakan file robots.txt untuk memblokir perayap web AI seperti GPTBot dari OpenAI.

- Tips dari Authors Guild

- Resolution Digital – Lindungi Situs Web dari Konten AI Mengikis

- Artikel ini memberikan langkah-langkah sederhana untuk melindungi situs web Anda dari pengambilan data (scraping) dan penggunaan tanpa izin oleh alat AI seperti ChatGPT. Artikel ini membahas penggunaan file robots.txt, implementasi CAPTCHA, dan pemblokiran rentang IP.

- Panduan Digital Resolusi

- Octoparse – Pengambilan Data Web untuk Perlindungan Merek dan Keamanan Siber

- Ini blog Artikel ini membahas bagaimana web scraping dapat digunakan untuk perlindungan merek dan keamanan siber. Artikel ini mendiskusikan penggunaan alat web scraping untuk menemukan potensi pelanggaran dan penyalahgaran hak cipta.

- Artikel Octoparse

- ScienceDirect – Perang melawan web scraping berbasis AI

- Artikel dari ScienceDirect ini membahas keberatan yang semakin meningkat terhadap web scraping berbasis AI, menyoroti kemajuan pesat dalam AI dan pelatihannya pada kumpulan data teks dan konten digital lainnya yang sangat besar.

- Artikel ScienceDirect