पोस्ट का सारांश सुनें:

मेरी वेबसाइट एक सुव्यवस्थित बगीचे की तरह है, जिसमें हर आगंतुक के साथ विकसित होने वाली मौलिक सामग्री है। हालाँकि, वेबसाइटों से डेटा निकालने में माहिर एआई उपकरणों की प्रगति के साथ, मैंने इन अवांछित डेटा निकासी को रोकने के लिए अपनी साइट की सुरक्षा को मजबूत करने की आवश्यकता को महसूस किया है। अपने अनुभव से, मैंने यह सीखा है कि वेबसाइट को एआई स्क्रैपिंग से प्रभावी ढंग से बचाने की रणनीतियाँ. आइए, अपनी साइट को सुरक्षित रखने के कुछ चरणों पर नज़र डालें। मैं आपको robots.txt निर्देश लागू करने, CAPTCHA चुनौतियाँ सेट करने और अन्य तरीकों के बारे में मार्गदर्शन दूंगा ताकि यह सुनिश्चित हो सके कि आपकी सामग्री केवल आपके डोमेन पर ही रहे। यह सब आपकी ऑनलाइन दुनिया की पवित्रता बनाए रखने और यह सुनिश्चित करने के बारे में है कि आपकी मेहनत का लाभ केवल मानव आगंतुकों को ही मिले।.

अपने डिजिटल आश्रय को सुरक्षित रखने के उद्देश्य से, याद रखें, "एक मजबूत द्वार यह सुनिश्चित करता है कि केवल स्वागत करने वाले ही भीतर के बगीचे की सुंदरता का आनंद ले सकें।"“

चाबी छीनना

अपनी वेबसाइट को एआई स्क्रैपर्स से सुरक्षित रखना एक निरंतर चलने वाली लड़ाई है जिसके लिए ध्यान और सक्रिय रणनीतियों की आवश्यकता होती है। मैंने पाया है कि robots.txt फ़ाइल को प्रभावी ढंग से कॉन्फ़िगर करना, CAPTCHA सेट करना, ज्ञात एआई स्क्रैपर्स की पहचान करना और उन्हें ब्लॉक करना, इन सभी तरीकों से सुरक्षा सुनिश्चित की जा सकती है। औजार, मेरी सामग्री तक किसकी पहुंच है, इसे नियंत्रित करना और सुरक्षा प्रोटोकॉल को नियमित रूप से अपडेट करना महत्वपूर्ण रणनीतियाँ हैं। कानूनी सुरक्षा उपाय जोड़ने से सुरक्षा की एक और परत जुड़ जाती है, लेकिन सतर्क रहना और तकनीकी रूप से कुशल रहना ही मेरी सामग्री को सुरक्षित रखने और आगंतुकों के लिए मेरी साइट के महत्व को बनाए रखने का सबसे अच्छा तरीका है।.

अपनी वेबसाइट की सुरक्षा व्यवस्था को हमेशा अपडेट रखें, क्योंकि डेटा स्क्रैपिंग के तरीके लगातार उन्नत हो रहे हैं। अपनी सुरक्षा सेटिंग्स की नियमित रूप से समीक्षा करें और अपनी सामग्री को सुरक्षित रखने के लिए नई चुनौतियों का सामना करने के लिए तैयार रहें।.

एआई वेब स्क्रैपिंग को समझना

एआई वेब स्क्रैपिंग के विषय पर चर्चा करते समय, इस प्रक्रिया के नैतिक पहलुओं को समझना अत्यंत महत्वपूर्ण है। मैं संभावित जोखिमों और लाभों का मूल्यांकन करूंगा, और एआई डेटा संग्रह में नैतिक आचरण के लिए एक ढांचा तैयार करूंगा। इसके बाद, मैं उन तकनीकी उपायों पर चर्चा करूंगा जो वेबसाइट मालिकों को अपनी सामग्री को अनधिकृत एआई स्क्रैपिंग से बचाने में मदद कर सकते हैं।.

एआई वेब स्क्रैपिंग के विषय पर चर्चा करते समय, इस प्रक्रिया के नैतिक पहलुओं को समझना अत्यंत महत्वपूर्ण है। मैं संभावित जोखिमों और लाभों का मूल्यांकन करूंगा, और एआई डेटा संग्रह में नैतिक आचरण के लिए एक ढांचा तैयार करूंगा। इसके बाद, मैं उन तकनीकी उपायों पर चर्चा करूंगा जो वेबसाइट मालिकों को अपनी सामग्री को अनधिकृत एआई स्क्रैपिंग से बचाने में मदद कर सकते हैं।.

नैतिक चिंताओं को दूर करना

कृत्रिम बुद्धिमत्ता के नैतिक आयामों को समझना सामग्री स्क्रैपिंग

आपकी वेबसाइट से सामग्री निकालने वाले एआई उपकरणों के नैतिक पहलुओं के बारे में आपको चिंतित क्यों होना चाहिए? इस विषय पर विचार करते समय, डेटा गोपनीयता की जटिलता को समझना अत्यंत महत्वपूर्ण है। अनियंत्रित एआई स्क्रैपिंग से मालिकाना जानकारी का अनधिकृत संग्रह हो सकता है, जिससे सामग्री निर्माताओं के बौद्धिक संपदा अधिकारों का उल्लंघन हो सकता है। डेटा के संग्रहण और उपयोग को नियंत्रित करने वाले कानूनों का पालन करना भी आवश्यक है। इन कानूनों का उद्देश्य व्यक्तियों और कंपनियों को गोपनीयता उल्लंघन और उनकी जानकारी के दुरुपयोग से बचाना है। इन नियमों से अवगत रहना आपकी वेबसाइट की सामग्री को सुरक्षित रखने और प्रौद्योगिकी के विकास के साथ-साथ आपकी प्रक्रियाओं को नैतिक रूप से सही बनाए रखने के लिए आवश्यक है।.

स्क्रैपिंग के लिए प्रतिउपाय

स्वचालित प्रणालियों द्वारा मेरी वेबसाइट से डेटा एकत्र करने से रोकने के लिए, मैं नियमित रूप से robots.txt फ़ाइल में बदलाव करता रहता हूँ। इस सावधानीपूर्वक प्रक्रिया से मुझे यह निर्धारित करने में मदद मिलती है कि मेरी वेबसाइट के कौन से हिस्से GPTBot जैसे बॉट्स के लिए सुलभ हैं। इन निर्देशों को लगातार अपडेट करके, मैं स्वचालित उपकरणों द्वारा अनधिकृत रूप से डेटा निकालने से अपनी वेबसाइट की सामग्री की रक्षा करता हूँ।.

ऐसा करके, मैं केवल एक तकनीकी प्रक्रिया का पालन नहीं कर रहा हूँ; मैं उस जानकारी के मूल्य और गोपनीयता की रक्षा के लिए प्रतिबद्ध हूँ जिसे बनाने में मैंने बहुत मेहनत की है। वेबमास्टर के रूप में, हमें सतर्क और सक्रिय रहना चाहिए ताकि हमारे डिजिटल संसाधनों के उपयोगकर्ताओं के भरोसे को सुरक्षित रखा जा सके और उन्हें किसी भी प्रकार की सुरक्षा से वंचित न किया जा सके।.

याद रखें, एक सुव्यवस्थित robots.txt फ़ाइल डेटा स्क्रैपर्स के लगातार प्रयासों के खिलाफ बचाव की एक सरल लेकिन प्रभावी परत है।.

Robots.txt को नियमित रूप से अपडेट करें

अपनी वेबसाइट की सामग्री की सुरक्षा बनाए रखने के लिए, नियमित रूप से अपनी robots.txt फ़ाइल की समीक्षा और उसे अपडेट करना आवश्यक है। मैं इसे प्रभावी ढंग से इस प्रकार करता हूँ:

- अपडेट के लिए एक नियमित समय सारिणी निर्धारित करें।.

- अपनी साइट के किन हिस्सों तक उपयोगकर्ता एजेंट (जैसे वेब क्रॉलर) पहुंच सकते हैं, यह निर्दिष्ट करने के लिए सर्वोत्तम तरीकों का उपयोग करें।.

- संभावित सुरक्षा जोखिमों से बचने के लिए एआई स्क्रैपिंग टूल्स में हो रहे नवीनतम विकास पर नजर रखें।.

- अनधिकृत पहुंच से अपनी सामग्री की सुरक्षा सुनिश्चित करने के लिए प्रतिबंधित मार्गों में आवश्यक समायोजन करें।.

आपको अपनी Robots.txt फ़ाइल को अपडेट करने की आवश्यकता क्यों है?

अपनी robots.txt फ़ाइल को अपडेट करना आपकी वेबसाइट को सुरक्षित रखने का एक सरल लेकिन शक्तिशाली तरीका है। यह सर्च इंजन और अन्य वेब क्रॉलर को बताता है कि आपकी साइट के किन पेजों या सेक्शन तक नहीं पहुँचा जाना चाहिए। सूचीबद्ध. इससे अवांछित डेटा स्क्रैपिंग को रोकने में मदद मिल सकती है और यह आपकी साइट की सामग्री की सुरक्षा के लिए एक व्यापक रणनीति का हिस्सा हो सकता है।.

ध्यान रखें, जैसे-जैसे नए प्रकार के वेब क्रॉलर सामने आते हैं, सतर्क रहना और अपनी robots.txt फ़ाइल को अपडेट करना एक समझदारी भरा कदम है। एक सुव्यवस्थित robots.txt फ़ाइल आपकी वेबसाइट की समग्र सुरक्षा रणनीति के लिए अत्यंत महत्वपूर्ण है।.

Robots.txt का प्रभावी ढंग से उपयोग करना

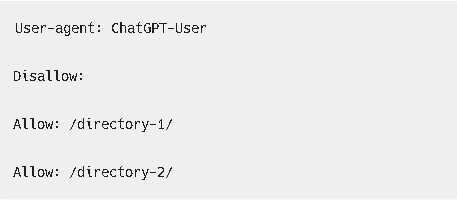

अपनी वेबसाइट को अवांछित स्वचालित डेटा संग्रह से बचाने के लिए, आइए robots.txt फ़ाइल को सावधानीपूर्वक अपडेट करने के बारे में चर्चा करें। आप विशिष्ट उपयोगकर्ता-एजेंट नियम बनाकर OpenAI के GPTBot जैसे कुछ वेब क्रॉलर को अपनी साइट की सामग्री तक पहुँचने या उसे अनदेखा करने का निर्देश दे सकते हैं। इन मापदंडों को ध्यानपूर्वक सेट करके, आप यह सटीक नियंत्रण प्राप्त कर सकते हैं कि आपकी साइट के किन हिस्सों को विभिन्न AI सिस्टम द्वारा अनुक्रमित किया जा सकता है या अनदेखा किया जा सकता है।.

अपनी वेबसाइट को अवांछित स्वचालित डेटा संग्रह से बचाने के लिए, आइए robots.txt फ़ाइल को सावधानीपूर्वक अपडेट करने के बारे में चर्चा करें। आप विशिष्ट उपयोगकर्ता-एजेंट नियम बनाकर OpenAI के GPTBot जैसे कुछ वेब क्रॉलर को अपनी साइट की सामग्री तक पहुँचने या उसे अनदेखा करने का निर्देश दे सकते हैं। इन मापदंडों को ध्यानपूर्वक सेट करके, आप यह सटीक नियंत्रण प्राप्त कर सकते हैं कि आपकी साइट के किन हिस्सों को विभिन्न AI सिस्टम द्वारा अनुक्रमित किया जा सकता है या अनदेखा किया जा सकता है।.

Robots.Txt को सही ढंग से संपादित करें

अपनी वेबसाइट को अनचाहे AI-आधारित डेटा स्क्रैपिंग से सुरक्षित रखने के लिए, robots.txt फ़ाइल को सावधानीपूर्वक प्रबंधित करना अत्यंत महत्वपूर्ण है। यह कदम आपकी वेबसाइट के डेटा की गोपनीयता बनाए रखने और डेटा संग्रहण कानूनों का अनुपालन करने के लिए मूलभूत है। इसे प्रभावी ढंग से करने के लिए मेरी मार्गदर्शिका यहाँ दी गई है:

- फ़ाइल ढूंढेंसबसे पहले, मैंने अपनी वेबसाइट के सर्वर में लॉग इन किया और वहां पहले से मौजूद robots.txt फ़ाइल को खोजा।.

- वर्तमान नियमों की समीक्षा करेंइसके बाद, मैं फाइल को ध्यान से देखता हूं ताकि मौजूदा नियमों और उनका मेरी साइट के लिए क्या मतलब है, इसे पूरी तरह से समझ सकूं।.

- केयर के साथ अपडेट करेंबारीकियों पर ध्यान देते हुए, मैं एआई सिस्टम क्या कर सकते हैं और क्या नहीं कर सकते, यह निर्दिष्ट करने के लिए नियमों को समायोजित करता हूं या नए नियम जोड़ता हूं, 'Disallow:' का उपयोग ब्लॉक करने के लिए और 'Allow:' का उपयोग एक्सेस देने के लिए करता हूं।.

- संशोधनों को सत्यापित करेंएक बार बदलाव कर लेने के बाद, मैं अपडेटेड robots.txt को टेस्टर्स के माध्यम से चलाकर यह सुनिश्चित करता हूं कि नियम सही ढंग से लिखे गए हैं और इच्छानुसार काम कर रहे हैं।.

इन चरणों का सावधानीपूर्वक पालन करके, मैं अपनी robots.txt फ़ाइल को अपडेट करता हूँ ताकि मेरी साइट सुरक्षित रहे और साथ ही साथ सभी उपयोगकर्ताओं का स्वागत भी हो। खोज इंजन जो लोगों को मेरी सामग्री ढूंढने में मदद करते हैं।.

कैप्चा सत्यापन लागू करना

अब हम कैप्चा सत्यापन पर ध्यान केंद्रित करते हैं, यह विधि अनधिकृत स्वचालित डेटा संग्रहण के खिलाफ एक ठोस अवरोध का काम करती है। यह वास्तविक मानवीय गतिविधि को अनधिकृत गतिविधि से अलग करके काम करती है। स्वचालित सॉफ़्टवेयर, यह अवांछित बॉट्स को प्रभावी ढंग से ब्लॉक करता है जबकि वास्तविक उपयोगकर्ताओं को एक्सेस की अनुमति देता है। हालांकि, कैप्चा को शामिल करते समय, उपयोगकर्ता इंटरैक्शन पर इसके संभावित प्रभावों पर विचार करना महत्वपूर्ण है। सही संतुलन बनाना यह सुनिश्चित करने की कुंजी है कि आपकी वेबसाइट उपयोगकर्ता के अनुकूल बनी रहे।.

कैप्चा की प्रभावशीलता

कैप्चा जांच को शामिल करना मेरी वेबसाइट को अनधिकृत पहुंच से बचाने की एक ठोस रणनीति है। सामग्री स्क्रैपिंग स्वचालित उपकरणों द्वारा। प्रभावी उपाय होने के बारे में मेरा दृष्टिकोण यह है:

- जटिल चुनौतियाँ: जटिल कैप्चा जटिल पहेलियाँ प्रस्तुत करते हैं जिन्हें स्वचालित मशीनों द्वारा हल करना कठिन होता है। लेकिन फिर भी लोगों के लिए प्रबंधनीय हैं।.

- निरंतर अपडेट: CAPTCHA एल्गोरिदम को बार-बार अपडेट करके, वे AI की प्रगति को मात दे सकते हैं, जो अन्यथा अपरिवर्तनीय प्रणालियों को दरकिनार कर सकती है।.

- स्तरित सुरक्षाजब कैप्चा का उपयोग अन्य सुरक्षा उपायों के साथ किया जाता है, तो यह अनधिकृत पहुंच के खिलाफ एक मजबूत अवरोध पैदा करता है।.

- सतर्कता: कैप्चा के प्रदर्शन और सफलता दर की निगरानी करने से यह संकेत मिल सकता है कि कब समायोजन या सुधार करने का समय आ गया है।.

हालांकि कैप्चा जोड़ने से सुरक्षा मजबूत होती है, मैं हमेशा नैतिक पहलू का ध्यान रखता हूं और उपयोगकर्ताओं पर इसके प्रभाव को यथासंभव कम रखने का प्रयास करता हूं। मजबूत सुरक्षा और उपयोगकर्ता की सुगमता के बीच सही संतुलन बनाना एक सावधानीपूर्वक और निरंतर चलने वाला कार्य है।.

उपयोगकर्ता अनुभव प्रभाव

CAPTCHA चेक लगाते समय, मुझे इस बात का पूरा एहसास है कि ये कभी-कभी उपयोगकर्ताओं को परेशान कर सकते हैं, भले ही ये AI का उपयोग करके कंटेंट स्क्रैप करने वाले बॉट्स को रोकने में कारगर हों। मेरे आकलन से पता चलता है कि CAPTCHA इन बॉट्स को दूर रखने में प्रभावी हैं, जिससे वेबसाइट पर आने वाले लोगों की संख्या को नियंत्रित करने में मदद मिलती है और बिना अनुमति के कंटेंट कॉपी होने की संभावना कम हो जाती है। फिर भी, अपनी साइट पर आने वाले लोगों को दूर भगाने से बचने के लिए इस टूल का समझदारी से उपयोग करना महत्वपूर्ण है। यह सब कंटेंट को आसानी से सुलभ बनाने और उसे AI द्वारा अनधिकृत स्क्रैपिंग से बचाने के बीच सही संतुलन बनाने के बारे में है। बहुत अधिक CAPTCHA टेस्ट बॉट्स के साथ-साथ उतने ही वास्तविक उपयोगकर्ताओं को भी दूर भगा सकते हैं। मैं CAPTCHA का उपयोग उन क्षेत्रों में करता हूँ जहाँ स्क्रैपिंग होने की सबसे अधिक संभावना होती है, जबकि साइट के बाकी हिस्से को उपयोगकर्ता के अनुकूल रखता हूँ। मेरा लक्ष्य साइट पर आने वाले लोगों को एक बेहतरीन अनुभव प्रदान करना है, साथ ही साइट के कंटेंट को AI द्वारा किसी भी अनधिकृत स्क्रैपिंग से सुरक्षित रखना है।.

विशिष्ट एआई क्रॉलरों को अवरुद्ध करना

वेबसाइट संचालक होने के नाते, मेरे पास ओपनएआई के जीपीटीबॉट जैसे कुछ एआई क्रॉलर को ब्लॉक करने की क्षमता है, ताकि वे मेरी साइट से सामग्री की नकल न कर सकें। यह कदम न केवल मेरी सामग्री के अनधिकृत संग्रह को रोकने के बारे में है, बल्कि सामग्री के उपयोग से संबंधित नैतिक मानकों और कानूनी नियमों का सम्मान करने के बारे में भी है। मैं इसे इस प्रकार करता हूँ:

- संशोधित

robots.txtमैं इस फ़ाइल को एआई क्रॉलर के लिए विशिष्ट निर्देशों के साथ समायोजित करता हूं, जिसमें यह बताया गया है कि मेरी साइट के किन हिस्सों तक उनकी पहुंच प्रतिबंधित है।.

उपयोगकर्ता-एजेंट: जीपीटीबॉट

अनुमति न दें: /

उपयोगकर्ता-एजेंट: चैटजीपीटी-उपयोगकर्ता

अनुमति न दें: /

उपयोगकर्ता-एजेंट: CCBot

अनुमति न दें: /

- सर्वर लॉग की जाँच करेंमैं अपने सर्वर के लॉग की जांच करना अपनी दिनचर्या का हिस्सा बनाता हूं ताकि किसी भी ऐसी एआई क्रॉलर गतिविधि का पता लगा सकूं जो असामान्य प्रतीत होती हो।.

- कैप्चा सेट अप करेंमेरी वेबसाइट के जिन हिस्सों पर उपयोगकर्ता इंटरैक्ट करते हैं, वहां मैं कैप्चा का उपयोग करता हूं। ये परीक्षण असली लोगों को स्वचालित बॉट्स से अलग करने में बहुत कारगर हैं।.

- कुछ आईपी पतों को ब्लॉक करेंजब मुझे जरूरत होती है, तो मैं उन आईपी पतों को ब्लॉक कर देता हूं जिनके बारे में मुझे पता है कि वे एआई क्रॉलर से जुड़े हैं ताकि उन्हें मेरी साइट से दूर रखा जा सके।.

इन सब चीजों को करके, मैं अपनी सामग्री की सुरक्षा करता हूं और यह सुनिश्चित करता हूं कि मैं डेटा गोपनीयता और बौद्धिक संपदा से संबंधित नियमों का पालन कर रहा हूं।.

सामग्री की पहुंच का प्रबंधन

अनधिकृत स्क्रैपिंग से अपनी वेबसाइट की सामग्री की सुरक्षा करना

कंटेंट स्क्रैपिंग की चिंताओं को दूर करने के लिए, आइए जानें कि आपकी वेबसाइट के कंटेंट तक कौन पहुंच सकता है, इसे नियंत्रित करने के प्रभावी तरीके क्या हैं। बॉट की पहुंच को रोकना बेहद ज़रूरी है, और मैं इन स्वचालित प्रणालियों को आपकी साइट की सामग्री को कॉपी करने या इंडेक्स करने से रोकने के लिए विशिष्ट तकनीकों की रूपरेखा प्रस्तुत करूंगा। इसमें तकनीकी बदलाव और एक्सेस कंट्रोल उपायों की सावधानीपूर्वक सेटिंग शामिल होगी।.

अपनी वेबसाइट की सामग्री की सुरक्षा करना

वेबसाइट चलाने वालों के लिए, अपनी सामग्री को गोपनीय रखना और स्वचालित स्क्रैपिंग सिस्टम से सुरक्षित रखना एक महत्वपूर्ण चिंता का विषय है। विशिष्ट तकनीकी उपायों को लागू करने से आपको यह नियंत्रित करने में मदद मिल सकती है कि आपकी वेबसाइट की सामग्री तक कौन पहुंच सकता है और उसे इंडेक्स कर सकता है।.

आप अपनी robots.txt फ़ाइल में बदलाव करने पर विचार कर सकते हैं। खोज इंजन को निर्देश देने वाली फ़ाइल यह सिस्टम बॉट्स को आपकी साइट के उन हिस्सों तक पहुँचने से रोकता है जिन्हें एक्सेस नहीं किया जाना चाहिए। CAPTCHA सिस्टम का उपयोग करके बॉट्स को रोका जा सकता है, जिससे मानव उपयोगकर्ताओं को कोई परेशानी नहीं होती। अधिक परिष्कृत दृष्टिकोण के लिए, आप वैध आगंतुकों और संभावित स्क्रैपर्स के बीच अंतर करने के लिए सर्वर-साइड जाँच लागू कर सकते हैं।.

याद रखें, आपकी सामग्री की अखंडता और विशिष्टता सर्वोपरि है। अपनी साइट को सुरक्षित करने के लिए सक्रिय कदम उठाकर, आप अपनी सामग्री और उसके वितरण पर नियंत्रण बनाए रखते हैं। आखिरकार, आपके द्वारा बनाई गई सामग्री आपके ब्रांड का प्रतिबिंब है और इसकी सावधानीपूर्वक सुरक्षा की जानी चाहिए।.

बॉट की पहुंच सीमित करना

बॉट की पहुंच सीमित करना

मैंने पाया है कि कुछ विशिष्ट कदम उठाने से स्वचालित प्रणालियों द्वारा मेरी साइट से सामग्री चुराने का जोखिम काफी कम हो जाता है। मैं इस प्रक्रिया को इस प्रकार अपनाता हूँ:

- Robots.txt को समायोजित करनामैं अपने को बेहतर बनाता हूँ

robots.txtबॉट की पहुंच को नियंत्रित करने के लिए फाइल बनाएं, जिसमें स्क्रैपिंग के कानूनी पहलुओं और डेटा गोपनीयता संबंधी चिंताओं को ध्यान में रखा जाए।. - दर सीमा लागू करनाअपने सर्वर पर दर सीमा लागू करके, मैं बॉट ट्रैफिक के संभावित विघटनकारी प्रभावों को कम कर सकता हूँ।.

- एपीआई नियंत्रण लागू करनामैं एपीआई के माध्यम से आवश्यकतानुसार ही कम से कम जानकारी साझा करता हूं और प्रवेश को प्रतिबंधित करने के लिए उचित प्रमाणीकरण की आवश्यकता होती है।.

- कंटेंट डिलीवरी नेटवर्क का उपयोग करनाबॉट प्रबंधन क्षमताओं से लैस सीडीएन का उपयोग करने से मुझे यह प्रबंधित करने की सुविधा मिलती है कि मेरी सामग्री तक कौन पहुंच सकता है और इसे प्रभावी ढंग से सुरक्षित रख सकता है।.

इन कदमों को उठाने से स्वचालित उपकरणों द्वारा सामग्री की अनधिकृत कटाई के खिलाफ एक मजबूत सुरक्षा कवच बनता है।.

सामग्री स्क्रैपिंग रोकथाम

मेरे अपडेट करने के बाद robots.txt अब मैं कंटेंट स्क्रैपिंग को रोकने के उपायों पर ध्यान केंद्रित कर रहा हूं, ताकि मेरी वेबसाइट सुलभ होने के साथ-साथ सुरक्षित भी बनी रहे। मैं स्क्रैपिंग के तकनीकी पहलुओं, इसके कानूनी परिणामों और उन्नत एआई स्क्रैपिंग विधियों से उपयोगकर्ता डेटा की सुरक्षा के महत्व का अध्ययन कर रहा हूं।.

| रणनीति | विवरण |

|---|---|

| परिवर्तनीय सामग्री वितरण | स्वचालित उपकरणों को मानव आगंतुकों से भिन्न सामग्री प्रदान करें।. |

| उपयोगकर्ता गतिविधि निगरानी | खरोंचने का संकेत देने वाले व्यवहारों की जांच करें।. |

| पहुँच प्रतिबंध | उपयोगकर्ता कितनी बार सामग्री तक पहुंच सकते हैं, इसे नियंत्रित करें और संदिग्ध आईपी पतों को ब्लॉक करें।. |

इन रणनीतियों को सावधानीपूर्वक लागू करके, मैं न केवल अपनी वेबसाइट की सामग्री की सुरक्षा कर रहा हूँ, बल्कि उपयोगकर्ता की जानकारी को भी गोपनीय और सुरक्षित रख रहा हूँ। यह मेरी वेबसाइट की सामग्री को प्रबंधित करने और स्वचालित उपकरणों द्वारा अनधिकृत पहुँच या दुरुपयोग को रोकने की एक सुनियोजित योजना है।.

इन रणनीतियों को अपनाना उन लोगों से आगे रहने का एक समझदारी भरा तरीका है जो आपकी मेहनत का दुरुपयोग करने की कोशिश कर सकते हैं। यह एक परिष्कृत अलार्म सिस्टम लगाने जैसा है जो न केवल घुसपैठियों पर नज़र रखता है बल्कि आपके मेहमानों की निजता का भी सम्मान करता है। संभावित खतरों के सामने प्रतिक्रिया देने के बजाय सक्रिय रहना ही इसका मूलमंत्र है।.

सुरक्षा उपायों को नियमित रूप से अपडेट करना

शुरुआती सुरक्षा उपाय जैसे कि robots.txt में बदलाव करना या CAPTCHA जोड़ना एक अच्छी शुरुआत है, लेकिन कंटेंट स्क्रैप करने वाले उन्नत AI टूल्स से प्रभावी ढंग से बचाव के लिए, अपनी वेबसाइट की सुरक्षा रणनीतियों को लगातार अपडेट करना बेहद ज़रूरी है। तकनीकी जगत लगातार बदल रहा है, AI की क्षमताएं अधिक परिष्कृत होती जा रही हैं और कभी-कभी पुरानी सुरक्षा विधियों को भी मात दे देती हैं। इसलिए, अपनी वेबसाइट की सुरक्षा बनाए रखने के लिए एक रणनीतिक, तकनीकी रूप से कुशल और व्यवस्थित दृष्टिकोण की आवश्यकता है।.

मेरी रणनीति यह है:

- नियमित सुरक्षा समीक्षामैं नियमित अंतराल पर सुरक्षा जांच करना अपना कर्तव्य मानता हूं ताकि किसी भी उभरती हुई कमजोरियों का पता लगा सकूं और यह सुनिश्चित कर सकूं कि मेरे सुरक्षा उपाय अद्यतन और प्रभावी हैं।.

- नवीनतम अपडेट से अवगत रहनामैं नवीनतम सुरक्षा अपडेट्स से अवगत रहता हूं और यह सुनिश्चित करता हूं कि मेरी साइट के सभी सॉफ्टवेयर तत्व अद्यतन हों।.

- सुरक्षा उपायों को अपनानामैं विशिष्ट खतरों से निपटने के लिए अपनी सुरक्षा सेटिंग्स को समायोजित करता हूं, जिससे सामग्री की सुरक्षा और यह सुनिश्चित करने के बीच एक स्वस्थ संतुलन बनाए रखने में मदद मिलती है कि यह सही कारणों से सुलभ हो।.

- ट्रैफ़िक विश्लेषण और रिपोर्टिंगमेरी साइट पर आने वाले ट्रैफिक पर नजर रखकर और एक्सेस लॉग की बारीकी से जांच करके, मैं संदिग्ध व्यवहार की तुरंत पहचान कर सकता हूं और उस पर कार्रवाई कर सकता हूं जो एआई स्क्रैपिंग के प्रयास का संकेत दे सकता है।.

अपनी वेबसाइट की सुरक्षा सुनिश्चित करना कोई आसान काम नहीं है; यह दुर्भावनापूर्ण इरादों वाले लोगों से लगातार बचाव करने की चुनौती है। सुरक्षा के प्रति सतर्क और सक्रिय रहकर, मैं न केवल अपनी साइट की सामग्री बल्कि उस पर आने वाले लोगों की गोपनीयता की भी रक्षा कर रहा हूँ।.

कानूनी सुरक्षा उपायों की खोज

कानूनी पेचीदगियों को समझते हुए, मैं अपनी वेबसाइट की सुरक्षा के लिए अनधिकृत एआई स्क्रैपिंग के खिलाफ कॉपीराइट कानूनों और विनियमों की जांच कर रहा हूं। यह समझना बेहद जरूरी है कि राष्ट्रीय और अंतरराष्ट्रीय कॉपीराइट कानून मेरी साइट पर मौजूद सामग्री को कैसे प्रभावित करते हैं। मैंने डिजिटल मिलेनियम कॉपीराइट एक्ट (डीएमसीए) की भी समीक्षा की है ताकि यह देख सकूं कि यह एआई-आधारित उल्लंघनों से मेरी सामग्री की रक्षा कैसे कर सकता है।.

एआई टूल्स के उपयोग की शर्तों का आकलन करना एक ज़िम्मेदार कदम है ताकि यह सुनिश्चित किया जा सके कि वे वेबसाइटों से डेटा का उपयोग और संग्रह करने के अपने अधिकारों का दुरुपयोग न करें। इस बारीकी पर ध्यान देना मेरी साइट के उपयोगकर्ता अनुभव को बनाए रखने और मेरी सामग्री के दुरुपयोग को रोकने के लिए महत्वपूर्ण है, जिससे मेरे ब्रांड का प्रभाव कम हो सकता है और आगंतुकों की सहभागिता घट सकती है।.

इसके अलावा, मैं सख्त एक्सेस कंट्रोल लागू करने और स्क्रैपिंग के प्रयासों की पहचान करने और उन्हें रोकने के लिए लगातार ट्रैफिक विश्लेषण जैसी तकनीकी रणनीतियों पर भी विचार कर रहा हूं। कानूनी उपायों और तकनीकी सुरक्षा उपायों का संयोजन मेरी वेबसाइट की विशिष्टता को बनाए रखने और इसके पीछे की रचनात्मक मेहनत की रक्षा करने की मेरी योजना है।.

अक्सर पूछे जाने वाले प्रश्नों

अगर मैं एआई टूल्स को अपनी वेबसाइट से डेटा स्क्रैप करने से रोक दूं, तो क्या इससे गूगल या बिंग जैसे अन्य सर्च इंजनों पर मेरी साइट की दृश्यता या रैंकिंग पर असर पड़ेगा?

मैं इस बात पर विचार कर रहा हूँ कि क्या एआई टूल्स को मेरी वेबसाइट से डेटा स्क्रैप करने से रोकने से मेरी साइट के प्रदर्शन में कोई बदलाव आ सकता है। गूगल जैसे खोज इंजन या बिंग। ऑनलाइन दृश्यता के बारे में किसी भी भ्रम को दूर करना महत्वपूर्ण है; ये सर्च इंजन रैंकिंग के लिए अद्वितीय एल्गोरिदम का उपयोग करते हैं।. वे पूरी तरह से एआई टूल्स द्वारा इंडेक्सिंग पर निर्भर नहीं हैं। मेरा लक्ष्य अपनी सामग्री को सुरक्षित रखना और साथ ही रैंकिंग में अच्छी स्थिति बनाए रखना है। खोज परिणाम. व्यवहार में, इसका अर्थ है मेरी सुरक्षा के बीच सावधानीपूर्वक संतुलन बनाना। वेबसाइट की सामग्री और बेहतर एसईओ हासिल करना परिणाम।.

अपनी वेबसाइट के ट्रैफिक का विश्लेषण करते समय मैं वैध सर्च इंजन क्रॉलर और एआई स्क्रैपर के बीच अंतर कैसे कर सकता हूँ?

मेरे डेटा को देखते समय वैध सर्च इंजन क्रॉलर और अनधिकृत एआई स्क्रैपर के बीच अंतर करने के लिए वेबसाइट का ट्रैफ़िक, मैं उपयोगकर्ता व्यवहार के उन पैटर्नों का बारीकी से अध्ययन करता हूँ जो स्वचालित इंटरैक्शन का संकेत दे सकते हैं। संभावित रूप से हानिकारक ट्रैफ़िक को रोकने के लिए, मैं आईपी ब्लॉकिंग तकनीकों का उपयोग करता हूँ। मैं बॉट डिटेक्शन टूल का भी लाभ उठाता हूँ, जो मुझे अनधिकृत बॉट्स की पहचान करने और उन्हें नियंत्रित करने में सहायता करते हैं। ये उपाय मेरी सामग्री की सुरक्षा सुनिश्चित करने के साथ-साथ यह भी सुनिश्चित करते हैं कि मेरी साइट विश्वसनीय उपयोगकर्ताओं के लिए सुलभ बनी रहे। खोज इंजन.

असली और नकली ट्रैफ़िक के बीच का अंतर समझना यह सुनिश्चित करता है कि मेरी वेबसाइट का विश्लेषण सटीक रहे और मेरी सामग्री गलत हाथों में न पड़े। एक वेबसाइट मालिक के रूप में, अपनी डिजिटल संपत्ति को सुरक्षित रखना मेरी ज़िम्मेदारी है, ठीक वैसे ही जैसे कोई व्यक्ति किसी भौतिक दुकान को चोरों से बचाता है। इन रणनीतियों को अपनाकर, मैं आत्मविश्वास से अपनी वेबसाइट के ट्रैफ़िक को प्रबंधित कर सकता हूँ और उसकी अखंडता बनाए रख सकता हूँ।.

यदि मुझे पता चलता है कि मेरी अनुमति के बिना किसी एआई टूल द्वारा मेरी सामग्री का उपयोग कर लिया गया है, तो मुझे क्या कदम उठाने चाहिए?

यदि मुझे पता चलता है कि मेरी सामग्री का उपयोग मेरी सहमति के बिना किसी एआई टूल द्वारा किया गया है, तो पहला कदम इस उल्लंघन के प्रत्येक उदाहरण को सावधानीपूर्वक रिकॉर्ड करना है। इसके बाद, मैं जिम्मेदार पक्ष से संपर्क करके या आवश्यकता पड़ने पर डीएमसीए टेकडाउन अनुरोध जारी करके अपनी सामग्री को पुनः प्राप्त करने का प्रयास करूंगा। यदि इन उपायों से समस्या का समाधान नहीं होता है, तो कानूनी कार्रवाई पर विचार करना एक विकल्प है। इसके अतिरिक्त, एआई टूल्स के नैतिक उपयोग को बढ़ावा देने के लिए, मेरी रचना के अनधिकृत उपयोग के बारे में जनता को सूचित करना लाभकारी है। ऑनलाइन अपने रचनात्मक अधिकारों की रक्षा के लिए सतर्कता और तत्काल कार्रवाई महत्वपूर्ण हैं।.

याद रखें: अपनी रचनात्मक कृति की रक्षा करना केवल एक अधिकार नहीं है; यह एक जिम्मेदारी भी है।.

क्या मेरी सामग्री पर वॉटरमार्क लगाने के लिए कोई उद्योग मानक या सर्वोत्तम प्रथाएं हैं, जिससे यह संकेत मिले कि इसका उपयोग एआई मॉडल को प्रशिक्षित करने के लिए नहीं किया जाना चाहिए?

मैं वर्तमान में एआई मॉडल के प्रशिक्षण में अनधिकृत उपयोग से अपनी सामग्री की सुरक्षा के तरीकों की समीक्षा कर रहा हूँ। एक तरीका डिजिटल वॉटरमार्किंग और कंटेंट फिंगरप्रिंटिंग का उपयोग करना है, जो मेरी सामग्री में अदृश्य चिह्न या विशिष्ट कोड सम्मिलित करता है। उपयोग संबंधी स्पष्ट नीतियों के साथ, ये रणनीतियाँ इस बात का संकेत देती हैं कि मेरी सामग्री का उपयोग एआई मॉडल के प्रशिक्षण के लिए नहीं किया जाना चाहिए। समुदाय अभी भी इस विषय पर सामान्य दिशा-निर्देशों के एक समूह की दिशा में काम कर रहा है, इसलिए मैं अपनी सामग्री की उचित सुरक्षा सुनिश्चित करने के लिए नवीनतम रणनीतियों से अवगत रहता हूँ।.

“ऐसे युग में जहां डेटा लगातार एल्गोरिदम में फीड किया जाता है, बौद्धिक संपदा की रक्षा करना रचनाकारों के लिए एक साझा चिंता का विषय है। सक्रिय रहना और जानकारी रखना बुद्धिमानी है।”

यदि एआई उपकरण कैप्चा को बायपास करने की क्षमता विकसित कर लेते हैं, तो मुझे अपनी वेबसाइट को अनधिकृत डेटा निष्कर्षण से बचाने के लिए अधिक परिष्कृत सुरक्षा रणनीतियों को अपनाना होगा। एक प्रभावी तरीका यह है: व्यवहारिक बायोमेट्रिक्स, यह साइट के साथ उपयोगकर्ताओं की बातचीत में होने वाली अनियमितताओं पर नज़र रखता है। इससे मानव आगंतुकों और संभावित स्वचालित स्क्रैपरों के बीच अंतर करने में मदद मिल सकती है।.

सुरक्षा की एक और परत में शामिल है उंगलियों के निशान का विश्लेषण. यह तकनीक किसी डिवाइस और उसके ब्राउज़र की अनूठी विशेषताओं, जैसे कि ऑपरेटिंग सिस्टम, स्क्रीन रिज़ॉल्यूशन और इंस्टॉल किए गए फ़ॉन्ट का मूल्यांकन करती है, ताकि बॉट गतिविधि की विशिष्ट विसंगतियों का पता लगाया जा सके।.

एक कदम आगे रहने के लिए, मैं इसे अमल में लाऊंगा। अनुकूली चुनौतियाँ. ये सुरक्षा जांच हैं जिनकी जटिलता जोखिम के आकलन के आधार पर भिन्न हो सकती है, जिससे एक गतिशील सुरक्षा सुनिश्चित होती है जो खतरे के स्तर के अनुसार समायोजित होती है। इन उन्नत विधियों को अपनाकर, मैं नवीनतम एआई-आधारित स्क्रैपिंग टूल के विरुद्ध अपनी वेबसाइट की सुरक्षा को काफी मजबूत कर सकता हूं।.

वर्ल्ड वाइड वेब के संदर्भ में एआई स्क्रैपिंग सुरक्षा क्या है?

एआई स्क्रैपिंग सुरक्षा से तात्पर्य उन विधियों और तकनीकों से है जिनका उपयोग स्वचालित बॉट्स को वेबसाइटों से बिना अनुमति के डेटा एकत्र करने या स्क्रैप करने से रोकने के लिए किया जाता है। ये तकनीकें कृत्रिम बुद्धिमत्ता की क्षमताओं का उपयोग करके ऐसी गतिविधियों का पता लगाती हैं, उनकी पहचान करती हैं और उन्हें अवरुद्ध करती हैं।.

इंटरनेट पर बौद्धिक संपदा के लिए एआई स्क्रैपर खतरा क्यों हैं?

एआई स्क्रैपर्स एक खतरा पैदा करते हैं क्योंकि वे वेब पर प्रकाशित बड़ी मात्रा में गोपनीय जानकारी को तेजी से और कुशलतापूर्वक एकत्र कर सकते हैं। इस डेटा में कॉपीराइट सामग्री, व्यापारिक रहस्य, डेटाबेस या अन्य डिजिटल संपत्तियां शामिल हो सकती हैं जिनका उपयोग केवल मूल वेबसाइट पर ही किया जाना चाहिए।.

एआई स्क्रैपर कैसे काम करता है?

एक एआई स्क्रैपर मानव ब्राउज़िंग व्यवहार का अनुकरण करके काम करता है। यह वेब पेजों पर जाता है, पूर्वनिर्धारित मानदंडों के आधार पर प्रासंगिक जानकारी की पहचान करता है, और फिर इस डेटा को अन्य उपयोग के लिए निकालता है। इन उपकरणों की दक्षता में काफी भिन्नता होती है; कुछ जटिल साइट संरचनाओं को नेविगेट करने और बुनियादी स्क्रैपिंग-रोधी उपायों से बचने में सक्षम होते हैं।.

एआई स्क्रैपिंग से सुरक्षा के लिए आमतौर पर किन तकनीकों का उपयोग किया जाता है?

एआई स्क्रैपिंग से सुरक्षा के लिए अक्सर इस्तेमाल की जाने वाली तकनीकों में रेट लिमिटिंग (एक निश्चित समय अवधि के भीतर एक आईपी एड्रेस द्वारा किए जा सकने वाले अनुरोधों की संख्या को सीमित करना), कैप्चा परीक्षण (जो उपयोगकर्ताओं को यह साबित करने के लिए चुनौती देते हैं कि वे इंसान हैं), उपयोगकर्ता एजेंट विश्लेषण (संदिग्ध ब्राउज़र गतिविधि की पहचान करने के लिए), और अधिक उन्नत मशीन लर्निंग एल्गोरिदम शामिल हैं जो बॉट व्यवहार के संकेत देने वाले असामान्य पैटर्न का पता लगा सकते हैं।.

क्या वेब स्क्रैपिंग गतिविधियों से बचाव के लिए कृत्रिम बुद्धिमत्ता का उपयोग किया जा सकता है?

जी हां, वेब स्क्रैपिंग का पता लगाने और उसे रोकने के लिए मशीन लर्निंग एल्गोरिदम जैसे कृत्रिम बुद्धिमत्ता के विभिन्न रूपों का उपयोग किया जा सकता है। ये सिस्टम बॉट के पिछले व्यवहार से सीखते हैं, जिससे वे भविष्य में होने वाले संभावित हमलों का बेहतर अनुमान लगा सकते हैं और उन्हें रोक सकते हैं। वे वास्तविक समय में पता लगाने की तकनीक भी लागू कर सकते हैं, जिससे संदिग्ध बॉट गतिविधि होने पर तुरंत कार्रवाई की जा सके।.

एआई टूल्स द्वारा आपकी वेबसाइट को स्क्रैप होने से बचाने के बारे में मेरे अंतिम विचार।

अपनी वेबसाइट को अनचाहे AI स्क्रैपिंग से सुरक्षित रखना एक निरंतर प्रयास है जिसके लिए सतर्कता आवश्यक है। मैंने पाया है कि robots.txt का समझदारी से उपयोग करना, CAPTCHA लागू करना, पहचाने गए AI स्क्रैपर्स को ब्लॉक करना, सामग्री तक पहुंच को नियंत्रित करना और अपने सुरक्षा उपायों को लगातार अपडेट करना महत्वपूर्ण कदम हैं। हालांकि कानूनी उपाय जोड़ने से सुरक्षा की एक अतिरिक्त परत मिलती है, लेकिन सतर्क रहना और तकनीकी रूप से कुशल होना यह सुनिश्चित करने की कुंजी है कि मेरी सामग्री मेरे नियंत्रण में रहे, जिससे मेरी वेबसाइट की अखंडता और उस पर आने वाले लोगों को मिलने वाला मूल्य बना रहे।.

आधिकारिक संदर्भ

यदि आप एआई क्रॉलर से अपनी वेबसाइटों की सुरक्षा के बारे में और अधिक पढ़ना चाहते हैं, तो मैं आपको निम्नलिखित पोस्ट देखने की सलाह देता हूं:

- ITPro – AI वेब स्क्रैपिंग: अपने व्यवसाय को इससे कैसे बचाएं

- यह लेख एआई वेब स्क्रैपिंग की जटिलताओं और उससे जुड़े जोखिमों पर चर्चा करता है। यह बताता है कि एआई किस प्रकार अधिक गति और सटीकता के साथ डेटा एकत्र कर सकता है और उसका विश्लेषण करके परिणाम उत्पन्न कर सकता है।.

- आईटीप्रो लेख

- लेखकों का संघ – लेखकों के लिए कृत्रिम बुद्धिमत्ता के उपयोग से अपनी रचनाओं की सुरक्षा के लिए व्यावहारिक सुझाव

- यह संसाधन लेखकों और वेबसाइट मालिकों को एआई के उपयोग से अपनी रचनाओं की सुरक्षा करने के लिए व्यावहारिक सलाह प्रदान करता है, जिसमें ओपनएआई के जीपीटीबॉट जैसे एआई वेब क्रॉलर को ब्लॉक करने के लिए robots.txt फ़ाइल का उपयोग करना शामिल है।.

- लेखक संघ के सुझाव

- रिज़ॉल्यूशन डिजिटल – वेबसाइट को सुरक्षित रखें एआई सामग्री स्क्रैपिंग

- यह लेख चैटजीपीटी जैसे एआई टूल द्वारा वेबसाइट को स्क्रैपिंग और अनधिकृत उपयोग से बचाने के सरल तरीके बताता है। इसमें robots.txt फ़ाइलों के उपयोग, कैप्चा कार्यान्वयन और आईपी रेंज ब्लॉक के बारे में चर्चा की गई है।.

- संकल्प डिजिटल गाइड

- ऑक्टोपार्स – ब्रांड सुरक्षा और साइबर सुरक्षा के लिए वेब स्क्रैपिंग

- यह ब्लॉग इस लेख में यह बताया गया है कि वेब स्क्रैपिंग का उपयोग ब्रांड सुरक्षा और साइबर सुरक्षा के लिए कैसे किया जा सकता है। इसमें संभावित उल्लंघनों और कॉपीराइट उल्लंघनों का पता लगाने के लिए वेब स्क्रैपिंग टूल के उपयोग पर चर्चा की गई है।.

- ऑक्टोपार्स लेख

- साइंसडायरेक्ट – एआई वेब स्क्रैपिंग के खिलाफ जंग

- साइंसडायरेक्ट का यह लेख एआई वेब स्क्रैपिंग पर बढ़ती आपत्तियों की पड़ताल करता है, जिसमें एआई में हुई तीव्र प्रगति और पाठ और अन्य डिजिटल सामग्री के विशाल डेटा सेट पर इसके प्रशिक्षण पर प्रकाश डाला गया है।.

- साइंसडायरेक्ट लेख