পোস্টের সারাংশ শুনুন:

আমার ওয়েবসাইটটি একটি যত্ন করে রাখা বাগানের মতো, যেখানে প্রতিটি পরিদর্শকের আগমনে মৌলিক বিষয়বস্তু আরও বিকশিত হয়। তবে, ওয়েবসাইট থেকে তথ্য আহরণে দক্ষ এআই টুলগুলোর অগ্রগতির ফলে, এই অনাকাঙ্ক্ষিত তথ্য আহরণ ঠেকানোর জন্য আমার সাইটের সুরক্ষাব্যবস্থা আরও জোরদার করার প্রয়োজনীয়তা আমি উপলব্ধি করেছি। আমার অভিজ্ঞতার মাধ্যমে আমি যা সংগ্রহ করেছি... আপনার ওয়েবসাইটকে AI স্ক্র্যাপিং থেকে কার্যকরভাবে রক্ষা করার কৌশল. চলুন আপনার সাইটকে সুরক্ষিত রাখার জন্য কিছু পদক্ষেপ দেখে নেওয়া যাক। আমি আপনাকে robots.txt নির্দেশাবলী প্রয়োগ করা, CAPTCHA চ্যালেঞ্জ সেট আপ করা এবং আপনার কন্টেন্ট যেন শুধুমাত্র আপনার ডোমেইনেই থাকে, তা নিশ্চিত করার জন্য অতিরিক্ত পদ্ধতি সম্পর্কে নির্দেশনা দেব। এর মূল উদ্দেশ্য হলো আপনার অনলাইন জগতের পবিত্রতা বজায় রাখা এবং এটা নিশ্চিত করা যে, আপনার কঠোর পরিশ্রমের সুফল যেন মানুষ ভিজিটররাই ভোগ করতে পারে।.

আপনার ডিজিটাল স্বর্গকে সুরক্ষিত রাখার চেতনায়, মনে রাখবেন, "একটি মজবুত গেট নিশ্চিত করে যে কেবলমাত্র স্বাগত ব্যক্তিই ভিতরের বাগানের প্রশংসা করতে পারে।"“

কী Takeaways

এআই স্ক্র্যাপারদের থেকে আমার ওয়েবসাইটকে রক্ষা করা একটি নিরন্তর সংগ্রাম, যার জন্য মনোযোগ এবং সক্রিয় কৌশল প্রয়োজন। আমি দেখেছি যে, আমার robots.txt ফাইল কার্যকরভাবে কনফিগার করা, CAPTCHA সেট আপ করা, এবং পরিচিত এআই স্ক্র্যাপারদের শনাক্ত ও ব্লক করার মাধ্যমে এই সমস্যা থেকে মুক্তি পাওয়া যায়। সরঞ্জাম, আমার কন্টেন্টে কে প্রবেশ করতে পারবে তা নিয়ন্ত্রণ করা এবং নিরাপত্তা প্রোটোকলগুলো নিয়মিত আপডেট করা অত্যন্ত গুরুত্বপূর্ণ কৌশল। আইনি সুরক্ষা যোগ করা আরেকটি প্রতিরক্ষা স্তর প্রদান করে, কিন্তু সতর্ক ও প্রযুক্তিগতভাবে দক্ষ থাকাই আমার কন্টেন্ট সুরক্ষিত রাখার এবং দর্শকদের কাছে আমার সাইটের গুরুত্ব বজায় রাখার সর্বোত্তম উপায়।.

আপনার ওয়েবসাইটের সুরক্ষা ব্যবস্থা হালনাগাদ রাখতে মনে রাখবেন, কারণ ডেটা স্ক্র্যাপিংয়ের পদ্ধতি ক্রমাগত উন্নত হচ্ছে। আপনার কন্টেন্ট সুরক্ষিত রাখতে নিয়মিত আপনার নিরাপত্তা সেটিংস পর্যালোচনা করুন এবং নতুন চ্যালেঞ্জের সাথে মানিয়ে নিতে প্রস্তুত থাকুন।.

এআই ওয়েব স্ক্র্যাপিং বোঝা

যেহেতু আমরা এআই ওয়েব স্ক্র্যাপিংয়ের বিষয়ে আলোচনা করছি, তাই এই অনুশীলনের নৈতিক প্রভাবগুলো অনুধাবন করা অত্যন্ত গুরুত্বপূর্ণ। আমি এর সম্ভাব্য ঝুঁকি ও সুবিধাগুলো মূল্যায়ন করব এবং এআই ডেটা সংগ্রহের ক্ষেত্রে নৈতিক আচরণের একটি কাঠামো প্রতিষ্ঠা নিশ্চিত করব। এরপর, অননুমোদিত এআই স্ক্র্যাপিং থেকে নিজেদের বিষয়বস্তু রক্ষা করতে ইচ্ছুক ওয়েবসাইট মালিকদের জন্য উপলব্ধ প্রযুক্তিগত প্রতিরোধমূলক ব্যবস্থাগুলো নিয়ে আমি আলোচনা করব।.

যেহেতু আমরা এআই ওয়েব স্ক্র্যাপিংয়ের বিষয়ে আলোচনা করছি, তাই এই অনুশীলনের নৈতিক প্রভাবগুলো অনুধাবন করা অত্যন্ত গুরুত্বপূর্ণ। আমি এর সম্ভাব্য ঝুঁকি ও সুবিধাগুলো মূল্যায়ন করব এবং এআই ডেটা সংগ্রহের ক্ষেত্রে নৈতিক আচরণের একটি কাঠামো প্রতিষ্ঠা নিশ্চিত করব। এরপর, অননুমোদিত এআই স্ক্র্যাপিং থেকে নিজেদের বিষয়বস্তু রক্ষা করতে ইচ্ছুক ওয়েবসাইট মালিকদের জন্য উপলব্ধ প্রযুক্তিগত প্রতিরোধমূলক ব্যবস্থাগুলো নিয়ে আমি আলোচনা করব।.

নীতিগত উদ্বেগগুলি দূর করা

AI এর নৈতিক মাত্রা বোঝা বিষয়বস্তু স্ক্রেপিং

আপনার ওয়েবসাইট থেকে এআই টুল দ্বারা কন্টেন্ট সংগ্রহের নৈতিক দিকগুলো নিয়ে আপনার কেন উদ্বিগ্ন হওয়া উচিত? এই বিষয়টি খতিয়ে দেখার সময়, ডেটা গোপনীয়তার জটিলতা বিবেচনা করা অত্যাবশ্যক। অনিয়ন্ত্রিত এআই স্ক্র্যাপিংয়ের ফলে মালিকানাধীন তথ্যের অননুমোদিত সংগ্রহ হতে পারে, যা কন্টেন্ট নির্মাতাদের মেধাস্বত্ব লঙ্ঘন করতে পারে। ডেটা কীভাবে সংগ্রহ ও ব্যবহার করা হয়, তা নিয়ন্ত্রণকারী আইনগুলো মেনে চলাও জরুরি। এই আইনগুলোর লক্ষ্য হলো ব্যক্তি ও সংস্থাগুলোকে গোপনীয়তা লঙ্ঘন এবং তাদের তথ্যের অপব্যবহার থেকে রক্ষা করা। প্রযুক্তির অগ্রগতির সাথে সাথে আপনার ওয়েবসাইটের কন্টেন্ট সুরক্ষিত রাখতে এবং আপনার কার্যক্রম নৈতিকভাবে সঠিক তা নিশ্চিত করতে এই নিয়মকানুনগুলোর সাথে হালনাগাদ থাকা আবশ্যক।.

স্ক্র্যাপিংয়ের প্রতিরোধমূলক ব্যবস্থা

আমার ওয়েবসাইট থেকে স্বয়ংক্রিয় সিস্টেম যাতে ডেটা সংগ্রহ করতে না পারে তার জন্য, আমি robots.txt ফাইলে নিয়মিত সমন্বয় করি। এই সতর্কতামূলক অনুশীলন আমাকে নির্ধারণ করতে সাহায্য করে যে আমার ওয়েবসাইটের কোন অংশগুলি GPTBot-এর মতো বট দ্বারা অ্যাক্সেসযোগ্য। এই নির্দেশাবলী ক্রমাগত আপডেট করার মাধ্যমে, আমি স্বয়ংক্রিয় সরঞ্জাম দ্বারা অননুমোদিত নিষ্কাশন থেকে আমার ওয়েবসাইটের বিষয়বস্তু রক্ষা করি।.

এর মাধ্যমে, আমি শুধু একটি গতানুগতিক নিয়ম অনুসরণ করছি না; বরং আমি আমার কঠোর পরিশ্রমে তৈরি করা তথ্যের মূল্য এবং গোপনীয়তা রক্ষা করার জন্য একটি দৃঢ় অবস্থান নিচ্ছি। ওয়েবমাস্টার হিসেবে, আমাদের ডিজিটাল সম্পদগুলোকে সুরক্ষিত রাখতে আমাদের অবশ্যই সতর্ক ও সক্রিয় হতে হবে, যা ব্যবহারকারীদের আস্থার কেন্দ্রবিন্দু এবং নাগালের বাইরে।.

মনে রাখবেন, একটি সু-রক্ষণাবেক্ষণ করা robots.txt ফাইল হল ডেটা স্ক্র্যাপারদের নিরলস প্রচেষ্টার বিরুদ্ধে প্রতিরক্ষার একটি সহজ কিন্তু কার্যকর স্তর।.

নিয়মিত Robots.txt আপডেট করুন

আপনার ওয়েবসাইটের বিষয়বস্তুর নিরাপত্তা বজায় রাখার অর্থ হলো নিয়মিত আপনার robots.txt ফাইলটি পর্যালোচনা ও আপডেট করা। আমি যেভাবে এটি কার্যকরভাবে করি তা হলো:

- আপডেটের জন্য একটি নিয়মিত সময়সূচী নির্ধারণ করুন।.

- আপনার সাইটের কোন অংশে ব্যবহারকারী-এজেন্ট (যেমন ওয়েব ক্রলার) অ্যাক্সেস করতে পারবে তা নির্দিষ্ট করার জন্য সেরা পদ্ধতিগুলি প্রয়োগ করুন।.

- সম্ভাব্য নিরাপত্তা ঝুঁকি এড়াতে AI স্ক্র্যাপিং টুলের সর্বশেষ উন্নয়নের উপর নজর রাখুন।.

- আপনার কন্টেন্ট যাতে অননুমোদিত অ্যাক্সেস থেকে সুরক্ষিত থাকে তা নিশ্চিত করার জন্য, যেসব পথ নিষিদ্ধ, সেগুলিতে প্রয়োজনীয় সমন্বয় করুন।.

কেন আপনার Robots.txt ফাইলটি আপডেট করবেন?

আপনার ওয়েবসাইটকে সুরক্ষিত রাখার জন্য আপনার robots.txt ফাইল আপডেট করা একটি সহজ কিন্তু শক্তিশালী উপায়। এটি সার্চ ইঞ্জিন এবং অন্যান্য ওয়েব ক্রলারদের বলে যে আপনার সাইটের কোন পৃষ্ঠা বা বিভাগগুলি অ্যাক্সেস করা উচিত নয় বা সূচিবদ্ধ. এটি অনাকাঙ্ক্ষিত স্ক্র্যাপিং প্রতিরোধ করতে সাহায্য করতে পারে এবং আপনার সাইটের বিষয়বস্তু সুরক্ষিত রাখার একটি বৃহত্তর কৌশলের অংশ হতে পারে।.

মনে রাখবেন, নতুন ধরনের ওয়েব ক্রলারের আবির্ভাবের সাথে সাথে সতর্ক থাকা এবং আপনার robots.txt ফাইলকে সে অনুযায়ী পরিবর্তন করা একটি বুদ্ধিমানের কাজ। আপনার ওয়েবসাইটের সামগ্রিক নিরাপত্তা কৌশলের জন্য একটি সুসংরক্ষিত robots.txt ফাইল অত্যন্ত গুরুত্বপূর্ণ।.

Robots.txt কার্যকরভাবে ব্যবহার করা

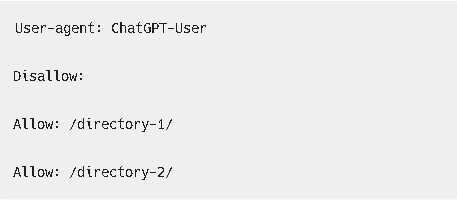

আপনার ওয়েবসাইটকে অনাকাঙ্ক্ষিত স্বয়ংক্রিয় ডেটা সংগ্রহ থেকে রক্ষা করতে, চলুন robots.txt ফাইলটি কীভাবে যত্নসহকারে আপডেট করতে হয় তা নিয়ে আলোচনা করা যাক। নির্দিষ্ট ইউজার-এজেন্ট নিয়ম তৈরি করার মাধ্যমে আপনি OpenAI-এর GPTBot-এর মতো নির্দিষ্ট ওয়েব ক্রলারকে আপনার সাইটের কন্টেন্ট অ্যাক্সেস করতে বা এড়িয়ে যেতে নির্দেশ দিতে পারেন। এই প্যারামিটারগুলো পুঙ্খানুপুঙ্খভাবে সেট করার মাধ্যমে, আপনি আপনার সাইটের কোন অংশগুলো বিভিন্ন এআই সিস্টেম দ্বারা ইনডেক্স করা হবে বা উপেক্ষা করা হবে তার উপর সুনির্দিষ্ট নিয়ন্ত্রণ লাভ করেন।.

আপনার ওয়েবসাইটকে অনাকাঙ্ক্ষিত স্বয়ংক্রিয় ডেটা সংগ্রহ থেকে রক্ষা করতে, চলুন robots.txt ফাইলটি কীভাবে যত্নসহকারে আপডেট করতে হয় তা নিয়ে আলোচনা করা যাক। নির্দিষ্ট ইউজার-এজেন্ট নিয়ম তৈরি করার মাধ্যমে আপনি OpenAI-এর GPTBot-এর মতো নির্দিষ্ট ওয়েব ক্রলারকে আপনার সাইটের কন্টেন্ট অ্যাক্সেস করতে বা এড়িয়ে যেতে নির্দেশ দিতে পারেন। এই প্যারামিটারগুলো পুঙ্খানুপুঙ্খভাবে সেট করার মাধ্যমে, আপনি আপনার সাইটের কোন অংশগুলো বিভিন্ন এআই সিস্টেম দ্বারা ইনডেক্স করা হবে বা উপেক্ষা করা হবে তার উপর সুনির্দিষ্ট নিয়ন্ত্রণ লাভ করেন।.

Robots.Txt সঠিকভাবে সম্পাদনা করুন

আপনার ওয়েবসাইটকে অনাকাঙ্ক্ষিত এআই-চালিত স্ক্র্যাপিং থেকে সুরক্ষিত রাখতে, আপনার robots.txt ফাইলটি যত্ন সহকারে পরিচালনা করা অত্যাবশ্যক। আপনার ওয়েবসাইটের ডেটা গোপন রাখা এবং ডেটা সংগ্রহ সংক্রান্ত আইন মেনে চলার জন্য এই পদক্ষেপটি মৌলিক। এটি কার্যকরভাবে করার জন্য এখানে আমার একটি নির্দেশিকা দেওয়া হলো:

- ফাইলটি খুঁজুনপ্রথমে, আমি আমার ওয়েবসাইটের সার্ভারে লগ ইন করে সেখানে আগে থেকেই থাকা robots.txt ফাইলটি খুঁজলাম।.

- বর্তমান নিয়ম পর্যালোচনা করুন: এরপর, আমি বিদ্যমান নিয়মগুলি এবং আমার সাইটের জন্য সেগুলির অর্থ কী তা সম্পূর্ণরূপে বুঝতে ফাইলটি ঘনিষ্ঠভাবে দেখি।.

- যত্ন সহ আপডেট করুনখুঁটিনাটি বিষয়ের প্রতি মনোযোগ দিয়ে, আমি এআই সিস্টেমগুলো কী করতে পারবে আর কী পারবে না তা নির্দিষ্ট করার জন্য নতুন নিয়ম যোগ করি বা পরিবর্তন করি; এক্ষেত্রে বাধা দেওয়ার জন্য 'Disallow:' এবং অনুমতি দেওয়ার জন্য 'Allow:' ব্যবহার করি।.

- সম্পাদনাগুলি যাচাই করুনপরিবর্তনগুলো করার পর, নিয়মগুলো সঠিকভাবে লেখা হয়েছে এবং উদ্দেশ্য অনুযায়ী কাজ করছে কিনা তা নিশ্চিত করার জন্য আমি আপডেট করা robots.txt ফাইলটি টেস্টারের মাধ্যমে চালাই।.

এই ধাপগুলি সাবধানতার সাথে সম্পাদন করে, আমি আমার robots.txt ফাইলটি আপডেট করি যাতে আমার সাইটটি সুরক্ষিত থাকে এবং একই সাথে সার্চ ইঞ্জিন যা লোকেদের আমার কন্টেন্ট খুঁজে পেতে সাহায্য করে।.

ক্যাপচা যাচাইকরণ বাস্তবায়ন করা হচ্ছে

ক্যাপচা যাচাইকরণের দিকে আমাদের মনোযোগ আকর্ষণ করে, এই পদ্ধতিটি অননুমোদিত স্বয়ংক্রিয় ডেটা সংগ্রহের বিরুদ্ধে একটি শক্ত বাধা হিসেবে কাজ করে। এটি প্রকৃত মানবিক কার্যকলাপকে স্বয়ংক্রিয় সফ্টওয়্যার, এর মাধ্যমে অবাঞ্ছিত বটগুলোকে কার্যকরভাবে ব্লক করা যায় এবং প্রকৃত ব্যবহারকারীদের প্রবেশাধিকার দেওয়া যায়। তা সত্ত্বেও, ক্যাপচা অন্তর্ভুক্ত করার সময় ব্যবহারকারীর মিথস্ক্রিয়ার উপর এর সম্ভাব্য প্রভাব বিবেচনা করা অত্যাবশ্যক। আপনার ওয়েবসাইটটি যাতে ব্যবহারকারী-বান্ধব থাকে, তা নিশ্চিত করার জন্য সঠিক ভারসাম্য বজায় রাখাই মূল চাবিকাঠি।.

ক্যাপচা কার্যকারিতা

ক্যাপচা চেক অন্তর্ভুক্ত করা আমার ওয়েবসাইটকে অননুমোদিত থেকে রক্ষা করার জন্য একটি শক্ত কৌশল কন্টেন্ট স্ক্র্যাপিং স্বয়ংক্রিয় সরঞ্জামের মাধ্যমে। এটি কেন একটি কার্যকর ব্যবস্থা, সে বিষয়ে আমার দৃষ্টিভঙ্গি নিচে দেওয়া হলো:

- জটিল চ্যালেঞ্জ: পরিশীলিত ক্যাপচা জটিল ধাঁধা তৈরি করে যা স্বয়ংক্রিয়ভাবে চালানো কঠিন সিস্টেম কিন্তু এখনও মানুষের জন্য পরিচালনাযোগ্য।.

- ধ্রুবক আপডেট: ঘন ঘন ক্যাপচা অ্যালগরিদম রিফ্রেশ করে, তারা AI-এর অগ্রগতিকে ছাড়িয়ে যেতে পারে যা অন্যথায় অপরিবর্তিত সিস্টেমগুলিকে এড়িয়ে যেতে পারে।.

- স্তরযুক্ত নিরাপত্তা: যখন অন্যান্য নিরাপত্তা ব্যবস্থার সাথে CAPTCHA ব্যবহার করা হয়, তখন এটি অননুমোদিত অ্যাক্সেসের বিরুদ্ধে একটি সুরক্ষিত বাধা তৈরি করে।.

- সতর্কতা: ক্যাপচার পারফরম্যান্স এবং সফলতার হার পর্যবেক্ষণ করলে কখন পরিবর্তন বা উন্নতি করার সময় হয়েছে, তার ইঙ্গিত পাওয়া যায়।.

যদিও CAPTCHA যোগ করা নিরাপত্তা জোরদার করে, আমি সর্বদা নীতিগত দিকটি বিবেচনা করি এবং ব্যবহারকারীদের উপর এর প্রভাব যতটা সম্ভব কম রাখার লক্ষ্য রাখি। শক্তিশালী নিরাপত্তা এবং ব্যবহারকারীর অ্যাক্সেসযোগ্যতার মধ্যে সঠিক ভারসাম্য খুঁজে বের করা একটি সতর্ক, ধারাবাহিক কাজ।.

ব্যবহারকারীর অভিজ্ঞতার প্রভাব

ক্যাপচা (CAPTCHA) চেক চালু করার সময় আমি ভালোভাবেই অবগত যে, এআই (AI) ব্যবহার করে কনটেন্ট স্ক্র্যাপ করা বটগুলোকে আটকাতে এগুলো কার্যকর হলেও, মাঝে মাঝে ব্যবহারকারীদের বিরক্ত করতে পারে। আমার মূল্যায়নে দেখা গেছে যে, এই বটগুলোকে দূরে রাখতে ক্যাপচা কার্যকর, যা ওয়েবসাইট ভিজিটরদের প্রবাহ পরিচালনা করতে সাহায্য করে এবং অনুমতি ছাড়া কনটেন্ট কপি হওয়ার সম্ভাবনা কমায়। তা সত্ত্বেও, আপনার সাইটে আসা মানুষদের দূরে সরিয়ে দেওয়া থেকে বিরত থাকতে এই টুলটি বিচক্ষণতার সাথে ব্যবহার করা অত্যাবশ্যক। মূল বিষয়টি হলো আপনার কনটেন্টকে সহজলভ্য করা এবং এটিকে অনাকাঙ্ক্ষিত এআই স্ক্র্যাপিং থেকে রক্ষা করার মধ্যে সঠিক ভারসাম্য খুঁজে বের করা। অতিরিক্ত ক্যাপচা পরীক্ষা বটের মতোই প্রকৃত ব্যবহারকারীদেরও দূরে সরিয়ে দিতে পারে। আমি সাইটের বাকি অংশকে ব্যবহারকারী-বান্ধব রেখে, সেইসব জায়গায় ক্যাপচা ব্যবহার করি যেখানে স্ক্র্যাপিং হওয়ার সম্ভাবনা সবচেয়ে বেশি। আমার লক্ষ্য হলো সাইট ভিজিটরদের একটি চমৎকার অভিজ্ঞতা প্রদান করা এবং একই সাথে সাইটের কনটেন্টকে এআই দ্বারা যেকোনো অননুমোদিত স্ক্র্যাপিং থেকে সুরক্ষিত রাখা।.

নির্দিষ্ট এআই ক্রলার ব্লক করা

একজন ওয়েবসাইট পরিচালক হিসেবে, আমার সাইট থেকে কন্টেন্ট কপি করা বন্ধ করার জন্য OpenAI-এর GPTBot-এর মতো নির্দিষ্ট কিছু এআই ক্রলারকে ব্লক করার ক্ষমতা আমার আছে। এই পদক্ষেপটি শুধুমাত্র আমার কন্টেন্টের অননুমোদিত সংগ্রহ বন্ধ করার জন্যই নয়, বরং কন্টেন্ট ব্যবহার সংক্রান্ত নৈতিক মান এবং আইনি নিয়মকানুনকে সম্মান জানানোর জন্যও নেওয়া হয়। আমি যেভাবে বিষয়টি দেখি তা নিচে দেওয়া হলো:

- পরিবর্তন করুন

robots.txt ফাইলআমি এই ফাইলটিতে এআই ক্রলারদের জন্য নির্দিষ্ট নির্দেশাবলী যোগ করে দিই, যেখানে উল্লেখ করা থাকে আমার সাইটের কোন কোন অংশে তাদের প্রবেশাধিকার নিষিদ্ধ।.

ব্যবহারকারী-এজেন্ট: GPTBot

অনুমতি না দেওয়া: /

ব্যবহারকারী-এজেন্ট: ChatGPT-ব্যবহারকারী

অনুমতি না দেওয়া: /

ব্যবহারকারী-এজেন্ট: CCBot

অনুমতি না দেওয়া: /

- সার্ভার লগ পরীক্ষা করুনআমার সার্ভারের লগগুলো খতিয়ে দেখা আমার দৈনন্দিন অভ্যাসের অংশ, যাতে কোনো অস্বাভাবিক এআই ক্রলার কার্যকলাপ চোখে পড়ে।.

- ক্যাপচা সেট আপ করুন: আমার ওয়েবসাইটের কিছু অংশে যেখানে ব্যবহারকারীরা যোগাযোগ করেন, আমি ক্যাপচা ব্যবহার করি। এই পরীক্ষাগুলি প্রকৃত মানুষদের স্বয়ংক্রিয় বট থেকে আলাদা করতে দুর্দান্ত।.

- নির্দিষ্ট কিছু আইপি ঠিকানা ব্লক করুন: যখন আমার প্রয়োজন হয়, তখন আমি যেসব আইপি অ্যাড্রেস এআই ক্রলারের সাথে সম্পর্কিত বলে জানি সেগুলো ব্লক করে দেই যাতে সেগুলো আমার সাইট থেকে দূরে থাকে।.

এই কাজগুলো করার মাধ্যমে আমি আমার কন্টেন্ট সুরক্ষিত রাখি এবং ডেটা গোপনীয়তা ও মেধাস্বত্ব সংক্রান্ত নিয়মকানুন মেনে চলি।.

কন্টেন্ট অ্যাক্সেসিবিলিটি পরিচালনা করা

আপনার ওয়েবসাইটের কন্টেন্টকে অননুমোদিত স্ক্র্যাপিং থেকে রক্ষা করা

কন্টেন্ট স্ক্র্যাপিংয়ের উদ্বেগ নিরসনে, আপনার ওয়েবসাইটের কন্টেন্টে কারা প্রবেশ করতে পারবে তা নিয়ন্ত্রণের কার্যকর পদ্ধতিগুলো নিয়ে আলোচনা করা যাক। বটের প্রবেশ সীমিত করা অত্যাবশ্যক, এবং এই স্বয়ংক্রিয় সিস্টেমগুলোকে আপনার সাইটের উপাদান কপি বা ইন্ডেক্স করা থেকে বিরত রাখার জন্য আমি নির্দিষ্ট কিছু কৌশল তুলে ধরব। এর জন্য প্রযুক্তিগত পরিবর্তন এবং সতর্কতার সাথে অ্যাক্সেস কন্ট্রোল ব্যবস্থা নির্ধারণ করতে হবে।.

আপনার ওয়েবসাইটের বিষয়বস্তু সুরক্ষিত রাখা

যারা ওয়েবসাইট পরিচালনা করেন, তাদের জন্য নিজেদের কন্টেন্টকে স্বতন্ত্র রাখা এবং স্বয়ংক্রিয় স্ক্র্যাপিং সিস্টেম থেকে সুরক্ষিত রাখা একটি প্রধান উদ্বেগের বিষয়। নির্দিষ্ট কিছু প্রযুক্তিগত ব্যবস্থা গ্রহণ করলে, কারা আপনার ওয়েবসাইটের কন্টেন্ট অ্যাক্সেস ও ইন্ডেক্স করতে পারবে, তা আপনি নিয়ন্ত্রণ করতে পারেন।.

তুমি তোমার robots.txt ফাইলটি সামঞ্জস্য করার কথা বিবেচনা করতে পারো। সার্চ ইঞ্জিনকে নির্দেশ দেওয়ার জন্য ফাইল আপনার সাইটের কোন অংশে অ্যাক্সেস করা উচিত নয় তা বট নির্ধারণ করে। ক্যাপচা সিস্টেম ব্যবহার করলে মানুষের ব্যবহারকারীদের বাধা না দিয়েও বটগুলিকে আটকানো যেতে পারে। আরও পরিশীলিত পদ্ধতির জন্য, আপনি বৈধ দর্শক এবং সম্ভাব্য স্ক্র্যাপারদের মধ্যে পার্থক্য করার জন্য সার্ভার-সাইড চেক প্রয়োগ করতে পারেন।.

মনে রাখবেন, আপনার কন্টেন্টের অখণ্ডতা এবং এক্সক্লুসিভিটি অত্যন্ত গুরুত্বপূর্ণ। আপনার সাইটকে সুরক্ষিত করার জন্য সক্রিয় পদক্ষেপ গ্রহণের মাধ্যমে, আপনি আপনার কন্টেন্ট এবং এর বিতরণের উপর নিয়ন্ত্রণ বজায় রাখেন। সর্বোপরি, আপনার তৈরি করা কন্টেন্ট আপনার ব্র্যান্ডের প্রতিফলন এবং যত্ন সহকারে সুরক্ষিত করা উচিত।.

বট অ্যাক্সেস সীমিত করা

বট অ্যাক্সেস সীমিত করা

আমি দেখেছি যে কিছু নির্দিষ্ট পদক্ষেপ নিলে স্বয়ংক্রিয় সিস্টেমের মাধ্যমে আমার সাইট থেকে কনটেন্ট সংগ্রহের ঝুঁকি অনেকটাই কমানো যায়। আমি যেভাবে এটি করি তা হলো:

- Robots.txt অ্যাডজাস্ট করা হচ্ছে: আমি আমার

robots.txt ফাইলস্ক্র্যাপিংয়ের আইনি দিকগুলি এবং ডেটা গোপনীয়তার উদ্বেগগুলি মাথায় রেখে বট অ্যাক্সেস নিয়ন্ত্রণ করার জন্য ফাইল।. - হার সীমা বাস্তবায়ন: আমার সার্ভারে রেট লিমিট চালু করে, আমি বট ট্র্যাফিকের সম্ভাব্য বিঘ্নকারী প্রভাবগুলি নিয়ন্ত্রণ করতে পারি।.

- API নিয়ন্ত্রণ প্রয়োগ করা হচ্ছে: আমি API গুলির মাধ্যমে যতটা প্রয়োজন ততটা কম তথ্য শেয়ার করি এবং প্রবেশ সীমাবদ্ধ করার জন্য সঠিক প্রমাণীকরণের প্রয়োজন হয়।.

- কন্টেন্ট ডেলিভারি নেটওয়ার্ক ব্যবহার করা: বট পরিচালনার ক্ষমতা সম্পন্ন সিডিএন ব্যবহার করে আমি আমার কন্টেন্ট কে অ্যাক্সেস করছে তা পরিচালনা করতে এবং কার্যকরভাবে এটি সুরক্ষিত করতে পারি।.

এই পদক্ষেপগুলি গ্রহণ করলে স্বয়ংক্রিয় সরঞ্জাম দ্বারা অননুমোদিতভাবে কন্টেন্ট সংগ্রহের বিরুদ্ধে একটি শক্তিশালী প্রতিরক্ষা ব্যবস্থা তৈরি হয়।.

কন্টেন্ট স্ক্র্যাপিং প্রতিরোধ

আমার আপডেট করার পর robots.txt ফাইল এখন আমি কন্টেন্ট স্ক্র্যাপিং প্রতিরোধের ব্যবস্থার উপর মনোযোগ দিচ্ছি, যাতে আমার ওয়েবসাইটটি সহজলভ্য ও সুরক্ষিত থাকে। আমি স্ক্র্যাপিংয়ের প্রযুক্তিগত দিক, এর আইনি পরিণতি এবং অত্যাধুনিক এআই স্ক্র্যাপিং পদ্ধতি থেকে ব্যবহারকারীর ডেটা সুরক্ষিত রাখার গুরুত্ব খতিয়ে দেখছি।.

| কৌশল | বিবরণ |

|---|---|

| পরিবর্তনশীল কন্টেন্ট ডেলিভারি | স্বয়ংক্রিয় সরঞ্জামগুলিতে মানুষের দর্শনার্থীদের তুলনায় ভিন্ন সামগ্রী সরবরাহ করুন।. |

| ব্যবহারকারীর কার্যকলাপ পর্যবেক্ষণ | এমন আচরণ পরীক্ষা করুন যা স্ক্র্যাপিংয়ের ইঙ্গিত দিতে পারে।. |

| অ্যাক্সেস বিধিনিষেধ | ব্যবহারকারীরা কত ঘন ঘন কন্টেন্ট অ্যাক্সেস করতে পারবেন তা নিয়ন্ত্রণ করুন এবং সন্দেহজনক IP ঠিকানাগুলি ব্লক করুন।. |

এই কৌশলগুলো সতর্কতার সাথে প্রয়োগ করার মাধ্যমে, আমি শুধু আমার ওয়েবসাইটের বিষয়বস্তুই রক্ষা করছি না, বরং ব্যবহারকারীর তথ্যও গোপন ও সুরক্ষিত রাখছি। এটি আমার ওয়েবসাইটের বিষয়বস্তু পরিচালনা করার এবং স্বয়ংক্রিয় সরঞ্জাম দ্বারা অননুমোদিত প্রবেশ বা অপব্যবহার রোধ করার একটি সুচিন্তিত পরিকল্পনা।.

যারা আপনার কঠোর পরিশ্রমের অপব্যবহার করার চেষ্টা করতে পারে, তাদের থেকে এগিয়ে থাকার জন্য এই কৌশলগুলো অবলম্বন করা একটি বুদ্ধিদীপ্ত উপায়। এটা অনেকটা একটি অত্যাধুনিক অ্যালার্ম সিস্টেম স্থাপন করার মতো, যা কেবল অনুপ্রবেশকারীদের উপরই নজর রাখে না, বরং আপনার অতিথিদের গোপনীয়তাকেও সম্মান করে। এর মূল কথা হলো, সম্ভাব্য হুমকির মুখে প্রতিক্রিয়াশীল না হয়ে বরং সক্রিয় হওয়া।.

নিয়মিত নিরাপত্তা ব্যবস্থা আপডেট করা

আপনার robots.txt ফাইল পরিবর্তন করা বা CAPTCHA যোগ করার মতো প্রাথমিক সুরক্ষা ব্যবস্থা গ্রহণ করা একটি দারুণ সূচনা, কিন্তু কন্টেন্ট স্ক্র্যাপ করে এমন উন্নত এআই টুলগুলোর বিরুদ্ধে কার্যকরভাবে সুরক্ষা পেতে আপনার ওয়েবসাইটের নিরাপত্তা কৌশলগুলো ক্রমাগত হালনাগাদ করা অত্যাবশ্যক। প্রযুক্তিগত পরিবেশ প্রতিনিয়ত পরিবর্তনশীল, যেখানে এআই-এর সক্ষমতা আরও অত্যাধুনিক হয়ে উঠছে এবং মাঝে মাঝে পুরোনো নিরাপত্তা পদ্ধতিগুলোকে ফাঁকি দিয়ে যাচ্ছে। অতএব, আপনার ওয়েবসাইটের নিরাপত্তা বজায় রাখার জন্য একটি কৌশলগত, প্রযুক্তি-সচেতন এবং পদ্ধতিগত দৃষ্টিভঙ্গি প্রয়োজন।.

এই হলো আমার কৌশল:

- নিয়মিত নিরাপত্তা পর্যালোচনা: আমি নিয়মিত বিরতিতে নিরাপত্তা পরীক্ষা পরিচালনা করার কথা ভাবছি যাতে কোনও দুর্বলতা দেখা দেয়, তা নিশ্চিত করা যায় যে আমার সুরক্ষা ব্যবস্থাগুলি হালনাগাদ এবং কার্যকর।.

- আপডেটের শীর্ষে থাকা: আমি নতুন নিরাপত্তা প্যাচ সম্পর্কে অবগত থাকি এবং নিশ্চিত করি যে আমার সাইটের সমস্ত সফ্টওয়্যার উপাদানগুলি বর্তমান।.

- নিরাপত্তা ব্যবস্থা গ্রহণআমি নির্দিষ্ট হুমকি মোকাবেলার জন্য আমার নিরাপত্তা সেটিংস ঠিক করি, যা কনটেন্ট সুরক্ষিত রাখা এবং সঠিক কারণে সেটির সহজলভ্যতা নিশ্চিত করার মধ্যে একটি স্বাস্থ্যকর ভারসাম্য বজায় রাখতে সাহায্য করে।.

- ট্রাফিক বিশ্লেষণ এবং প্রতিবেদনআমার সাইটে ট্র্যাফিকের প্রবাহের উপর নজর রেখে এবং অ্যাক্সেস লগগুলো পুঙ্খানুপুঙ্খভাবে পরীক্ষা করে, আমি দ্রুত সন্দেহজনক কার্যকলাপ শনাক্ত করতে ও তার বিরুদ্ধে ব্যবস্থা নিতে পারি, যা এআই স্ক্র্যাপিংয়ের চেষ্টার ইঙ্গিত দিতে পারে।.

আমার ওয়েবসাইট সুরক্ষিত করা এমন কোনো ব্যাপার নয় যে একবার করে দিলেই কাজ শেষ; বরং অসৎ উদ্দেশ্যপ্রণোদিত ব্যক্তিদের প্রতিহত করা এটি একটি নিরন্তর চ্যালেঞ্জ। নিরাপত্তার বিষয়ে সতর্ক ও সক্রিয় থাকার মাধ্যমে আমি শুধু আমার সাইটের বিষয়বস্তুই নয়, বরং দর্শকদের গোপনীয়তাও রক্ষা করছি।.

আইনি সুরক্ষা অন্বেষণ

আইনি জটিলতাগুলো সামলে, আমার ওয়েবসাইটকে সুরক্ষিত রাখতে আমি অননুমোদিত এআই স্ক্র্যাপিংয়ের বিরুদ্ধে কপিরাইট আইন ও বিধিমালা খতিয়ে দেখছি। জাতীয় ও আন্তর্জাতিক কপিরাইট আইনগুলো আমার সাইটের বিষয়বস্তুকে কীভাবে প্রভাবিত করে, তা বোঝার জন্য একটি পদ্ধতিগত পন্থা অবলম্বন করা অপরিহার্য। এআই-চালিত লঙ্ঘন থেকে আমার বিষয়বস্তুকে কীভাবে রক্ষা করা যায়, তা দেখতে আমি ডিজিটাল মিলেনিয়াম কপিরাইট অ্যাক্ট (DMCA)-ও পর্যালোচনা করেছি।.

ওয়েবসাইট থেকে ডেটা ব্যবহার ও সংগ্রহ করার ক্ষেত্রে এআই টুলগুলো যেন তাদের অধিকারের অপব্যবহার না করে, তা নিশ্চিত করার জন্য সেগুলোর ব্যবহারের শর্তাবলী মূল্যায়ন করা একটি দায়িত্বশীল পদক্ষেপ। আমার সাইটের ব্যবহারকারীর অভিজ্ঞতা অক্ষুণ্ণ রাখতে এবং আমার কন্টেন্টের অপব্যবহার রোধ করতে এই খুঁটিনাটি বিষয়ের প্রতি মনোযোগ দেওয়া অত্যন্ত গুরুত্বপূর্ণ, যা আমার ব্র্যান্ডের প্রভাব কমিয়ে দিতে পারে এবং ভিজিটরদের সম্পৃক্ততা হ্রাস করতে পারে।.

এছাড়াও, স্ক্র্যাপিংয়ের প্রচেষ্টা শনাক্ত ও প্রতিহত করার জন্য আমি কঠোর অ্যাক্সেস কন্ট্রোল এবং নিয়মিত ট্র্যাফিক বিশ্লেষণের মতো প্রযুক্তিগত কৌশল গ্রহণের কথা ভাবছি। আমার ওয়েবসাইটের স্বাতন্ত্র্য বজায় রাখতে এবং এর পেছনের সৃজনশীল প্রচেষ্টাকে সুরক্ষিত রাখতে আইনি ব্যবস্থা ও প্রযুক্তিগত সুরক্ষার সমন্বয়ই আমার পরিকল্পনা।.

সচরাচর জিজ্ঞাস্য

আমি যদি এআই টুলগুলোকে আমার ওয়েবসাইট স্ক্র্যাপ করা থেকে ব্লক করি, তাহলে কি গুগল বা বিং-এর মতো অন্যান্য সার্চ ইঞ্জিনে আমার সাইটের দৃশ্যমানতা বা র্যাঙ্কিংয়ের ওপর এর কোনো প্রভাব পড়বে?

আমি বিবেচনা করছি যে এআই টুলগুলোকে আমার ওয়েবসাইট স্ক্র্যাপ করা থেকে বিরত রাখলে আমার সাইটের পারফরম্যান্সে কোনো পরিবর্তন আসতে পারে কিনা। গুগলের মতো সার্চ ইঞ্জিন অথবা বিং। অনলাইন দৃশ্যমানতা সম্পর্কে যেকোনো বিভ্রান্তি দূর করা গুরুত্বপূর্ণ; এইগুলি সার্চ ইঞ্জিনগুলি র্যাঙ্কিংয়ের জন্য অনন্য অ্যালগরিদম ব্যবহার করে. তারা শুধুমাত্র এআই টুলের ইন্ডেক্সিংয়ের উপর নির্ভর করে না। আমার লক্ষ্য হলো আমার কন্টেন্ট সুরক্ষিত রাখা এবং একই সাথে একটি ভালো অবস্থান ধরে রাখা। অনুসন্ধান ফলাফল. বাস্তবে, এর অর্থ হল আমার সুরক্ষার মধ্যে একটি সতর্ক ভারসাম্য খুঁজে বের করা ওয়েবসাইটের বিষয়বস্তু এবং শক্তিশালী এসইও অর্জন ফলাফল.

আমার ওয়েবসাইটের ট্র্যাফিক বিশ্লেষণ করার সময় আমি কীভাবে বৈধ সার্চ ইঞ্জিন ক্রলার এবং এআই স্ক্র্যাপারের মধ্যে পার্থক্য করতে পারি?

আমার অনুসন্ধান ইঞ্জিনের দিকে তাকালে বৈধ অনুসন্ধান ইঞ্জিন ক্রলার এবং অননুমোদিত এআই স্ক্র্যাপারগুলির মধ্যে পার্থক্য করার জন্য ওয়েবসাইটের ট্র্যাফিক, আমি ব্যবহারকারীর আচরণের ধরণগুলি ঘনিষ্ঠভাবে পরীক্ষা করি যা স্বয়ংক্রিয় মিথস্ক্রিয়ার ইঙ্গিত দিতে পারে। সম্ভাব্য ক্ষতিকারক ট্র্যাফিক এড়াতে, আমি আইপি ব্লকিং কৌশল প্রয়োগ করি। আমি বট সনাক্তকরণ সরঞ্জামগুলিরও সুবিধা গ্রহণ করি, যা আমাকে অননুমোদিত বটগুলি চিহ্নিত করতে এবং নিয়ন্ত্রণ করতে সহায়তা করে। এই ব্যবস্থাগুলি আমাকে আমার সামগ্রী সুরক্ষিত করতে সাহায্য করে এবং নিশ্চিত করে যে আমার সাইটটি সম্মানিতদের কাছে অ্যাক্সেসযোগ্য থাকে। সার্চ ইঞ্জিন.

প্রকৃত এবং কৃত্রিম ট্র্যাফিকের মধ্যে পার্থক্য বুঝতে পারলে আমার ওয়েবসাইটের অ্যানালিটিক্স নির্ভুল থাকে এবং আমার কন্টেন্ট ভুল হাতে পড়ে না। একজন ওয়েবসাইট মালিক হিসেবে, আমার ডিজিটাল সম্পত্তি সুরক্ষিত রাখা আমার দায়িত্ব, ঠিক যেমন একজন তার ভৌত দোকানকে চোরদের হাত থেকে রক্ষা করে। এই কৌশলগুলো অনুসরণ করে, আমি আত্মবিশ্বাসের সাথে আমার ওয়েবসাইটের ট্র্যাফিক পরিচালনা করতে এবং এর অখণ্ডতা বজায় রাখতে পারি।.

যদি আমি লক্ষ্য করি যে আমার কন্টেন্ট ইতিমধ্যেই আমার অনুমতি ছাড়াই একটি AI টুল দ্বারা স্ক্র্যাপ করা হয়েছে, তাহলে আমার কী পদক্ষেপ নেওয়া উচিত?

আমার অনুমতি ছাড়াই কোনো এআই টুল আমার কন্টেন্ট ব্যবহার করেছে জানতে পারলে, প্রথম পদক্ষেপ হলো এই লঙ্ঘনের প্রতিটি ঘটনা পুঙ্খানুপুঙ্খভাবে নথিভুক্ত করা। এরপর, আমি দায়ী পক্ষের সাথে যোগাযোগ করে, অথবা প্রয়োজনে ডিএমসিএ টেকডাউন অনুরোধ জারি করে আমার কন্টেন্ট পুনরুদ্ধারের চেষ্টা করব। যদি এই পদক্ষেপগুলো সমস্যার সমাধান করতে ব্যর্থ হয়, তবে আইনি ব্যবস্থা নেওয়ার কথা বিবেচনা করা যেতে পারে। এছাড়াও, আমার কাজের অননুমোদিত ব্যবহার সম্পর্কে জনসাধারণকে অবহিত করা এবং এআই টুলের নৈতিক ব্যবহারকে উৎসাহিত করা উপকারী। অনলাইনে নিজের সৃজনশীল অধিকার রক্ষায় সতর্কতা এবং তাৎক্ষণিক পদক্ষেপই মূল চাবিকাঠি।.

মনে রাখবেন: আপনার সৃজনশীল কাজ রক্ষা করা শুধু একটি অধিকারই নয়, এটি একটি দায়িত্বও।.

আমার কন্টেন্টে ওয়াটারমার্ক যুক্ত করার জন্য কোনো ইন্ডাস্ট্রি স্ট্যান্ডার্ড বা সেরা অনুশীলন আছে কি, যা নির্দেশ করবে যে এটি এআই মডেল প্রশিক্ষণের জন্য ব্যবহার করা উচিত নয়?

আমি বর্তমানে এআই মডেল প্রশিক্ষণে অননুমোদিত ব্যবহার থেকে আমার কন্টেন্ট সুরক্ষিত রাখার পদ্ধতিগুলো পর্যালোচনা করছি। একটি উপায় হলো ডিজিটাল ওয়াটারমার্কিং এবং কন্টেন্ট ফিঙ্গারপ্রিন্টিং ব্যবহার করা, যা আমার কাজে অদৃশ্য চিহ্ন বা স্বতন্ত্র কোড যুক্ত করে। ব্যবহারের বিষয়ে সুস্পষ্ট নীতিমালার সাথে মিলিত হয়ে, এই কৌশলগুলো একটি চিহ্ন হিসেবে কাজ করে যে আমার উপকরণগুলো এআই মডেল প্রশিক্ষণের জন্য ব্যবহার করা উচিত নয়। এই বিষয়ে কমিউনিটি এখনও একটি সাধারণ নির্দেশিকা তৈরির জন্য কাজ করছে, তাই আমার কাজ যাতে সঠিকভাবে সুরক্ষিত থাকে তা নিশ্চিত করতে আমি সর্বশেষ কৌশলগুলো সম্পর্কে অবগত থাকছি।.

“এমন এক যুগে যেখানে অ্যালগরিদমে ক্রমাগত ডেটা যোগ করা হচ্ছে, সেখানে মেধাস্বত্ব রক্ষা করা নির্মাতাদের জন্য একটি সাধারণ উদ্বেগের বিষয়। সক্রিয় ও অবহিত থাকাই বুদ্ধিমানের কাজ।”

যদি AI টুলগুলি CAPTCHA বাইপাস করার ক্ষমতা বিকাশ করে, তাহলে আমার ওয়েবসাইটকে অননুমোদিত ডেটা নিষ্কাশন থেকে রক্ষা করার জন্য আমাকে আরও উন্নত সুরক্ষা কৌশল গ্রহণ করতে হবে। একটি কার্যকর পদ্ধতি হল আচরণগত বায়োমেট্রিক্স, যা ব্যবহারকারীরা সাইটের সাথে কীভাবে ইন্টারঅ্যাক্ট করে তাতে অনিয়ম পর্যবেক্ষণ করে। এটি মানব দর্শনার্থী এবং সম্ভাব্য স্বয়ংক্রিয় স্ক্র্যাপারদের মধ্যে পার্থক্য করতে সাহায্য করতে পারে।.

সুরক্ষার আরেকটি স্তরের মধ্যে রয়েছে আঙুলের ছাপ বিশ্লেষণ. এই কৌশলটি একটি ডিভাইস এবং তার ব্রাউজারের অনন্য বৈশিষ্ট্যগুলি মূল্যায়ন করে, যেমন অপারেটিং সিস্টেম, স্ক্রিন রেজোলিউশন এবং ইনস্টল করা ফন্ট, যাতে বট কার্যকলাপের সাধারণ অসঙ্গতিগুলি সনাক্ত করা যায়।.

এক ধাপ এগিয়ে থাকার জন্য, আমি পদক্ষেপ নেব অভিযোজিত চ্যালেঞ্জ. এগুলো হলো নিরাপত্তা যাচাই প্রক্রিয়া, যার জটিলতা মূল্যায়িত ঝুঁকির উপর ভিত্তি করে পরিবর্তিত হতে পারে, যা শনাক্তকৃত হুমকির মাত্রার সাথে সামঞ্জস্যপূর্ণ একটি গতিশীল প্রতিরক্ষা ব্যবস্থা নিশ্চিত করে। এই উন্নত পদ্ধতিগুলো প্রয়োগ করে, আমি সর্বশেষ এআই-চালিত স্ক্র্যাপিং টুলগুলোর বিরুদ্ধে আমার ওয়েবসাইটের নিরাপত্তাকে উল্লেখযোগ্যভাবে শক্তিশালী করতে পারি।.

ওয়ার্ল্ড ওয়াইড ওয়েবের প্রেক্ষাপটে এআই স্ক্র্যাপিং সুরক্ষা কী?

এআই স্ক্র্যাপিং সুরক্ষা বলতে এমন পদ্ধতি এবং প্রযুক্তি বোঝায় যা স্বয়ংক্রিয় বটগুলিকে অনুমতি ছাড়া ওয়েবসাইট থেকে ডেটা সংগ্রহ বা স্ক্র্যাপ করা থেকে বিরত রাখার জন্য ব্যবহৃত হয়। এই প্রযুক্তিগুলি এই ধরনের কার্যকলাপ সনাক্ত, সনাক্ত এবং ব্লক করার জন্য কৃত্রিম বুদ্ধিমত্তার ক্ষমতা ব্যবহার করে।.

কেন AI স্ক্র্যাপার ইন্টারনেটে বৌদ্ধিক সম্পত্তির জন্য হুমকি?

এআই স্ক্র্যাপারগুলি হুমকির কারণ হয়ে দাঁড়ায় কারণ তারা দ্রুত এবং দক্ষতার সাথে ওয়েবে প্রকাশিত বিপুল পরিমাণে মালিকানাধীন তথ্য সংগ্রহ করতে পারে। এই ডেটাতে কপিরাইটযুক্ত সামগ্রী, বাণিজ্য গোপনীয়তা, ডাটাবেস বা অন্যান্য ডিজিটাল সম্পদ অন্তর্ভুক্ত থাকতে পারে যা কেবলমাত্র উৎস ওয়েবসাইটে ব্যবহারের উদ্দেশ্যে তৈরি।.

একটি AI স্ক্র্যাপার কিভাবে কাজ করে?

একটি AI স্ক্র্যাপার মানুষের ব্রাউজিং আচরণের অনুকরণ করে কাজ করে। এটি ওয়েব পৃষ্ঠাগুলি পরিদর্শন করে, পূর্ব-নির্ধারিত মানদণ্ডের উপর ভিত্তি করে প্রাসঙ্গিক তথ্য সনাক্ত করে, তারপর অন্য কোথাও ব্যবহারের জন্য এই ডেটা বের করে। এই সরঞ্জামগুলির পরিশীলিততা ব্যাপকভাবে পরিবর্তিত হয়; কিছু জটিল সাইট কাঠামো নেভিগেট করতে এবং মৌলিক অ্যান্টি-স্ক্র্যাপিং ব্যবস্থা এড়াতে সক্ষম।.

AI স্ক্র্যাপিং সুরক্ষায় সাধারণত কোন কৌশলগুলি ব্যবহার করা হয়?

এআই স্ক্র্যাপিং সুরক্ষায় প্রায়শই ব্যবহৃত কৌশলগুলির মধ্যে রয়েছে রেট লিমিটিং (একটি নির্দিষ্ট সময়ের মধ্যে একটি আইপি অ্যাড্রেস কতগুলি অনুরোধ করতে পারে তা সীমাবদ্ধ করা), ক্যাপচা পরীক্ষা (যা ব্যবহারকারীদের তারা মানুষ তা প্রমাণ করার জন্য চ্যালেঞ্জ করে), ব্যবহারকারী এজেন্ট বিশ্লেষণ (সন্দেহজনক ব্রাউজার কার্যকলাপ সনাক্ত করার জন্য), এবং আরও উন্নত মেশিন লার্নিং অ্যালগরিদম যা বট আচরণের ইঙ্গিতকারী অস্বাভাবিক প্যাটার্ন সনাক্ত করতে পারে।.

ওয়েব স্ক্র্যাপিং কার্যকলাপ থেকে রক্ষা করার জন্য কি কৃত্রিম বুদ্ধিমত্তা ব্যবহার করা যেতে পারে?

হ্যাঁ, ওয়েব স্ক্র্যাপিং সনাক্তকরণ এবং প্রতিরোধের জন্য মেশিন লার্নিং অ্যালগরিদমের মতো বিভিন্ন ধরণের কৃত্রিম বুদ্ধিমত্তা ব্যবহার করা যেতে পারে। এই সিস্টেমগুলি বট আচরণের পূর্ববর্তী উদাহরণগুলি থেকে শিক্ষা নেয়, যা তাদের ভবিষ্যতের সম্ভাব্য আক্রমণগুলিকে আরও ভালভাবে অনুমান করতে এবং প্রতিহত করতে সহায়তা করে। তারা রিয়েল-টাইম সনাক্তকরণ কৌশলগুলিও প্রয়োগ করতে পারে যা সন্দেহজনক বট কার্যকলাপ দেখা দিলে তাৎক্ষণিক পদক্ষেপ নেওয়ার অনুমতি দেয়।.

আপনার ওয়েবসাইটকে AI টুল দ্বারা স্ক্র্যাপ হওয়া থেকে রক্ষা করার বিষয়ে আমার শেষ চিন্তাভাবনা

আমার ওয়েবসাইটকে অনাকাঙ্ক্ষিত এআই স্ক্র্যাপিং থেকে সুরক্ষিত রাখা একটি চলমান প্রচেষ্টা, যার জন্য অধ্যবসায় প্রয়োজন। আমি দেখেছি যে robots.txt-এর বুদ্ধিদীপ্ত ব্যবহার, CAPTCHA প্রয়োগ করা, পরিচিত এআই স্ক্র্যাপারদের ব্লক করা, কন্টেন্টে প্রবেশাধিকার নিয়ন্ত্রণ করা এবং আমার নিরাপত্তা ব্যবস্থাগুলো নিয়মিতভাবে হালনাগাদ করা অত্যন্ত গুরুত্বপূর্ণ পদক্ষেপ। যদিও আইনি ব্যবস্থা গ্রহণ করা সুরক্ষার একটি অতিরিক্ত স্তর প্রদান করে, তবুও সতর্ক এবং প্রযুক্তিগতভাবে দক্ষ থাকাটাই মূল চাবিকাঠি, যা আমার কন্টেন্টকে আমার আওতার মধ্যে রাখতে সাহায্য করে। এর ফলে আমার ওয়েবসাইটের অখণ্ডতা এবং দর্শনার্থীদের জন্য এর উপযোগিতা বজায় থাকে।.

প্রামাণিক তথ্যসূত্র

যদি আপনি আপনার ওয়েবসাইটগুলিকে AI ক্রলার থেকে রক্ষা করার বিষয়ে আরও কিছু পড়তে চান, তাহলে আমি আপনাকে নিম্নলিখিত পোস্টটি একবার দেখার পরামর্শ দিচ্ছি:

- ITPro – AI ওয়েব স্ক্র্যাপিং: কীভাবে আপনার ব্যবসাকে এইসব থেকে রক্ষা করবেন

- এই প্রবন্ধে AI ওয়েব স্ক্র্যাপিংয়ের জটিলতা এবং এর সাথে সম্পর্কিত ঝুঁকি নিয়ে আলোচনা করা হয়েছে। এটি AI কীভাবে দ্রুত এবং পরিশীলিতভাবে ডেটা সংগ্রহ করতে পারে, বিশ্লেষণ করে আউটপুট তৈরি করতে পারে সে সম্পর্কে অন্তর্দৃষ্টি প্রদান করে।.

- আইটিপ্রো প্রবন্ধ

- লেখক গিল্ড - লেখকদের তাদের কাজগুলিকে AI ব্যবহার থেকে রক্ষা করার জন্য ব্যবহারিক টিপস

- এই রিসোর্সটি লেখক এবং ওয়েবসাইট মালিকদের জন্য তাদের কাজকে এআই-এর ব্যবহার থেকে সুরক্ষিত রাখার বিষয়ে বাস্তবসম্মত পরামর্শ প্রদান করে, যার মধ্যে OpenAI-এর GPTBot-এর মতো এআই ওয়েব ক্রলারদের ব্লক করতে robots.txt ফাইল ব্যবহারের উপায়ও রয়েছে।.

- লেখক গিল্ড টিপস

- রেজোলিউশন ডিজিটাল – ওয়েবসাইটকে সুরক্ষিত রাখুন এআই কন্টেন্ট স্ক্র্যাপিং

- এই প্রবন্ধে ChatGPT-এর মতো AI টুলগুলির দ্বারা স্ক্র্যাপিং এবং অননুমোদিত ব্যবহার থেকে আপনার ওয়েবসাইটকে রক্ষা করার সহজ পদক্ষেপগুলি প্রদান করা হয়েছে। এটি robots.txt ফাইলের ব্যবহার, CAPTCHA বাস্তবায়ন এবং IP রেঞ্জ ব্লক সম্পর্কে আলোচনা করে।.

- রেজোলিউশন ডিজিটাল গাইড

- অক্টোপার্স - ব্র্যান্ড সুরক্ষা এবং সাইবার নিরাপত্তার জন্য ওয়েব স্ক্র্যাপিং

- এই ব্লগ পোস্টটিতে ব্র্যান্ড সুরক্ষা এবং সাইবার নিরাপত্তার জন্য ওয়েব স্ক্র্যাপিং কীভাবে ব্যবহার করা যেতে পারে তা অন্বেষণ করা হয়েছে। এটি সম্ভাব্য লঙ্ঘন এবং কপিরাইট লঙ্ঘন খুঁজে বের করার জন্য ওয়েব স্ক্র্যাপিং সরঞ্জামগুলির ব্যবহার নিয়ে আলোচনা করে।.

- অক্টোপার্স আর্টিকেল

- সায়েন্সডাইরেক্ট – এআই ওয়েব স্ক্র্যাপিংয়ের বিরুদ্ধে যুদ্ধ

- সায়েন্সডাইরেক্টের এই প্রবন্ধটি এআই ওয়েব স্ক্র্যাপিং-এর প্রতি ক্রমবর্ধমান আপত্তিগুলি অন্বেষণ করে, এআই-এর দ্রুত অগ্রগতি এবং টেক্সট এবং অন্যান্য ডিজিটাল কন্টেন্টের বিশাল ডেটা সেটের উপর এর প্রশিক্ষণের উপর আলোকপাত করে।.

- সায়েন্সডাইরেক্ট প্রবন্ধ